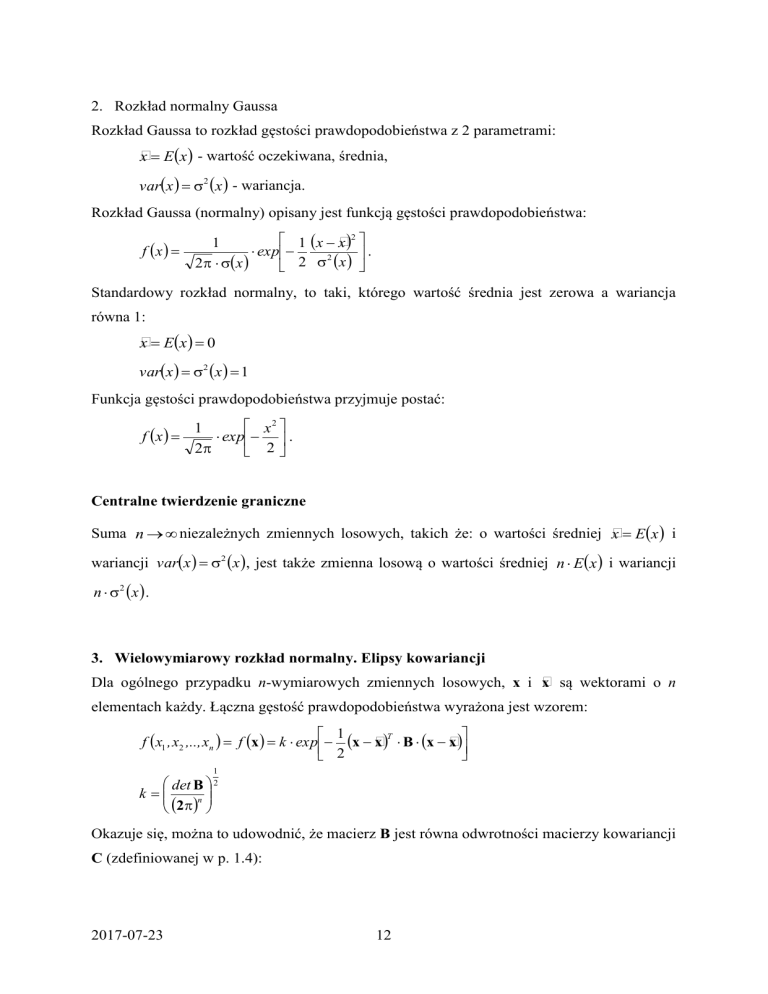

2. Rozkład normalny Gaussa

Rozkład Gaussa to rozkład gęstości prawdopodobieństwa z 2 parametrami:

x Ex - wartość oczekiwana, średnia,

varx 2 x - wariancja.

Rozkład Gaussa (normalny) opisany jest funkcją gęstości prawdopodobieństwa:

f x

2

1 x

1

x

exp

.

2

2 x

2 x

Standardowy rozkład normalny, to taki, którego wartość średnia jest zerowa a wariancja

równa 1:

x E x 0

varx 2 x 1

Funkcja gęstości prawdopodobieństwa przyjmuje postać:

f x

x2

1

exp .

2

2

Centralne twierdzenie graniczne

Suma n niezależnych zmiennych losowych, takich że: o wartości średniej

x E x i

wariancji varx 2 x , jest także zmienna losową o wartości średniej n E x i wariancji

n 2 x .

3. Wielowymiarowy rozkład normalny. Elipsy kowariancji

x są wektorami o n

Dla ogólnego przypadku n-wymiarowych zmiennych losowych, x i

elementach każdy. Łączna gęstość prawdopodobieństwa wyrażona jest wzorem:

1

T

f x1 , x2 ,.., xn f x k exp x

x B x

x

2

1

det B 2

k

n

2

Okazuje się, można to udowodnić, że macierz B jest równa odwrotności macierzy kowariancji

C (zdefiniowanej w p. 1.4):

2017-07-23

12

definicja

B C1

adjC

,

det C

Przypomnijmy macierz C::

C cij E x

x x

x

T

x1

x1

E x2

x 2 x1

x1 , x2

x2

x

n x n

2

x1

x1

E x2

x 2 x1

x1

x

n x n x1 x1

xn

x n

x1

x1 x2

x 2 x1

x1 xn

x n

2

x2

x2

x2

x 2 xn

x n

2

xn

xn

x n x2

x2

xn

Rozważmy przypadek 2 zmiennych losowych:

x x1 , x2 , E x

x

x1 ,

x2 ,varx1 12 ,varx2 22

T

T

Zgodnie z powyższym, macierz kowariancji C ma postać:

12

covx1 , x2

C

, gdzie covx1 , x2 covx2 , x1

22

covx2 , x1

definicja

a poszukiwana macierz odwrotna B C1

adjC

, po odpowiednich przekształceniach,

det C

wynosi:

22

covx1 , x2

1

B 2 2

.

2

1 2 cov x1 , x2 covx1 , x21

12

Gdy zmienne losowe są niezależne, i covx1 , x2 covx2 , x1 0 , wtedy macierz B ma postać:

2

1

B 2 2 2

1 2 0

1

0 12

12 0

0

.

1

22

W przypadku 2 zmiennych losowych, rolę przedziału ufności przejmują elipsy

kowariancji. Gdy zmiennych jest więcej, mówimy o elipsoidach kowariancji w przestrzeni

wielowymiarowej. Pozostańmy przy elipsach kowariancji.

Aby wyznaczyć linie stałej gęstości prawdopodobieństwa, wykładnik exponenty

funkcji gęstości prawdopodobieństwa f x

2017-07-23

13

1

T

f x1 , x2 f x k exp x

x B x

x

2

1

det B 2

k

n

2

1 1

2 2

1 22

2

1

2

1

21 2

należy przyrównać do wartości stałej, np. do 1:

x x

T

B x

x 1

a1 , a2 i o

Obierzmy przykład 2 zmiennych x x1 , x2 o wartościach średnich E x a

T

T

wariancjach varx1 12 , varx2 22 , dla których macierz B wynosi:

1

2

B 1

0

0

1

22

x B x

x 1 :

Podstawmy powyższe wielkości do równania na elipsę kowariancji x

T

1

2

x1 a1 , x2 a2 1

0

0

x a

1 1 1

1 x2 a 2

22

Po wymnożeniu otrzymujemy równanie:

x1 a1 2 x2 a2 2

12

22

1

Jest to równanie elipsy na płaszczyźnie x1 , x2 , o osiach 21 ,22 i o środku w punkcie o

współrzędnych a1 ,a2 . Kąt nachylenia osi elipsy zależy od znaku i wartości współczynnika

korelacji

cov x1 , x2

(patrz Rys.3). Trzy przedstawione na Rys. 3 przypadki różnią się

1 2

wartością i znakiem współczynnika korelacji ρ 0.00, 0.30, 0.70, 0.99 .

=0, zmienne są niezależne, elipsa przechodzi w koło,

>0, kąt nachylenia osi elipsy 090o,

<0, kąt nachylenia osi elipsy 90180o.

2017-07-23

14

Rys.3. Elipsy kowariancji.

Rys. 4. Gęstość prawdopodobieństwa dla dwuwymiarowego rozkładu Gaussa i

odpowiadająca mu elipsa kowariancji. Przypadki różnią się tylko wartością współczynnika

korelacji -0.50, 0.00, 0.90 .

2017-07-23

15

Na Rys.4 przedstawione są gęstości prawdopodobieństwa

f x1 , x2 x1 , x2 dla

dwuwymiarowego rozkładu Gaussa i odpowiadające im elipsy kowariancji dla współczynnika

korelacji: =-0.5, =0.0, =+0.90.

Poziome przekroje tych funkcji są elipsami wzajemnie koncentrycznymi. Dla maksymalnej

wartości funkcji elipsa przechodzi w punkt o współrzędnych a1 ,a2 : rzut wierzchołka na

płaszczyznę x1 , x2 ma współrzędne a1 ,a2 .

Pionowe przekroje przechodzące przez wierzchołek to krzywe Gaussa, których szerokości

są wyznaczone przez punkty leżące na elipsie kowariancji i są różne dla różnych przekrojów.

Wszystkie inne linie stałego prawdopodobieństwa, gdy wykładnik jest przyrównany do innej

stałej c1, to także elipsy. Leżą one wewnątrz (gdy c>1) lub na zewnątrz (gdy c<1) elipsy

powstałej dla c=1.

Znaczenie elipsy kowariancji dodatkowo ilustruje Rys.5. Punkty leżące na elipsie są

jednakowo prawdopodobne co jest określone przez prawdopodobieństwo Pe . Każdy z

punktów leżących wewnątrz elipsy jest bardziej prawdopodobny od punktu leżącego na

elipsie, a każdy punkt na elipsie jest bardziej prawdopodobny od punktu leżącego na

zewnątrz elipsy. Jest tak niezależnie od tego jakie są geometryczne odległości tych punktów

od środka elipsy. Ilustruje to Rys.5.

Rys.5 Względne prawdopodobieństwo dla kilku punktów dla 2-wymiarowego

rozkładu normalnego. Punkty na elipsie: P1 P2 Pe , punkt wewnątrz elipsy: P3 Pe , punkt

na zewnątrz elipsy: P4 Pe .

Gdyby x miało nie 2 wymiary lecz n wymiarów, wówczas analogiczne rozumowanie

doprowadziłoby do równania:

2017-07-23

16

x1 a1 2 x2 a2 2 ... xn an 2

12

22

2n

1

Jest to równanie elipsoidy w przestrzeni n-wymiarowej, to tzw. hiperpowierzchnia.

Interpretacja i właściwości są takie same jak w przypadku 2-wymiarowym.

4. Pobieranie próby

Próbą nazywamy skończony zbiór doświadczeń dokonywanych w celu określenia rozkładu

badanej zmiennej. Częściej zmierzamy do wyznaczenia parametrów znanego rozkładu, np.

wartości średniej i wariancji dla rozkładu normalnego.

Zbiór wszystkich możliwych doświadczeń jest zazwyczaj nieskończony i nazywamy go

populacją generalną. Próba n-wymiarowa, to taka, która zawiera n elementów.

Na przykład: W wybranej szkole badamy wzrost uczniów z klas pierwszych. Mamy 6 klas po

30 uczniów. Zatem zbiór wszystkich możliwych przypadków, populacja generalna, to 180

uczniów. W każdej klasie badamy 10 uczniów. Oznacza to, że pobrano próbę 60wymiarową.

Załóżmy, że pobraliśmy p prób n-wymiarowych dla zmiennej x:

próba 1-sza

(ważymy uczniów z klasy nr 1)

.............

próba i-ta

(ważymy uczniów z klasy nr i)

.............

próba p-ta

(ważymy uczniów z klasy nr p=6)

x11 , x12 ,....., x1n

(n=10 wyników pomiaru)

.....................

x1i , x2i ,....., xni

(n=10 wyników pomiaru)

....................

x1p , x2p ,....., xnp

(n=10 wyników pomiaru)

Aby pobieranie próby było pobieraniem losowym, łączna gęstość prawdopodobieństwa

badanej zmiennej losowej g x g x1 , x2 ,.., xn musi spełniać następujące warunki formalne:

1. poszczególne xi muszą być niezależne, tzn. g x g1 x1 g 2 x2 ... g n xn ,

2. poszczególne rozkłady muszą być jednakowe i identyczne z rozkładem

f x dla

populacji generalnej, tzn. g1 x =...= g n x = f x

(w klasach są dzieci w równym wieku, żadna klasa nie skupia np. samych przerośniętych

repetentów).

Należy podkreślić, że w rzeczywistym pobieraniu próby często dosyć trudno jest zapewnić

pełną losowość procesu. O ile 1-szy warunek można zweryfikować porównując poszczególne

2017-07-23

17

rozkłady, o tyle warunek 2-gi, odnoszący się do populacji generalnej czasami jest niełatwy do

sprawdzenia.

Aby móc posłużyć się wynikami z próby do wyznaczenia parametrów rozkładu, po prostu

zakładamy, że próba została pobrana losowo. Nie mamy innej możliwości, należy jednak

wiedzieć co to założenie oznacza.

Funkcja zmiennej losowej x, będąca sama zmienną losową, to statystyka. Ważnym

przykładem takiej statystyki jest wartość średnia z próby: x

1

x1 x2 ... xn . Kolejna

n

n-wymiarowa próba tej zmiennej losowej dostarczy kolejną średnią. W tym sensie wartość

średnia z próby jest zmienną losową: x

1

x1 x2 ... xn E x

x

n

Rozważmy obecnie typowy problem, będący przedmiotem zainteresowania analizy danych:

załóżmy, że znamy analityczną postać funkcji, ale nie znamy jednego (lub więcej)

parametrów tej funkcji. Parametr ten (parametry) chcemy wyznaczyć na podstawie próby.

Mamy tu do czynienia z problemem estymacji parametrów. Estymowane parametry są

wyznaczane z próby, są to więc statystyki zwane estymatami, estymatorami (nowa próba, to

nowa wartość estymat). Oznaczmy jako S S x1 , x2 ,.., xn pewien estymator (np. estymator

parametru o prawdziwej wartości a wyznaczany jako średnia na podstawie n-wymiarowej

próby x

1

x1 x2 ... xn ).

n

Estymator S nazywamy nieobciążonym, jeśli ES x1 , x2 ,.., xn a dla każdego n.

0.

Estymator S nazywamy zgodnym, jeśli lim varS lim σ 2 S lim E S S

n

n

n

2

Estymator nieobciążony i zgodny to taki, którego średnia jest równa wartości rzeczywistej a

wariancja jest równa zero.

5. Wartość średnia z próby i wariancja z próby

Pamiętamy, że średnia arytmetyczna z próby ( x ) to nie jest to samo co wartość oczekiwana

(

x ):

x

1

x1 x2 ... xn E x

x , zachodzi natomiast Ex

x.

n

Oznacza to, że wartość oczekiwana zmiennej losowej (jaką jest średnia z próby) jest równa

wartości oczekiwanej tej zmiennej. Inaczej mówiąc: to średnia z wielu średnich staje się

bliska wartości oczekiwanej. Nie dotyczy to jednej, dowolnej z takich średnich x .

Uporządkujemy wyrażenia dotyczące średnich, wariancji i dokładności.

2017-07-23

18

Załóżmy, że zmienna losowa x jest mierzona n-krotnie. Czyli: pobieramy próbę o liczebności

n z populacji generalnej o gęstości prawdopodobieństwa f x odpowiadającej np. rozkładowi

normalnemu. Jest to najczęściej spotykana sytuacja pomiarowa.

Dla próby n-wymiarowej pobranej z populacji

generalnej

1 n

x xi

n i 1

Wartość średnia

Dla populacji generalnej

Wartość średnia

E x

x

xf x dx

σ 2 x E x

x

Wariancja z populacji

2

1 n

xi x 2

n 1 i 1

s 2 x

Wariancja z próby

x f x dx

x

2

-

Wariancja

wartości średniej

-

Błąd dowolnego

-

elementu próby

-

Błąd wartości

-

średniej

2017-07-23

1 2

s x

n

n

1

2

xi x

nn 1 i 1

s 2 x

19

x

1 n

xi x 2

n 1 i 1

x

n

1

xi x 2

nn 1 i1