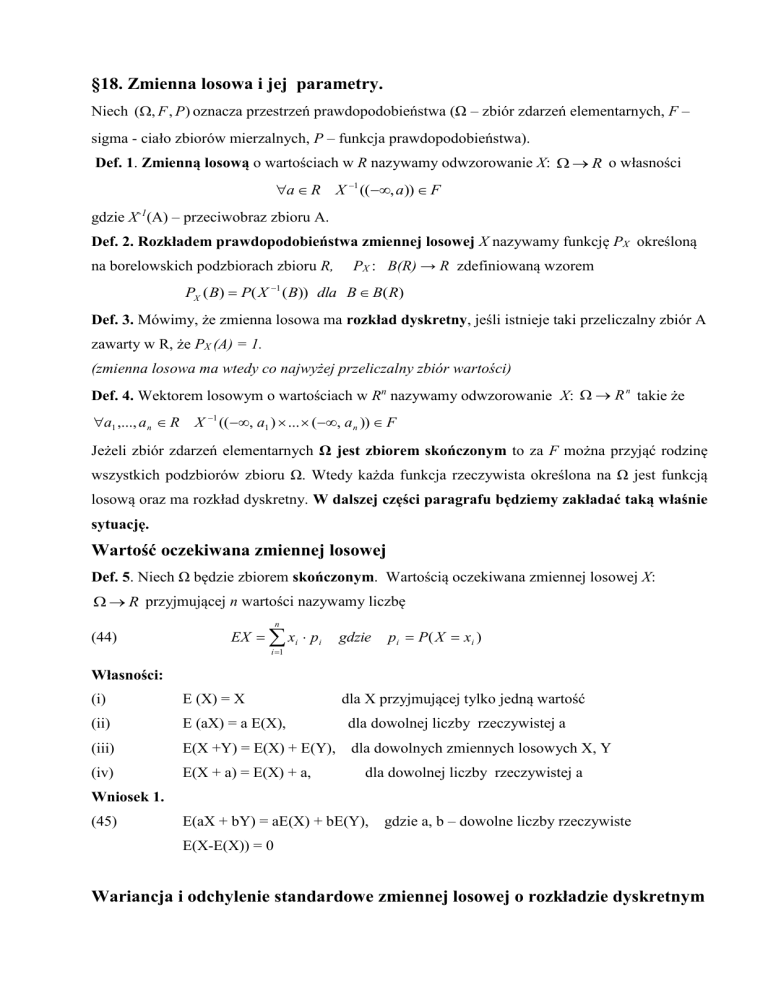

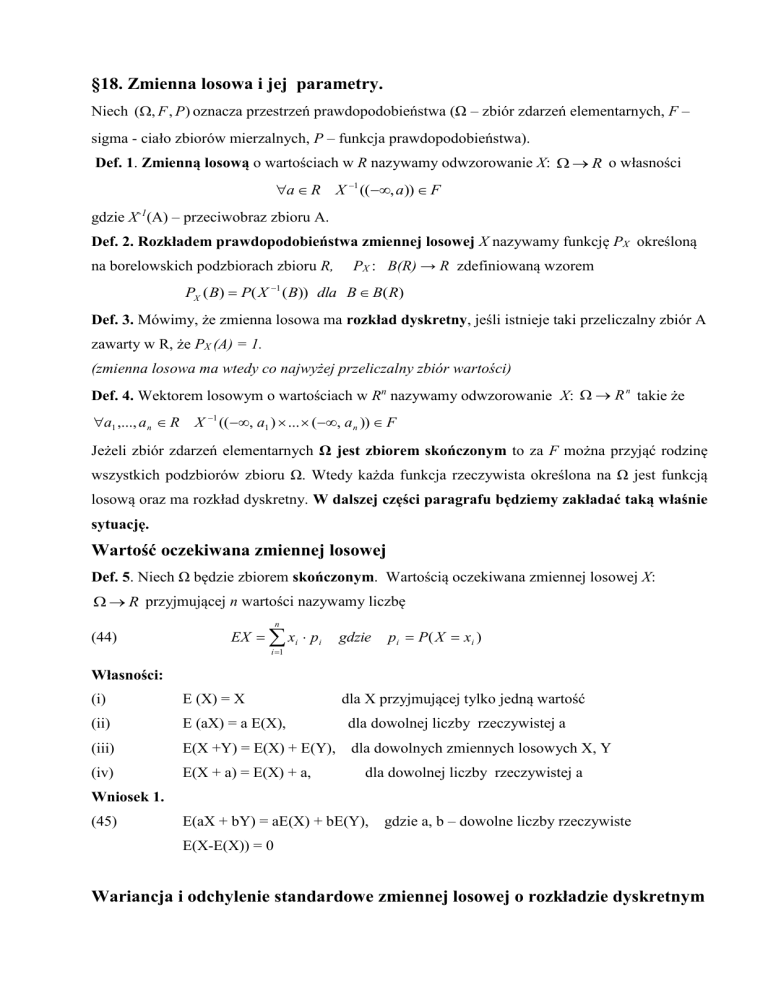

§18. Zmienna losowa i jej parametry.

Niech (, F , P ) oznacza przestrzeń prawdopodobieństwa (Ω – zbiór zdarzeń elementarnych, F –

sigma - ciało zbiorów mierzalnych, P – funkcja prawdopodobieństwa).

Def. 1. Zmienną losową o wartościach w R nazywamy odwzorowanie X: R o własności

a R X 1 ((, a)) F

gdzie X-1(A) – przeciwobraz zbioru A.

Def. 2. Rozkładem prawdopodobieństwa zmiennej losowej X nazywamy funkcję PX określoną

na borelowskich podzbiorach zbioru R,

PX : B(R) → R zdefiniowaną wzorem

PX ( B) P( X 1 ( B)) dla B B( R)

Def. 3. Mówimy, że zmienna losowa ma rozkład dyskretny, jeśli istnieje taki przeliczalny zbiór A

zawarty w R, że PX (A) = 1.

(zmienna losowa ma wtedy co najwyżej przeliczalny zbiór wartości)

Def. 4. Wektorem losowym o wartościach w Rn nazywamy odwzorowanie X: R n takie że

a1 ,..., a n R X 1 (( , a1 ) ... (, a n )) F

Jeżeli zbiór zdarzeń elementarnych Ω jest zbiorem skończonym to za F można przyjąć rodzinę

wszystkich podzbiorów zbioru Ω. Wtedy każda funkcja rzeczywista określona na Ω jest funkcją

losową oraz ma rozkład dyskretny. W dalszej części paragrafu będziemy zakładać taką właśnie

sytuację.

Wartość oczekiwana zmiennej losowej

Def. 5. Niech Ω będzie zbiorem skończonym. Wartością oczekiwana zmiennej losowej X:

R przyjmującej n wartości nazywamy liczbę

n

(44)

EX xi pi

gdzie

i 1

p i P ( X xi )

Własności:

dla X przyjmującej tylko jedną wartość

(i)

E (X) = X

(ii)

E (aX) = a E(X),

dla dowolnej liczby rzeczywistej a

(iii)

E(X +Y) = E(X) + E(Y),

dla dowolnych zmiennych losowych X, Y

(iv)

E(X + a) = E(X) + a,

dla dowolnej liczby rzeczywistej a

Wniosek 1.

(45)

E(aX + bY) = aE(X) + bE(Y),

gdzie a, b – dowolne liczby rzeczywiste

E(X-E(X)) = 0

Wariancja i odchylenie standardowe zmiennej losowej o rozkładzie dyskretnym

Def. 6. Niech – jak poprzednio - Ω będzie zbiorem skończonym. Wariancją zmiennej losowej X:

R przyjmującej n wartości nazywamy liczbę

n

D 2 X ( xi EX ) 2 pi

(46)

gdzie

i 1

p i P ( X xi )

czyli D 2 X E [( X EX ) 2 ]

Wariancję oznacza się również symbolem Var X.

Stwierdzenie 1. Wariancja zmiennej losowej X może być obliczona ze wzoru

Var X = E(X2) – (E(X))2

(47)

Dowód. E[(X-E(X))2] = E(X2 – 2XE(X) + (E(X))2) = E(X2) –2 E(XE(X)) + E(E(X))2 =

= E(X2) – 2 (E(X))2 + (E(X))2 = E(X2) – (E(X))2.

Własności wariancji

(i) Var X > 0

(ii)

jeżeli X przyjmuje tylko jedną wartość, to Var X = 0

(iii)

Var (aX) = a2 VarX

(dla dowolnej liczby rzeczywistej a )

(iv) Var (a +X) = VarX

Def.7. Odchyleniem standardowym zmiennej losowej X nazywamy wartość pierwiastka

kwadratowego z jej wariancji

X VarX

(48)

Niezależność zmiennych losowych

Def. 8. Zmienne X, Y o rozkładzie dyskretnym, przyjmujące odpowiednio n i m wartości,

nazywamy niezależnymi zmiennymi losowymi, gdy spełniony jest warunek

(49) i {1,...., n} k {1,...., m} P( X xi , Y y k ) P( X xi ) P(Y y k )

Uwaga 1. Analogicznie można zdefiniować niezależność l różnych zmiennych losowych;

prawdopodobieństwo dowolnej koniunkcji zdarzeń dotyczącej wielu zmiennych jest równe

iloczynowi prawdopodobieństw związanych z poszczególnymi zmiennymi.

Twierdzenie 2. Jeżeli zmienne losowe X i Y są niezależne, to

(50)

E(XY) = E(X) E(Y)

Dowód. E ( XY ) xi y k pik

gdzie

pik P( X xi , Y y k )

i ,k

E ( XY ) xi y k P( X xi , Y y k ) xi y k P( X xi ) P(Y y k )

i ,k

x y

i

k

k

i

i ,k

P( X xi ) P(Y y k ) y k P(Y y k ) xi P( X xi ) E (Y ) E ( X )

k

i

Uwaga 2. Analogiczne twierdzenie jest prawdziwe przy dowolnej ilości niezależnych zmiennych

losowych.

Twierdzenie 3. Jeżeli zmienne losowe X i Y są niezależne, to

(51)

Var (X + Y) = Var X + Var Y

Uwaga 3. Wariancja sumy większej liczby niezależnych zmiennych losowych jest także równa

sumie wariancji tych zmiennych.

Kowariancja i współczynnik korelacji zmiennych losowych

Def. 9. Kowariancją zmiennych losowych X, Y nazywamy liczbę

Cov( X , Y ) E[( X EX )(Y EY )]

czyli

Cov( X , Y ) ( xi EX )( y k EY ) pik

(52)

gdzie

pik P( X xi , Y y k )

i ,k

Uwaga 4. Kowariancję zmiennych losowych X, Y można przedstawić w postaci

(53)

Cov( X , Y ) xi y k pik EX EY ,

i ,k

gdzie

pik P( X xi , Y y k )

lub inaczej Cov( X , Y ) E ( XY ) EX EY .

Rzeczywiście:

E[(X-EX)(Y-EY)] = E(XY - X EY – Y EX + EX EY) = E(XY) – E(XEY) – E(YEX) + E(EX EY) =

E(XY) – EY EX – EX EY + EX EY = E(XY) – EY EX.

Def. 10. Jeśli Cov (X,Y) = 0, to zmienne X,Y nazywamy nieskorelowanymi, w przeciwnym

wypadku mówimy, że zmienne są skorelowane.

Twierdzenie 4. Jeżeli zmienne losowe X i Y są niezależne, to są nieskorelowane.

Dowód wynika z twierdzenia 2 oraz wzoru (50).

Własności kowariancji (a dowolna liczba rzeczywista):

(i)

Cov(X,Y) = Cov(Y, X)

(ii)

Cov(X,X) = Var X

(iii)

Cov(aX,Y) = a Cov(X,Y)

(iv)

Cov(a+X,Y) = Cov(X,Y)

(v)

Cov(X + Y,Z) = Cov(X,Z) + Cov(Y,Z)

Wniosek 2.

(54)

Cov(aX,bY) = abCov(X,Y)

Można wykazać że zachodzi nierówność

(55)

Cov( X , Y ) VarX VarY ,

przy czym równość zachodzi tylko wtedy, gdy P( X = aY + b ) = 1, dla pewnych rzeczywistych

a,b.

Szczególny przypadek. Jeżeli każda ze zmiennych losowych X,Y przyjmuje n wartości oraz

P ( X xi , Y y i ) p i ,

(56)

i 1,..., n, oraz

Cov( X , Y ) ( xi EX )( yi EY ) pi

n

p

i 1

i

1, to

i

Współczynnik korelacji

Współczynnikiem korelacji zmiennych losowych X, Y o dodatnich odchyleniach standardowych

nazywamy liczbę

(57)

( X ,Y )

Cov( X , Y )

X Y

Z nierówności (57) wynika następująca nierówność dla tego współczynnika

1 ( X ,Y ) 1

(58)

Będziemy zamiennie używać symbolu Cor (X,Y)

Własności ( zakładamy, że zmienne losowe X, Y mają dodatnie odchylenia standardowe)

(i)

Cor (X,X) = 1,

(ii)

Cor (X,Y) = Cor (Y,X)

(iii)

Cor (aX,X) = 1, gdy a > 0 ; Cor (aX,X) = -1, gdy a < 0

(iv)

Cor (aX,Y) = Cor (X,Y), gdy a > 0 ; Cor (aX,Y) = - Cor (X,Y), gdy a < 0

(v)

Cor (a + X,Y) = Cor (X,Y),

(vi)

Cor (aX,aY) = Cor (X,Y), gdy a różne od zera

Wariancja sumy zmiennych losowych

Twierdzenie 5. Jeżeli X i Y są dyskretnymi zmiennymi losowymi, to

(59)

Var (X + Y) = Var X + Var Y+ 2Cov (X,Y)

Dowód. Zgodnie ze wzorem (49) Var (X + Y) = E(X + Y)2 – (E(X + Y))2 = E(X2 + 2XY + Y2) +

– (E(X) + E(Y))2 = E(X2) + E(2XY) + E(Y2) – (E(X))2 – (E(Y))2 - 2E(X)E(Y) = E(X2) +

+ 2E(XY) + E(Y2) – (E(X))2 – (E(Y))2 - 2E(X)E(Y) = (E(X2) – (E(X))2 ) + (E(Y2) – (E(Y))2 )+

+2E(XY)- 2E(X)E(Y) = Var X + Var Y+ 2Cov (X,Y)

Wniosek 3. Dla kombinacji liniowej dwóch zmiennych losowych prawdziwy jest wzór

(60)

Var (aX + bY) = a2 Var X + b2 Var Y+ 2ab Cov (X,Y)

(wynika z tw. 5 oraz własności wariancji i kowariancji)

Wniosek 4. Dla sumy trzech zmiennych losowych mamy

(61)

Var (X +Y+Z) = Var X + Var Y+ VarZ + 2 Cov (X,Y) + 2 Cov (X,Z) + 2 Cov (Y,Z)

(wynika z tw. 5 oraz własności (v) dla kowariancji).

Wniosek 5. Dla kombinacji liniowej trzech zmiennych losowych mamy

(62) Var (aX + bY + cZ) = a2 Var X + b2 Var Y + c2 VarZ + 2abCov (X,Y) + 2ac Cov (X,Z) +

+ 2bc Cov (Y,Z)

(wynika z wniosku 4 oraz odpowiednich własności wariancji i kowariancji).