1

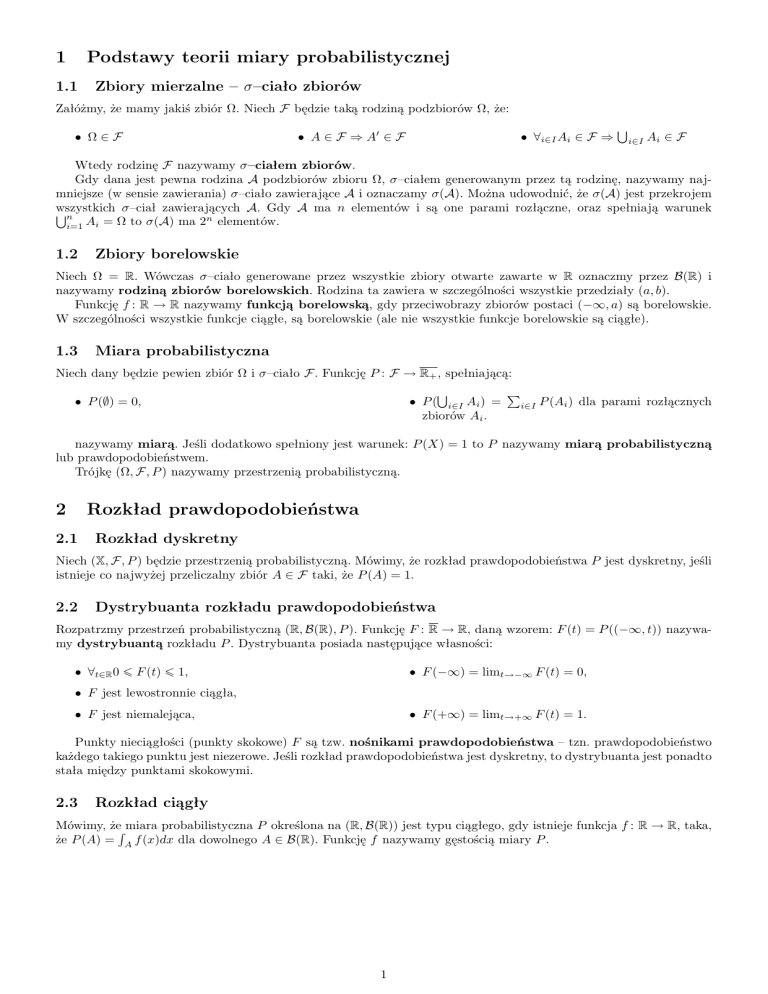

Podstawy teorii miary probabilistycznej

1.1

Zbiory mierzalne – σ–ciało zbiorów

Załóżmy, że mamy jakiś zbiór Ω. Niech F będzie taką rodziną podzbiorów Ω, że:

• Ω∈F

• A ∈ F ⇒ A0 ∈ F

• ∀i∈I Ai ∈ F ⇒

S

i∈I

Ai ∈ F

Wtedy rodzinę F nazywamy σ–ciałem zbiorów.

Gdy dana jest pewna rodzina A podzbiorów zbioru Ω, σ–ciałem generowanym przez tą rodzinę, nazywamy najmniejsze (w sensie zawierania) σ–ciało zawierające A i oznaczamy σ(A). Można udowodnić, że σ(A) jest przekrojem

wszystkich

σ–ciał zawierających A. Gdy A ma n elementów i są one parami rozłączne, oraz spełniają warunek

Sn

A

=

Ω

to σ(A) ma 2n elementów.

i=1 i

1.2

Zbiory borelowskie

Niech Ω = R. Wówczas σ–ciało generowane przez wszystkie zbiory otwarte zawarte w R oznaczmy przez B(R) i

nazywamy rodziną zbiorów borelowskich. Rodzina ta zawiera w szczególności wszystkie przedziały (a, b).

Funkcję f : R → R nazywamy funkcją borelowską, gdy przeciwobrazy zbiorów postaci (−∞, a) są borelowskie.

W szczególności wszystkie funkcje ciągłe, są borelowskie (ale nie wszystkie funkcje borelowskie są ciągłe).

1.3

Miara probabilistyczna

Niech dany będzie pewien zbiór Ω i σ–ciało F. Funkcję P : F → R+ , spełniającą:

S

P

• P ( i∈I Ai ) =

i∈I P (Ai ) dla parami rozłącznych

zbiorów Ai .

• P (∅) = 0,

nazywamy miarą. Jeśli dodatkowo spełniony jest warunek: P (X) = 1 to P nazywamy miarą probabilistyczną

lub prawdopodobieństwem.

Trójkę (Ω, F, P ) nazywamy przestrzenią probabilistyczną.

2

Rozkład prawdopodobieństwa

2.1

Rozkład dyskretny

Niech (X, F, P ) będzie przestrzenią probabilistyczną. Mówimy, że rozkład prawdopodobieństwa P jest dyskretny, jeśli

istnieje co najwyżej przeliczalny zbiór A ∈ F taki, że P (A) = 1.

2.2

Dystrybuanta rozkładu prawdopodobieństwa

Rozpatrzmy przestrzeń probabilistyczną (R, B(R), P ). Funkcję F : R → R, daną wzorem: F (t) = P ((−∞, t)) nazywamy dystrybuantą rozkładu P . Dystrybuanta posiada następujące własności:

• ∀t∈R 0 ¬ F (t) ¬ 1,

• F (−∞) = limt→−∞ F (t) = 0,

• F jest lewostronnie ciągła,

• F jest niemalejąca,

• F (+∞) = limt→+∞ F (t) = 1.

Punkty nieciągłości (punkty skokowe) F są tzw. nośnikami prawdopodobieństwa – tzn. prawdopodobieństwo

każdego takiego punktu jest niezerowe. Jeśli rozkład prawdopodobieństwa jest dyskretny, to dystrybuanta jest ponadto

stała między punktami skokowymi.

2.3

Rozkład ciągły

Mówimy, żeR miara probabilistyczna P określona na (R, B(R)) jest typu ciągłego, gdy istnieje funkcja f : R → R, taka,

że P (A) = A f (x)dx dla dowolnego A ∈ B(R). Funkcję f nazywamy gęstością miary P .

1

• f (x) ­ 0 prawie wszędzie (czyli zbiór punktów w

których to nie jest prawda, ma miarę równą 0).

Własności gęstości miary probabilistycznej

R

• R f (x)dx = 1,

Każda funkcja f : R → R która spełnia te własności jest gęstością pewnego rozkładu prawdopodobieństwa.

Niech f będzie gęstością, a F dystrybuantą. Wtedy zachodzi:

Z x

F (x) = P ((−∞, x)) =

f (t)dt

−∞

Dystrybuanta rozkładu typu ciągłego jest funkcją ciągłą. W punktach ciągłości f istnieje pochodna dystrybuanty i

zachodzi: f (x) = F 0 (x).

Uwaga. Nie każda ciągła dystrybuanta jest dystrybuantą rozkładu typu ciągłego. Istnieją rozkłady które nie są

ani ciągłe ani dyskretne.

3

Zmienna losowa

Zmienną losową nazywamy dowolną funkcję X : Ω → R taką, że ∀x∈R {ω : X(ω) < x} ∈ F. W przypadku gdy

F = 2Ω , dowolna funkcja X : Ω → R jest zmienną losową.

3.1

Definicje podstawowe

Niech dana będzie przestrzeń probabilistyczna (Ω, F, P ), oraz pewna zmienna losowa X. Wówczas funkcja PX (A) =

P (X −1 (A)) jest miarą probabilistyczną, oraz (R, B(R), PX ) jest przestrzenią probabilistyczną. Miarę PX nazywamy

prawdopodobieństwem generowanym przez zmienną losową X.

Mając miarę PX odpowiadającą pewnej zmiennej losowej X możemy więc zdefiniować pojęcie dystrybuanty

zmiennej losowej. Dystrybuantą zmiennej losowej X nazywamy funkcję FX : R → R daną wzorem1 :

FX (t) = PX ((−∞, t)) = P (X −1 (−∞, t)) = P (X < t).

3.2

Dyskretna zmienna losowa

Zmienną losową X nazywamy zmienną typu dyskretnego, gdy istnieje co najwyżej przeliczalny zbiór B ∈ B(R),

taki, że PX (B) = 1.

3.3

Ciągła zmienna losowa

Zmienną losową X zmienną typu ciągłego, gdy istnieje gęstość rozkładu prawdopodobieństwa PX .

3.4

Funkcja zmiennej losowej

Jeśli X jest zmienną losową, a g funkcją borelowską, to złożenie Y = g ◦ X jest również zmienną losową. Ponadto

zachodzi:

PY (B) = Pg◦X (B) = P ({ω : g(X(ω)) ∈ B}) = P ({ω : X(ω) ∈ g −1 (B)}) = PX (g −1 (B))

Ponadto jeśli X jest typu ciągłego to mamy:

Z

FY (y) =

fX (x)dx.

{x:g(x)<y}

Jeśli dodatkowo, wiemy że g jest różniczkowalna i ściśle rosnąca (g 0 (x) 6= 0), to:

Z y

FY (y) =

(g −1 (t))0 fX (g −1 (t))dt

g −1 (−∞)

oraz

fY (y) = fX (g −1 (y))(g −1 (y))0 = fX (g −1 (y))

3.5

1

g 0 (g −1 (y))

.

Niezależne zmienne losowe

Zmienne losowe X1 , X2 , . . . , Xn są niezależne jeżeli dla dowolnych zbiorów borelowskich B1 , B2 , . . . , Bn zachodzi:

P (X1 = B1 ∧ X2 = B2 ∧ . . . ∧ Xn = Bn ) = P (X1 = B1 )P (X2 = B2 ) · · · P (Xn = Bn )

1 Wzór

podany jest na kilka sposobów – stosuje się zamiennie kilka równoważnych form zapisu.

2

3.6

3.6.1

Charakterystyki zmiennych losowych

Wartość oczekiwana

Wartością oczekiwaną zmiennej losowej X nazywamy liczbę EX.

W przypadku, gdy X jest zmienną typu ciągłego wartość oczekiwana ma wartość:

X

EX =

xi pi .

i∈I

o ile szereg jest bezwzględnie zbieżny (jeśli nie jest to EX nie istnieje).

W przypadku, gdy X jest zmienną typu ciągłego o gęstości f , wartość oczekiwana wyraża się wzorem:

Z

EX =

xf (x)dx

R

i istnieje, gdy całka jest zbieżna.

Własności wartości oczekiwanej

• X ­ 0 ⇒ EX ­ 0

• |EX| ¬ E|X|

• dla a, b ∈ R zachodzi E(aX + bY ) = aEX + bEY

• dla a ∈ R zachodzi Ea = a

• E(X − EX) = 0

• E(XY ) = EX ∗ EY , gdy X i Y są niezależne

Wartość oczekiwana z funkcji zmiennej losowej Jeśli ϕ jest funkcją borelowską, a zmienna losowa X jest typu

dyskretnego, to:

X

Eϕ(X) =

ϕ(xi )P (X = xi )

i∈I

a gdy X jest typu ciągłego, o gęstości f , to:

Z

Eϕ(X) =

ϕ(x)f (x)dx

R

3.6.2

Wariancja

2

2

Wariancją zmiennej losowej X nazywamy liczbę V ar(X) daną wzorem: V ar(X)

.

P = EX − (EX)

2

W przypadku zmiennej losowej X typu dyskretnego zachodzi wzór: V ar(X) = i∈I (xi − EX) pi .

• V ar(X) = 0 ⇐⇒ ∃c P (X = c) = 1

Własności wariancji

• V ar(X) ­ 0

• V ar(cX) = c2 V ar(X) dla c ∈ R

• V ar(X ± Y ) = V ar(X) + V ar(Y ) gdy X i Y są

niezależne

• V ar(X + c) = V ar(X)

Liczbę

3.6.3

√

V arX nazywa się czasem odchyleniem standardowym i oznacza przez σ(X).

Kowariancja i współczynnik korelacji

Niech X, Y będą zmiennymi losowymi. Liczbę cov(X, Y ) = E[(X − EX)(Y − EY )] nazywamy kowariancją zmiennych

X i Y . Kowariancję możemy wyliczyć również ze wzoru: cov(X, Y ) = EXY − EXEY . Zauważmy, że gdy X = Y to

cov(X, Y ) = cov(X, X)

p = V ar(X).

TW. |cov(X, Y )| ¬ V ar(X)V ar(Y )

P2 P4

Ponadto zachodzi: cov(aX +b, cY +d) = ac·cov(X, Y ), cov(a1 X1 +a2 X2 , a3 X3 +a4 X4 ) = i=1 j=3 ai aj cov(Xi , Xj ).

Liczbę ρ(X, Y ) = √ cov(X,Y )

nazywamy współczynnikiem korelacji zmiennych X i Y .

V ar(X)V ar(Y )

Gdy ρ(X, Y ) = 0, to mówimy, że zmienne są nieskorelowane. Gdy ρ(X, Y ) = ±1 to P (X = aY + b) = 1 dla pewnych

a, b ∈ R.

3

3.6.4

Inne charakterystyki liczbowe

Zmienna typu dyskretnego

Moment zwykły rzędu r αr = EX r =

xri pi

P

Moment centralny rzędu r µr = E(X − α1 )r = i∈I (xi − α1 )r pi

P

i∈I

P

pi ¬ 0, 5 ¬ xi ¬x0,5 pi

P

Kwantyl rzędu p każda liczba xp , 0 < p < 1 spełniająca warunki F (xp ) ¬ p ¬ limx→xp F (x); xi <xp pi ¬ p ¬

P

xi ¬xp pi

Mediana każda liczba x0,5 spełniająca warunki F (x0,5 ) ¬ 0, 5 ¬ limx→x0,5 F (x);

P

xi <x0,5

Dominanta m0 – punkt skokowy xk , różny od min(xi ) i max(xi ), dla którego p(xk ) osiąga maksimum absolutne.

Zmienna typu ciągłego

Moment zwykły rzędu r αr = EX r =

xr f (x)dx

R

Moment centralny rzędu r µr = E(X − α1 )r = R (x − α1 )r f (x)dx

R

R

Mediana F (x0,5 ) = 0, 5

Kwantyl rzędu p F (xp ) = p

Dominanta m0 – odcięta maksimum absolutnego gęstości.

3.7

Funkcja charakterystyczna

Funkcją charakterystyczną zmiennej losowej X nazywamy funkcję zespoloną ϕ : R → C daną wzorem ϕ(t) =

EeitX . W przypadku gdy X jest zmienną losową typu dyskretnego, funkcja charakterystyczna wyraża się wzorem:

X

ϕ(t) =

pk eitxk

k

W przypadku ciągłej zmiennej losowej X o gęstości f mamy natomiast:

Z

eitx f (x)dx

R

Własności funkcji charakterystycznej

1. ϕ(0) = 1.

2. ∀t∈R ϕ(t) = ϕ(−t), gdzie ϕ(−t) oznacza liczbę zespoloną sprzężoną z ϕ(−t).

3. ∀t∈R |ϕ(t)| ¬ 1.

4. ϕ jest funkcją jednostajnie ciągłą (co w szczególności oznacza, że jest ona ciągła).

5. ϕ jest funkcją rzeczywistą ⇔ rozkład zmiennej losowej X jest symetryczny względem x = 0.

6. Jeśli ϕX (t) jest funkcją charakterystyczną zmiennej losowej X to, funkcją charakterystyczną zmiennej Y = aX +b

jest funkcja ϕY (t) = eitb ϕX (at).

7. Jeżeli istnieje k-ty moment zmiennej losowej X o funkcji charakterystycznej ϕ, to ϕ jest k-krotnie różniczkowalna

i zachodzi związek αk = EX k = i1k ϕ(k) (0)

8. Funkcja charakterystyczna skończonej sumy niezależnych zmiennych losowych równa się iloczynowi funkcji charakterystycznych tych zmiennych.

TW. Niech F będzie dystrybuantą, zaś ϕ funkcją charakterystyczną zmiennej losowej X. Wtedy:

1. Dla a < b takich że, F jest ciągła (w tych punktach) zachodzi

Z R −ita

1

e

− e−itb

lim

ϕ(t)dt = F (b) − F (a)

R→∞ 2π −R

it

2. Jeśli ponadto

R

R

|ϕ(t)|dt ¬ +∞, to X ma rozkład typu ciągłego, o gęstości f (x) =

1

2π

R

R

e−itx ϕ(t)dt.

Wniosek. Funkcja charakterystyczna jednoznacznie wyznacza rozkład zmiennej losowej.

TW. Jeśli ϕ jest funkcją charakterystyczną zmiennej losowejR X, okresową o okresie T = 2π, to X jest zmienną typu

π

1

dyskretnego o wartościach całkowitych oraz P (X = k) = 2π

e−itk ϕ(t)dt, k ∈ Z.

−π

4

4

Katalog zmiennych losowych

4.1

Dyskretne

• EX = np

Równomierny

• pi =

1

n

• EX =

• V ar(X) = npq

x1 +...+xn

n

• ϕ(t) = (peit + q)n

Jednopunktowy

Poissona

• P (x0 ) = 1

• Oznaczenie: P(λ)

• EX = x0

• Parametr: λ > 0

• V ar(X) = 0

• P (k) = e−λ λk! dla k ∈ N

k

• ϕ(t) = eita

• EX = λ

• V ar(X) = λ

Zero-jedynkowy

• P (1) = p, P (0) = 1 − p = q

• ϕ(t) = eλ(e

• EX = p

it

−1)

Geometryczny

• V ar(X) = pq

• Oznaczenie: Geom(p).

• ϕ(t) = peit + q

• P (1) = p, P (0) = 1 − p

Dwumianowy (Bernouliego)

• Oznaczenie:

B(n, p),

n-liczba

prawdopodobieństwo sukcesu,

• P (k) = nk pk q n−k

4.2

• EX = p

prób,

p-

• V ar(X) =

• ϕ(t) =

1−p

p2

peit

1−(1−p)eit

Ciągłe

Jednostajny(równomierny)

• J((a, b)), gdzie

x+a

b−a

• F (x) = 0

1

(

1

b−a

• f (x) =

• EX =

0

Gamma

(a, b) – przedział

• Oznaczenie: Γ(p, α)

( p

α

xp−1 e−αx dla x > 0

• f (x) = Γ(p)

0

dla pozostałych x

R ∞ p−1 −x

gdzie Γ(p) = 0 x e dx, n = 1, 2, 3, . . ., Γ(n) =

(n − 1)!

dla a ¬ x ¬ b

dla x < a

dla x > b

dla a ¬ x ¬ b

dla pozostałych x

• ϕ(t) = (1 −

• Uwaga: Γ(1, α) to rozkład wykładniczy.

b−a

2

• V ar(X) =

• Uwaga: Γ( n2 , 12 ) to tak zwany rozkład χ2 (chi kwadrat) z n stopniami swobody.

(b−a)2

12

• Dla J((0, a)): ϕ(t) =

eiat −1

iat

• Dla J((−a, a)): ϕ(t) =

Beta

sin at

at

• Parametry: p, q > 0

(

Wykładniczy

• f (x)

• Parametr λ > 0

(

1 − e−λx dla x ­ 0

• F (x) =

0

dla x < 0

(

λe−λx dla x ­ 0

• f (x) =

0

dla pozostałych x

• ϕ(t) =

it −p

α)

β(p, q) :=

=

1

p−1

(1

β(p,q) x

0

Γ(p)Γ(q)

Γ(p+q)

Laplace’a

• Parametr λ > 0

• f (x) = λ2 e−λ|x|

λ

1+t2

5

dla x ∈ R

− x)q−1

x ∈ (0, 1)

w p.p.

Normalny (Gaussowski)

Cauchy’ego

• Parametry θ, λ

• Oznaczenie N (p, σ 2 ), N (0, 1) nazywamy standardowym.

Rt

• F (x) =

√1

2π

• f (x) =

√1 e−

σ 2π

−∞

e−

(t)2

2

(x−m)2

2σ 2

dt

= Φ(x)

• f (x) =

1

2

πλ[1+( x−θ

λ ) )]

+

arctan

x−θ

λ

• Wartość oczekiwana i wariancja są niezdefiniowane

– nie istnieją gdyż całki rozbiegają do nieskończoności.

• EX = m

• V ar(X) = σ 2

5

1

2

• ϕ(t) = e−|t|

dla x ∈ R

• Dla standardowego: ϕ(t) = e

1

π

• F (x) =

• Uwaga. Jeśli X i Y mają standardowy rozkład normalny to zmienna X/Y ma rozkład Cauchy’ego z

parametrami θ = 0 i λ = 1

−t2

2

Zmienne losowe wielowymiarowe

Wektorem losowym lub zmienną losową wielowymiarową nazywamy dowolną funkcję X : Ω → Rn , która spełnia

warunek: ∀B∈B(Rn ) X −1 (B) ∈ F, czyli przeciwobraz dowolnego zbioru borelowskiego z przestrzeni2 Rn musi należeć

do σ–ciała.

Każdą funkcję wielowymiarową X : Ω → Rn możemy przestawić w postaci: X = (X1 , X2 , . . . , Xn ), gdzie dla

każdego 1 ¬ i ¬ n Xi : Ω → R. Funkcja X jest zmienną losową wielowymiarową ⇐⇒ każde Xi jest („zwykłą”)

zmienną losową.

Odwzorowanie ϕ : Rn → Rm nazywamy funkcją borelowską gdy przeciwobrazy zbiorów borelowskich z Rm są

zbiorami borelowskim w Rn .

Złożenie ϕ ◦ X, gdzie X wektor losowy a ϕ funkcja borelowska, jest też wektorem losowym.

Wektor losowy jest wektorem typu dyskretnego, gdy istnieje taki co najwyżej przeliczalny zbiór B borelowski,

że PX (B) = 1.

R R

Wektor losowy jest wektorem typu ciągłego, gdy istnieje funkcja f taka, że PX (B) = . . . B f (x)dx, dla dowolnego B borelowskiego. Funkcję tą nazywamy gęstością (musi ona spełniać dodatkowe warunki, o czym niżej).

5.1

Dystrybuanta

Gdy X : Ω → Rn jest wektorem losowym, dystrybuanta ma postać: F : Rn → R, F (t1 , t2 , . . . , tn ) = PX ((−∞, t1 ) ×

(−∞, t2 ) × . . . (−∞, tn )). W przypadku gdy n = 2 mamy: F (x, y) = P (X < x, Y < y) dla(x, y) ∈ R2 .

Własności

• Jest lewostronnie ciągła i niemalejąca ze względu na każdą zmienną z osoba.

• ∀x∈R limy→−∞ F (x, y) = 0,

∀y∈R limx→−∞ F (x, y) = 0

• limx→∞,y→∞ F (x, y) = 1

• Dla dowolnych punktów (x1 , y1 ), (x2 , y2 ) takich, że x1 ¬ x2 i y1 ¬ y2 zachodzi nierówność F (x2 , y2 )−F (x2 , y1 )−

F (x1 , y2 ) + F (x1 , y1 ) ­ 0

5.2

Gęstość

Własności

R R

• PX (B) = . . . B f (x)dx

R t1

R tn

• F (t1 , t2 , . . . , tn ) = −∞

. . . −∞

f (t1 , t2 , . . . , tn )dt1 dt2 . . . dtn

RR

• R2 f (x, y)dxdy = 1

• w punktach ciągłości: f (x1 , . . . , xn ) =

∂ n Fx (x1 ,...,xn )

.

∂x1 ...∂xn

Niezależność zmiennych: ∀(x,y)∈R2 F (x, y) = FX (x)FY (y) lub f (x, y) = fX (x)fY (y)

2 Zbiory borelowskie w Rn , to σ–ciało zbiorów zawierające wszystkie zbiory otwarte z tej przestrzeni. Generowane jest np. przez wszystkie

otwarte kostki (iloczyny kartezjańskie przedziałów otwartych).

6

5.3

Rozkład brzegowy

Niech X : Ω → R2 wektor losowy o dystrybuancie F . Wówczas funkcje FX (x) = limy→∞ F (x, y) oraz FY (y) =

limx→∞ F (x, y) są dystrybuantami rozkładów na R. Rozkłady te nazywamyR brzegowymi.

R

Jeśli dodatkowo wektor losowy posiada gęstość f , to funkcje fX (x) = R f (x, y)dy oraz fY (y) = R f (x, y)dx są

gęstościami rozkładów brzegowych na R.

5.4

Parametry liczbowe

Wartość oczekiwana Jeśli X = (X1 , X2 , . . . , Xn ) jest wektorem losowym, to wektor liczb (EX1 , EX2 , . . . , EXn )

nazywamy wartością średnią (oczekiwaną) wektora X. Jest ona określona jeśli wszystkie wartości oczekiwane EXi

istnieją.

R

Jeśli ϕ : Rn → R funkcja borelowska, oraz X wektor losowy typu ciągłego, to Eϕ(X) = Rn ϕ(x)f (x)dx.

5.5

Przykłady

Gęstości sumy, iloczynu, ilorazu zmiennych losowych:

R

R

1. U = X + Y : k1 (u) = R f (x, u − x)dx; gdy X, Y -niezależne: k1 (u) = R f1 (x)f2 (u − x)dx

2. U = XY : k1 (u) =

3. U =

X

Y :

k1 (u) =

R

R

R

R

1

dx; gdy X, Y -niezależne: k1 (u) =

f (x, ux ) |x|

f (uy, y)|y|dy; gdy X, Y -niezależne: k1 (u) =

Dwuwymiarowy rozkład normalny

f (x, y) =

2πσ1 σ2

1

p

1 − ρ2

n

exp −

gdzie: µ1 = EX, µ2 = EY , σ1 =

|ρ| < 1.

6

√

R

R

R

R

1

f1 (x)f2 ( ux ) |x|

dx

f1 (uy)f2 (y)|y|dy

ma gęstość daną wzorem:

h (x − µ )2

1

(x − µ1 )(y − µ2 ) (y − µ2 )2 io

1

−

2ρ

+

dla (x, y) ∈ R2

2(1 − ρ2 )

σ12

σ1 σ 2

σ22

D2 X > 0, σ2 =

√

D2 Y > 0, ρ–współczynnik korelacji zm.los. X i Y , przy czym

Zbieżność ciągów zmiennych losowych

1. Zbieżność z prawdopodobieństwem 1 (prawie na pewno, prawie wszędzie): P ({ω : limn→inf Xn (ω) X(ω)}) = 1.

z pr. 1

Oznaczenie: Xn −−−−→ X.

(p.n.)

wg pr.

2. Zbieżność według prawdopodobieństwa: ∀>0 limn→∞ P ({ω : |Xn (ω) − X(ω)| ­ }) = 0. Oznaczenie: Xn −−−−→

(P )

X.

3. Zbieżność według dystrybuant (zbieżność względem rozkładu, słabo zbieżny) – ciąg dystrybuant Fn jest zbieżny

D

do dystrybuanty F w każdym punkcie ciągłości F . Oznaczenie: Xn −−→ X.

(s)

Rodzaje zbieżności wymienione są od najsilniejszej do najsłabszej. Ze zbieżności z prawdopodobieństwem 1 wynika

zbieżność według prawdopodobieństwa, a z niej wynika zbieżność według dystrybuant.

Następujące warunki są równoważne ze zbieżnością z prawdopodobieństwem 1:

T∞

• ∀>0 limk→∞ n=k {|Xn − X| < } = 1

S∞

• ∀>0 limk→∞ n=k {|Xn − X| ­ } = 0

6.1

Twierdzenie o ciągłości

Ciąg (Xn )n jest zbieżny według rozkładu do X wtedy i tylko wtedy, gdy ciąg funkcji charakterystycznych ϕn jest

zbieżny w każdym punkcie do funkcji ciągłej ϕ. Takie ϕ jest funkcją charakterystyczną zmiennej X.

7

7

Prawa wielkich liczb i twierdzenia graniczne

Pn

SłabePprawo wielkich liczb. Niech Xn będzie ciągiem zmiennych losowych, mk = EXk , Sn = k=1 Xn . Jeżeli

n

(Xk −mk )

k=1

ciąg

zbiega według prawdopodobieństwa do 0 to mówimy, że Xn spełnia słabe prawo wielkich liczb

n

n

| ­ ) = 0.

(SPWL). Warunek z definicji można równoważnie zapisać: ∀>0 limn→∞ P (| Sn −ES

n

Tw. Czebyszewa Ciąg niezależnych zmiennych losowych Xn spełnia SPWL, gdy istnieją wartości oczekiwane E(Xi )

i wariancje σi2 zmiennych Xi istnieją i są wspólnie ograniczone (tzn. ∃σ2 ∀n V ar(Sn ) ¬ σ 2 ).

Tw. Markowa Ciąg zmiennych losowych Xn spełnia SPWL, gdy istnieją wartości oczekiwane E(Xi ) i wariancje σi2

n)

= 0.

zmiennych Xi oraz limn→∞ V ar(S

n2

Wniosek Jeśli Xn ciąg niezależnych zmiennych losowych o jednakowym rozkładzie, dla którego istnieje wariancja,

to ciąg ten spełnia SPWL.

Tw. Chinczyna Ciąg niezależnych zmiennych losowych o jednakowych rozkładach i wspólnej wartości oczekiwanej

spełnia SPWL.

Mocne prawo wielkich liczb. P

Xn jest ciągiem zmiennych losowych, mk = EXk . Ciąg Xn spełnia mocne prawo

n

(Xk −mk )

k=1

wielkich liczb (MPWL), gdy ciąg

zbiega do 0 z prawdopodobieństwem jeden.

n

Uwaga. Jeśli ciąg spełnia MPWL to spełnia też SPWL.

P∞

V ar(Xn )

n=1

Tw. Kołomogorowa Jeśli Xn są niezależne, V ar(Xn ) istnieją oraz szereg

jest zbieżny, to (Xn )n

n2

spełnia MPWL.

Wniosek Jeśli (Xn )n jest ciągiem niezależnych zmiennych losowych o jednakowym rozkładzie i ∀n V ar(Xn ) = σ 2 <

+∞, to Xn spełnia MPWL.

Wniosek Jeśli Xn spełnia założenia tw. Czybyszewa to spełnia MPWL.

Centralne twierdzenie graniczne Lindeberga-Levy’ego. Jeżeli {Xn } jest losowym ciągiem niezależnych zmiennych o jednakowym rozkładzie, o wartości przeciętnej α1 i skończonej wariancji σ 2 > 0, to ciąg (F

Pnn) dystrybuant

Pn

Xi −nα1

Xn −α1

i=1 √

=

jest

standaryzowanych średnich arytmetycznych Xn (standaryzowanych sum i=1 Xi ) Yn = √σ

σ

n

n

R

2

1

y

zbieżny do dystrybuanty Φ rozkładu N (0, 1): limn→∞ Fn (y) = √12π −∞ e− 2 t dt ≡ Φ(y)

8