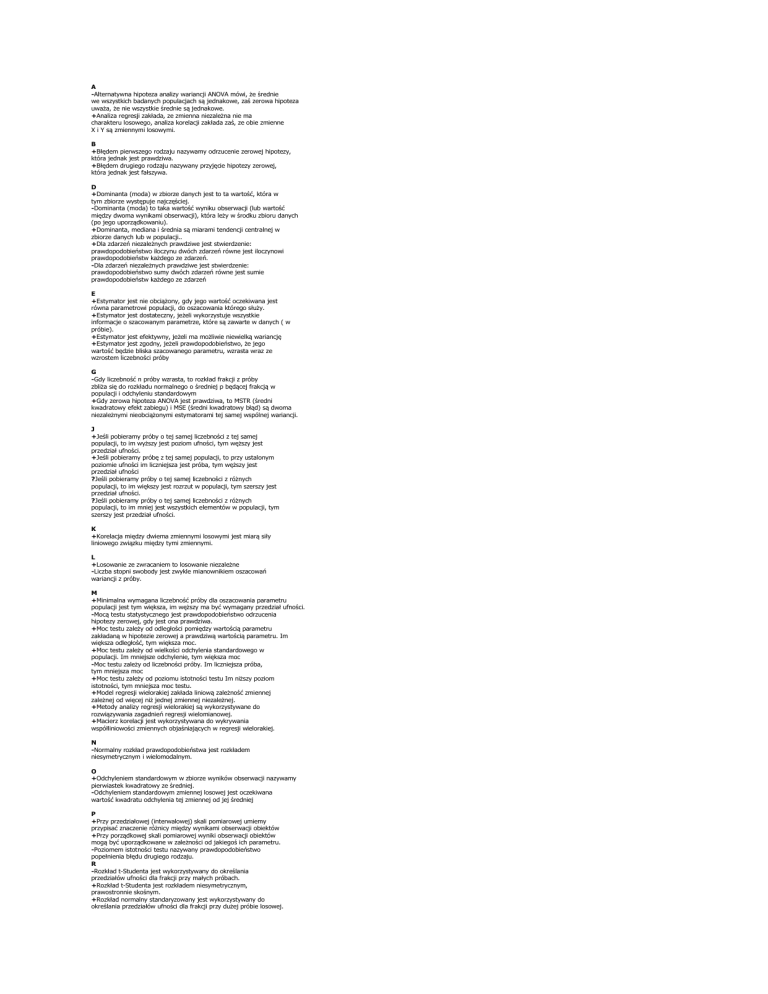

A

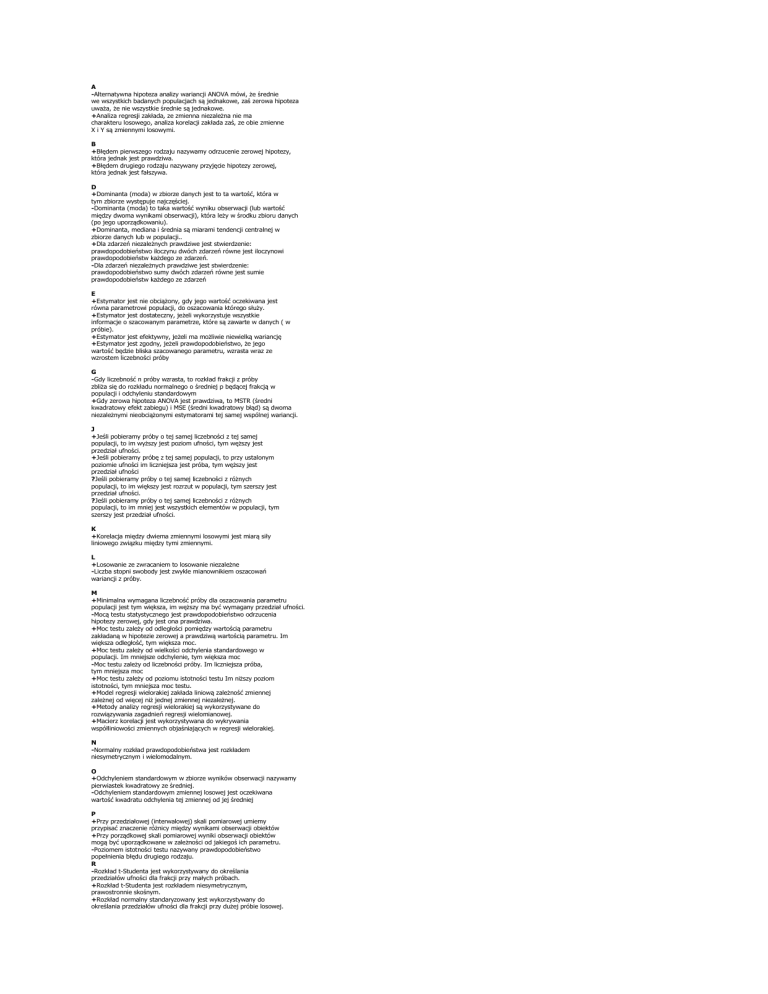

-Alternatywna hipoteza analizy wariancji ANOVA mówi, że średnie

we wszystkich badanych populacjach są jednakowe, zaś zerowa hipoteza

uważa, że nie wszystkie średnie są jednakowe.

+Analiza regresji zakłada, ze zmienna niezależna nie ma

charakteru losowego, analiza korelacji zakłada zaś, ze obie zmienne

X i Y są zmiennymi losowymi.

B

+Błędem pierwszego rodzaju nazywamy odrzucenie zerowej hipotezy,

która jednak jest prawdziwa.

+Błędem drugiego rodzaju nazywany przyjęcie hipotezy zerowej,

która jednak jest fałszywa.

D

+Dominanta (moda) w zbiorze danych jest to ta wartość, która w

tym zbiorze występuje najczęściej.

-Dominanta (moda) to taka wartość wyniku obserwacji (lub wartość

między dwoma wynikami obserwacji), która leży w środku zbioru danych

(po jego uporządkowaniu).

+Dominanta, mediana i średnia są miarami tendencji centralnej w

zbiorze danych lub w populacji..

+Dla zdarzeń niezależnych prawdziwe jest stwierdzenie:

prawdopodobieństwo iloczynu dwóch zdarzeń równe jest iloczynowi

prawdopodobieństw każdego ze zdarzeń.

-Dla zdarzeń niezależnych prawdziwe jest stwierdzenie:

prawdopodobieństwo sumy dwóch zdarzeń równe jest sumie

prawdopodobieństw każdego ze zdarzeń

E

+Estymator jest nie obciążony, gdy jego wartość oczekiwana jest

równa parametrowi populacji, do oszacowania którego służy.

+Estymator jest dostateczny, jeżeli wykorzystuje wszystkie

informacje o szacowanym parametrze, które są zawarte w danych ( w

próbie).

+Estymator jest efektywny, jeżeli ma możliwie niewielką wariancję

+Estymator jest zgodny, jeżeli prawdopodobieństwo, że jego

wartość będzie bliska szacowanego parametru, wzrasta wraz ze

wzrostem liczebności próby

G

-Gdy liczebność n próby wzrasta, to rozkład frakcji z próby

zbliża się do rozkładu normalnego o średniej p będącej frakcją w

populacji i odchyleniu standardowym

+Gdy zerowa hipoteza ANOVA jest prawdziwa, to MSTR (średni

kwadratowy efekt zabiegu) i MSE (średni kwadratowy błąd) są dwoma

niezależnymi nieobciążonymi estymatorami tej samej wspólnej wariancji.

J

+Jeśli pobieramy próby o tej samej liczebności z tej samej

populacji, to im wyższy jest poziom ufności, tym węższy jest

przedział ufności.

+Jeśli pobieramy próbę z tej samej populacji, to przy ustalonym

poziomie ufności im liczniejsza jest próba, tym węższy jest

przedział ufności

?Jeśli pobieramy próby o tej samej liczebności z różnych

populacji, to im większy jest rozrzut w populacji, tym szerszy jest

przedział ufności.

?Jeśli pobieramy próby o tej samej liczebności z różnych

populacji, to im mniej jest wszystkich elementów w populacji, tym

szerszy jest przedział ufności.

K

+Korelacja między dwiema zmiennymi losowymi jest miarą siły

liniowego związku między tymi zmiennymi.

L

+Losowanie ze zwracaniem to losowanie niezależne

-Liczba stopni swobody jest zwykle mianownikiem oszacowań

wariancji z próby.

M

+Minimalna wymagana liczebność próby dla oszacowania parametru

populacji jest tym większa, im węższy ma być wymagany przedział ufności.

-Mocą testu statystycznego jest prawdopodobieństwo odrzucenia

hipotezy zerowej, gdy jest ona prawdziwa.

+Moc testu zależy od odległości pomiędzy wartością parametru

zakładaną w hipotezie zerowej a prawdziwą wartością parametru. Im

większa odległość, tym większa moc.

+Moc testu zależy od wielkości odchylenia standardowego w

populacji. Im mniejsze odchylenie, tym większa moc

-Moc testu zależy od liczebności próby. Im liczniejsza próba,

tym mniejsza moc

+Moc testu zależy od poziomu istotności testu Im niższy poziom

istotności, tym mniejsza moc testu.

+Model regresji wielorakiej zakłada liniową zależność zmiennej

zależnej od więcej niż jednej zmiennej niezależnej.

+Metody analizy regresji wielorakiej są wykorzystywane do

rozwiązywania zagadnień regresji wielomianowej.

+Macierz korelacji jest wykorzystywana do wykrywania

współliniowości zmiennych objaśniających w regresji wielorakiej.

N

-Normalny rozkład prawdopodobieństwa jest rozkładem

niesymetrycznym i wielomodalnym.

O

+Odchyleniem standardowym w zbiorze wyników obserwacji nazywamy

pierwiastek kwadratowy ze średniej.

-Odchyleniem standardowym zmiennej losowej jest oczekiwana

wartość kwadratu odchylenia tej zmiennej od jej średniej

P

+Przy przedziałowej (interwalowej) skali pomiarowej umiemy

przypisać znaczenie różnicy między wynikami obserwacji obiektów

+Przy porządkowej skali pomiarowej wyniki obserwacji obiektów

mogą być uporządkowane w zależności od jakiegoś ich parametru.

-Poziomem istotności testu nazywany prawdopodobieństwo

popełnienia błędu drugiego rodzaju.

R

-Rozkład t-Studenta jest wykorzystywany do określania

przedziałów ufności dla frakcji przy małych próbach.

+Rozkład t-Studenta jest rozkładem niesymetrycznym,

prawostronnie skośnym.

+Rozkład normalny standaryzowany jest wykorzystywany do

określania przedziałów ufności dla frakcji przy dużej próbie losowej.

+Rozkład F jest rozkładem dwóch ilorazu dwóch niezależnych

zmiennych losowych chi -kwadrat, z których każda podzielona jest

przez właściwą dla niej liczbę stopni swobody.

-Rozkłady F i chi-kwadrat są rozkładami symetrycznymi, o

średniej równej zero.

+Rozkład chi-kwadrat jest rozkładem prawdopodobieństwa sumy

kwadratów niezależnych standaryzowanych normalnych zmiennych losowych

S

-Skala przedziałowa (interwalowa) musi zawierać naturalne zero.

+Skumulowaną funkcją rozkładu (dystrybuantą) zmiennej losowej

jest funkcja, której wartością dla każdego x jest prawdopodobieństwo

tego, że zmienna losowa przyjmie wartość nie większą niż x.

+Standaryzowaną normalną zmienną losową jest normalna zmienna

losowa o średniej równej zeru i odchyleniu standardowym równym jeden

-Standardowy błąd średniej z próby jest równy ilorazowi

odchylenia standardowego w populacji przez liczebność próby.

+Siłę korelacji między dwiema zmiennymi mierzy współczynnik

korelacji, którego estymatorem z próby jest tzw. współczynnik

determinacji Fishera.

+Średnia rozkładu chi-kwadrat jest równa liczbie stopni swobody.

Wariancja tego rozkładu jest równa liczbie stopni swobody pomnożonej

przez dwa.

T

-Test Tukeya wolno przeprowadzać, gdy hipoteza zerowa ANOVA o

nierówności średnich w badanych populacjach nie zostanie odrzucona.

+Test Tukeya pozwala na równoczesne wykonanie porównań

wszystkich badanych średnich według schematu „każda z każdą"

przy tym samym poziomic istotności.

-Testem zachodzenia liniowego związku między zmiennymi X i Y w

prostej liniowej analizie regresji jest test na wyraz wolny prostej

regresji.

W

+Wartość oczekiwana skokowej zmiennej losowej jest równa sumie

wszystkich możliwych wartości tej zmiennej mnożonych przez ich

prawdopodobieństwa.

+Wariancją w zbiorze wyników obserwacji nazywamy przeciętne

kwadratowe odchylenie poszczególnych wyników od ich średniej.

-Wariancja i odchylenie standardowe są najczęściej stosowanymi

miarami tendencji centralne

+Wariancja rozkładu dwumianowego jest równa iloczynowi liczby

doświadczeń, prawdopodobieństwa sukcesu i prawdopodobieństwa porażki j.

+Wariancje w każdej z r badanych populacji są jednakowe

+Warunkiem niezależności dwóch zdarzeń A i B jest, aby

prawdopodobieństwo warunkowe zdarzenia A pod warunkiem B było równe

prawdopodobieństwu bezwarunkowemu zdarzenia A.

+Współczynnik zmienności będący stosunkiem odchylenia

standardowego do średniej jest względną miarą rozrzutu (rozproszenia).

-Współczynnik kowariancji wielorakiej R2 mierzy część zmienności

zmiennej zależnej, która została wyjaśniona oddziaływaniem zmiennych

objaśniających występujących w modelu regresji wielorakiej.

+W przypadku ilorazowej skali pomiarowej znaczenie ma nie tylko

różnica miedzy wynikami obserwacji obiektów, ale i iloraz wyników

tych obserwacji.

Z

+Zdarzenia niezależne są zdarzeniami wzajemnie się wykluczającymi.