Marek Cieciura, Janusz Zacharski

PODSTAWY PROBABILISTYKI

Z PRZYKŁADAMI ZASTOSOWAŃ

W INFORMATYCE

CZĘŚĆ IV

STATYSTYKA MATEMATYCZNA

Na prawach rękopisu

Warszawa, wrzesień 2011

Data ostatniej aktualizacji: piątek, 2 grudnia 2011, godzina 16:39

Statystyka jest bardziej sposobem myślenia lub wnioskowania niŜ pęczkiem recept

na młócenie danych w celu odsłonięcia odpowiedzi - Calyampudi Radhakrishna Rao

Podręcznik:

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ

W INFORMATYCE

publikowany jest w częściach podanych poniŜej

Nr

Tytuł

I.

Wprowadzenie

II.

Statystyka opisowa

III.

Rachunek prawdopodobieństwa

IV.

Statystyka matematyczna

V.

Przykłady zastosowań w informatyce

VI.

Dowody wybranych twierdzeń

VII.

Tablice statystyczne

Autorzy proszą o przesyłanie wszelkich uwagi i propozycji dotyczących zawartości

podręcznika z wykorzystaniem formularza kontaktowego zamieszczonego w portalu

http://cieciura.net/mp/

Publikowane części będą na bieŜąco poprawiane, w kaŜdej będzie podawana data ostatniej

aktualizacji.

Podręcznik udostępnia się na warunku licencji Creative Commons (CC): Uznanie Autorstwa

– UŜycie Niekomercyjne – Bez Utworów ZaleŜnych (CC-BY-NC-ND),co oznacza:

•

Uznanie Autorstwa (ang. Attribution - BY): zezwala się na kopiowanie,

dystrybucję, wyświetlanie i uŜytkowanie dzieła i wszelkich jego pochodnych pod

warunkiem umieszczenia informacji o twórcy.

•

UŜycie Niekomercyjne (ang. Noncommercial - NC): zezwala się na

kopiowanie, dystrybucję, wyświetlanie i uŜytkowanie dzieła i wszelkich jego

pochodnych tylko w celach niekomercyjnych..

•

Bez Utworów ZaleŜnych (ang. No Derivative Works - ND): zezwala się na

kopiowanie, dystrybucję, wyświetlanie tylko dokładnych (dosłownych) kopii dzieła,

niedozwolone jest jego zmienianie i tworzenie na jego bazie pochodnych.

Podręcznik i skorelowany z nim portal, są w pełni i powszechnie dostępne, stanowią więc

Otwarte Zasoby Edukacyjne - OZE (ang. Open Educational Resources – OER).

2

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

SPIS TREŚCI

14. STATYSTYKI I ICH ROZKŁADY ....................................................................................... 5

14.1. PRÓBA JAKO ZMIENNA LOSOWA WIELOWYMIAROWA ............................................................ 5

14.2. PODSTAWOWE STATYSTYKI I ICH ROZKŁADY ........................................................................ 6

14.2.1. Wykazy statystyk .......................................................................................................... 6

14.2.2. Rozkład średniej z próby .............................................................................................. 7

14.2.3. Rozkład statystyk związanych z wariancją z próby ....................................................... 8

15. ESTYMACJA PARAMETRÓW.......................................................................................... 12

15.1. WPROWADZENIE ............................................................................................................... 12

15.2. ESTYMACJA PUNKTOWA .................................................................................................... 12

15.2.1. Klasyfikacja estymatorów i nierówność Rao-Cramera ............................................... 13

15.2.2. Estymacja wartości oczekiwanej rozkładu normalnego .............................................. 14

15.2.3. Estymatory wariancji rozkładu normalnego ............................................................... 15

15.2.4. Metoda największej wiarygodności otrzymywania estymatorów................................. 17

15.2.5. Zestawienie estymatorów parametrów rozkładu zmiennej losowej i ich własności...... 19

15.3. ESTYMACJA PRZEDZIAŁOWA .............................................................................................. 20

15.3.1. Uwagi wstępne........................................................................................................... 20

15.3.2. Wyznaczenie przedziału ufności dla wartości oczekiwanej rozkładu normalnego ....... 21

15.3.3. Tabela przedziałów ufności........................................................................................ 24

15.3.4. Wyznaczanie wielkości próby..................................................................................... 28

15.3.5. Wykorzystanie arkusza Excel ..................................................................................... 30

16. WERYFIKACJA HIPOTEZ ................................................................................................ 31

16.1 WPROWADZENIE ................................................................................................................ 31

16.1.1. Uwagi wstępne........................................................................................................... 31

16.1.2. Pzykład konstrukcji testu parametrycznego do weryfikacji hipotezy o wartości

oczekiwanej........................................................................................................................... 34

16.1.3. Pzykład konstrukcji testu parametrycznego do weryfikacji hipotezy o równości wartości

oczekiwanych ........................................................................................................................ 35

16.1.4. Uwagi o weryfikacji hipotez parametrycznych ........................................................... 37

16.2. TESTY PARAMETRYCZNE DLA JEDNEJ PRÓBY ...................................................................... 38

16.2.1. Testy do weryfikacji hipotezy o wartości oczekiwanej................................................. 38

16.2.2. Testy do weryfikacji hipotezy o wariancji i odchyleniu standardowym ....................... 43

16.2.3. Testy do weryfikacji hipotezy o wskaźniku struktury................................................... 44

16.3. TESTY PARAMETRYCZNE DLA DWÓCH PRÓB........................................................................ 45

16.3.1. Testy do porównywania wartości oczekiwanych dla prób niezaleŜnych ...................... 45

16.3.2. Testy do porównywania wartości oczekiwanych – próby zaleŜne................................ 53

16.3.3. Testy do porównywania wariancji.............................................................................. 57

16.3.4. Testy do porównywania wskaźników struktury ........................................................... 59

16.4. TESTY NIEPARAMETRYCZNE DLA JEDNEJ PRÓBY ................................................................. 61

16.4.1. Ocena losowości próby .............................................................................................. 61

16.4.2. Test zgodności chi kwadrat ........................................................................................ 62

16.4.3. Ocena normalności rozkładu ..................................................................................... 65

16.4.4. Test niezaleŜności chi kwadrat ................................................................................... 68

16.5. TESTY NIEPARAMETRYCZNE DLA DWÓCH PRÓB................................................................... 73

16.5.1. Test zgodności rozkładów dla prób niepowiązanych (test Wilcoxona) ........................ 73

16.5.2. Test zgodności rozkładów dla prób powiązanych (test rangowanych znaków) ............ 75

16.6. ALGORYTMIZACJA OBLICZEŃ ............................................................................................. 77

16.6.1. Wykorzystanie arkusza Excel ..................................................................................... 77

16.6.2.Zasady wyboru testu przy dwóch próbach................................................................... 78

3

STATYSTYKA MATEMATYCZNA

17. ANALIZA KORELACJI I REGRESJI DWÓCH ZMIENNYCH...................................... 79

17.1. WPROWADZENIE ............................................................................................................... 79

17.2. ANALIZA KORELACJI.......................................................................................................... 80

17.2.1. Uwagi wstępne........................................................................................................... 80

17.2.2. Estymacja współczynnika korelacji cech populacji..................................................... 80

17.2.3. Weryfikacja hipotez o współczynniku korelacji........................................................... 82

17.2.4. Współczynnik korelacji Spearmana............................................................................ 84

17.2.5. Współczynnik korelacji Cramera................................................................................ 87

17.3. ANALIZA REGRESJI ............................................................................................................ 88

17.3.1. Uwagi wstępne........................................................................................................... 88

17.3.2. Estymatory współczynników regresji.......................................................................... 88

17.3.3. Rozkłady estymatorów współczynników regresji......................................................... 92

17.3.4. Estymacja przedziałowa współczynników regresji...................................................... 92

17.3.5. Weryfikacja hipotez o współczynnikach regresji......................................................... 94

18. WPROWADZENIE DO ZAAWANSOWANYCH METOD STATYSTYCZNYCH......... 96

18.1. CHARAKTERYSTYKA ZAAWANSOWANYCH METOD STATYSTYCZNYCH ................................. 96

18.2. ALGORYTMIZACJA WYBORU METOD STATYSTYCZNYCH .................................................... 100

4

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

14. STATYSTYKI I ICH ROZKŁADY

Począwszy od tego rozdziału będziemy przedstawiali teorię i zastosowania statystyki

matematycznej. RozwaŜymy najpierw sytuacje, w których badana jest jedna cecha populacji lub

dwie cechy róŜnych populacji tak, Ŝe moŜna je traktować jako zmienne losowe niezaleŜne.

Wówczas o próbach pobranych z tych populacji mówimy, Ŝe są niepowiązane.

14.1. Próba jako zmienna losowa wielowymiarowa

W dalszych rozwaŜaniach będzie potrzebna nowa definicja próby umoŜliwiająca korzystanie

w statystyce z rachunku prawdopodobieństwa.

Badana jest cecha X populacji. Niech X1, X2, ... Xn będą zmiennymi losowymi niezaleŜnymi

o jednakowym rozkładzie, takim jak rozkład cechy X. Próba losowa n-elementowa ze względu na

cechę X (próba n elementowa) jest to zmienna losowa n-wymiarowa

(X1, X2, ..., Xn)

(14.1)

Interpretacja

Zmienna losowa X1 jest modelem wartości cechy X pierwszego elementu wylosowanego

z populacji do próby, X2 modelem drugiego elementu itd. PoniewaŜ do próby losujemy elementy

metodą ze zwracaniem, więc kaŜdy element populacji ma te same szanse być

wylosowany, dlatego przyjmuje się, Ŝe zmienne losowe są niezaleŜne.

KaŜdą wartość

(x1, x2, ..., xn)

próby (14.1) nazywamy realizacją próby lub takŜe próbą.

(14.2)

Przykład 14.1

RozwaŜamy populację gospodarstw domowych na terenie Warszawy. Populację tę badamy ze

względu na cechę X – liczba osób w gospodarstwie. Z populacji pobieramy próbę

pięcioelementową. Losujemy ze zwracaniem pięć gospodarstw domowych. Przypuśćmy,

Ŝe otrzymaliśmy wartości cechy X: 2, 3, 1, 3, 4. Zatem zmienna losowa X1 oznaczająca liczbę osób

w wylosowanym pierwszym gospodarstwie przyjęła wartość 2, zmienna losowa X2 oznaczająca

liczbę osób w wylosowanym drugim gospodarstwie przyjęła wartość 3 itd.

Próba

(X1, X2, X3, X4, X5)

(14.3)

przyjęła wartość

(2, 3, 1, 3, 4)

(14.4)

Przypuśćmy, Ŝe badanie powtórzono i otrzymano teraz następujące wartości cechy X: 3,1,1,2,2.

Otrzymaliśmy inną wartość próby (14.3), mianowicie

(3, 1 ,1, 2, 2)

(14.5)

Ciągi (14.4) i (14.5) są realizacjami próby (14.3). Statystyki

Aby moŜna było przeprowadzić analizę statystyczną naleŜy przekształcić próbę, czyli rozpatrywać

funkcje próby. Funkcje próby (14.1) nazywamy statystykami

Un = g(X1, X2, ..., Xn)

(14.6)

Przykład 14.2

Jeśli interesujemy się średnią liczbą osób w gospodarstwach domowych wybranych do próby,

to naleŜy rozwaŜyć zmienną losową

U5 =

X1 +X 2 +X 3 +X 4 +X 5

5

5

średnia arytmetyczna z próby

(14.7)

STATYSTYKA MATEMATYCZNA

Zmienna ta jest funkcją próby (14.3), jest zatem statystyką. Wartościami (realizacjami) tej

statystyki, dla realizacji próby (14.4) i (14.5) są liczby

u5 =

2+3+1+3+4

3+1+1+2+2

=2,6 i u 5 =

=1,8 5

5

14.2. Podstawowe statystyki i ich rozkłady

14.2.1. Wykazy statystyk

Przedstawimy teraz dwa wykazy najczęściej stosowanych statystyk.

• Wykaz statystyk klasycznych, tj. statystyk, których wartości zaleŜą od wszystkich zmiennych

losowych wchodzących w skład próby.

• Wykaz statystyk pozycyjnych, tj. statystyk, których wartości zaleŜą tylko od niektórych

zmiennych losowych wchodzących w skład próby, głównie od tych, które zajmują odpowiednią

pozycję w próbie.

Tabela 14.1 Wykaz statystyk klasycznych

Lp

Postać

2

S2n =

3

Sn =

4

Ŝ2n =

5

6

7

8

9

10

11

1 n

∑ Xi

n i =1

Średnia z próby

1 n

∑ (Xi − X n ) 2

n i =1

Wariancja z próby (obciąŜona1)

1 n

∑ (Xi − X n )2

n i=1

Odchylenie standardowe z próby

Xn =

1

Nazwa / Komentarz

1 n

∑ (Xi − X n )2

n − 1 i=1

1 n

So2

=

∑ (Xi − m)2

n

n i =1

Un =

nSo2

n

σ2

n X −m

= ∑ i

σ

i =1

nS2n

Wariancja z próby (nieobciąŜona2)

m=EX

2

m=EX, σ=DX

2

n X −X

i

n

=

∑

2

σ

σ

i =1

1 n

U n = ∑ Xik

n i =1

n

1

U n = ∑ (X i − X n )k

n i=1

X −m

Un = n

n −1

Sn

Y

W(ω) = n

n

Yn- liczba jedynek w próbie patrz poniŜsza uwaga

Un =

1

Wyjaśnienie nazwy w podpukcie 15.2.1.

2

Jak wyŜej

Moment z próby rzędu k

Moment centralny z próby rzędu k

Wskaźnik struktury wariantu ω.

6

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Tabela 14.2. Wykaz statystyk pozycyjnych

Nazwa statystyki

Symbol

Mediana z próby

Me

Kwantyl rzędu p z próby

Kp

Kwartyl pierwszy, drugi i trzeci z próby

Q1, Q2, Q3

Rozstęp z próby

Ro

Definicja statystyki

Statystyka przyjmująca dla kaŜdej realizacji

próby medianę w tej realizacji

Statystyka przyjmująca dla kaŜdej realizacji

próby kwantyl rzędu p w tej realizacji

Statystyka przyjmująca dla kaŜdej realizacji

próby odpowiedni kwartyl w tej realizacji

Statystyka przyjmująca dla kaŜdej realizacji

próby rozstęp w tej realizacji

Podobnie definiuje się inne statystyki pozycyjne np. decyle z próby i centyle z próby.

Uwaga: KaŜdemu elementowi próby przyporządkowujemy 1, gdy element ma wartość cechy X

równą wariantowi ω lub 0 w przeciwnym przypadku. Wtedy próba (X1, X2, ..., Xn) jest ciągiem

zmiennych losowych o rozkładach zerojedynkowych, a kaŜda realizacja próby jest ciągiem

n- elementowym zer lub jedynek.

14.2.2. Rozkład średniej z próby

Średnia z próby n-elementowej jest to statystyka

Xn =

1 n

∑ Xi

n i=1

Parametry średniej

Jeśli cecha X populacji ma wartość oczekiwaną m i wariancję σ2 , to

σ2

σ

EX n =m , D 2 X n = , DX n =

n

n

Rozkład średniej

Jeśli cecha X populacji ma rozkład normalny N(m, σ), to średnia arytmetyczna X n ma rozkład

σ

3

normalny N m,

. Twierdzenie to wynika z własności rozkładu normalnego .

n

Rozkład asymptotyczny średniej

Jeśli cecha X populacji ma wartość oczekiwaną m i wariancję σ 2 >0 , to dla duŜych n średnia

σ

arytmetyczna X n ma rozkład asymptotycznie normalny N m,

.

n

Twierdzenie to wynika z faktów:

a) na podstawie tw. Lindeberga-Levy’ego4 suma

n

∑X

i

ma rozkład asymptotycznie normalny,

i=1

b) funkcja liniowa zmiennej losowej o rozkładzie normalnym ma rozkład normalny.

Oba rozkłady średniej (dokładny i asymptotyczny) potwierdzają znany nam fakt, wynikający

z prawa wielkich liczb Chinczyna, Ŝe średnia arytmetyczna duŜej liczby zmiennych losowych ma

rozkład skupiony przy wartości oczekiwanej. Teraz ten fakt został ujęty ilościowo.

3

4

Patrz podpunkt 21.1.1. części VII Wybrane twierdzenia z dowodami

Patrz podpunkt 9.2.2 części III Rachunek prawdopodobieństwa

7

STATYSTYKA MATEMATYCZNA

Przykład 14.1

Cecha X populacji ma rozkład normalny N(3,1). Obliczymy prawdopodobieństwa

P( X-3 <0,1), P( X16 -3 <0,1), P( X 400 -3 <0,1) .

Rozwiązanie

P ( X-3 <0,1) =2Φ ( 0,1) -1=2 ⋅ 0,5398-1=0,08

1

1

Statystyka X16 ma rozkład N 3,

, czyli rozkład N 3, 4 . Zatem

16

1

1

P( X16 -3 <0,1)=P X16 -3 : <0,1: =2Φ(0,4)-1= 2 ⋅ 0,4556-1=0,30

4

4

1

1

Statystyka X 400 ma rozkład N 3,

czyli rozkład N 3, 20 . Zatem

400

1

1

P( X 400 -3 <0,1)=P X 400 -3 : <0,1: =2Φ(2)-1=2 ⋅ 0,97725-1=0,955

20

20

Obliczyliśmy prawdopodobieństwa, Ŝe zmienne losowe X, X16 , X 400 przyjmą wartości

z otoczenia o promieniu 0,1 swoich wartości oczekiwanych. Widać, Ŝe to prawdopodobieństwo dla

zmiennej losowej X jest małe, umiarkowanej wartości dla średniej X16 i bardzo duŜe dla średniej

X 400 . Potwierdza to wcześniej sformułowaną właściwość średniej z próby, o przyjmowaniu przez

nią wartości z prawdopodobieństwem bliskim jedności mało róŜniących się od jej wartości

oczekiwanej (a takŜe cechy populacji), gdy próba jest liczna. Wynika stąd, Ŝe wartości statystyki

X n mogą słuŜyć do oceny wartości oczekiwanej, gdy wartość ta nie jest znana, a próba ma duŜo

elementów. 14.2.3. Rozkład statystyk związanych z wariancją z próby

Wariancja z próby n-elementowej jest to statystyka

1 n

S2n = ∑ (Xi − X n ) 2

n i =1

Odchylenie standardowe z próby n-elementowej jest to statystyka

Sn =

1 n

∑ (Xi − X n )2

n i=1

Interpretacja

ZauwaŜmy, Ŝe dla realizacji próby, której elementy mało róŜnią się od siebie realizacja s 2n

statystyki S2n jest liczbą bliską zeru, natomiast dla realizacji próby, której elementy róŜnią się

znacznie od siebie, ta realizacja jest duŜą liczbą. Podobne uwagi dotyczą odchylenia standardowego

z próby. Zatem statystyki S2n i Sn są miarami zróŜnicowania elementów próby względem średniej

z próby.

Z wariancją z próby związane są statystyki

Ŝ2n =

2

1 n

X i -X n ) oraz

(

∑

n-1 i=1

gdzie m jest wartością oczekiwaną cechy X populacji.

8

So2

n =

1 n

2

∑ ( Xi -m )

n i=1

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

ZauwaŜmy, Ŝe między statystykami Ŝ2n i So2

n występują związki

Ŝ2n =

n

2

n 2

Sn oraz nS2n =(n-1) Ŝ2n = ∑ ( X i -X n )

n-1

i=1

nS2n nSo2

n

i

2

2

σ

σ

Zakładamy, Ŝe cecha X populacji ma rozkład normalny N(m, σ). Wtedy statystyka

Rozkłady statystyk

2

n

nSo2

X i -m

n

=

∑

2

σ

σ

i=1

jest sumą kwadratów n niezaleŜnych zmiennych losowych o rozkładzie normalnym N(0, 1), zatem

ma rozkład χ 2 z n stopniami swobody5.

Natomiast statystyka

nS2n n X i -X n

=∑

σ 2 i=1 σ

2

nSo2

n

, Ŝe zamiast róŜnicy Xi - m występuje róŜnica X i - X n . MoŜna

σ2

udowodnić, Ŝe ma ona takŜe rozkład χ 2 , tyle, Ŝe z n-1 stopniami swobody. Zatem prawdziwe jest

twierdzenie:.

nSo2

n

Jeśli cecha X populacji ma rozkład normalny N(m, σ), to statystyka

ma rozkład χ 2

σ2

nS2n

z n stopniami swobody. Statystyka

ma rozkład χ 2 z n-1 stopniami swobody.

2

σ

2 ˆ2

o2

ZbieŜność statystyk Sn ,Sn ,Sn

Jeśli cecha populacji X ma wariancję σ 2 , to ciągi ( S2 ) , Sˆ 2 , ( So2 ) są zbieŜne według

róŜni się tym od statystyki

( )

( S ) , ( Sˆ ) , (S ) są

n

prawdopodobieństwa do wariancji σ 2 , natomiast ciągi

n

n

n

n

o

n

zbieŜne według

prawdopodobieństwa do odchylenia standardowego σ .

Wynika stąd, Ŝe dla licznej próby wartości statystyk S2n , Sˆ 2n , So2

n mogą słuŜyć do oceny wariancji

σ 2 , natomiast wartości statystyk S ,Sˆ ,So do oceny odchylenia standardowego σ .

n

n

n

Wartość oczekiwana statystyk S , Sˆ 2n , So2

n

2

n

ES2n =

5

n-1 2

σ ,

n

E Sˆ 2n =σ 2 ,

Patrz ppkt 6.2.5 - definicja rozkładu chi kwadrat.

9

2

E So2

n =σ .

STATYSTYKA MATEMATYCZNA

W tabelach 14.2. i 14.3. podano zestawienie wybranych statystyk wraz z ich rozkładami6.

Tabela 14.2. Rozkłady statystyk dla jednej cechy populacji

Rozkład cechy populacji

Statystyka

Rozkład statystyki

Normalny

Xn

Normalny N(m,σ)

Dowolny z wartością

oczekiwaną m i wariancją

2

nSn 2

σ2

nSn o2

σ2

X n -m

n-1

Sn

χ 2 z n-1 stopniami swobody

χ 2 z n stopniami swobody

Studenta z n-1 stopniami swobody

Xn

Asymptotycznie normalny

σ

N(m,

) dla duŜych n

n

Wskaźnik struktury

(częstość sukcesu)

Yn

n

Yn- liczba jedynek w

próbie

Asymptotycznie normalny

p(1-p)

N p,

,

n

σ >0

Zerojedynkowy

P(X = 1) = p

P ( X = 0) = 1 − p

p- prawdopodobieństwo

sukcesu

σ

N m,

n

Dla przypadku, gdy X: N(m, σ), podane w tabeli 14.3. rozkłady statystyk moŜna zilustrować

w sposób następujący.

Rys. 14.1. Rozkłady wybranych statystyk

6

Patrz punkt 21.1. części VII Wybrane twierdzenia z dowodami

10

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Tabela 14.4. Rozkłady statystyk dla dwóch niezaleŜnych cech populacji

Rozkład cechy X

Rozkład cechy Y

Normalny

N(m, σ1)

Normalny

N(m, σ2)

Normalny

N(m, σ)

Normalny

N(m, σ)

Normalny

N(m1, σ )

Normalny

N(m2, σ )

Dowolny

z wartością

oczekiwaną m1

i z wariacją σ12

Dowolny

z wartością

oczekiwaną m2

i z wariacją σ 22

Statystyka

X n1 -Yn 2

σ12 σ 22

+

n1 n 2

Xn1 -Yn2

2

1 n1

nn

1 2

(n1+n2-2)

n1+n2

2

2 n2

nS +n S

Ŝ2n 2

X n1 -Yn 2

n1

11

+

Normalny

N(0,1)

Studenta z n1 + n2 -2

stopniami swobody

Snedecora z parą

(n1-1, n2-1) stopni

swobody

Ŝ2n1

S2n1

Rozkład statystyki

S2n 2

n2

Asymptotycznie normalny

N(0,1)

STATYSTYKA MATEMATYCZNA

15. ESTYMACJA PARAMETRÓW

15.1. Wprowadzenie

W teorii estymacji wyróŜnia się: estymację parametryczną i estymację nieparametryczną.

Estymacja parametryczna dotyczy szacowania nieznanych parametrów rozkładu. Problem

estymacji parametrycznej, odnoszący się do jednej cechy jest następujący:

Populacja badana jest ze względu na cechę X o rozkładzie zaleŜnym od parametru Q, tzn.

dystrybuanta tej cechy jest postaci FQ (x), przy czym dla kaŜdego Q naleŜącego do pewnego zbioru

Ω – przestrzeni parametru Q, dystrybuanta ta jest znana. Przy tych załoŜeniach wnioskowanie

o rozkładzie cechy X sprowadza się do oszacowania (estymacji) na podstawie próby wartości

parametru Q.

WyróŜnia się dwa sposoby szacowania parametru Q: oszacowanie punktowe i oszacowanie

przedziałowe.

Estymacja nieparametryczna dotyczy szacowania postaci funkcyjnej rozkładu, np. w postaci

dystrybuanty. MoŜna w tym celu stosować, analogicznie jak przy estymacji parametrycznej,

oszacowanie punktowe lub przedziałowe. Przy szacowaniu przedziałowym wyznacza się obszar

(pas) ufności.

15.2. Estymacja punktowa

Estymacja punktowa parametru Q polega na:

Wybraniu pewnej statystyki Un o rozkładzie zaleŜnym od parametru Q.

Obliczeniu na podstawie próby wartości un statystyki Un

Przyjęciu, Ŝe un jest oszacowaniem parametru Q, co zapisujemy

Q̂ = u n

i czytamy: oceną parametru Q jest un.

Statystyka Un nazywa się wówczas estymatorem parametru Q.

Znanych jest szereg metod wyznaczania estymatorów. NajwaŜniejsze z nich to: metoda momentów,

metoda największej wiarygodności, metoda najmniejszych kwadratów – autor Carl Gauss, metoda

estymacji bayesowskiej i metoda estymacji minimaksowej.

PoniŜej podano istotę pierwszej z wymienionych metod, druga zostanie scharakteryzowana

w punkcie 15.2.4, a trzecia w punkcie 17.3.2.(łacznie z nawiązaniem do poprzednich)

Metoda momentów została opracowana pod koniec XIX wieku przez angielskiego statystyka

K. Pearsona. Zgodnie z tą metodą przyjmuje się, Ŝe estymatorem momentu cechy populacji jest

odpowiadający mu moment z próby, zaś estymatorem funkcji momentów populacji jest ta sama

funkcja momentów z próby.

Przykład 15.1

Badana jest cecha X populacji. Zgodnie z metodą momentów przyjmujemy, Ŝe estymatorem

1 n

wartości oczekiwanej m jest średnia z próby X n = ∑ Xi , natomiast estymatorem wariancji σ2

n i =1

n

2

1

jest wariancja z próby S2n = ∑ ( X i -X n ) . n i=1

NaleŜy podkreślić, Ŝe charakterystyki liczbowe opisane w ramach statystyki opisowej pokrywają się

z estymatorami wyznaczonymi metodą momentów.

12

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

15.2.1. Klasyfikacja estymatorów i nierówność Rao-Cramera

Estymator zgodny parametru Q jest to estymator Un zbieŜny wg prawdopodobieństwa do Q, tzn.

lim P( U n -Q <ε)=1

n →∞

dla dowolnego ε >0

Estymator nieobciąŜony parametru Q jest to estymator Un o wartości oczekiwanej równej

parametrowi Q

EUn = Q

Estymator najefektywniejszy parametru Q jest to estymator nieobciąŜony tego parametru

o najmniejszej wariancji spośród wszystkich estymatorów nieobciąŜonych parametru Q.

Estymator obciąŜony parametru Q jest to estymator Un taki, Ŝe

EUn ≠ Q

Estymator asymptotycznie nieobciąŜony parametru Q jest to estymator Un o granicy wartości

oczekiwanej równej parametrowi Q

lim EU n =Q

n →∞

Estymator asymptotycznie najefektywniejszy parametru Q jest to estymator nieobciąŜony lub

asymptotycznie nieobciąŜony taki, Ŝe

(

D2 U n

lim 2 =1

n →∞ D U

n

(

gdzie U n jest estymatorem najefektywniejszym parametru Q.

Interpretacja

Jeśli estymator jest estymatorem zgodnym parametru Q, to dla duŜej próby

z prawdopodobieństwem bliskim 1 ocena parametru i parametr mało róŜnią się.

Jeśli estymator parametru Q jest nieobciąŜony, to otrzymujmy oceny bez błędu systematycznego.

Jeśli bowiem byłoby EU n <Q , to otrzymywalibyśmy oceny średnio zaniŜone. Natomiast, gdyby

EU n >Q , to otrzymywalibyśmy oceny średnio zawyŜone.

Jeśli estymator jest estymatorem najefektywniejszym parametru Q, to jego rozkład jest najbardziej

skupiony przy parametrze Q, zatem otrzymujemy oceny bliŜsze parametrowi Q, niŜ przy innych

estymatorach.

Estymator asymptotycznie nieobciąŜony jest praktycznie estymatorem nieobciąŜonym, gdy próba

jest liczna, takŜe estymator asymptotycznie najefektywniejszy jest praktycznie, dla duŜej próby,

estymatorem najefektywniejszym.

Zgodność, a nieobciąŜoność estymatora

PoniŜsze twierdzenie jest uŜyteczne przy badaniu zgodności estymatora.

Jeśli Un jest estymatorem nieobciąŜonym lub asymptotycznie nieobciąŜonym parametru Q oraz

lim D 2 U n =0

n →∞

to Un jest estymatorem zgodnym tego parametru.

Nierówność Rao-Cramera

Jeśli cecha populacji X jest zmienną losową skokową o funkcji prawdopodobieństwa zaleŜnej od

parametru Q

P(X=x k )=pk (Q)

i Un jest estymatorem nieobciąŜonym parametru Q oraz spełnione są warunki regularności7, to

wariancja estymatora Un spełnia tzw. nierówność Rao-Cramera

7

Leitner Roman, Zacharski Janusz: Zarys matematyki wyŜszej dla studentów, część III, WNT, Warszawa 1998 - str. 298

13

STATYSTYKA MATEMATYCZNA

1

D2 U n ≥

2

d

n∑

lnp k (Q) p k (Q)

k dQ

przy czym dla estymatora najefektywniejszego zachodzi równość w powyŜszej nierówności.

Jeśli cecha populacji X jest zmienną losową ciągłą o gęstości fQ(x) zaleŜnej od parametru Q

i Un jest estymatorem nieobciąŜonym parametru Q oraz spełnione są warunki regularności8, to

wariancja estymatora Un spełnia nierówność Rao-Cramera w poniŜszej postaci

D2 U n ≥

1

2

∞

∂

n∫

ln f Q (x) f Q (x)dx

∂Q

-∞

przy czym dla estymatora najefektywniejszego zachodzi równość w powyŜszej nierówności.

Efektywność estymatora

Efektywność estymatora nieobciąŜonego Un parametru Q jest to liczba

(

D2 U n

en = 2

D Un

(

2

gdzie D U n jest wariancją estymatora najefektywniejszego parametru Q.

Oczywiście

0 < en ≤ 1

Estymator Un jest estymatorem najefektywniejszym wtedy i tylko wtedy, gdy en = 1.

15.2.2. Estymacja wartości oczekiwanej rozkładu normalnego

Cecha X populacji ma rozkład normalny N(m,σ), przy czym σ jest znane. Przyjmiemy, Ŝe

estymatorem wartości oczekiwanej jest średnia z próby

1 n

X n = ∑ Xi

n i =1

Zgodność

Cecha X ma rozkład z wartością oczekiwana m. Średnia z próby X n jest estymatorem zgodnym

wartości oczekiwanej m, gdyŜ na podstawie prawa wielkich liczb Chinczyna9

lim P( X n - m <ε)=1 dla dowolnego ε >0 n →∞

NieobciąŜoność

PoniewaŜ

1 n

1

1 n

1 n

EX n =E ∑ X k = ∑ EX k = ∑ m= nm=m

n k=1

n

n k=1 n k=1

więc średnia z próby jest estymatorem nieobciąŜonym wartości oczekiwanej. Efektywność

Obliczymy najpierw wariancję estymatora najefektywniejszego wartości oczekiwanej rozkładu

normalnego, a następnie wariancję średniej z próby i porównamy otrzymane wielkości.

8

9

Patrz jw

Patrz ppkt 9.4.3. części III Rachunek prawdopodobieństwa

14

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

% jest estymatorem najefektywniejszym, to jego wariancja jest równa prawej stronie

Jeśli U

n

nierówności Rao-Cramera

1

1

% =

D2 U

= {ozn.} =

n

2

∞

M

∂

n∫

lnf m (x) f m (x)dx

∂m

-∞

2

2

1

gdzie: f m (x)=

e-(x-m) /(2σ )

σ 2π

1

(x-m)2

∂

(x-m)

Zatem lnf m (x)=ln

i

lnf m (x)= 2

2

∂m

σ

σ 2π 2σ

∞

n

n

n

n

M= 4 ∫ (x-m) 2 f m (x)dx= 4 D2 X= 4 σ 2 = 2

σ -∞

σ

σ

σ

2

(

1

σ

Czyli D 2 U n =

wariancja estymatora najefektywniejszego wartości oczekiwanej rozkładu normalnego

=

1

n 2 n

σ

n

1

1 n

1

σ2

1 n

D2 X n =D2 ∑ X k = 2 ∑ D2 X k = 2 ∑ σ 2 = 2 nσ 2 =

n k=1

n

n

n k=1 n k=1

(

Zatem D2 X n = D2 U n , więc średnia z próby jest estymatorem najefektywniejszym wartości

oczekiwanej rozkładu normalnego.

Z powyŜszego wynika, Ŝe średnia z próby X n jest estymatorem zgodnym, nieobciąŜonym

i najefektywniejszym wartości oczekiwanej rozkładu normalnego.

15.2.3. Estymatory wariancji rozkładu normalnego

Estymatorami wariancji są statystyki

2

2

1 n

1 n

1 n

2

Sn 2 = ∑ ( X i -X n ) Sn o2 = ∑ ( X i -m ) Ŝn 2 =

X i -X n )

(

∑

n i=1

n i=1

n-1 i=1

Zbadamy własności tych estymatorów przy załoŜeniu, iŜ rozkład cechy jest normalny.

nSn 2 nSn o2

W ppkt 14.2.3. stwierdziliśmy, Ŝe statystyki

i

mają rozkłady chi kwadrat z n-1

σ2

σ2

i n stopniami swobody oraz, Ŝe rozkład chi kwadrat z n stopniami swobody ma wartość oczekiwaną

równą n i wariancję 2n.

NieobciąŜoność10

E

nS2n

=n-1

σ2

oraz

E

E

nSo2

n

=n

σ2

oraz

E

nS2n n

= 2 ES2n

2

σ

σ

nSo2

n

n

= 2 ESo2

n

2

σ

σ

zatem ES2n =

n-1 2

σ

n

2

zatem ESo2

n =σ

n 2 n

n n-1 2 2

ESˆ 2n =E

Sn =

ES2n =

σ =σ

n-1

n-1

n-1 n

10

W 21.2 części VI Wybrane twierdzenia wraz z dowodami oceniono obciąŜoność wariancji bez załoŜenia o

normalności rozkładu

15

STATYSTYKA MATEMATYCZNA

Wnioski

2

2

Statystyki So2

n i Ŝn są estymatorami nieobciąŜonymi wariancji σ .

Statystyka S2n jest estymatorem obciąŜonym wariancji σ 2 ale

n-1 2 2

σ =σ

lim ES2n = lim

n →∞

n →∞ n

czyli jest estymatorem asymptotycznie nieobciąŜonym wariancji σ 2 .

Zgodność

Przy badaniu zgodności estymatorów wariancji σ 2 wykorzystamy twierdzenie podane w punkcie

15.2.1. PoniewaŜ rozwaŜane estymatory wariancji są nieobciąŜone lub asymptotycznie

nieobciąŜone, to zgodnie z tym twierdzeniem będą estymatorami zgodnymi, gdy ich wariancje

zbieŜne są do zera. Obliczymy te wariancje

2 ( n-1) 4

nS2

nS2 n 2

D2 2n =2(n-1)

oraz D 2 2n = 4 D 2 S2n , zatem D 2 S2n =

σ →0

σ

σ

σ

n2

o2

o2

n2

2σ 4

2 nSn

2 nSn

o2

2 o2

D

=2n

oraz D

= 4 ESn , zatem D Sn =

→0

n

σ2

σ2

σ

n 2

n2

n 2 2 ( n-1) 4 2σ 4

2 2

σ =

→0

D 2Sˆ 2n =D 2

Sn =

D

S

=

n

2

2

2

n-1

n-1

( n-1)

( n-1) n

Wniosek. Statystyki S 2n , Son 2 , Ŝ 2n są estymatorami zgodnymi wariancji σ 2

Efektywność

(

Jeśli U n jest estymatorem najefektywniejszym wariancji σ 2 , to jego wariancja jest równa prawej

stronie nierówności Rao-Cramera, czyli

% =

D2 U

n

gdzie: f σ2 (x)=

1

2

∞

∂

n ∫ 2 lnf σ2 (x) f σ2 (x)dx

∂

σ

-∞

= {ozn.} =

2

2

1

e-(x-m) /(2σ )

σ 2π

Zatem

1

1 (x-m) 2

lnf σ2 (x)=- lnσ 2 -ln

2

2

2π 2σ

∂

1 (x-m)2 (x-m)2 -σ 2

lnf

(x)=+

=

2

∂σ 2 σ

2σ 2

2σ 4

2σ 4

2

2

∞

(x-m) 2 -σ 2

∂

M = n ∫ 2 lnf σ2 (x) f σ2 (x)dx = n ∫

f 2 (x)dx =

2σ 4 σ

∂σ

-∞

-∞

∞

∞

∞

∞

n

4

2

2

4

= 8 ∫ (x-m) f σ2 (x)dx-2σ ∫ (x-m) f σ2 (x)dx+σ ∫ f σ2 (x)dx =

4σ - ∞

-∞

-∞

4

n

1

2σ

n

= 8 µ 4 -2σ 4 +σ 4 = 8 3σ 4 -2σ 4 +σ 4 = 8 = 4

4σ

2σ

4σ 2σ

4

(

1

2σ

D2 U n =

=

1

n

n 4

2σ

16

1

M

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Porównując otrzymany wynik z wcześniej obliczonymi wariancjami estymatorów stwierdzamy, Ŝe

( 2σ 4

2 o2

2

D Sn =D U n =

n

(

2

4

D U 2σ 2σ 4 n-1

e n = 2 2n =

:

=

n n-1 n

D Sˆ n

(

D 2 U n 2σ 4 2(n-1)σ 4 n

=

:

=

D 2S2n

n

n2

n-1

Wnioski z powyŜszych równości

Statystyka

So2

n =

1 n

2

( Xi -m ) jest estymatorem najefektywniejszym wariancji σ2 rozkładu

∑

n i=1

normalnego.

2

1 n

X i -X n ) nie jest estymatorem najefektywniejszym wariancji σ2 rozkładu

(

∑

n-1 i=1

normalnego, ma efektywność (n-1)/n, jest więc estymatorem asymptotycznie najefektywniejszym.

Statystyka Ŝ2n =

2

1 n

X i -X n ) jest estymatorem asymptotycznie najefektywniejszym wariancji σ2

(

∑

n i=1

rozkładu normalnego.

Statystyka S2n =

PoniewaŜ statystyka ta nie jest estymatorem nieobciąŜonym, więc nie moŜe być estymatorem

najefektywniejszym i nie moŜna mówić o efektywności tego estymatora.

Estymatory odchylenia standardowego

Estymatory odchylenia standardowego przedstawione są w tabeli 15.2.

ZauwaŜmy, Ŝe pierwiastek kwadratowy estymatora nieobciąŜonego wariancji σ2 nie musi być

estymatorem nieobciąŜonym odchylenia standardowego σ.

15.2.4. Metoda największej wiarygodności otrzymywania estymatorów

Cecha X populacji ma rozkład zaleŜny od s parametrów Q1, ... , Qs

(X1, ... , Xn) – próba

(x1, ... , xn) – realizacja próby.

Funkcja wiarygodności jest to funkcja s zmiennych Q1, ... , Qs

•

•

w przypadku cechy populacji X skokowej przyporządkowuje kaŜdemu moŜliwemu punktowi

(Q1, ... , Qs) prawdopodobieństwo otrzymania realizacji próby (x1, ... , xn)

L(Q1, ... , Qs) = P(X1 = x1, … , Xn = xn) = P(X1 = x1) … P(Xn = xn)

w przypadku cechy populacji X ciągłej przyporządkowuje kaŜdemu moŜliwemu punktowi

(Q1, ... , Qm) gęstość próby w punkcie będącym realizacją próby (x1, ... , xn)

L(Q1, ... , Qs) = f (x1, ... , xn) = f1(x1) … fn(xn)

Metoda największej wiarygodności (MNW) otrzymywania estymatorów polega na wyznaczeniu,

ˆ , ..., Q

ˆ , parametrów Q1, ... , Qs, by funkcja wiarygodności

dla danej realizacji próby, takich ocen Q

1

s

ˆ

ˆ

w punkcie ( Q , ..., Q ) osiągała wartość największą.

1

s

Estymatory, których wartościami są oceny parametrów Q1, ... ,Qs uzyskiwanymi metodą

największej wiarygodności nazywamy estymatorami największej wiarygodności (ENW).

17

STATYSTYKA MATEMATYCZNA

Interpretacja

MNW opiera się na następującej intuicji: skoro otrzymano realizację próby (x1, ... , xn), to musiała

ona być bardziej wiarygodna od innych realizacji, tzn. w przypadku cechy skokowej

prawdopodobieństwo uzyskania takiej realizacji powinno być największe, natomiast

w przypadku cechy ciągłej gęstość próby dla otrzymanej realizacji powinna być największa.

ENW mają rozkłady asymptotycznie normalne i są estymatorami zgodnymi oraz asymptotycznie

nieobciąŜonymi i asymptotycznie najefektywniejszymi ( przy dość ogólnych załoŜeniach).

Przykład 15.2

Wyznaczymy metodą największej wiarogodności na podstawie próby (x1 , x 2 ,..., x n ) estymator

wartości oczekiwanej cechy X o rozkładzie N(m,σ)

Uwzględniając, Ŝe gęstość rozkładu normalnego ma postać

−

1

f (x) =

e

σ 2π

otrzymuje się funkcję wiarogodności w postaci

−

1

L(m) =

e

σ 2π

(x1 − m)2

2σ

2

−

1

...

e

σ 2π

(x − m) 2

2 σ2

(x n − m) 2

2σ

2

n

1

n

( x i − m)

1 − 2 σ2 ∑

i=1

=

e

σ 2π

2

Przy poszukiwaniu maksimum funkcji L(m) wygodniej posługiwać się logarytmem tej funkcji,

gdyŜ łatwiej jest znaleźć maksimum lnL(m), aniŜeli maksimum L(m), a obie funkcja L(m) i ln L(m)

przyjmują maksimum w tym samym punkcie, co funkcja, a na ogół.

Logarytm funkcji L(m) jest równy

1

1

1

+ n ln

− 2

σ

2 π 2σ

Po zróŜniczkowaniu względem parametru m otrzymujemy

ln L(m) = n ln

n

∑ (x

i

− m) 2

i =1

d ln L(m)

1 n

1 n

1

= − 2 ∑ (x i − m) = 2 ∑ x i − 2 n ⋅ m

dm

σ i =1

σ i =1

σ

Po przyrównaniu pochodnej do zera otrzymujemy

1

σ2

n

∑x

i

−

i =1

1

ˆ =0

n⋅m

σ2

skąd

1 n

∑ xi

n i =1

Zatem estymator wartości oczekiwanej cechy X o rozkładzie N(m,σ) jest równy średniej

arytmetycznej elementów próby.

Druga pochodna jest równa

m̂ =

d2

d d ln L(m) d 1

ln L(m) =

= 2

2

dm

dt

dm

dt σ

n

∑x

i =1

i

−

1

1

n ⋅m = − 2 n < 0

2

σ

σ

czyli m̂ zapewnia maksimum funkcji L(m) Kolejne przykłady wyznaczania estymatorów metoda największej wiarogogodności zamieszczono

w punkcie 21.3. części VI Wybrane twierdzenia wraz z dowodami:

• Estymator parametru p rozkładu zero-jedynkowego.

• Estymator parametru Θ rozkładu wykładniczego.

• Estymator parametru λ rozkładu Poissona.

18

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

15.2.5. Zestawienie estymatorów parametrów rozkładu zmiennej losowej i ich własności

Tabela 15.2. Zestawienie estymatorów

Parametr

Wartość

oczekiwana m

rozkładu

normalnego

Estymator

Zgodny

NieobciąŜony

Najefektywniejszy

1 n

∑ Xk

n k=1

TAK

TAK

TAK

2

1 n

X i -X n )

(

∑

n i=1

TAK

Asymptotycznie

nieobciąŜony

Brak oceny11

1 n

2

( Xi -m )

∑

n i=1

TAK

TAK

TAK

2

1 n

X i -X n )

(

∑

n-1 i=1

TAK

TAK

Asymptotycznie

najefektywniejszy

TAK

Asymptotycznie

nieobciąŜone

Asymptotycznie

najefektywniejsze

TAK

TAK

DuŜa efektywność

dla małych prób

TAK

TAK

Efektywność

1/(π-2)

TAK

TAK

TAK

TAK

TAK

TAK

Xn =

S2n =

Wariancja σ2

rozkładu

normalnego

S02

n =

Ŝ2n =

S0n , Ŝn , Sn

Odchylenie

standardowe

Parametr λ

rozkładu

Poissona

Parametr p

rozkładu zerojedynkowego

11

Własności estymatora

U n = ( X max -X min ) d n

Xmax – największy

element w próbie

Xmin – najmniejszy

element w próbie

dn – współczynnik

liczbowy, tak

dobrany, by estymator

był nieobciąŜony

n

1

Un =

π/2 ∑ X k -m

n

k=1

Xn =

1 n

∑ Xk

n k=1

Yn/n, gdzie Yn

oznacza liczbę

jedynek

w próbie

Statystyka jest estymatorem asymptotycznie najefektywniejszym wariancji rozkładu normalnego, ale poniewaŜ

statystyka ta nie jest estymatorem nieobciąŜonym, więc nie moŜe być estymatorem najefektywniejszym i nie moŜna

mówić o efektywności tego estymatora.

19

STATYSTYKA MATEMATYCZNA

15.3. Estymacja przedziałowa

15.3.1. Uwagi wstępne

Oszacowanie przedziałowe nieznanego parametru polega na wyznaczeniu przedziału ufności.

X – cecha populacji, Q – parametr rozkładu cechy X, 1 - α - poziom ufności ( 0< α <1).

*

**

Jeśli istnieją dwie statystyki U*n , U**

n takie, Ŝe P(U n ≤ Q ≤ U n )=1-α to przedział losowy

12

<U*n ; U**

n >

nazywamy przedziałem ufności parametru Q na poziomie ufności 1 - α.

(15.1)

*

**

Jeśli na podstawie próby obliczymy wartości u*n , u**

n statystyk Un , Un , to otrzymujemy liczbowy

przedział

< u*n ; u**

n >

(15.2)

będący wartością (realizacją) przedziału (15.1). Parametr Q moŜe naleŜeć do przedziału (15.2) lub

nie naleŜeć. Jeśli jednak poziom ufności 1 - α jest bliski jedności, to bardzo rzadko będziemy

otrzymywać liczbowe przedziały ufności (15.2) do których parametr Q nie naleŜy.

Granice przedziału ufności są zmiennymi losowymi. Zatem dla róŜnych realizacji próby

otrzymujemy na ogół róŜne realizacje przedziałów ufności. Gdybyśmy oszacowanie przedziałowe

powtórzyli wiele razy, to częstość realizacji, do których szacowany parametr naleŜy byłaby bliska

poziomowi ufności i tak np. jeśli próbę powtórzono 100 razy i poziom ufności przyjęto 0,99, to

częstość tych realizacji, do których parametr naleŜy byłaby bliska 0,99, a więc średnio tylko do

jednej ze 100 realizacji szacowany parametr nie będzie naleŜał.

Błąd bezwzględny. Błąd względny

Jeśli realizacja (15.2) ma postać <u n - ε; u n + ε> , to liczbę ε nazywamy błędem bezwzględnym, zaś

ε

liczbę δ=

błędem względnym oszacowania parametru na poziomie istotności 1 - α.

un

Na poniŜszym rysunku przedstawiono kilka z moŜliwych realizacji przedziałów ufności dla

wartości oczekiwanej.

m

Rys. 15.4. Ilustracja szacowania m za pomocą przedziałów ufności

Niektóre z nich pokrywają prawdziwą wartość parametru m, a niektóre nie. Sumarycznie, tzn.

odnosząc się do wszystkich realizacji przedziałów ufności otrzymywanych tą metodą naleŜy

stwierdzić, Ŝe z częstością bliską 1-α pokrywają prawdziwą wartość parametru.

12

RozwaŜa się takŜe jednostronne przedziały ufności postaci (-∞; Un> lub <Un;-∞).

20

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

15.3.2. Wyznaczenie przedziału ufności dla wartości oczekiwanej rozkładu normalnego

Dla zilustrowania sposobu postępowania przy określeniu przedziału ufności wyznaczymy go dla

wartości oczekiwanej rozkładu normalnego w dwóch przypadkach: przy znanej i nieznanej

wariancji.

Znana wariancja.

Cecha X ma rozkład normalny N(m,σ), σ jest znane.

Do budowy przedziału ufności na poziomie 1 – α wybieramy statystykę do oszacowania wartości

oczekiwanej w postaci średniej arytmetycznej próby X n , która jak wiadomo (21-3.1) jest

σ

estymatorem najefektywniejszym. Jak wiadomo13, średnia arytmetyczna ma rozkład X n : N(m,

)

n

zaleŜny od wartości oczekiwanej m.

Standaryzujemy X n , tzn. przekształcamy ją w statystykę U n

Un =

Statystyka Un ma rozkład N(0,1)14 .

Xn − m

σ

n

Wyznaczamy przedział liczbowy < −u α , u α > tak aby

P[− u α ≤

Xn − m

≤ uα ] = 1− α

σ

n

(15-3.2)

gdzie uα zaleŜy od poziomu ufności 1 - α.

Rozwiązujemy nierówność pod znakiem prawdopodobieństwa względem m

σ

σ

−u α

≤ Xn − m ≤ u α

n

n

σ

σ

−Xn − u α

≤ −m ≤ − X n + u α

n

n

σ

σ

Xn + uα

≥ m ≥ Xn − uα

n

n

σ

σ

Xn − uα

≤ m ≤ Xn + u α

(15-3.3)

n

n

ZaleŜność (15-3.3 ) określa szukany przedział ufności, spełnia on warunek

σ

σ

(15-3.4)

P(X n − u α

≤ m ≤ Xn + uα

) = 1− α

n

n

Dla jego określenia naleŜy jeszcze wyznaczyć uα. Uwzględniając (3.6-2) i rozkład normalny Un

P(− u α ≤ U n ≤ u α ) = P(U n ≤ u α ) − P(U n ≤ − u α ) = φ(u α ) − φ(− u α )

qdzie Φ jest dystrybuantą rozkładu normalnego N(0,1).

PoniewaŜ Φ (−u α ) = 1 − Φ (u α ) - patrz poniŜszy rysunek

13

14

Podpunkt 19.1.1 części VI Wybrane twierdzenia z dowodami

Podpunkt 20.5.5 części VI Wybrane twierdzenia z dowodami

21

STATYSTYKA MATEMATYCZNA

Rysunek 15.14a. Wyznaczanie granicy przedziału ufności

to

P(− u α ≤ U n ≤ u α ) = φ(u α ) − 1 + φ(u α ) = 2φ(u α ) − 1

Uwzględniając (15-3.2) mamy równanie do wyznaczenia uα

2φ(u α ) − 1 =1-α

Zatem uα wyznacza się z zaleŜności

φ(u α ) = 1 −

α

2

(15-3.5)

Uwagi dotyczące przedziału ufności (15.3)

1. PołoŜenie końców przedziału jest losowe (bo średnia z próby ma wartość zaleŜną od realizacji

próby).

2. Długość przedziału jest stała.

3. Długość przedziału zaleŜy od poziomu ufności 1–α (bo u α zaleŜy od α), im większy poziom

ufności, tym dłuŜszy przedział ufności – patrz rys. 15.3.

4. Długość przedziału jest odwrotnie proporcjonalna do pierwiastka liczebności próby, zatem ze

wzrostem liczebności próby zwiększa się dokładność oszacowania, jednak nadmierne

powiększanie próby nie jest korzystne, bowiem powoduje małe zwiększanie się dokładności.

5. Długość przedziału ufności zaleŜy od odchylenia standardowego σ cechy X. Jeśli X oznacza

wynik pomiaru, to σ oznacza dokładność pomiaru, a więc zwiększanie dokładności pomiarów

powoduje zmniejszenie błędu oszacowania.

Z powyŜszych uwag wynika, Ŝe potrzebny jest kompromis między zaufaniem do oszacowania

(poziomem ufności), a błędem oszacowania, bowiem zwiększenie ufności powoduje zwiększenie

błędu, zmniejszenie błędu powoduje zmniejszenie ufności oszacowania.

Stosowanie przedziału ufności (15.3) wymaga spełnienia załoŜenia, Ŝe odchylenie standardowe σ

jest znane. ZałoŜenie to w zagadnieniach praktycznych jest niezmiernie rzadko spełnione.

Nieznana wariancja

Cecha X ma rozkład normalny N(m,σ), σ jest znane..

Konstrukcja przedziału ufności dla wartości oczekiwanej rozkładu normalnego, gdy σ nie jest

znane wymaga innego, niŜ poprzednio przekształcenia średniej z próby, mianowicie

wykorzystujemy twierdzenie, Ŝe statystyka

X -m

Un = n

n-1

Sn

ma rozkład Studenta z n-1 stopniami swobody15. Dalej postępujemy podobnie jak poprzednio.

15

Podpunkt 21.1.2 części VI Wybrane twierdzenia z dowodami

22

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Wyznaczamy liczbę u α tak, by

P(-u α ≤ U n ≤ u α )=1- α

co jest równowaŜne wyraŜeniu

P( U n ≥ u α )=α

Liczbę u α spełniającą powyŜszy związek odczytujemy z tablic rozkładu Studenta z n-1 stopniami

swobody i poziomu prawdopodobieństwa α (pkt 6 części VII „Tablice statystyczne”) lub

znajdujemy ją przy pomocy programu komputerowego. Mamy

X -m

P(-u α ≤ n

n-1 ≤ u α )=1-α

Sn

Rozwiązując względem m występującą w powyŜszym związku nierówność otrzymujemy przedział

ufności

uS

uS

<X n - α n ;X n + α n > przedział ufności dla wartości oczekiwanej rozkładu normalnego

n-1

n-1

uS

ε= α n błąd bezwzględny (połowa długości przedziału ufności)

n-1

Tym razem nie tylko końce przedziału ufności są losowe, takŜe losowa jest długość przedziału

ufności.

Próba o duŜej liczności

RozwaŜymy jeszcze jedną sytuację. Nie mamy informacji, Ŝe rozkład cechy jest normalny, za to

wiemy, Ŝe próba jest liczna. Wówczas statystyka X n ma rozkład w przybliŜeniu normalny,

σ

N m,

). Postępując, jak przy konstrukcji przedziału (15.3) i zastępując σ odchyleniem

n

standardowym z próby ( o ile σ nie jest znane) otrzymujemy przedział ufności

uS

uS

<X n - α n ;X n + α n > - przedział ufności dla wartości oczekiwanej dowolnego rozkładu.

n

n

Podsumowanie

Znalezione powyŜej trzy przedziały ufności dla wartości oczekiwanej oraz przedziały ufności dla

innych parametrów są przedstawione w tabeli 15.3. Uogólniając powyŜszej przedstawione

postępowanie naleŜy stwierdzić, Ŝe konstrukcja przedziału ufności dla parametru Q polega na:

1. Wybraniu statystyki o rozkładzie zaleŜnym od Q, najlepiej by statystyka ta była estymatorem

najefektywniejszym tego parametru lub estymatorem o wysokiej efektywności.

2. Przekształceniu wybranej statystyki w statystykę U n wyraŜoną wzorem, w którym występuje

Q. Rozkład U n powinien być znany i zaleŜeć tylko od Q.

3. Wyznaczeniu przedziału liczbowego <u1 ;u 2 > , tak by P(u1 ≤ U n ≤ u 2 )=1-α .

4. Rozwiązaniu względem Q nierówności u1 ≤ U n ≤ u 2 .

23

STATYSTYKA MATEMATYCZNA

15.3.3. Tabela przedziałów ufności

Tabela 15.3. Zestawienie przedziałów ufności

Parametr

Wartość

oczekiwana

m

Rozkład cechy

Normalny

N(m,σ),

σ - jest znane

Normalny

N(m,σ),

σ - nie jest znane

Dowolny

Liczna próba

n ≥ 100

Wariancja σ2

Normalny N(m,σ)

nS2 nS2

;

u1 u 2

Odchylenie

standardowe

σ

Normalny

N(m,σ),

nS2 nS2

;

u1

u2

Wskaźnik

struktury p

Rozkład zerojedynkowy

P(X = 1) = p,

P ( X = 0) = 1 − p

liczna próba

n ≥ 100

Wartość

oczekiwana

m

Wartość

oczekiwana

m

Wyznaczanie liczby u α

Przedział ufności

σ uα

σu

<X−

; X+ α >

n

n

<X−

S uα

<X−

W − uα

n −1

S uα

n

Su α

; X+

; X+

n −1

Su α

n

α

2

Φ -dystrybuanta rozkładu N(0,1)

P(| Tn −1 |≥ u α ) = α

Tn-1 zmienna losowa o rozkładzie Studenta z n-1

stopniami swobody

α

Φ (u α ) = 1 −

2

Φ -dystrybuanta N(0,1)

α

P(Yn −1 ≥ u 1 ) =

2

α

P(Yn −1 ≥ u 2 ) = 1 −

2

Yn-1 ma rozkład χ2 z n – 1 stopniami swobody

α

P(Yn −1 ≥ u 1 ) =

2

α

P(Yn −1 ≥ u 2 ) = 1 −

2

Yn-1 ma rozkład χ2 z n – 1 stopniami swobody

α

Φ (u α ) = 1 −

2

Φ -dystrybuanta rozkładu normalnego N(0,1)

Φ (u α ) = 1 −

>

>

W(1 − W)

W(1 − W)

; W + uα

n

n

W - wskaźnik struktury w próbie

W=Yn/n Yn – licznba jedynek w próbie

24

Nr

PU-1

PU-2

PU-3

PU-4

PU-5

PU-6

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Przykład 15.3

Badano ceny drukarek Canon BC250 w 40 wylosowanych punktach sprzedaŜy. Otrzymano, Ŝe

średnia cena drukarki wynosi 358,37. Zakładając, Ŝe cena drukarki w całej populacji ma rozkład

normalny N(m, σ) na poziomie ufności 1-α = 0,95 wyznaczymy na podstawie 40 elementowej

próby przedział ufności dla średniej ceny drukarki przyjmując, Ŝe odchylenie standardowe populacji

jest równe 20.

Rozwiązanie.

Zastosujemy przedział ufności PU-1: <X-

σ uα

n

; X+

σ uα

n

> . PoniewaŜ 1-α = 0,95, czyli α = 0.05

α

α

= 0.025. Równanie do wyznaczenia uα ma postać Φ(u α )=1- = 0,975, stąd uα=1,96, więc błąd

2

2

σu

20 ⋅1,96

bezwzględny, czyli połowa długości przedziału ufności ε= α =

= 6,198.

n

40

Średnia arytmetyczna ceny jest równa x = 358,37.

i

Zatem szukanym przedziałem ufności jest przedział <358,37–6,2;358,37+6,2 = <352,17;364,57>

ε

6,2

Błąd względny δ= 100%=

100% = 1,55%.

x

358,37

σ uα

Długość połowy przedziału ufności równą ε =

zwraca funkcja UFNOŚĆ arkusza Excel na

n

podstawie odchylenia standardowego σ i liczebności próby.

Zwracamy uwagę, Ŝe otrzymany wynik jest identyczny jak obliczony powyŜej.

25

STATYSTYKA MATEMATYCZNA

Przykład 15.4

Dla danych z przykładu 15.3 obliczymy błędy bezwzględny i względny oszacowania parametru m

na poziomie ufności 1 - α = 0,99.

Rozwiązanie

α

Mamy Φ(u α )=1- = 0,995, stąd u α =2,576 , więc błąd bezwzględny, czyli połowa długości

2

σu

ε

8,15

20 ⋅ 2,576

przedziału ufności ε = α =

=8,15, błąd względny δ = =

=2,27% x 358,37

n

40

Widzimy, Ŝe powiększanie poziomu ufności (zaufania do otrzymanego oszacowania) powoduje

powiększenie obu błędów bezwzględnego i względnego. Dlatego w praktyce nie moŜna

przyjmować zbyt duŜych poziomów ufności, gdyŜ prowadzi to do duŜych błędów oszacowania

(przedziały ufności mają wtedy duŜą długość).

Niektórzy praktycy przyjmują, Ŝe oszacowanie jest:

• Bardzo dobre, gdy błąd względny jest równy najwyŜej 2%;

• Dobre, gdy błąd względny jest zawarty między 2% i 5%;

• Dostateczne, gdy błąd względny jest zawarty między 5% i 10%;

• Niedostateczne, gdy błąd względny jest większy od 10%.

Przykład 15.5

Na poziomie 0,95 obliczmy przedział ufności dla średniej ceny monitorów 17 calowych na

podstawie 12 elementowej próby: 733, 685, 761, 812, 708, 735, 639, 730, 703, 694, 714, 664

zakładając, Ŝe cena ma rozkład normalny.

Rozwiązanie

Stosujemy przedział ufności PU-2 <XObliczamy: x = 714,83 oraz s

Su α

Su α

; X+

>

n-1

n-1

1 10

2

∑ (x i − 714,83) =43,19

12 i =1

Liczba u α spełnia związek P(|Tn-1| ≥ u α )=α , który dla danych zadania przybiera postać

P(|T11| ≥ u α ) = 0,01. Z tablicy rozkładu Studenta dla 11 stopni swobody i poziomu prawdopodobieństwa 0,05 (pkt 6 części VII „Tablice statystyczne”) odczytujemy, Ŝe u α = 2,201, więc

Su α 43,19 ⋅ 2,201 95, 064

ε=

=

=

=28,66 .

Zatem

przedział

ufności

jest

równy

3, 317

n-1

11

< 8, 6 − 0, 23 ; 8, 6 + 0, 23 > = < 8, 37 ; 8, 63 >

ŝ u

45,11 ⋅ 2, 201 99, 287

Długość połowy przedziału ufności równą ε ' = α =

= 28,66 zwraca

=

3, 464

n

12

narzędzie Statystyka opisowa modułu Analiza danych pakietu Excel

Kolumna1

Średnia

Błąd standardowy

Mediana

Tryb

Odchylenie standardowe

Wariancja próbki

Poziom ufności (95,0%)

714,8333333

13,02261048

711

#N/D!

45,11164601

2035,060606

28,6625724

Zwraca się uwagę, Ŝe otrzymany wynik jest identyczny jak obliczony powyŜej.

26

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Przykład 15.6

Jako miarę dokładności przyrządu przyjęto odchylenie standardowe pomiarów dokonanych tym

przyrządem. Zakładamy, Ŝe pomiary pochodzą z populacji normalnej N(m,σ). Dokonano 20

pomiarów i otrzymano wariancję z próby 6,5. Na poziomie ufności 0,9 oszacuj przedziałem ufności

wariancję i odchylenie standardowe wszystkich moŜliwych pomiarów.

Rozwiązanie

Dane n = 20, s2 =6,5, 1- α = 0, 9, rozkład cechy populacji N(m, σ).

Stosujemy przedziały ufności PU-4 i PU-5

nS2 nS2

;

u1 u 2

nS2 nS2

;

u1

u2

,

Liczby u1 i u2 spełniają związki

P(Yn-1 ≥ u1 )=

α

2

P(Yn-1 ≥ u 2 )=1-

α

2

w których Yn-1 oznacza zmienną losową o rozkładzie χ2 z n-1 stopniami swobody.

0,1

=0,05

2

0,1

P(Y19 ≥ u 2 )=1=0,95

2

P(Y19 ≥ u1 )=

Z tablicy rozkładu χ2 (pkt 5 części VII „Tablice statystyczne”) odczytujemy, Ŝe u1 = 30,1 u2 = 10,1

Przedział ufności dla wariancji

20 ⋅ 6,5 20 ⋅ 6, 5

;

=< 4,3;12, 9 >

30,1

10,1

Przedział ufności dla odchylenia standardowego < 4, 3 ; 12, 9 > = < 2,1 ; 3, 6 > Przykład 15.7

Na 400 obrotów anteny radarowej obiekt znajdujący się w obszarze obserwacji radaru został

wykryty 350 razy. Literą p oznaczamy prawdopodobieństwo wykrycia obiektu przy jednym obrocie

anteny (niezawodność radaru). Znajdziemy przedział ufności dla p na poziomie ufności 0,95.

Rozwiązanie

Niech X będzie zmienną losową przyjmującą wartość 1, gdy w jednym obrocie anteny obiekt został

wykryty, zaś wartość 0, gdy nie został wykryty. Zmienna losowa X ma rozkład zerojedynkowy z

parametrem p. Prawdopodobieństwo p oszacujemy przedziałem ufności PU-6

W-u α

W(1-W)

W(1-W)

; W+u α

n

n

gdzie w jest wskaźnikiem struktury w próbie (oszacowaniem wskaźnika struktury p w populacji)

k

w = , k - liczba jedynek w próbie.

n

Dla danych w zadaniu mamy

w=

k 350

=

= 0,875 = 87,5%

n 400

27

STATYSTYKA MATEMATYCZNA

α

0,05

Φ(u α )=1- =1=0,975 ⇒ u α =1,96

2

2

w(1-w)

0,875 ⋅ 0,125

ε = uα

=1,96

=3,2%

n

400

<87,5%-3,2% ; 87,5%+3,2%>= <84,2% ; 90,7%>

Odp. Niezawodność radaru z ufnością 0,95 jest zawarta między 84,2% a 90,7%. 15.3.4. Wyznaczanie wielkości próby

Zagadnienie

Wyznaczyć liczebność próby n tak by błąd bezwzględny oszacowania parametru przedziałem

ufności wynosił ε , przy poziomie ufności 1 - α .

Zasady wyznaczania wielkości próby podano w poniŜej tabeli.

Tabela 15.4. Wyznaczanie liczebności próby n przy poziomie ufności 1 - α

ZałoŜenia

Cecha X ma

rozkład

normalny

N(m, σ), σ jest

znana16

Cecha X ma

rozkład

normalny

N(m, σ), σ nie

jest znana

Etapy wyznaczania liczebności próby

1) Wyznaczamy liczbę uα : Φ(u α )=1 σu

2) Obliczamy n = α

ε

α

2

2

Nr

LP-1

1) Pobieramy próbę o małej liczebności n0 (wstępną próbę) i szacujemy

odchylenie standardowe σ za pomocą odchylenia standardowego s0

z tej próby

2

s u

2) Obliczamy n = 0 α + 1

ε

LP-2

Rozkład cechy 3) Jeśli n-n0 > 0, to naleŜy powiększyć próbę o n-n0 elementów.

X nie jest znany. Jeśli

Próba jest liczna n – n0 ≤ 0, to poprzestajemy na pobraniu wstępnej próby.

Cecha X ma

rozkład

zerojedynkowy.

Próba jest

liczna.

Dokładność

oszacowania

dokładnością ε

17

1) Wyznaczamy liczbę uα : Φ(u α )=1-

α

2

u α2

k gdzie

ε2

w − oszacowanie wskaźnika na podstawie wstępnej próby,

w(1 − w) w ≤ 0,5

k = 0, 25

nie mamy Ŝadnych informacji o w

0, 21

jesli wiemy, Ŝe wadliwość nie moŜe przekroczyć 30%

2) Obliczamy n =

Uwaga: Przy obliczaniu n zawsze przyjmujemy zaokrąglenie w górę

16

17

Patrz przedział ufności PU-1

Patrz przedział ufności PU-6

28

LP-3

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

Przykład 15.8

W doświadczeniu chemicznym bada się czas trwania reakcji chemicznej. Czas ten modelujemy

zmienną losową X o rozkładzie normalnym N(m, 5 sek).

Ile razy naleŜy powtórzyć to doświadczenie, by oszacować przedziałem ufności średni czas m

trwania tej reakcji na poziomie ufności 0,95 tak, by błąd bezwzględny wynosił 2 s?

Rozwiązanie

Korzystamy z zasady LP-1 podanej w tabeli 15.3

σ uα

n =

ε

2

Φ (u α ) = 1 −

α

0, 05

= 1−

= 0,975 ⇒ uα=1,96,

2

2

2

1,96 ⋅ 5

n=

≈ 24

2

Odp. NaleŜy doświadczenie powtórzyć 24 razy. Przykład 15.9

Cecha X populacji ma rozkład normalny o nieznanych parametrach. W celu oszacowania wartości

oczekiwanej przedziałem ufności o długości 1, na poziomie ufności 0,96, pobrano wstępną

5- elementową próbę i otrzymano odchylenie standardowe s0=0,8. Jak wielką próbę naleŜy pobrać?

Rozwiązanie

Korzystamy z zasady LP-2 podanej w tabeli 15.3

Φ (u α ) = 1 −

α

0, 04

= 1−

= 0,98 ⇒ u α = 2, 05

2

2

2

2

0,8 ⋅ 2, 05

s u

n = 0 α +1=

+ 1 ≈ 12

ε

0,5

Odp. NaleŜy pobrać próbę 12 elementową, czyli naleŜy dobrać jeszcze 7 elementów. Przykład 15.10

Cecha X populacji ma rozkład normalny N(m, σ), σ nie jest znana. Jak wielką próbę naleŜy pobrać,

by na poziomie ufności 0, 98 oszacować wartość oczekiwaną m z błędem, co najwyŜej równym 0,5,

gdy na podstawie wstępnej próby 50 elementowej otrzymano odchylenie standardowe 3,0?

Rozwiązanie

Korzystamy z zasady LP-2 podanej w tabeli 15.3

1 – α = 0, 98 ε = 0,5 n 0 = 50 s0 = 3, 0

α

0, 04

Φ (u α ) = 1 − = 1 −

= 0, 98 ⇒ uα = 2,05

2

2

2

2

3, 0 ⋅ 2, 05

s u

n = 0 α +1 =

+ 1 ≈ 153

ε

0,5

Odp. NaleŜy wziąć próbę 153 elementową, naleŜy więc jeszcze dobrać 103 elementy. 29

STATYSTYKA MATEMATYCZNA

Przykład 15.11

Mamy oszacować przedziałem ufności wadliwość p partii towaru na poziomie ufności

1- α = 0,96, z dokładnością ε = 0,05. Jak wielka powinna być próba?

Rozwiązanie

α

0,04

Φ(u α )=1- =1=0,98 ⇒ uα = 2,05

2

2

w(1-w)

n = u α2

ε2

Jeśli nie mamy Ŝadnych informacji o wadliwości w, to w miejsce iloczynu w(1-w) podstawiamy ¼

(największą wartość iloczynu).

1/4

≈ 421

0,052

Jeśli natomiast wiemy, Ŝe wadliwość nie moŜe przekroczyć 30%, to iloczyn w (1-w) nie moŜe

0,21

przekroczyć liczby 0,3 ⋅ 0,7 = 0,21, zatem n=2,052

≈ 353 0,052

n = 2,052

15.3.5. Wykorzystanie arkusza Excel

Lp

Zakres analizy statystycznej

1.

Estymacja długości połowy przedziału

ufności dla wartości oczekiwanej przy

znanej wariancji

2.

Estymacja długości połowy przedziału

ufności dla wartości oczekiwanej przy

nieznanej wariancji

Funkcje

statystyczne

Narzędzia statystyczne

UFNOŚĆ

STATYSTYKA

OPISOWA

30

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

16. WERYFIKACJA HIPOTEZ

16.1 Wprowadzenie

16.1.1. Uwagi wstępne

Teoria weryfikacji hipotez zajmuje się metodami sprawdzania hipotez statystycznych.

Hipoteza statystyczna to kaŜde przypuszczenie dotyczące nieznanego rozkładu badanej cechy

(cech). Hipoteza dotycząca jedynie wartości parametrów cechy nazywa się hipotezą parametryczną,

natomiast hipoteza precyzująca, do jakiego typu rozkładów naleŜy rozkład cechy populacji, nosi

nazwę hipotezy nieparametrycznej.

Przykład 16.1

Wiemy, Ŝe cecha X populacji ma rozkład N(m, 3). Przypuszczenie, Ŝe „wartość oczekiwana cechy

X jest równa 5” jest hipotezą parametryczną.

ZałóŜmy teraz, Ŝe nie mamy Ŝadnej informacji o rozkładzie cechy X populacji. Przypuszczenie

„rozkład cechy X jest normalny” jest hipotezą nieparametryczną. Test statystyczny jest to metoda weryfikacji (sprawdzania) hipotez statystycznych, przy czym

•

Test parametryczny jest to test do weryfikacji hipotez parametrycznych.

•

Test nieparametryczny jest to test do weryfikacji hipotez nieparametrycznych.

Zajmiemy się najpierw hipotezami i testami parametrycznymi dla jednej i dwóch prób.

Rozpatrzmy cechę X populacji, o rozkładzie zaleŜnym od parametru Q ∈ Ω, gdzie Ω jest

podzbiorem zbioru liczb rzeczywistych, zwanym przestrzenią parametru.

O parametrze Q wysuwamy dwie hipotezy:

• Hipotezę zerową, (główną, sprawdzaną), Ŝe parametr Q ma wartość równą Q0∈ Ω, co

zapisujemy H0 (Q = Q0) i czytamy: hipoteza H zero, Ŝe parametr Q jest równy Q zero.

• Hipotezę alternatywną, Ŝe parametr Q przyjmuje dowolną wartość z przestrzeni parametru róŜną

od Q0, co zapisujemy H1 ( Q∈ Ω- Q0)

W zagadnieniach tu rozwaŜanych hipoteza alternatywna będzie miała jedną z czterech poniŜszych

postaci

H1 (Q ≠ Q0), H1 (Q > Q0), H1 (Q < Q0), H1 (Q = Q1).

(16.1)

Przy weryfikacji hipotez podejmujemy jedną z dwu decyzji

• Odrzucić hipotezę zerową i przyjąć alternatywną.

• Przyjąć hipotezę zerową i odrzucić alternatywną.

PoniewaŜ decyzje przy weryfikacji hipotez podejmujemy na podstawie próby, więc decyzja moŜe

być błędna mimo iŜ test został wykonany poprawnie.

Hipoteza zerowa odzwierciedla z reguły pytanie, na które naleŜy uzyskać odpowiedź. Występują

równieŜ przypadki, Ŝe taką rolę spełnia hipoteza alternatywna, ale łatwiej jest weryfikować hipotezę

zerową. Hipotezę alternatywną ustala się na podstawie przesłanek, jakimi dysponuje się przed

pobraniem próby, tzn. postać hipotezy alternatywnej określona jest wiedzą o problemie badawczym

nie opierającą się o wnioski z analizy prób. Tak więc hipoteza alternatywna wyraŜa skrystalizowane

a priori przypuszczenie o treści róŜnej od treści hipotezy sprawdzanej.

Opis testu parametrycznego

X - cecha populacji, Q – parametr rozkładu cechy X.

Wysuwamy hipotezy: zerową H0 (Q = Q0) i alternatywną H1, która ma jedną z postaci (16.1).

31

STATYSTYKA MATEMATYCZNA

Postępowanie przy weryfikacji powyŜszych hipotez jest następujące

1. Wybieramy pewną statystykę U n o rozkładzie zaleŜnym od parametru Q oraz pewną liczbę α z

przedziału (0,1) i wyznaczamy podzbiór K zbioru liczb rzeczywistych tak by spełniony był

warunek

P(U n ∈ K/Q=Q0 ) = α

(16.2)

czyli by prawdopodobieństwo, iŜ statystyka Un przyjmie wartość ze zbioru K, przy załoŜeniu, Ŝe

prawdziwa jest hipoteza zerowa było równe α.

2. Pobieramy próbę18 i obliczamy wartość un statystyki Un

3. Podejmujemy decyzje

odrzucamy H0 , gdy un∈K

przyjmujemy H0, gdy u n ∉ K

(16.3)

(16.4)

Wykorzystywaną statystykę Un nazywamy sprawdzianem, zbiór K – zbiorem krytycznym,

a liczbę α poziomem istotności.

Przy weryfikacji hipotez przyjmuje się mały poziom istotności (bliski 0, ale dodatni).

Uzasadnienie podejmowanych decyzji:

• Decyzja (16.3): Jeśli hipoteza H0 (Q = Q0) jest prawdziwa, to prawdopodobieństwo zdarzenia

Un∈K jest zgodnie z (16.2) równe α, a więc tak małe, Ŝe uwaŜamy, iŜ zajście tego zdarzenia jest

w praktyce niemoŜliwe. PoniewaŜ jednak to zdarzenie dla pobranej próby zaszło, więc

wnioskujmy, Ŝe załoŜenie, przy którym prawdopodobieństwo tego zdarzenia zostało obliczone

jest nieprawdziwe. Stąd teŜ odrzucamy H0.

• Decyzja (16.4): Jeśli zdarzenie Un∈K, przy załoŜeniu, Ŝe hipoteza H0 (Q = Q0) jest prawdziwa,

nie zaszło, to nie ma powodu, by twierdzić, Ŝe H0 nie jest prawdziwa, bowiem nie ma nic

nadzwyczajnego w fakcie, Ŝe nie zaszło zdarzenie o małym prawdopodobieństwie. Dlatego

hipotezę H0 przyjmujemy lub ostroŜniej: mówimy, Ŝe nie ma podstaw do odrzucenia tej

hipotezy.

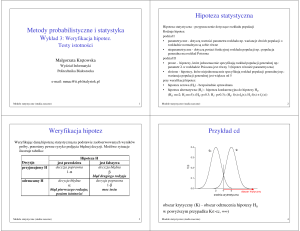

Przy podejmowaniu decyzji moŜna zawsze popełnić jeden z dwu błędów

• Błąd I rodzaju - błąd polegający na odrzuceniu hipotezy zerowej H0, gdy ta hipoteza jest

prawdziwa. Odrzucenie H0, gdy jest ona prawdziwa moŜna jako zdarzenie losowe zapisać

Un∈K/Q=Q0. Prawdopodobieństwo tego zdarzenia, zgodnie ze wzorem (16.2) jest równe

poziomowi istotności α, zatem prawdopodobieństwo błędu I rodzaju P(U n ∈ K/Q = Q 0 )=α .

• Błąd II rodzaju - błąd polegający na przyjęciu hipotezy zerowej H0, gdy ta hipoteza jest

fałszywa. Przypuśćmy, Ŝe hipoteza alternatywna jest postaci H1(Q = Q1). Wtedy błąd II rodzaju:

przyjęcie H0, gdy ta hipoteza jest fałszywa, jako zdarzenie losowe moŜna zapisać U n ∉ K/Q=Q1 ,

a prawdopodobieństwo tego zdarzenia oznaczmy β, zatem prawdopodobieństwo błędu II

rodzaju P(U n ∉ K/Q=Q1 )=β .

Jak widzimy prawdopodobieństwo błędu I rodzaju jest równe poziomowi istotności α, a więc jest

znane na podstawie metody weryfikacji, natomiast prawdopodobieństwo błędu II rodzaju wymaga

obliczenia, co wcale nie musi być łatwe, dlatego często rezygnujemy z jego wyznaczania.

18

WyróŜnia się dwa rodzaje prób: niepowiązane i powiązane. JeŜeli wartości określonej cechy mierzone są u róŜnych

elementów to otrzymywane próby nazywamy niepowiązanymi. Z kolei jeŜeli wartości cechy mierzone sa u tych

samych elementów np. w róŜnych momentach czasu to otrzymywane próby nazywamy powiązanymi.

32

PODSTAWY PROBABILISTYKI Z PRZYKŁADAMI ZASTOSOWAŃ W INFORMATYCE

W zaleŜności od postaci hipotezy alternatywnej przyjmuje się róŜną postać zbioru krytycznego.

I tak:

Zbiór krytyczny prawostronny jest to

zbiór postaci K =< k 2 ; ∞) . Wzór (16.2)

przybiera teraz postać

P(U n ≥ k 2 /Q=Q 0 )=α

Rys. 16.1. Prawostronny zbiór krytyczny

Zbiór krytyczny lewostronny jest to

zbiór postaci K = ( −∞; k1 > . Wzór

(16.2) przybiera teraz postać

P(U n ≤ k1 /Q=Q 0 )=α

Jeśli gęstość statystyki Un / Q=Q0 ma

wykres symetryczny względem osi Oy

(rozkład normalny, rozkład Studenta), to

zbiór krytyczny lewostronny moŜna

zapisać w postaci K = ( −∞;−k > . Wzór

(16.2) przybiera teraz postać

P( U n ≥ k | Q = Q 0 ) = α identyczną jak

dla zbioru krytycznego prawostronnego.

Rys. 16.2. Lewostronny zbiór krytyczny

Zbiór krytyczny dwustronny jest to zbiór

postaci K = (−∞; k1 > ∪ < k 2 ; ∞) . Zbiór

ten w przypadku symetrycznego

względem osi Oy rozkładu statystyki

Un / Q=Q0 przyjmuje postać

K=(-∞;-k>∪<k;∞)

W pierwszym przypadku liczby k1 i k2

wyznaczamy z relacji

Rys. 16.3. Dwustronny zbiór krytyczny

P(U n ≤ k1 /Q=Q0 )=α/2

P(U n ≥ k 2 /Q = Q0 )=α/2

W drugim przypadku liczba k spełnia

relację P(|U n | ≥ k)=α

Zbiór krytyczny naleŜy wybrać tak, by przy ustalonym prawdopodobieństwie

(poziomie istotności), prawdopodobieństwo błędu II rodzaju było najmniejsze.

• Jeśli hipoteza alternatywna ma postać H1 (Q > Q0), to przyjmujemy

prawostronny.

• Jeśli hipoteza alternatywna ma postać H1 (Q < Q0), to przyjmujemy

lewostronny.

• Jeśli hipoteza alternatywna ma postać H1 (Q ≠ Q0), to przyjmujemy

dwustronny.

33

błędu I rodzaju

zbiór krytyczny

zbiór krytyczny

zbiór krytyczny

STATYSTYKA MATEMATYCZNA

16.1.2. Pzykład konstrukcji testu parametrycznego do weryfikacji hipotezy o wartości

oczekiwanej

Badana jest cecha X populacji generalnej ma rozkład normalny N(m,σ), przy czym σ jest znane.

O wartości oczekiwanej wysuwamy hipotezy:

• zerową H0 (m=m0)

• alternatywną H1 (m>m0)

a)

ZałóŜmy, Ŝe hipoteza zerowa jest prawdziwa i Ŝe przyjęto hipotezę alternatywną postaci

H1 (m>m0). Hipotezy weryfikujemy na podstawie o próbę (x1 , x 2 ,..., x n1 ) przy poziomie

istotności α. Wtedy róŜnica X n − m 0 obliczona na podstawie próby powinna przyjąć wartość

bliską zeru, bowiem statystyka X n jest estymatorem najefektywniejszym parametru m.

Natomiast, gdy róŜnica ta jest duŜa (ze względu na kształt hipotezy alternatywnej powinna być

dodatnia), to moŜna sądzić, Ŝe hipoteza zerowa jest fałszywa.

Wygodniej jest posługiwać się postacią standaryzowaną statystyki X n − m 0 , czyli statystyką

Un =

Xn − m0

σ/ n

Statystyka Un/m = m0 ma rozkład normalny N(0,1). Mała wartość tej statystyki przemawia za

przyjęciem hipotezy zerowej, natomiast duŜa wartość za przyjęciem hipotezy alternatywnej.

Dlatego zbiór krytyczny przyjmujemy prawostronny (potwierdza się zasada wyboru zbioru

krytycznego K = <k ; ∞)) na danym poziomie istotności α. Liczba k spełnia związek

P(Un ≥ k/m = m0). Stąd 1 − Φ ( k ) = α , czyli Φ(k)=1-α . Liczba k jest liczbą graniczną w tym

sensie, Ŝe przyjmujemy, iŜ wartości un statystyki Un, obliczone na podstawie próby są duŜe,

gdy un ≥ k, natomiast są małe w przeciwnym przypadku. Zatem

Jeśli un ≥ k, czyli u n ∈ K , to H0 odrzucamy i przyjmujemy H1

Jeśli un < k, czyli u n ∉ K , to H0 przyjmujmy i odrzucamy H1

b)

ZałóŜmy teraz, Ŝe hipoteza alternatywna ma postać H1 (m< m0). TakŜe w tym przypadku mała

wartość statystyki Un przemawia za przyjęciem hipotezy zerowej, natomiast duŜa wartość

bezwzględna, ale ujemna za przyjęciem hipotezy alternatywnej. Dlatego zbiór krytyczny

przyjmujemy lewostronny K = (-∞ ; -k> na danym poziomie istotności α. Liczba k spełnia

związek P(Un ≤ -k/m = m 0 )=α . Stąd Φ(-k) = α ⇒ 1-Φ(k) = α , czyli Φ(k)=1-α .

c)

ZałóŜmy wreszcie, Ŝe hipoteza alternatywna ma postać H1 (m≠m0). W tym jak

i w poprzednich przypadkach mała wartość statystyki Un przemawia za przyjęciem hipotezy

zerowej, natomiast wartości o duŜym module (dodatnie lub ujemne) za przyjęciem hipotezy

alternatywnej. Dlatego zbiór krytyczny przyjmujemy dwustronny K=(-∞; -k> ∪ < k;∞) na

danym poziomie istotności α. Liczba k spełnia związek

α

P( U n ≥ k/m=m 0 ) = α . Stąd 2 [1-Φ(k)] = α , czyli Φ(k)=12

Przykład 16.2

Czas wykonania detalu modelowany jest zmienną losową o rozkładzie normalnym

N(m, 2 min.). W celu weryfikacji hipotez: zerowej, Ŝe średni czas wykonania detalu wynosi

3 min i alternatywnej, Ŝe wynosi 4,6 min., pobrano próbę 9 elementową, której średnia wyniosła 3,4