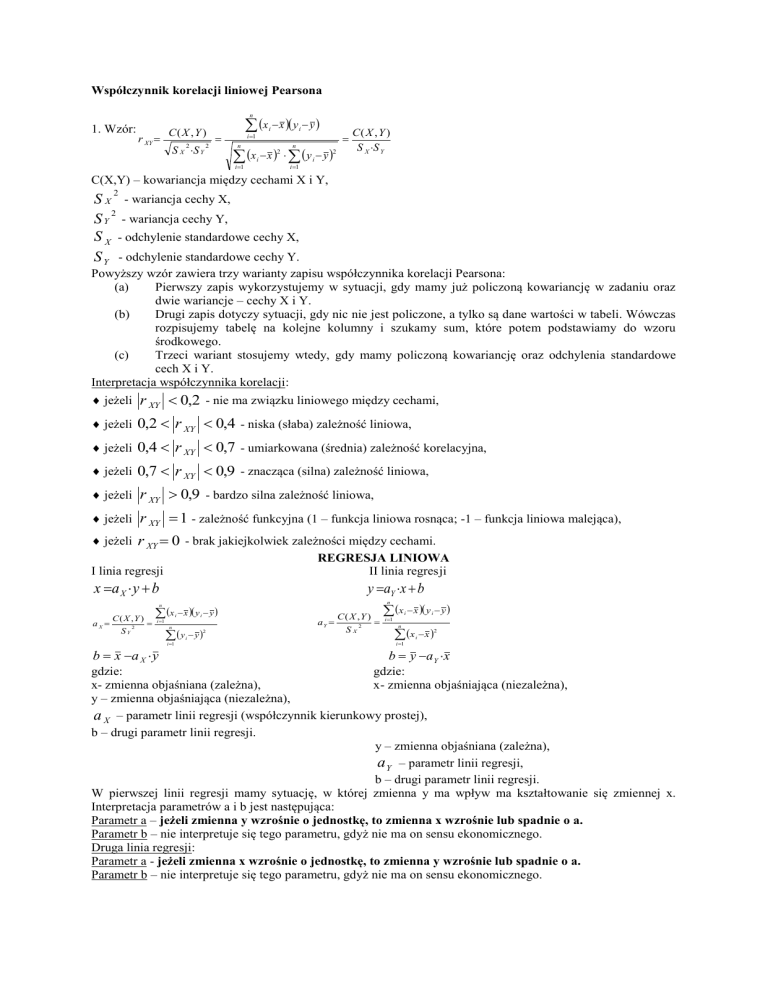

Współczynnik korelacji liniowej Pearsona

n

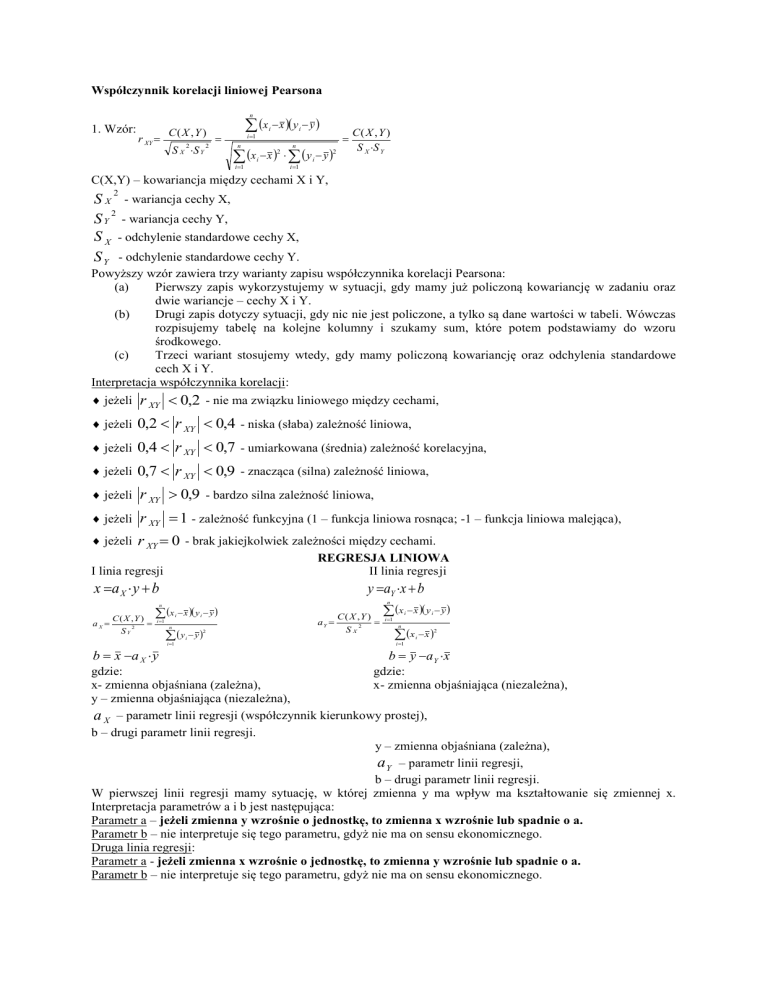

1. Wzór:

r XY

C( X , Y )

S X S Y

2

2

x x y y

i

i 1

n

i

n

x x y y

i 1

2

i

i 1

2

C( X , Y )

S X S Y

i

C(X,Y) – kowariancja między cechami X i Y,

2

S X - wariancja cechy X,

2

S Y - wariancja cechy Y,

S X - odchylenie standardowe cechy X,

S Y - odchylenie standardowe cechy Y.

Powyższy wzór zawiera trzy warianty zapisu współczynnika korelacji Pearsona:

(a)

Pierwszy zapis wykorzystujemy w sytuacji, gdy mamy już policzoną kowariancję w zadaniu oraz

dwie wariancje – cechy X i Y.

(b)

Drugi zapis dotyczy sytuacji, gdy nic nie jest policzone, a tylko są dane wartości w tabeli. Wówczas

rozpisujemy tabelę na kolejne kolumny i szukamy sum, które potem podstawiamy do wzoru

środkowego.

(c)

Trzeci wariant stosujemy wtedy, gdy mamy policzoną kowariancję oraz odchylenia standardowe

cech X i Y.

Interpretacja współczynnika korelacji:

jeżeli

r XY 0,2 - nie ma związku liniowego między cechami,

jeżeli

0,2 r XY 0,4 - niska (słaba) zależność liniowa,

jeżeli

0,4 r XY 0,7 - umiarkowana (średnia) zależność korelacyjna,

jeżeli

0,7 r XY 0,9 - znacząca (silna) zależność liniowa,

jeżeli

r XY 0,9 - bardzo silna zależność liniowa,

jeżeli

r XY 1 - zależność funkcyjna (1 – funkcja liniowa rosnąca; -1 – funkcja liniowa malejąca),

jeżeli

r XY 0 - brak jakiejkolwiek zależności między cechami.

REGRESJA LINIOWA

II linia regresji

I linia regresji

x a X y b

y aY x b

n

n

aX

C( X ,Y )

2

SY

x x y y

i

i 1

n

y y

i 1

b x a X y

i

2

i

aY

C ( X ,Y )

2

SX

x x y y

i

i 1

i

n

x x

i 1

2

i

b y aY x

gdzie:

x- zmienna objaśniająca (niezależna),

gdzie:

x- zmienna objaśniana (zależna),

y – zmienna objaśniająca (niezależna),

a X – parametr linii regresji (współczynnik kierunkowy prostej),

b – drugi parametr linii regresji.

y – zmienna objaśniana (zależna),

a Y – parametr linii regresji,

b – drugi parametr linii regresji.

W pierwszej linii regresji mamy sytuację, w której zmienna y ma wpływ ma kształtowanie się zmiennej x.

Interpretacja parametrów a i b jest następująca:

Parametr a – jeżeli zmienna y wzrośnie o jednostkę, to zmienna x wzrośnie lub spadnie o a.

Parametr b – nie interpretuje się tego parametru, gdyż nie ma on sensu ekonomicznego.

Druga linia regresji:

Parametr a - jeżeli zmienna x wzrośnie o jednostkę, to zmienna y wzrośnie lub spadnie o a.

Parametr b – nie interpretuje się tego parametru, gdyż nie ma on sensu ekonomicznego.

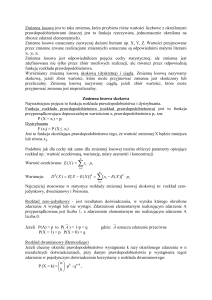

wyznaczymy dwie linie regresji, a konkretnie dwa współczynniki regresji

możemy obliczyć współczynnik korelacji Pearsona, według wzoru:

a X oraz a Y , wówczas

r XY a X a Y

współczynnik determinacji R r XY

Im bliżej 1, tym lepsze dopasowanie modelu do rzeczywistości.

2

2

X

xi x

Y

Model trendu liniowego:

(xi x)2

yi y

( y i y ) 2 ( x i x )( y i y )

y a t b

y – zmienna objaśniana (zależna),

t – zmienna czasowa (objaśniająca, niezależna),

a, b – parametry linii trendu.

Model trendu liniowego jest szczególnym przypadkiem regresji liniowej, gdzie jedyną zmienną

objaśniającą jest czas.

n

a

t t y

t 1

n

b y a t

t

t t

2

t 1

Interpretacja parametru a: jeżeli okres rośnie o jednostkę, to y rośnie lub maleje średnio o a.

Interpretacja parametru b: w okresie poprzedzającym pierwszy badany (t=0) wartość y wynosiła b.

Zużycie energii

t

yt

t t

(t t ) 2

(t t ) y t

ANALIZA DYNAMIKI – INDEKSY PROSTE

Indeksy dynamiki określa się następująco:

yn

y

lub i n 100%

y0

y0

i

gdzie :

y n - poziom zjawiska w pewnym okresie,

y 0 - poziom zjawiska w okresie odniesienia.

yn

100% 100% ,

y0

mówi o ile procent poziom zjawiska w okresie n-tym jest wyższy lub niższy niż w okresie 0-owym.

Indeksy jednopodstawowe informują, jakie zmiany nastąpiły w poziomie zjawiska

w kolejnych okresach w

stosunku do okresu przyjętego jako podstawa (bazowego).

y

y1 y 2 y 3

, , ,..., n

y0 y0 y0

y0

Indeksy łańcuchowe (o podstawie zmiennej) informują, jakie zmiany nastąpiły w poziomie zjawiska w

kolejnym okresie w stosunku do okresu go poprzedzającego.

y

y2 y3 y4

, , ,..., n

y1 y 2 y 3

y n1

Średniookresowe tempo zmian w czasie określa średniookresowy wzrost lub spadek badanego zjawiska,

przypadający na analizowaną jednostkę czasu:

T (i G 1) 100%

T - średniookresowe tempo zmian w czasie,

i G - średniookresowy indeks łańcuchowy.

na podstawie wartości analizowanego zjawiska dla pierwszego i ostatniego okresu:

yn

y1

i G n1

na podstawie indeksów łańcuchowych:

i G

n 1

i 2 1 i 3 2 ... i n n 1

► korzystając z indeksów o podstawie stałej dla pierwszego i ostatniego okresu mamy:

i G

n 1

in 1

i1 1

ROZKŁADY ZMIENNYCH LOSOWYCH SKOKOWYCH

Dystrybuanta zmiennej losowej X jest to następująca funkcja:

F(x)=P(X<x)

Własności dystrybuanty:

(a)

0 F ( x) 1

(b) F(x) jest funkcją niemalejącą

(c)

lim F ( x) 0

oraz

x

lim F ( x) 1

x

Parametry zmiennej losowej skokowej:

1. Wartość oczekiwana (przeciętna): E ( X )

n

x

i 1

xi

i

pi

wartości zmiennej losowej skokowej,

p i prawdopodobieństwa odpowiadające określonym wartościom zmiennej losowej.

n

Przy czym:

p

i 1

i

1

2. Wariancja: V ( X )

n

x E ( X )

i 1

i

3. Odchylenie standardowe:

2

pi

V (X )

Czyli odchylenie standardowe jest pierwiastkiem z wariancji.

Liczba

usterek

Prawdopodobieństwa

xi

pi

xi pi

x i E (X )

( x i E ( X )) 2

Rozkład zero-jedynkowy:

Zmienna losowa X ma rozkład zero-jedynkowy, jeśli przyjmuje wartość 0 lub 1:

P(X=1)=p

P(X=0)=q

Gdzie: p+q=1

p- prawdopodobieństwo sukcesu,

q- prawdopodobieństwo porażki.

Dystrybuanta zmiennej losowej o rozkładzie zero-jedynkowym jest następująca:

( x i E ( X )) 2 p i

x0

0 dla

F ( x) q dla 0 x 1

1 dla

x 1

Rozkład dwumianowy:

n

P( X k ) p k q n k

k

n – liczba prób (doświadczeń),

k – liczba sukcesów w n próbach,

p – prawdopodobieństwo sukcesu w pojedynczym doświadczeniu,

q – prawdopodobieństwo porażki w pojedynczym doświadczeniu,

przy czym:

p+q=1

P(X=k) – prawdopodobieństwo, że zmienna losowa X osiągnie sukces k,

n

n

C nk

k n k

k

Są to kombinacje k-elementowe z n-elementów.

Definicja silni:

n = 123...n

0 = 1

Rozkład Poissona:

Rozkład ten jest szczególnym przypadkiem rozkładu dwumianowego, przy czym:

- prawdopodobieństwo sukcesu musi być małe, tzn. p<0,02,

- liczba doświadczeń musi być duża, tzn. n >20.

Aby znaleźć odpowiednie prawdopodobieństwo P(X=k) korzystamy z tablic rozkładu Poissona.

n p

Określamy także wartość oczekiwaną

Schemat szukania prawdopodobieństw:

P( X k ) P( X k ) P( X k 1)

(a)

(b)

P( X k ) 1 P( X k )

(c)

P( X k ) 1 P( X k 1)

Pierwsza kolumna jest podzielona na dwie części:

k – oznacza liczbę sukcesów (od 0 do 15),

ROZKŁADY ZMIENNYCH LOSOWYCH CIĄGŁYCH

Rozkład normalny:

Np. waga, wzrost, wynagrodzenia, wiek.

Zmienna losowa X ma rozkład normalny z wartością oczekiwaną (średnią) równą m i odchyleniem

standardowym równym σ :

X : N (m, )

W celu obliczenia prawdopodobieństwa P(a < X b) należy skorzystać z operacji nazywanej standaryzacją.

Jeśli zmienna losowa X ma rozkład N ( m, ) to zmienna standaryzowana T X m ma rozkład N(0,1). Na

tej podstawie można wyznaczyć:

bm

am

bm

a m

P ( a X b ) P

T

TWIERDZENIA GRANICZNE

Twierdzenie Moivre’a – Laplace’a:

Niech X n będzie ciągiem zmiennych losowych o rozkładzie dwumianowym. Wtedy:

m E X n n p

n- liczba doświadczeń,

p – prawdopodobieństwo sukcesu,

q – prawdopodobieństwo porażki,

m – wartość oczekiwana (średnia),

oraz

V X V X n n p q

V(X) – wariancja.

Jeżeli liczba doświadczeń będzie większa od 30, czyli n>30, wówczas rozkład dwumianowy można przybliżyć

rozkładem normalnym, na mocy twierdzenia Moivre’a – Laplace’a:

X : N n p, n p q

np=m – wartość oczekiwana,

npq - odchylenie standardowe.

Twierdzenie Lindeberga – Levy’ego (centralne twierdzenie graniczne):

Wartość oczekiwana:

Wariancja:

E Z n n m

V Z n n 2

Odchylenie standardowe:

V Z n n 2 n

Nowa zmienna losowa ma w przybliżeniu rozkład normalny o parametrach:

Z n~ N n m; n

Twierdzenie to mówi, że jeśli n jest duże, to rozkład zmiennej losowej Zn można przybliżać rozkładem

normalnym z wartością oczekiwaną n m i odchyleniem standardowym

Wniosek z centralnego twierdzenia granicznego:

Mamy ciąg niezależnych zmiennych losowych o jednakowym rozkładzie:

n.

X 1, X 2, X 3,... X n

Obliczamy nową zmienną losową równą średniej arytmetycznej tych zmiennych:

X

1

X 1 X 2 X 3... X n

n

Wobec tego:

E X

1

mn m

n

1

2

V X 2 n 2

n

n

V X

2

n

n

czyli: wartość oczekiwana wynosi m, a odchylenie standardowe wynosi

.

n

Nowa zmienna losowa równa średniej arytmetycznej wszystkich zmiennych ma w przybliżeniu rozkład

normalny z wartością oczekiwaną m i odchyleniem standardowym

:

n

X ~ N m;

n

1 zwanym poziomem ufności lub współczynnikiem ufności, pokrywa nieznaną wartość szacowanego

parametru. to poziom istotności

Jeżeli mamy dużą próbę (n>30) oraz cecha X ma rozkład normalny X ~ N(m, ) , wówczas przedział ufności

dla parametru m ma postać:

x t

x - średnia arytmetyczna,

- odchylenie standardowe, założenie (

n- liczebność próby,

m – wartość oczekiwana (przeciętna),

n

m x t

n

S)

t - wartość krytyczna odczytana z tablic rozkładu normalnego, gdzie: t

1

2

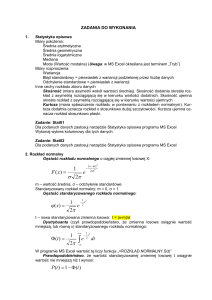

xi

ni

x i

x i n i

x i x

( x i x ) 2 ( x i x ) 2 n i

Najpierw obliczamy średnią arytmetyczną dla szeregu rozdzielczego przedziałowego:

x

1

x i n i

n

Następnie obliczamy wariancję S2:

1

x i x 2 n i

n

1

2

S pierwiastek

2225 z wariancji:

22,25

Teraz obliczamy odchylenie standardowe, czyli

100

2

S S S222,25 22,25 4,72

S2

S 4,72 odczytujemy wartość

Następnie z tablic rozkładu normalnego

t , przy czym t 1 0,98 0,49

2

Podstawiamy wszystko do wzoru:

x t

n

m x t

2

n

Hipoteza zerowa H0 – hipoteza sprawdzana 4

(testowana,

weryfikowana).

,72

4,72

2,35

można przyjąć,

m gdy

12zostanie

2,35odrzucona

Hipoteza alternatywna H1 – 12

hipoteza,

którą

hipoteza zerowa H0.

100

100

Jeżeli jest znane i n 30 lub znane i n>30 lub nieznane i n>30 (wtedy S ), wtedy

10,jest

91 statystyka:

m 13o,rozkładzie

09

sprawdzianem hipotezy zerowej

normalnym N(0,1)

T

x m

n