Jak działa mózg?

Uwagi dla modelarzy.

Włodzisław Duch

Katedra Informatyki Stosowanej

Uniwersytet Mikołaja Kopernika, Toruń, PL

Google: Duch

XXIV Szkoła Zimowa IF PAN, luty 2007

1

Czym się zajmujemy 1

1. Rozwojem teorii i zastosowań metod inteligencji obliczeniowej (np.

sieci neuronowe, logika rozmyta), uczeniem maszynowym, selekcją

informacji, systemami do dogłębnej analizy danych (data mining) oraz

rozumienia danych (reguły logiczne, wizualizacja).

Zastosowaniami do analizy kwestionariuszy (np. psychometrycznych) i

wspomagania diagnostyki medycznej.

Ghostminer, nasz system programów data mining (sprzedawany przez

Fujitsu) używany jest do analizy danych w kilku szpitalach klinicznych

w USA i w firmach bioinformatycznych.

Obecnie pracujemy w KIS nad całkiem nowym systemem.

Na zjeździe firmy Bayern Diagnostics prowadziliśmy warsztaty na temat

zastosowania sieci neuronowych w diagnostyce medycznej;

zainteresowanie głównie analizami hematologicznymi.

2. Bioinformatyką, genomiką i modelowaniem komputerowym w

medycynie molekularnej – dr hab J. Meller w Cincinnati Children’s

Hospital Research Foundation.

2

Czym się zajmujemy 2

3. Informatyką i robotyką neurokognitywną.

Funkcjonalnymi modelami neuronowymi funkcji mózgu: pamięci,

uwagi, wyższych czynności poznawczych, procesami twórczymi.

NTU Singapur + dwa złożone projekty EU, koordynowane przez KCL.

4. Rozwój i stymulacja zdolności poznawczych u niemowląt, patent

„Układ aktywnego stymulatora ośrodków mowy, zwłaszcza niemowląt i

dzieci”, projekt inteligentnej kołyski i zabawek kognitywnych.

5. Analizą języka naturalnego.

Wykorzystnie inspiracji neurokognitywnych (pamięć rozpoznawcza,

semantyczna, epizodyczna) pracujemy nad systemami interpretacji

tekstów medycznych, korzystając z ontologii UMLS.

Zastosowania: annotacje semantyczne, biling, wspomaganie prac

badawczych, systemy wyszukiwania informacji.

Doktoranci w Cincinnati + Gdańsku.

3

Jak patrzeć na mózg?

Zależy to od pytań, na które chcemy znaleźć odpowiedź.

Riken Brain Science Inst: protecting, understanding & creating the brain.

Większość wykładów tej szkoły jest albo na poziomie molekularnym, albo

na poziomie psychologicznym.

Farmakologia odpowiada na pytania podstawowe, ważne dla medycyny,

bada elementarne procesy i ich związek z zachowaniem.

Psychologia poszukuje wyjaśnień najczęściej na poziomie opisowym.

Co trzeba wiedzieć by stworzyć sztuczny mózg?

Na wiele pytań można odpowiedzieć tylko z perspektywy ekologicznej i

ewolucyjnej: dlaczego świat jest taki, jaki jest? Bo tak się zrobił ...

Dlaczego kora ma budowę kolumnową i warstwową?

Dlaczego jedzenie bulw ignamu w czasie pory deszczowej stanowi

religijne tabu? Nawet skrajni redukcjoniści nie szukają odpowiedzi na

takie pytania wyłącznie na poziomie molekularnym ...

4

Od molekuł ...

10-10 m, poziom molekularny: kanały jonowe, synapsy,

własności

błon komórkowych, biofizyka, neurochemia,

psychofarmakologia, umysł z perspektywy molekuł

(Ira Black, 1994)?

10-6 m, pojedyncze neurony: neurochemia, LTP, LTD, biofizyka,

neuronauki obliczeniowe (CS), modele wielokomorowe

neuronów, impulsy, neurofizjologia.

10-4 m, małe sieci: synchronizacja impulsujących neuronów, rekurencja,

neurodynamika, układy wielostabilne, generatory wzorców, zwoje

neuronów, efekty pamięci, zachowania chaotyczne (semi-liquid

state), „kod neuronowy” (kodowanie informacji), neurofizjologia ...

10-3 m, funkcjonalne grupy neuronów: kolumny korowe (104-105),

synchronizacja, kodowanie populacyjne, mikroobwody, zapisy

wieloelektrodowe, Local Field Potentials, neurodynamika

wielkiej skali, neuroanatomia i neurofizjologia.

5

… do zachowania

10-2 m, sieci mezoskopowe: mapy czuciowo-ruchowe, kodowanie

populacyjne, samoorganizacja, teorie pola średniego, teorie

ośrodków ciągłych, EEG, MEG, metody obrazowania PET/fMRI ...

10-1 m, pola transkorowe, obszary funkcjonalne mózgu: uproszczone

modele kory, struktury podkorowe, działania sensomotoryczne,

integracja funkcji, wyższe czynności psychiczne, pamięć robocza,

świadomość; (neuro)psychologia, psychiatria komputerowa ...

Teraz zdarza się cud ...

1 m, CUN, cały mózg i organizm: świat wewnętrzny, zachowania intencjonalne, działania celowe, myślenie, język, psychologia behawioralna ...

FSA, aproksymacje symboliczne (sztuczna inteligencja).

Gdzie podziała się psyche, perspektywa wewnętrzna?

Lost in translation: sieci => automaty skończone => zachowanie

Alternatywa: przestrzenie psychologiczne => zdarzenia mentalne.

6

Poziom systemowy

7

Podejście neurokognitywne

Computational cognitive neuroscience: szczegółowe modele funkcji

poznawczych i neuronów, pierwsza doroczna konferencja 11/2005.

Informatyka neurokognitywna: uproszczone modele wyższych czynności

poznawczych, myślenia, rozwiązywania problemów, uwagi, języka,

kontroli zachowania i świadomości.

Wiele spekulacji, ponieważ nie znamy szczegółów procesów

zachodzących w mózgu, ale modele jakościowe wyjaśniające rezultaty

eksperymentów psychofizycznych oraz przyczyny chorób psychicznych i

zespołów neuropsychologicznych rozwijają się szybko od ~ 1995 r.

Nawet proste mózgo-podobne przetwarzanie informacji daje rezultaty

podobne do prawdziwych; złożoność mózgu nie jest głównym problemem!

Brain As Complex System (BRACS, EU Project) centralne założenie:

najważniejsza jest ogólna neuroanatomiczna struktura kory i obszarów

podkorowych mózgu, należy ją w modelach zachować.

“Roadmap to human level intelligence” – workshopy na WCCI’06 ++

8

Model transformacji

Przetwarzanie informacji, pomijane sprzężenia

zwrotne: redukcja ilości informacji (kategoryzacja),

działania senso-motoryczne.

Output

weights

~ p(MI|X) 0.7 Myocardial

Infarction

Input

weights

Inputs:

-1

65

Sex

Age

1

5

3

1

Smoking Pain

Elevation

Pain

Intensity Duration ECG: ST

9

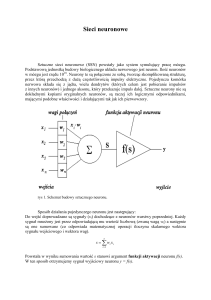

Model samoorganizacji

Topograficzne reprezentacje w licznych obszarach mózgu:

bodźców czuciowych, w korze ruchowej i móżdżku, wielomodalne mapy

orientacji w wzgórkach czworaczych górnych, mapy w układzie

wzrokowym i tonotopiczne mapy kory słuchowej.

Najprostszy model

(Kohonen 1981):

konkurencja między

grupami neuronów i

lokalna kooperacja.

Neurony reagują na

sygnały dostrajając

swoje parametry tak, by

wszystkie bodźce były

analizowane i by bodźce

do siebie podobne

analizowane były przez

sąsiednie neurony.

o

x=dane

o=pozycje wag

neuronów

x

o

o

o

o x

o

o

x

o

xo

N-wymiarowa

przestrzeń danych

o

o

o

wagi wskazują

na punkty w N-D

siatka neuronów

w 2-D

10

Model dynamiczny

Silne sprzężenia zwrotne, stany kolektywne, neurodynamika.

Najprostszy model (Hopfield 1982): pamięć skojarzeniowa, uczenie w

oparciu o regułę Hebba, dynamika synchroniczna, neurony dwustanowe.

Wektor potencjałów wejściowych

V(0)=Vini , czyli wejście = wyjście.

Dynamika (iteracje)

sieć Hopfielda osiąga stany stacjonarne,

czyli odpowiedzi sieci (wektory aktywacji

elementów) na zadane pytanie Vini

(autoasocjacja).

Jeśli połączenia są symetryczne to taka

sieć dąży do stanu stacjonarnego

(atraktor punktowy).

t = dyskretny czas.

Vi t 1 sgn I i t 1 sgn

j WijV j - j

11

Model biofizyczny

Synapses

Soma

I syn (t )

Spike

EPSP, IPSP

Rsyn

Spike

Csyn

Cm

Rm

s AMPA

(t )

d AMPA

j

s j (t ) (t - t kj )

dt

AMPA

k

, ext

I AMPA, ext (t ) g AMPA, ext (Vi (t ) - VE ) wij s AMPA

(t )

j

s NMDA

(t )

d NMDA

j

s j (t ) x j (t )(1 - s NMDA

(t ))

j

dt

NMDA, decay

j

, rec

I AMPA, rec (t ) g AMPA, rec (Vi (t ) - VE ) wij s AMPA

(t )

j

j

I NMDA, rec (t )

g NMDA, rec (Vi (t ) - VE )

2

(1 [ Mg ]exp(-0.062Vi (t ) /3.57))

, rec

I GABA, rec (t ) gGABA, rec (Vi (t ) - VE ) wij s GABA

(t )

j

j

NMDA, rec

w

s

ij j (t )

j

x NMDA

(t )

d NMDA

j

x j (t ) (t - t kj )

dt

NMDA, rise k

s GABA

(t )

d GABA

j

s j (t ) (t - t kj )

dt

GABA

k

12

Problemy neurologiczne

Co wynika z modelowego myślenia?

Padaczka: dodatnie sprzężenie zwrotne jest tu ogólną metaforą, zbyt

słabe hamowanie prowadzi do ognisk silnych pobudzeń, ale o wiele

więcej można się dowiedzieć z modeli biofizycznych.

Wyniki: szczegółowe modele biofizyczne komórek piramidowych i

neuronów wstawkowych w hipokampie (CA3), poznano mechanizm

synchronizacji, zbadano wpływ różnych substancji chemicznych.

Częstości 200-600 Hz (phi) obserwowane w niektórych rodzajach

padaczki nie da się wygenerować w modelach bez synaps

elektrotonicznych na aksonach (kompleksy białkowe koneksyny).

Wystarczą dwie takie synapsy/neuron (Traub, Jefferys).

Jak wpłynąć na koneksyny by zablokować synchronizację?

Potrzebne są modele na poziomie dynamiki molekularnej.

13

Udary i reorganizacja kory

Reprezentacje topograficzne mogą ulegać reorganizacji na

skutek udaru, uszkodzenia nerwu lub amputacji części ciała.

W wyniku stymulacji (lub jej braku) na stepuje szybka ekspansja (lub

kontrakcja) obszarów w korze S1 reagujących na bodźce.

Proste modele SOM dają jakościowo poprawne wyniki.

Uwzględnienie wzgórza daje efekt „odwrotnego powiększenia”, czyli

wielkość obszaru kory zależy odwrotnie proporcjonalnie od wielkości

pola recepcyjnego.

Wyzwanie: kończyny fantomatyczne.

Reorganizacja projekcji wzgórzowych w tym

przypadku osiąga 10 mm, zwykle obszar

projekcji jest rzędu 1 mm.

Być może powstają nowe połączenia.

14

Model reorganizacja kory

Reprezentacje topograficzne mogą ulegać reorganizacji na skutek

udaru, uszkodzenia nerwu lub amputacji części ciała.

W wyniku stymulacji (lub jej braku) na stepuje szybka ekspansja (lub

kontrakcja) obszarów w korze S1 reagujących na bodźce.

Proste modele SOM dają jakościowo poprawne wyniki.

Uwzględnienie wzgórza daje efekt „odwrotnego powiększenia”, czyli

wielkość obszaru kory zależy odwrotnie proporcjonalnie od wielkości

pola recepcyjnego.

Wyzwanie: kończyny fantomatyczne.

Reorganizacja projekcji wzgórzowych w tym

przypadku osiąga 10 mm, zwykle obszar

projekcji jest rzędu 1 mm.

Być może powstają nowe połączenia.

15

Model szybkiej reorganizacji

Szczegółowy model w oparciu o symulator GENESIS.

M. Mazza et al, J. Computational Neuroscience 16 (2004) 177-201

Ręka: 512=32*16 receptorów, dłoń 4x32

+ 4 palce 8x12, ciałka Meissnera,

wysyłają realistyczne ciągi impulsów

do części brzuszno-boczno-tylniej (VPL)

wzgórza; receptory AMPA, GABA i NMDA.

VPL: neurony przekaźnikowe wzgórza i neurony wstawkowe.

Kanały jonowe:

Na, Ca, trzy rodzaje

kanałów K dla neuronów

przekaźnikowych, i 3

kanały dla wstawkowych

Liczne parametry

ustalone doświadczalnie

16

Model VPL

Siatka 16x16=256 neuronów

przekaźnikowych

128 neuronów wstawkowych:

wejścia z ręki przez receptory

AMPA, z innych neuronów

przekaźnikowych przez

receptory AMPA i NMDA,

hamowanie przez receptory

GABA.

Tabele prawdopodobieństw połączeń pomiędzy neuronami oparte na

neuroanatomicznych danych: komórka łączy się z sąsiednimi w

promieniu Rc, z niektórymi (p=0.5) w pierścieniu Rc-Re,

eliptycznie dla połączeń miedzy neuronami przekaźnikowymi z

kanałami NMDA, oraz neuronami wstawkowymi z kanałami GABA.

17

Kora 3b

Modelowane warstwy II, IV i

V, każda 32x32=1024.

Typy neuronów:

A: neurony gwiaździste

warstwy IV,

B: wstawkowe koszyczkowe.

C: piramidalne z warstwy III,

D: piramidalne z warstwy V,

szybkie hamujące GABA;

Neurony piramidowe mają po 8

segmentów, gwiaździste 5,

neuronów pobudzających jest 3072,

wstawkowe mają 2 segmenty i jest

ich razem 1536, po 512 w każdej

warstwie.

18

Połączenia 3b

A, neurony gwiaździste

warstwy IV, mają wejścia

ze wzgórza oraz innych

neuronów tej warstwy.

B, wstawkowe łączą się z

różnymi pobudzającymi.

C i D, piramidalne III i V,

mają wejścia wzgórzowe

i z warstwy II, IV i V.

Probabilistycznie

określone połączenia.

Równania na prądy/potencjały całkowano z krokiem czasowym 0.05 ms

na komputerze osobistym, 1 s = ok. 1 godz. symulacji.

Można prześledzić tworzenie się stabilnych map topograficznych na

poziomie jądra VPL i kory.

19

Symulacje

Symulacje przypadkowo wybranych fragmentów 2x2

receptorów ręki. 1 s= 20.000 pobudzeń,

Aktywność VPL stabilizuje się już po 500 ms, a kory

w warstwie II i V po 750 ms, i IV po 800 ms.

Jasne pola = słaba reakcja, ciemne >10 impulsów/s

Obserwacje:

Reprezentacja dłoni jest mniejsza niż palców.

Warstwa IV ma najbardziej precyzyjne

odwzorowanie, zgodnie z faktami.

Granice reprezentacji ciągle fluktuują.

20

Amputacja

Po osiągnięciu stabilności i obserwacji powstałych

map (900 ms) odcinamy palec = stymulację.

Po następnych 400 ms obserwujemy zmiany.

Część neuronów nie reaguje na żadne pobudzenia

ale reprezentacje palca 1 i 3 zwiększyły swój obszar,

zwłaszcza w warstwie II i V, w mniejszym stopniu w

warstwie IV i wzgórzu.

Eksperymenty pokazują podobną szybką ekspansję i

reorganizację reprezentacji, po której następuje

wolniejsza konsolidacja.

Stabilność map wynika z równowagi pobudzenia i

hamowania; reorganizacja jest wynikiem zaniku

hamowania i wzrostu aktywności receptorów NMDA.

W modelu brakuje jeszcze plastyczności LTP.

21

Pamięć

Ze względu na czas trwania:

1.

2.

3.

LTM - pamięć długotrwała - lata. Kora + hipokamp.

Pamięć krótkotrwała (STM), robocza (WM), operacyjna - sekundy do

minut, przy ciągłym odświeżaniu godzin; aktualizuje kombinacje

stanów LTM. Stan dynamiczny mózgu.

Pamięć natychmiastowa, ikonograficzna, pętla fonologiczna - od

ułamków do kilku sekund. Lokalny stan dynamiczny.

Ze względu na rodzaje pamięci.

1.

2.

3.

4.

5.

Pamięć rozpoznawcza (recognition memory) - już to widziałem, choć

nie mogłem sobie przypomnieć (kora śród- i około-węchowa).

Pamięć opisowa (deklaratywna): epizodyczna i semantyczna.

Pamięć nieopisowa (niedeklaratywna): proceduralna, odruchów

warunkowych (gotowości reakcji, dyspozycyjności), habituacjasentetyzacja (nieasocjacyjna) oraz torowanie (priming).

Pamięć jawna (świadoma, explicit) i utajona (nieświadoma, implicit).

Pamięć emocjonalna - często utajona, ale dzięki połączeniom

hipokamp-kora przejściowa-ciało migdałowate bywa jawna.

22

Cechy neuronowych modeli pamięci

1. Zdolność do rozpoznawania uszkodzonych wzorców –

adresowalność kontekstowa.

2. Czas nie zależy od liczby zapamiętanych wzorców.

3. Uszkodzenie części macierzy połączeń nie prowadzi

do zapomnienia konkretnych wzorców - brak

lokalizacji.

4. Interferencja (mylenie się) dla podobnych wzorców jest

częstsza niż dla wzorców odmiennych.

5. Przepełnienie pamięci (macierzy wag) prowadzi do

chaotycznego zachowania.

Wniosek: najprostsze systemy rozproszone wykazują

cechy typowej pamięci skojarzeniowej.

23

Pamięć epizodyczna

Układ neuromodulacji reguluje

plastyczność hipokampa i kory.

Pamięć średnioterminowa może

być zapisana w sieciach

hipokampa jako wskaźniki do

kolumn kory.

Pamięć trwała jest rezultatem stanów atraktorowych minikolumn kory

mózgu, zapisana jest w synapsach w sposób rozproszony.

Pamięć epizodyczna - odtworzenie stanu mózgu w momencie epizodu.

24

Powstawanie trwałej pamięci

Model TraceLink, Jaap Murre.

25

Amnezja wsteczna

Główna przyczyna:

utrata łączy do kory.

Objawy:

gradienty Ribota czyli im

starsze wspomnienia

tym lepiej pamiętane.

26

Amnezja następcza

Główna przyczyna:

uszkodzenie systemu

neuromodulacji.

Wtórnie: następuje

utrata łączy z korą.

Objawy:

brak możliwości

zapamiętania nowych

faktów.

27

Amnezja semantyczna

Objawy: Trudności w znajdowaniu słów, rozumieniu, zapamiętanie

nowych faktów wymaga ciągłego powtarzania.

Główna przyczyna: uszkodzenie łączy wewnątrzkorowych.

28

Symulacje modelu

Murre, Meeter (2004): uszkodzenie łączy wewnątrzkorowych.

200 kolumn korowych; 42 kolumny hipokampa; neuromodulacja

wpływa na parametry, ale nie jest explicite uwzględniana.

Binarne neurony stochastyczne, prawd. wysłania impulsu zależy od

pobudzeń i hamowania, szybkiego bądź powolnego (spontaniczne).

Połączenia wewnątrz i pomiędzy neuronami – bez ograniczeń.

Uczenie Hebbowskie (Singer 1990), szybkość uczenia w korze mała.

Nakrywanie wzorców: spore w hipokampie, niewielkie w korze.

Symulacje normalnego uczenia i przypominania:

akwizycja - szybkie uczenie, hipokamp.

konsolidacja - powolne korowe, spontaniczne przypominanie;

testowanie - częściowe wektory, ile kolumn prawidłowo pobudzonych?

Dostajemy: ~potęgowe prawo zapominania, gradienty Ribota i amnezję

wsteczną (RA); chwilową amnezję globalną (TGA) w wyniku zaniku

aktywności w hipokampie; amnezję następczą (AA) i jej korelacje z RA;

izolowaną RA, pamięć utajoną i wiele innych efektów...

29

Pamięć semantyczna

Jak z epizodów, obserwacji, tworzy się systematyczna wiedza o

świecie, zawarta w pamięci semantycznej?

Sieci autoasocjacyjne potrafią utworzyć interesujące reprezentacje

wewnętrzne (McClleland-Naughton-O’Reilly, 1995).

Na wejściu sieci mamy węzły

reprezentujące konfiguracje

pobudzeń rozpoznanych

obiektów, np. pine, oak,

oraz kategorie ogólne, np.

trees, plants.

Dodatkowe wejścia pomagają

określać własności, np. „jest

czymś” (ISA), ma, może ...

Na wyjściu mamy obiekty

wejściowe (sprzężenie

zwrotne), oraz czasowniki typu

„lata, biega”.

30

Odległości semantyczne

Odległość pomiędzy wektorami aktywacji

po wytrenowaniu sieci można przedstawić

w postaci dendrogramu, pokazującego

naturalne podobieństwa i klastry.

W miarę uczenia się sieci podobne obiekty

dają bliskie sobie i hierarchicznie

zorganizowane wzorce pobudzeń ukrytych

elementów.

Skalowanie wielowymiarowe pozwala na pokazanie relacji odległości

pomiędzy obiektami w wielowymiarowych przestrzeniach,

np. minimalizując sumę kwadratów różnic odległości S (Rij - rij)2

Odległości Rij można wziąść z aktywacji ukrytych neuronów;

z opisu obiektów za pomocą predykatów, lub z eksperymentów

psychologicznych – wyniki są barzo podobne.

31

Mapy semantyczne: MDS i SOM

horse

duck

cow

zebra

tiger

goose

hawk

wolf

lion

owl

dove

dog

eagle

hen

fox

cat

32

MDS na danych eksperymentalnych

Odległości = uśrednione czasy reakcji

33

Degeneracja pamięci w AD

Degeneracja pamięci, np. w chorobie Alzheimera, może być

związana z utratą słabych synaps.

Jak wpłynie taka utrata na pojemność pamięci?

Odpowiedzi - na razie tylko w oparciu o modele Hopfielda.

Kompensacja - pozostałe synapsy mogą się zaadoptować do nowej

sytuacji. Jaka kompensacja jest najlepsza?

dk

Wij Wij 1

1

d

n

o

d - stopień uszkodzenia

k=k(d) funkcja kompensacji

Silne synapsy ulegają dalszemu wzmocnieniu.

Samo d nie świadczy jeszcze o stopniu uszkodzenia pamięci.

Możliwe są różne objawy przy tym samym stopniu uszkodzenia d.

34

Kompensacja

Zmiana wielkości basenów

atrakcji uszkodzonej sieci w

wyniku uczenia bez (górne

kółko) i z kompensacją

(dolne kółko): widać znaczne

zmniejszenie się rozmiarów

dominujących atraktorów.

Małe baseny => silna

interferencja, halucynacje.

Duży basen – ubóstwo

skojarzeń i myśli.

Poprawne odpowiedzi jako

funkcja ułamka (0.2 i 0.6)

usuniętych połączeń bez i z

kompensacją.

35

Pamięć i atraktory

Za pamięć biologiczną odpowiedzialne są sieci atraktorowe.

Modele wyrastające z sieci Hopfielda dają tylko atraktory punktowe, zbyt

proste by porównywać wyniki z pomiarami neurofizjologów.

DMS, Delayed Match to Sample - małpa musi nauczyć się sekwencji

wielu obrazów; w fazie testu po krótkiej prezentacji jednego obrazu i

przerwie rzędu 30 s ma pokazać sekwencję kilku obrazów.

Wysoka aktywność (20 Hz) neuronów w obszarze IT i PF do 30 sekund

po prezentacji, pomiary z wielu elektrod.

Korelacje czasowe przechodzą w korelacje aktywności neuronów.

Model Amita i wsp. pozwala odtworzyć takie krzywe korelacji.

36

Organizacja hierarchiczna

Dokładniejsze modele: przepływ informacji i kooperacja elementów na

różnym poziomie wymaga hierarchicznej i modularnej organizacji:

6 warstw, neurony => mikrokolumny ~ 110 neuronów.

Kolumny kory (ok. 1 mm2), 105 neuronów = 103 mikrokolumn.

Małe wyspecjalizowane struktury kory, wewnątrz zakrętów; całe mapy

pobudzenia dochodzące z zewnątrz (przez komórki piramidowe).

37

Trochę neurodynamiki

Uproszczone modele

impulsujących neuronów w

kolumnach można

zastosować do opisu

dynamiki uczenia.

Etap 1: pojedyncza kolumna

reaguje na sygnały.

Etap 2: kilka kolumn reaguje

na różne sygnały.

Etap 3: pojawia się

skorelowana aktywność

wielu kolumn.

Nowe atraktory => nowe

obiekty umysłu.

PDF: p(aktywnosci kolumny|

obserwacja danej cechy)

38

Pamięć robocza

Pamięć robocza (WM) jest aktywna, konieczna by powstały wrażenia

świadome, jest oparta na chwilowych stanach wielostabilnego układu.

Czas trwania ~ sekund, pojemność 7±2 obiekty (Miller 1956).

Testy: głównie nieskorelowane słowa/liczby/symbole.

Porcjowanie: grupowanie prostszych obiektów w obiekty wyższego

rzędu, mechanizm uczenia „divide and conquer”, pozwala pamiętać

więcej pomimo ograniczeń pojemności pamięci.

Dla obiektów wzrokowych WM mieści tylko 4±2 obiekty

- np. chińskie znaki jeśli ktoś nie zna chińskiego.

Jak uzasadnić „magiczną” liczbę 7? Niewiele modeli WM.

Lester Ingber, SMNI, Statistical Mechanics of Neocortical Interactions.

Teoria statystyczna, uśrednianie po mikro i minikolumnach.

Mała pojemność: interferencja niezależnych atraktorów.

39

Eksperymenty A-not B

Piaget (1954) - eksperymenty A-not B z niemowlętami i małpami;

interakcja LTM-WM.

E - eksperymentator, N - niemowlę, A, B - miejsca

1. N obserwuje, jak E chowa zabawkę w A, po krótkiej przerwie ją tam

znajduje; powtarza się to kilka razy.

2. N obserwuje, jak E chowa zabawkę w B, ale po krótkiej przerwie

szuka zabawki nadal w A.

Uczenie faworyzuje A, aktywacja WM (kora prefrontalna) B.

Lezje kory prefrontalnej u rezusów i N dają silny efekt A-not B.

Konkurencja pomiędzy uczeniem synaptycznym (pamięcią długotrwałą) i

aktywacjami dynamicznymi.

Symulacje - Munakata (1998) i wielu innych autorów.

40

Płyn neuronowy

Na ile prawdziwa jest metafora mózg-komputer?

Czy mózg liczy tak jak komputer czy jak zwijające się białko?

Neuronowy płyn (Maass 2001): kolumny działają prosto!

Tysiące mikroobwodów, dziesiątki neurotransmiterów i modulatorów,

wiele typów neuronów i synaps. Dlaczego kolumna jest tak złożona?

Czy jej struktura jest genetycznie zaprogramowana?

Jak kodowana jest informacja w sieci neuronów?

„Płyn neuronowy”: przypadkowo połączone neurony w kolumnie, nie ma

stanów ustalonych, impulsy zaburzają mikroobwody kolumn, nie ma

kodowania ani „wewnętrznych reprezentacji”.

Wystarczy zdolność do wzajemnego odróżniania zaburzonych stanów!

Taki system ma moc maszyny Turinga działającej w czasie rzeczywistym.

41

Podsumowanie

•

•

•

•

•

•

•

Szczegółowe modele problemów neurologicznych dają

wyniki porównywalne z eksperymentami.

Proste modele dają ciekawe jakościowe przewidywania,

czasami wskazówki terapeutyczne.

Jest wiele modeli problemów neurologicznych, pamięci, zespołów

neuropsychologicznych, chorób psychicznych (spekulatywne).

Brakuje modeli pnia mózgu (M. Arbib, Mózg i jego modele 1972).

Zachowanie w znacznej mierze sprowadza się do automatyzmów.

Funkcje wymagające świadomości: utrzymywanie informacji w pamięci

roboczej, nowe kombinacje operacji, zachowania intencjonalne.

Zbudowanie modelu umysłu uwzględniające perspektywę wewnętrzną

jest nadal wielkim wyzwaniem – potrzebne są modele geometryczne?

Szkic: WD, Geometryczny model umysłu.

Kognitywistyka i Media w Edukacji, Vol. 6 (2002) 199-230;

WD, Neurokognitywna teoria świadomości,

Kognitywistyka i Media w Edukacji, T.5 (2) 2001, pp. 47-67.

42

Automatyzacja działania

Uczenie się nowych zachowań: początkowo

świadome, aktywacja dużych obszarów mózgu,

działanie staje się w końcowym etapie

automatyczne, nieświadome, pozostają dobrze

zlokalizowane aktywacje obszarów mózgu.

Uczenie się możliwe jest dzięki krytyce (reinforcement), wymaga

zbierania informacji o skutkach działania i oceny na ile skuteczne są

planowane i wykonywane działania.

Relacje zapamiętanych epizodów (LTM) do obecnych wyników (WM) i

oczekiwań wymagają ocen i porównań (Gray – subiculum, podpora), po

których następują reakcje emocjonalne, uwolnienie dopaminy,

zwiększenie plastyczności połączeń umożliwiające szybkie uczenie się

wyspecjalizowanych modułów kontrolujących elementarne kroki.

Pamięć robocza jest niezbędna do zbierania informacji, uwaga do

kontroli, błędy są bolesne, trzeba je pamiętać i korygować.

Świadome przeżywanie wiąże się z krytyką (reinforcement), nie ma

„transferu do nieświadomości”; czy jest to główna funkcja świadomości?

43

Paradoks Centralny

Centralny Paradoks kognitywistyki:

w jaki sposób ze zliczania impulsów przez neurony powstać może świat

wewnętrzny, sens i znaczenia pojęć, emocje, świadomość?

Czy nauki kognitywne zbliżają nas do rozwiązania tego paradoksu?

Jest to na razie mieszanka psychologii poznawczej, psychofizyki,

neurobiologii, lingwistyki, sztucznej inteligencji, filozofii umysłu ...

W psychologii jest bardzo niewiele praw ogólnych (w większości

psychofizycznych) i niewiele mało fenomenologii.

Psycho-logia straciła psyche?

Nauki kognitywne nie mają dobrego modelu umysłu,

jest wiele filozoficznych problemów leżących u ich podstaw

(Searle, Chalmers, Nagel, Jackson ...).

Searle: neurony mają tajemnicze „moce przyczynowe” ...

44

Mind the Gap

Przepaść pomiędzy neuronaukami a psychologią „potoczną” jest tak

duża, że wielu filozofów uważa ją za nie do pokonania.

Czy możliwa jest sensowna teoria umysłu?

Roger Shepard, Toward a universal law of generalization for

psychological science (Science, Sept. 1987):

„Nie potrzeba nam więcej danych czy też bardziej wyrafinowanych

danych, ale odmienne podejście do problemu”.

Definicja robocza:

• Umysł jest podzbiorem możliwych do uświadomienia procesów

zachodzących w mózgu.

Jak opisać dynamikę tych procesów by dostać zadawalający

(geometryczny?) obraz umysłu?

45

Mózgo-podobne obliczanie

Stany mózgu są czasoprzestrzennymi pobudzeniami neuronów.

•

•

•

Widzę, słyszę i czuję ... stany swojego mózgu! Np. ślepota zmian.

Słodycz, swędzenie, głód ... to fizyczne stany mózgu/organizmu.

Procesy poznawcze działają na perceptach, dalece przetworzonych

danych zmysłowych.

Rejestry komputera są dyskretne

a stany mózgu są ciągłe,

„ubrane” w wiele skojarzeń i

potencjalnych relacji.

Świat wewnętrzny jest wynikiem

relacji pomiędzy stanami mózgu,

substratu tworzącego przestrzeń

umysłu (global neuronal

workspace) – komputery niczego

podobnego nie mają ...

46

Model „Platoński”: motywacja

Platon wierzył w rzeczywistość świata umysłu, idealnych

form rozpoznawanych przez intelekt.

Metafora Platona: postrzegamy

zaledwie cienie idealnego świata

rzucane na ściany jaskini, w której

jesteśmy uwięzieni.

(rysunek: Marc Cohen)

Prawdziwe obiekty umysłu to cienie neurodynamiki!

W jaki sposób się tworzą i jak je opisać?

47

Geometria umysłu

Roger Shepard (1994): prawa psychologiczne należy formułować w

odpowiednich przestrzeniach.

Makroskopowe własności są wynikiem oddziaływań na poziomie

mikroskopowym.

Opis ruchu jest niezmienniczy w odpowiednich przestrzeniach.

Przestrzenie Euklidesowe - transformacja Galileusza.

Pseudo-Euklidesowe (3+1) - transformacja Lorentza.

Riemanna - transformacje w układzie przyspieszającym.

Zachowanie, decyzje - rezultat neurodynamiki.

Opis na poziomie neurodynamiki: zbyt trudny.

Logika i symbole - zbyt uproszczona; opis geometryczny

najlepszy?

Jakie przestrzenie należy użyć by znaleźć ogólne prawa

zachowania?

Przestrzenie psychologiczne (K. Lewin 1938): obszar, w którym

można umieścić elementy naszego doświadczenia, zdarzenia

mentalne.

48

Prawa uniwersalne?

„Siły, dynamika”: w P-przestrzeniach o minimalnej liczbie wymiarów.

Odległości: malejące z wzrastającym podobieństwem obiektów.

Uniwersalne prawo generalizacji bodźców zmysłowych:

w odpowiedniej przestrzeni zależność jest eksponencjalna.

D, odległość, obliczona procedurą MDS z postrzeganego podobieństwa;

G(D), prawdopodobieństwo reakcji na wyuczony bodziec (D=0).

49

Struktura P-przestrzeni.

P-przestrzenie: jakie wymiary? Jakie relacje do bodźców fizycznych?

Informacje docierające z siatkówki do kory wzrokowej są szkicowe!

Niezmienniczość postrzeganego koloru K(x,l) = I(l)S(x,l).

Postrzeganie stałego koloru wymaga 6 receptorów, a są 3.

Fizyka ruchu wyobrażanych obiektów: geometria kinematyczna.

Trajektorie ruchu pozornego: linie geodezyjne obrotu i przesunięcia, a

więc jest to ruch helikalny.

Położenie sztywnego obiektu: wyróżniony punkt + kąty, czyli

rozmaitość 6-D, iloczyn półprosty grup E+=R3SO(3).

Linie geodezyjne: rodzina 1-par. podgrup, odpowiadających

helikalnym trajektoriom geometrii kinematycznej.

Częściowa symetria obiektów upraszcza strukturę przestrzeni.

Eksperymenty psychofizyczne pozwalają na określenie struktury tej 6wymiarowej przestrzeni.

Interpretacja kształtów obiektów wymaga większej liczby wymiarów.

Rozpoznawanie: ruch po geodezyjnej w stronę prototypu kształtu obiektu. 50

Model umysłu

Model hierarchiczny:

• wykrywanie cech - mapy topograficzne, kora sensoryczna

• rozpoznawanie obiektów - pamięć długotrwała

• pamięć robocza - bieżąca kontrola, przeżywana teraźniejszość.

51

Uczenie się kategorii

Kategoryzacja w psychologii - wiele teorii.

Klasyczne eksperymenty: Shepard et. al (1961), Nosofsky et al. (1994)

Problemy o wzrastającym stopniu złożoności, podział na kategorie C1, C2,

3 binarne własności: kolor (czarny/biały), rozmiar (mały/duży), kształt

(,).

Typ I : jedna własność określa kategorię.

Typ II: dwie własności, XOR, np. Kat A: (czarny,duży) lub (biały,mały),

kształt dowolny.

Typ III-V: jedna własność + coraz więcej wyjątków.

Typ VI: brak reguły, wyliczanka

Trudności i szybkość uczenia się: Typ I < II < III ~ IV ~ V < VI

52

Dynamika kanoniczna

Co dzieje się w mózgu w czasie uczenia się kategorii na przykładach?

Złożona neurodynamika <=> najprostsza dynamika (kanoniczna).

Dla wszystkich reguł logicznych można napisać odpowiednia równania.

Dla problemów typu II, czyli XOR:

1 2

2

2 2

V x, y, z 3 xyz x y z

4

V

x -3 yz - x 2 y 2 z 2 x

x

V

y -3 xz - x 2 y 2 z 2 y

y

V

z -3 xy - x 2 y 2 z 2 z

z

Przestrzeń

cech

53

Wbrew większości

Lista: choroby C lub R, symptomy PC, PR, I

Choroba C kojarzy się z symptomami (PC, I), choroba

R z (PR, I); C występuje 3 razy częściej niż R.

(PC, I) => C, PC => C, I => C.

Przewidywania „wbrew większości”:

Chociaż PC + I + PR => C (60%)

to

PC + PR => R (60%)

Baseny atraktorów neurodynamiki?

PDF w przestrzeni {C, R, I, PC, PR}.

Interpretacja psychologiczna (1996):

PR ma znaczenie ponieważ jest to symptom

wyróżniający, chociaż PC jest częstszy.

Aktywacja PR + PC częściej prowadzi do

odpowiedzi R ponieważ gradient w kierunku

R jest większy.

54

Powiązania

Przestrzenie umysłu jako arena zdarzeń mentalnych,

np. Mind as motion, ed. R.F. Port, T. van Gelder (MIT Press 1995)

P. Gärdenfors „Conceptual spaces”.

K. Levin, siły psychologiczne.

G. Kelly, Personal Construct Psychology.

R. Shepard, uniwersalne prawa psychologii.

P. Johnson-Laird, modele mentalne.

D. Marr (1970) “krajobraz probabilistyczny”.

C.H. Anderson, D.C. van Essen (1994): mapy PDF Sup. Collic

S. Edelman: “neural spaces”, rozpoznawanie obiektów.

Lingwistyka: problemy analizy semantycznej rozwiązać można za

pomocą „przestrzeni konceptualnych” (concept spaces).

Strumień myśli, zdanie jako trajektoria w przestrzeni umysłu,

np: J. Elman, „Language as a dynamical system”.

55

Podsumowanie

Model Platoński - redukowalny do neurodynamiki,

ale interpretowalny na poziomie psychicznym.

Nowy spójny paradygmat dla kognitywistyki?

Poszukiwanie niskowymiarowych reprezentacji

zdarzeń mentalnych i uproszczonej dynamiki.

Sieć neuronowa realizująca model Platoński znajduje użyteczne

zastosowania techniczne, daje model intuicji.

Otwarte pytania:

Matematyczny opis p-ni o zmiennej liczbie wymiarów.

Geometryczne unaocznienie nawet prostych eksperymentów wymaga

wielowymiarowych przestrzeni.

Jeśli odległości prawd. przejść to są niesymetryczne, a takie modele

geometryczne są trudne do wyobrażenia. Przestrzeń Finslera?

Wyzwanie: od neurodynamiki => przestrzeni cech dla kategoryzacji.

Symulator modelu dynamicznego, redukcja dynamiki.

Na ile taki model może być przydatny, na ile będzie zadawalający?

56

Dziękuję za

uwagę

Google: Duch => Papers

57