Przykłady rozkładów zmiennych losowych

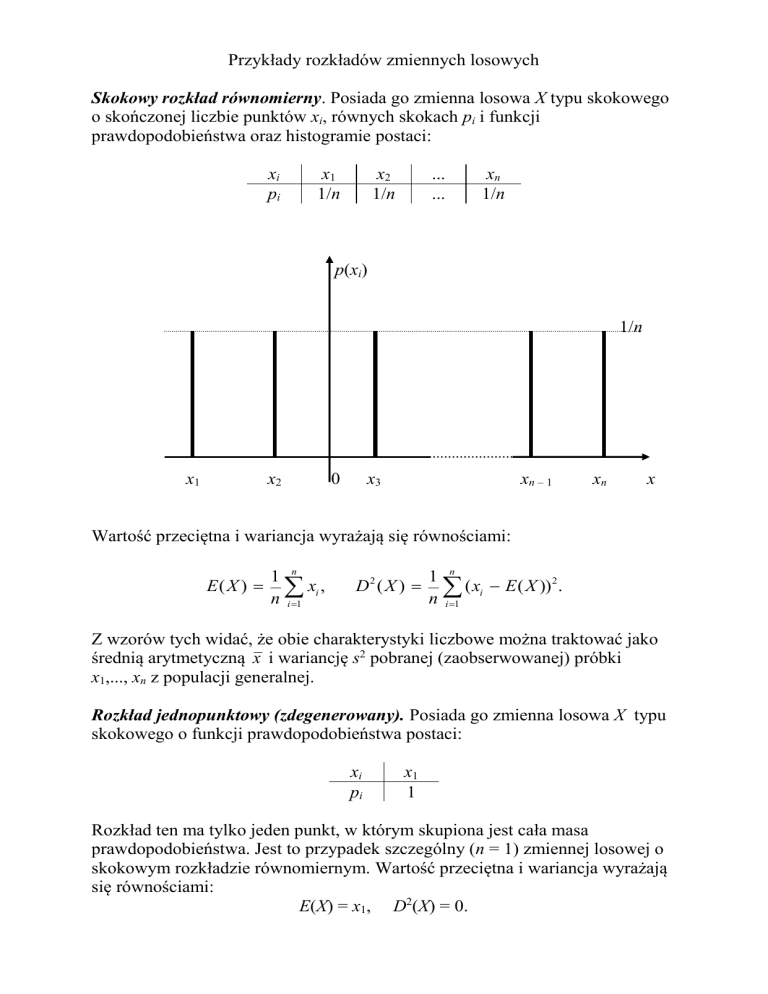

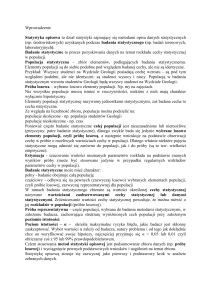

Skokowy rozkład równomierny. Posiada go zmienna losowa X typu skokowego

o skończonej liczbie punktów xi, równych skokach pi i funkcji

prawdopodobieństwa oraz histogramie postaci:

xi

pi

x1

1/n

x2

1/n

...

...

xn

1/n

p(xi)

1/n

x1

x2

0

x3

xn – 1

xn

x

Wartość przeciętna i wariancja wyrażają się równościami:

1 n

E ( X ) xi ,

n i 1

1 n

D ( X ) ( xi E ( X )) 2 .

n i 1

2

Z wzorów tych widać, że obie charakterystyki liczbowe można traktować jako

średnią arytmetyczną x i wariancję s2 pobranej (zaobserwowanej) próbki

x1,..., xn z populacji generalnej.

Rozkład jednopunktowy (zdegenerowany). Posiada go zmienna losowa X typu

skokowego o funkcji prawdopodobieństwa postaci:

xi

pi

x1

1

Rozkład ten ma tylko jeden punkt, w którym skupiona jest cała masa

prawdopodobieństwa. Jest to przypadek szczególny (n = 1) zmiennej losowej o

skokowym rozkładzie równomiernym. Wartość przeciętna i wariancja wyrażają

się równościami:

E(X) = x1, D2(X) = 0.

Zmienna losowa o rozkładzie jednopunktowym jest modelem wielkości

zdeterminowanych. Pozwala zaliczyć te zmienne do zmiennych losowych.

Rozkład zero-jedynkowy. Posiada go zmienna losowa X typu skokowego o o

dwu punktach x1 = 0 i x2 = 1 i funkcji prawdopodobieństwa oraz histogramie

postaci:

xi

pi

0

q

1

p

pi

1,0

q+p=1

p

q

0

1

x

Wartość przeciętna, wariancja oraz moment centralny (asymetria) wyrażają się

równościami:

E(X) = p,

D2(X) = pq, μ3 = pq(1 – 2p).

Jest to rozkład prawdopodobieństwa dla dwu zdarzeń (doświadczeń) losowych

wzajemnie się wykluczających. Jedno z nich zachodzi z prawdopodobieństwem

p a drugie z q = 1 – p. Zdarzeniom tym przypisujemy dwie wartości zmiennej

losowej X, np. x = 1 dla zdarzenia A, a x = 0 dla zdarzenia Ā.

Rozkład dwumienny. Rozkład ten otrzymamy powtarzając n-krotnie

eksperyment obejmujący dwa wykluczające się zdarzenia i pytając o rozkład

prawdopodobieństwa zmiennej losowej postaci

n

X Xi ,

i 0

gdzie zmienna Xi może przyjmować dwie wartości 0 i 1 (rozkład zerojedynkowy). Zmienna X może się zatem zmieniać od 0 do n.

Prawdopodobieństwo występowania wartości x = k oblicza się jako

prawdopodobieństwo k-krotnego powtórzenia się wyniku 1 i (n - k)-krotnego

wyniku 0. Ponieważ zdarzenia są niezależne, zatem prawdopodobieństwo

liczymy jako iloczyn prawdopodobieństw, czyli

pkqn-k.

Wynik powyższy może być realizowany na wiele sposobów, tyle, ile jest

n

kombinacji k elementów z n elementów, czyli .Rozkład zmiennej X jest

k

n

P(k, n, p) = pkqn-k ,

k

postaci:

k = 0, 1, ... , n.

Rozkład ten nazywa się dwumienny (dwumianowy, binomialny, Bernoulliego),

gdyż ma postać (k + 1)-wyrazu dwumianu do potęgi n-tej: (p + q)n .

Z postaci rozkładu wynika , że spełniony jest warunek normalizacyjny,

n

n

n

P(k , n, p) k p q

k 0

k 0

k

nk

( p q) n 1 .

Wartość przeciętna, wariancja oraz moment centralny 3 wyrażają się wzorami:

E(X) = np, D2(X) = npq, 3 = npq(1 – 2p),

3 q p

. Widać z niego, że rozkład

3

npq

symetryczny otrzymamy jedynie w przypadku p = q.

a współczynnik asymetrii

Zmienna losowa o rozkładzie dwumianowym wiąże się (między innymi) ze

zmiennymi losowymi o rozkładach: zero-jedynkowym, Poissona, normalnym.

P(k, n, p)

0,4

p = 0,3

n=5

n =10

n = 15

0,3

0,2

0,1

0

0

4

0

4

0

4

8

k

P(k, n, p)

0,4

n = 15

p = 0,06

p = 0,2

p = 0,5

0,3

0,2

0,1

0

0

4

0

4

0

4

8

k

Rozkład Poissona. W praktyce spotyka się przypadek, że liczba zdarzeń n

występująca w rozkładzie dwumiennym jest bardzo duża a liczba k

zaobserwowanych zdarzeń mała skutkiem małej wartości prawdopodobieństwa

pojedynczego zdarzenia p. Często w takim przypadku brak jest informacji o

liczbie zdarzeń n jak i prawdopodobieństwie p. Klasycznym przykładem jest

rozpad promieniotwórczy jąder. Liczba jąder w próbce jest duża a liczba

zaobserwowanych rozpadów bardzo mała. Dostępną w obserwacji wielkością

jest liczba rozpadów w jednostce czasu, będąca zmienną losową o wartości

oczekiwanej np. Szukamy rozkładu przybliżającego rozkład dwumienny a

zależny od jednego parametru = np. Rozpiszmy współczynnik dwumienny:

n

n!

1

n(n 1)...(n k 1).

k k!(n k )! k!

Wyrażenie można uprościć korzystając z założenie n≫k,

n nk

.

k k!

Funkcję rozkładu prawdopodobieństwa można zapisać w postaci

nk k

n

k k

P(k , ) lim

p (1 ) (1 )

e ,

n k!

n

n

k!

ponieważ lim (1

n

n

) n e .

Otrzymujemy w ten sposób rozkład Poissona

P( k , )

k

k!

e .

Rozkład Poissona spełnia warunek normalizacyjny

k 0

k 0

k

P ( k , ) k! e e e 1 .

Wartość przeciętna, wariancja oraz moment centralny 3 wyrażają się wzorami:

E(X) = , D2(X) = , 3 = ,

3

1

. Widać z niego, że rozkład jest tym

3

bardziej symetryczny im większa jest wartość oczekiwana.

a współczynnik asymetrii

Rysunek przedstawia rozkład Poissona dla kilku wartości .

Dla n⋝50, p⋜0,1 i np⋜10 rozkład Poissona przybliża rozkład dwumienny.

k

n k nk

,

p q e

k!

k

Na kolejnym rysunku porównano rozkład Poissona z rozkładami dwumiennymi

dla różnych n i p ale przy tym samym = np.

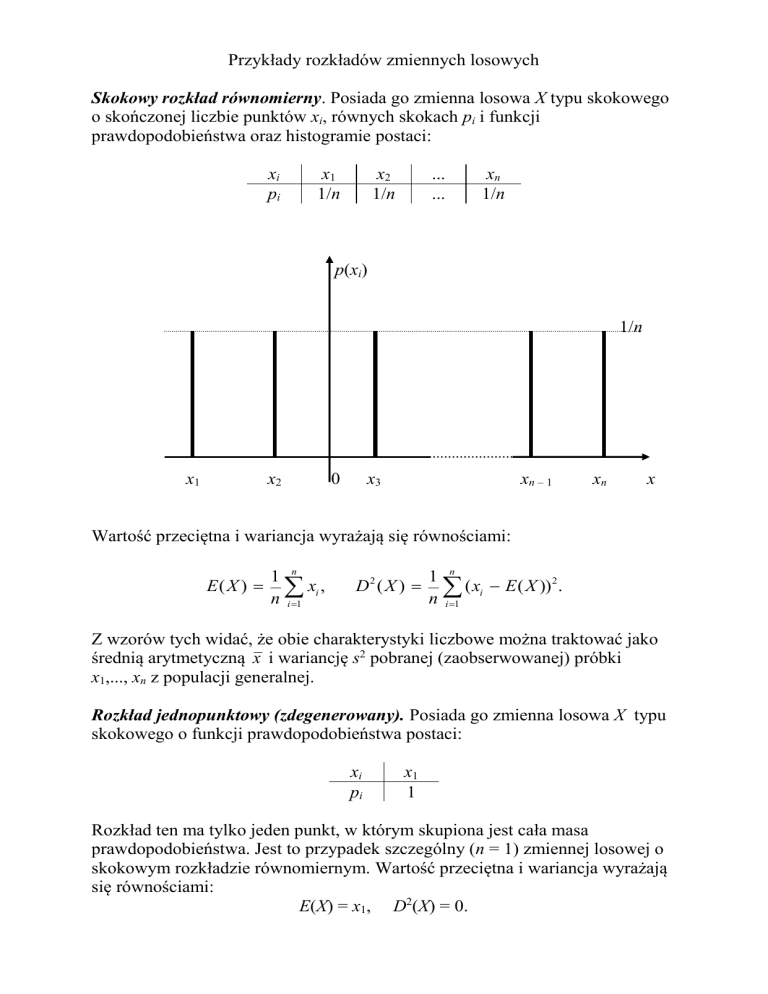

Rozkład równomierny (jednostajny, prostokątny, mikrokanoniczny). Posiada

go zmienna losowa X jeżeli jej gęstość prawdopodobieństwa skoncentrowana na

przedziale a, b jest określona wzorem

1

dla a x b

.

f ( x) b a

dla x a i x b

0

Dystrybuanta tego rozkładu jest postaci:

dla x a

0

x a

F ( x)

dla a x b .

b

a

dla x b

1

F(x)

.

1

.

0,5

.

0

a

(a + b)/2

b

x

wartość przeciętna i mediana zmiennej losowej X są równe

E(X) = x0,5 =

ab

.

2

Moment centralny parzystego rzędu 2r wyraża się wzorem

2r

(b a ) 2 r

,

(2r 1)2 2 r

w szczególności dla r = 1 otrzymujemy wariancję

D2 ( X )

1

12

(b a) 2 .

Wszystkie momenty centralne rzędów nieparzystych są równe zeru (ze względu

na symetrię funkcji gęstości rozkładu wobec wartości przeciętnej).

Liczne zastosowania rozkładu równomiernego wynikają z proporcjonalności

prawdopodobieństwa, że zmienna losowa X przyjmuje wartości z pewnego

przedziału, jedynie do długości tego przedziału.

Rozkład gamma. Posiada go zmienna losowa X jeżeli jej gęstość

prawdopodobieństwa jest określona wzorem:

x p 1

x

exp

p

f ( x) ( p)

0

dla x 0

,

dla x 0

gdzie > 0 jest parametrem skali tego rozkładu, p jest parametrem kształtu a

funkcją specjalną gamma (p) argumentu p zespolonego o części rzeczywistej

dodatniej nazywamy całkę postaci

( p)

x

p 1 x

e dx,

Re p > 0,

0

gdy p jest liczbą rzeczywistą dodatnią otrzymujemy związek postaci:

(p + 1) = p (p),

p > 0.

Jeśli p jest liczbą naturalną, p = n, to

(n + 1) = n!.

Wykres funkcji gęstości rozkładu prawdopodobieństwa dla = 2 i różnych

wartości parametru p (p = ½, 1, 3) przedstawia rysunek.

Moment zwykły r-tego rzędu dla tego rozkładu jest postaci

r

( p r) r

.

( p)

Stąd wartość oczekiwana i wariancja równają się:

E(X) = p,

D2(X) = p2.

Dla p > 1 rozkład gamma jest rozkładem jednomodalnym o wartości mody

m0 = (p – 1).

Można rozważyć następujące szczególne przypadki rozkładu gamma:

1) Dla p = 1 funkcję gęstości prawdopodobieństwa określa wzór

1

x

exp

f ( x)

0

dla x 0

.

dla x 0

Otrzymujemy w ten sposób rozkład wykładniczy o parametrze = E(X).

Rozkładem tym opisuje się, między innymi, czas bezawaryjnej pracy badanego

elementu. Jest on jedynym rozkładem ciągłym który ma właściwość zwaną

brakiem pamięci. Własność tę można interpretować jako niezależność dalszego

czasu pracy elementu od tego co działo się z nim w „przeszłości”. Dalszy czas

pracy elementu ma taki sam rozkład jak całkowity czas pracy elementu.

2) Dla p = n, n N, funkcję gęstości prawdopodobieństwa określa wzór

x n 1

x

exp

f ( x) (n 1)! n

0

dla x 0

,

dla x 0

Otrzymujemy w ten sposób rozkład Erlanga o parametrach n i . Jest to rozkład

jaki posiada suma n niezależnych zmiennych losowych o rozkładzie

wykładniczym.

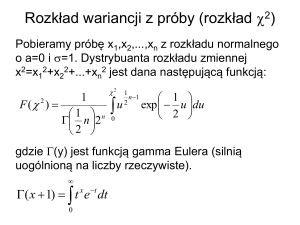

3) Dla p = n/2, n N, = 2 funkcję gęstości prawdopodobieństwa określa

wzór

x 2 1

x

n 2 n exp

f ( x) 2 ( 2 )

2

0

n

dla x 0

,

dla x 0

Otrzymujemy w ten sposób rozkład 2 o n stopniach swobody .

Rozkład normalny (Gaussa). Jest to najważniejszy i najczęściej występujący w

zastosowaniach rozkład typu ciągłego.

Rozkład dwumienny wraz ze wzrostem n coraz bardziej się symetryzuje.

Poszukuje się rozkładu ciągłego dobrze przybliżającego rozkład dwumienny

przy założeniu dużych wartości n i niezbyt małych wartościach p.

Wzór na rozkład dwumienny jest postaci:

n

n!

P(k , n, p) p k q nk

p k q nk .

k!n k !

k

Zlogarytmujmy obustronnie to wyrażenie

ln P ln n! ln k! ln( n k )!k ln p (n k ) ln q .

Wzór Stirlinga przybliża ln n! następująco

ln n! (n 12 ) ln n n 12 ln 2 .

Stosując to przybliżenie we wzorze na ln P otrzymujemy

ln P (n 12 ) ln n (k 12 ) ln k (n k 12 ) ln( n k ) 12 ln 2 k ln p (n k ) ln q

Wprowadźmy oznaczenia wartości oczekiwanej i wariancji w rozkładzie

dwumiennym: = np, V = 2 = npq i dokonajmy zamiany zmiennej

z

k

k np

.

npq

Otrzymujemy wówczas

ln P 12 ln( 2npq) np 12 z npq ln 1 z

q

np

np

1

2

z npq ln 1 z

p

nq

Rozwijając logarytmy na szeregi i pomijając dla dużych n wyrazy rzędu n-1/2 i

wyższych otrzymujemy

ln P 12 ln( 2npq) 12 z 2 ,

skąd przechodząc do pierwotnej zmiennej skokowej k i zastępując ją zmienną

ciągłą X otrzymujemy rozkład postaci

(x )2

1

P ( x, , )

exp

.

2 2

2

Rysunek pokazuje jak dobrze dla większych n rozkład normalny przybliża

rozkład dwumienny.

Rozkład normalny o parametrach , oznaczamy symbolem N(, ), gdzie

jest parametrem przesunięcia (rys. a) a parametrem skali (rys. b) tego

rozkładu.

Wykres gęstości prawdopodobieństwa rozkładu normalnego ma maksimum w

punkcie x = oraz punkty przegięcia x = ± .

Wykresem gęstości prawdopodobieństwa rozkładu normalnego jest tzw. krzywa

Gaussa.

Wartość przeciętna, mediana i moda równają się parametrowi :

E(X) = me = m0 = .

Wszystkie wyższe momenty centralne rozkładu normalnego wyrażają się przez

parametr lub równają się zeru, więc parametry i całkowicie opisują jego

postać.

Wariancja oraz moment centralny 3 są równe:

D2(X) = 2, 3 = 0,

a współczynnik asymetrii

3

0 . Widać z niego, że rozkład Gaussa jest

3

symetryczny względem wartości średniej. Z kolei współczynnik spłaszczenia

4

3 , dla rozkładu normalnego jest równy zeru. Jest to więc

4

współczynnik, który porównuje skupienie dowolnego rozkładu wokół jego

wartości przeciętnej, ze skupieniem rozkładu N(, ).

(eksces), tj. 2

Przejęło się posługiwać tabelami rozkładu normalnego. Jednakże różne wartości

parametrów i uniemożliwiają praktycznie taką operację. Należy gęstość

rozkładu normalnego uniezależnić od wartości obu parametrów. Wprowadza się

nową zmienną w postaci

Z

X

.

Otrzymujemy standaryzowany (unormowany) rozkład normalny N(0, 1) o

= 0 i = 1. Gęstość rozkładu jest postaci:

n( z )

1 z2 / 2

e

.

2

Wykres prezentuje funkcję gęstości oraz dystrybuantę tego rozkładu, która, ze

względu na symetrię funkcji gęstości, spełnia zależność:

F(x) = 1 F(x).

Dystrybuantę standaryzowanego rozkładu normalnego można przedstawić przy

pomocy całki Laplace’a

F(z) = 0,5 + (z), gdzie

1

(z) =

2

z

e

2

/2

d .

0

Wartości całki Laplace’a są stabelaryzowane i z ich pomocą możemy

wyznaczyć prawdopodobieństwo, że wartość zmiennej losowej zawarta jest

między wartościami x1 i x2. Prawdopodobieństwo to równa się

x

x

P( x1 X x2 ) F ( x2 ) F ( x1 ) 2

1

.

Korzystając z powyższej relacji wyznaczmy prawdopodobieństwo, że wartość X

nie będzie się różnić od wartości oczekiwanej o więcej niż o jedno odchylenie

standardowe :

P( ) < X ( ) = (+1) (1) = 2(+1) = 0.68269,

Czyli prawdopodobieństwo to wynosi około 68 %.

Podobnie dla różnic o dwa lub o trzy odchylenie standardowe otrzymujemy:

P( 2) < X ( 2) = (+2) (2) = 2(+2) = 0.95450,

P( 3) < X ( 3) = (+3) (3) = 2(+3) = 0.99730.

Czyli odpowiednio 95 % i 99,7 %. Te wartości mają znaczenie przy interpretacji

jako błędu średniego.