1/18/2017

G:

PROBLEM: KLASTROWANIE DANYCH

I DRZEWA FILOGENETYCZNE

METODY:

MACIERZ EKSPRESJI

KLASTROWANIE HIERARCHICZNE

KLASTROWANIE K-ŚREDNICH

METODA KLIK

ODLEGŁOŚCIOWA REKONSTRUKCJA DRZEWA FILOGENETYCZNEGO

MACIERZE ADDYTYWNE

REKONSTRUKCJA DRZEWA POPRZEZ KLASTROWANIE

METODA NAJWIĘKSZEJ OSZCZĘDNOŚCI : PARSYMONIA

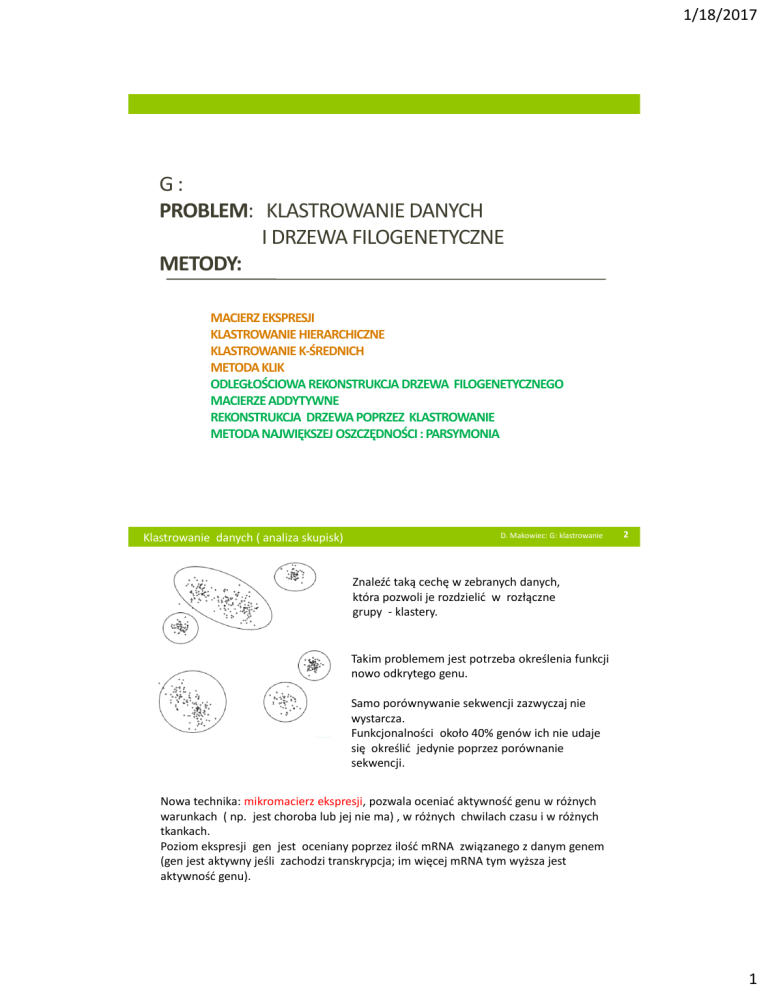

Klastrowanie danych ( analiza skupisk)

D. Makowiec: G: klastrowanie

2

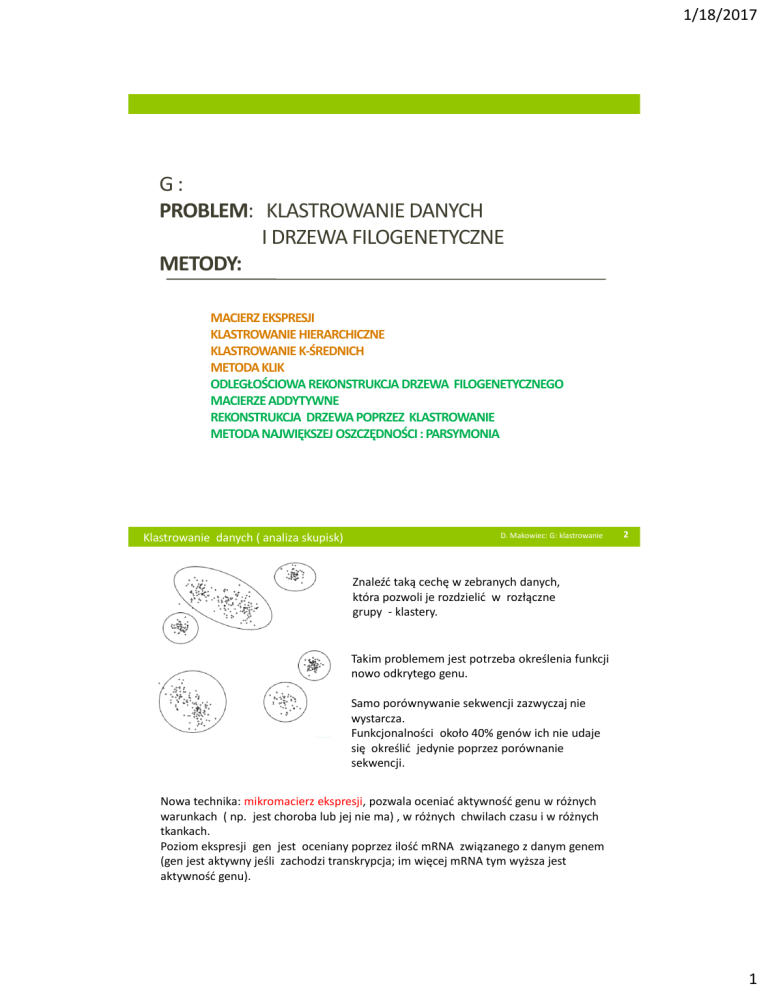

Znaleźć taką cechę w zebranych danych,

która pozwoli je rozdzielić w rozłączne

grupy - klastery.

Takim problemem jest potrzeba określenia funkcji

nowo odkrytego genu.

Samo porównywanie sekwencji zazwyczaj nie

wystarcza.

Funkcjonalności około 40% genów ich nie udaje

się określić jedynie poprzez porównanie

sekwencji.

Nowa technika: mikromacierz ekspresji, pozwala oceniać aktywność genu w różnych

warunkach ( np. jest choroba lub jej nie ma) , w różnych chwilach czasu i w różnych

tkankach.

Poziom ekspresji gen jest oceniany poprzez ilość mRNA związanego z danym genem

(gen jest aktywny jeśli zachodzi transkrypcja; im więcej mRNA tym wyższa jest

aktywność genu).

1

1/18/2017

D. Makowiec: G: klastrowanie

Eksperymenty z mikromacierzami

kontrola

3

próba

Gen jest bardziej

aktywny w kontroli niż

próbce

Pobieramy mRNA

Gen jest bardziej

aktywny w próbce niż

w kontroli

Syntezujemy cDNA

’farbujemy’ go

fosforem

Aktywność obu grup

genów jest identyczna

Mieszamy

Nie wykryto aktywności

żadnego z grup genów

Hybrydyzujemy

Skanujemy

Analizujemy obraz

Macierz ekspresji genów

D. Makowiec: G: klastrowanie

4

2

1/18/2017

Klastrowanie danych z mikromacierzy

Macierz ekspresji genów

D. Makowiec: G: klastrowanie

D. Makowiec: G: klastrowanie

6

7

I ij to poziom ekspresji genu i w eksperymencie j

Wiersz i to wzorzec ekspresji genu i

Zadanie:

wyszukać w I pary genów o podobnych wzorcach

3

1/18/2017

Macierz odległości ekspresji genów

D. Makowiec: G: klastrowanie

8

Warunki poprawnego grupowania:

• jednorodność : geny z tej samej grupy,

każdy z każdym, mają wzorce bardzo

podobne

• separacja : geny z różnych grup, każdy z

każdym, różnią się znacząco

OK

Techniki klastrowania

Nie OK

D. Makowiec: G: klastrowanie

9

Hierarchiczna : dane organizujemy w drzewa binarne (np.: dendrogram)

Optymalizacyjna : szukamy średniego wektora najlepiej reprezentującego klaster

Grafowe : klikowe – klastery tworzą kliki w grafie odległości z progiem

4

1/18/2017

Klastrowanie hierarchiczne

D. Makowiec: G: klastrowanie

1

0

Technika organizowania danych w

drzewo:

• geny to liście

• krawędzie mają długość

• Długość ścieżki pomiędzy liśćmi

koreluje z wynikiem z macierzy

odległości d

2 krok:

1 krok:

Start:

Klastrowanie hierarchiczne

D. Makowiec: G: klastrowanie

11

Różne

możliwości

zdefiniowania

odległości do

nowego

węzła

5

1/18/2017

Klastrowanie hierarchiczne

D. Makowiec: G: klastrowanie

12

Główna

propozycja

podziału

Klastrowanie hierarchiczne

Michel Eisen i

współpracownicy ,

i ich drzewo

klastrowania 8600

genów w 13 chwilach

czasowych

D. Makowiec: G: klastrowanie

13

Macierz odległości to

macierz korelacji:

Eisen M B et al. PNAS 1998;95:14863-14868

6

1/18/2017

D. Makowiec: G: klastrowanie 14

Klastrowanie hierarchiczne jest często wykorzytywane do konstrukcji historii

ewolucji ( tzw. drzewa filogenetyczne)

D. Makowiec: G: klastrowanie

Klastrowanie k-średnich

15

Definicja

odległością punktu v od zbioru punktów X={ x1,x2,…, xk } nazywamy

d (v, {x1 , x2 ,...xk }) min xi :x1 , x2 ,... xk d (v, xi )

Definicja

Błąd kwadratowy średni ( błąd deformacji) zbioru punktów V ={v1,v2,… vn} od

zbioru punktów X={ x1,x2,…, xn } nazywamy

d ({v1 , v2 ,..., vn }, {x1 , x2 ,...xk })

1

d 2 (vi ,{x1 , x2 ,...xk })

n i 1,..n

Problem:

Dla zadanego zbioru n punktów z m-wymiarowej przestrzeni oraz danej wartości K

zbudować zbiór X składający się K punktów (centrów klastrowania) takich, dla

których błąd kwadratowy średni jest minimalny.

7

1/18/2017

Klastrowanie K- średnich

Klastrowanie K- średnich

D. Makowiec: G: klastrowanie

D. Makowiec: G: klastrowanie

16

17

Przykład :

Klastrowanie 1-średniej

epsilon odpowiednio maly

Input : zestaw punktów V{v1,v2,… vn}

Output: pojedynczy punkt x (centrum klastera), który minimalizuje d(V,x) po

wszystkich możliwych wyborach x

Typowa symulacja

Monte Carlo

• Wylosuj współrzędne wektora X=[x1,x2,…,xk]

• Oblicz d(V, X)

• Wylosuj numer współrzędnej

j:1,…,m

• Wylosuj nową wartość dla tej wspólrzędnej x*j

• Oblicz d(V, X*)

• Jeśli d(V, X*)< d(V, X) zaakceptuj zmianę w X, czyli X= X*

w przeciwnym wypadku zaakceptuj zmianę w X z prawdopodobieństwem

skorelownym z epsilon = d(V, X*)-d(V, X)

Wróć do

8

1/18/2017

Klastrowanie K- średnich

D. Makowiec: G: klastrowanie

18

Przykład :

Klastrowanie K-średnich

epsilon odpowiednio maly

Input : zestaw punktów V{v1,v2,… vn}

Output: zestaw K punktów X (centrów klasterów), które minimalizują d(V,x) po

wszystkich możliwych wyborach X

Typowa symulacja

Monte Carlo

• Wylosuj współrzędne wektora X=[x1,x2,…,xk], każdy jest m wymiarowy

• Oblicz d(V, X)

• Wylosuj numer wektora i:1…k, i numer wspolrzędnej j:1,…,m

• Wylosuj nową wartość X*j, utworz X*=[x1,x2,… x*j…. ,xm]

• Oblicz d(V, X*)

• Jeśli d(V, X*)< d(V, X) zaakceptuj zmianę w X, czyli X= X*

w przeciwnym wypadku zaakceptuj zmianę w X z prawdopodobieństwem

skorelownym z epsilon = d(V, X*)-d(V, X)

Wróć do

Algorytm Lloyda ( heurystyczne klastrowanie k-średnich

D. Makowiec: G: klastrowanie

1

9

9

1/18/2017

Algorytm Lloyda ( heurystyczne klastrowanie k-średnich

D. Makowiec: G: klastrowanie

2

0

Algorytm Lloyda ( heurystyczne klastrowanie k-średnich

D. Makowiec: G: klastrowanie

2

1

10

1/18/2017

Algorytm Lloyda ( heurystyczne klastrowanie k-średnich

Algorytm Lloyda ( heurystyczne klastrowanie k-średnich

D. Makowiec: G: klastrowanie

23

11

1/18/2017

Jak dobrać K?

D. Makowiec: G: klastrowanie

25

D. Makowiec: G: klastrowanie

26

Jeśli K rośnie to błąd kwadratowy

średni maleje

(jest zerem gdy K=n, ale wówczas

klastrowanie jest bezużyteczne)

Strategia:

Zwiększaj k dopóki błąd kwadratowy

średni ma malejące przyrosty

Grafy klikowe

Definicje:

Grafem zupełnym nazywamy graf, w którym każde dwa wierzchołki są połączone krawędzią.

Grafem klikowym nazywamy graf, w którym każda składowa spójna jest grafem zupełnym.

Podzbiór V’ zbioru wierzchołków V grafu G= (V, E) tworzy podgraf zupełny jeśli dowolne dwa

wierzchołki z V’ są połączone krawędzią w G.

Kliką w grafie nazywamy maksymalny podgraf zupełny, to znaczy podgraf zupełny, który nie jest

zawarty w innym podgrafie.

Przykład:

1) Graf o trzech składowych spójnych . Każda składowa jest grafem

zupełnym.

1) Graf o 7 wierzchołkach , który posiada 4 kliki: {1,2,6,7} ,{2,3}, {5,6},

{3,4,5}.

12

1/18/2017

Grafy klikowe

D. Makowiec: G: klastrowanie

27

Każdy podział n elementów na K klastrów może być reprezentowany jako graf klikowy

o n wierzchołkach i K klikach.

Grafy klikowe

D. Makowiec: G: klastrowanie

28

Od macierzy odległości do

grafu klikowego:

• geny to wierzchołki grafu

• dwa wierzchołki łączymy

krawędzią jeśli odległość

pomiędzy nimi jest mniejsza

od ustalonego progu

odległości θ

13

1/18/2017

CAST : Claster Affinity Search Technique

D. Makowiec: G: klastrowanie

29

*** Ewolucja a analiza DNA : zagadka wielkiej pandy

D. Makowiec: G: klastrowanie

30

https://en.wikipedia.org/wiki/Giant_panda

niedźwiedź czy szop?

•

1870 problem postawił Armand David

Analiza cech behawioralnych i morfologicznych

kształt niedźwiedzia, ale nie hibernuje

nie ryczy jak niedźwiedź a beczy jak szop

•

1985 problem rozwiązał Steven O’Brian ze współpracownikami opierając się na badaniach DNA

14

1/18/2017

Drzewo ewolucyjne człowieka

D. Makowiec: G: klastrowanie

31

1965 : Zuckerman i Pauling pracą

„Evolutionary Divergence and

Convergence in Proteins” dali początek

wykorzystania DNA do rekonstrukcji

drzewa filogenetycznego.

Obecnie badania DNA są podstawą

badań ewolucyjnych

W tym samym czasie, gdy Steven O’Brien

rozwiązał kontrowersje wokół pochodzenia

wielkiej pandy, Rebecca Cann, Mark Stoneking

i Allan Wilson skonstruowali drzewo ewolucji

człowieka.

Nowa kontrowersja - hipoteza o afrykańskim

pochodzeniu naszego gatunku.

Gatunek nasz ma wspólnego przodka, który to

żył w Afryce ok. 200,000 lat temu …….

Temporal and Geographical Distribution of Hominid

Populations Redrawn from Stringer (2003)

Drzewo ewolucyjne człowieka

D. Makowiec: G: klastrowanie

32

15

1/18/2017

Drzewo ewolucyjne człowieka

D. Makowiec: G: klastrowanie

33

Drzewo ewolucyjne człowieka

D. Makowiec: G: klastrowanie

34

16

1/18/2017

Drzewo ewolucyjne człowieka

Bazowe pojęcia: drzewa swobodne a drzewa ukorzenione

D. Makowiec: G: klastrowanie

35

D. Makowiec: G: klastrowanie

36

Jak te drzewa są budowane z sekwencji DNA?

Konstruujemy ważone drzewa binarne: wszystkie wewnętrzne wierzchołki mają stopień 3.

przy czym

• Liście to aktualnie istniejące gatunki

• Wewnętrzne wierzchołki to wspólni przodkowie

• Zazwyczaj krawędzie mają wagę

To samo drzewo w reprezentacji

• Czasem i wierzchołki mają wagę (tzw. zegar molekularny) od wyróżnionego wierzchołka

Wyróżniony

wierzchołek

nie jest binarne

Drzewa mogą być swobodne

lub ukorzenione.

Pień drzewa ukorzenionego

wskazuje na wspólnego

przodka.

W drzewie swobodnym

wspólny przodek jest nieznany.

17

1/18/2017

Rekonstrukcja drzewa bazująca na odległościach

D. Makowiec: G: klastrowanie

37

Drzewo binarne o sześciu liściach

ma cztery węzły wewnętrzne.

Mając drzewo ważone możemy

dla każdej pary liści obliczyć

odległość pomiędzy nimi.

Zatem każde drzewo T ważone wyznacza

macierz d i,j (T) odległości pomiędzy

wierzchołkami i oraz j .

Z drugiej strony w oparciu o badania n

gatunków mamy macierz n x n odległości

pomiędzy nimi D i,j.

Zadanie:

Znaleźć takie drzewo T ważone dla którego

d i,j (T) = D i,j

dla dowolnych wierzchołków i oraz j .

Drzewo dla przypadku n =3

D. Makowiec: G: klastrowanie

38

Od macierzy D(i,j) do drzewa binarnego nieukorzenionego (swobodnego) T ważonego ,

takiego gdzie waga krawędzi d(i,j) = D(i,j)

3 równania liniowe o 3 niewiadomych

18

1/18/2017

Addytywna macierz odłeglości

39

D. Makowiec: G: klastrowanie

TWIERDZENIE: Swobodne drzewo binarne o n liściach ma 2n-3 krawędzi

Dopasowanie drzewa do zadanej macierzy odległości wymaga rozwiązania układu

n(n-1)/2 równań liniowych o 2n-3 zmiennych

Definicja:

Macierz odległości D(i,j) nazywamy addytywną jeśli istnieje takie binarne i swobodne drzewo

T, że odległości w tym drzewie d(i,j) są uzgodnione z macierzą odległości, D(i,j)=d(i,j)

D. Makowiec: G: klastrowanie

40

19

1/18/2017

D. Makowiec: G: klastrowanie

Rekonstrukcja drzewa z macierzy addytywnej

• Odszukaj sąsiadujące liście i, j , to jest

liście które mają tego samego ojca k

• Usuń wiersze oraz kolumny i-te oraz j-te

• Dopisz nowy wiersz oraz kolumnę

odpowiadającą wierzchołkowi k gdzie

odległość do dowolnego wierzchołka m

jest obliczana jako

41

Tego wierzchołka w D póki co

nie było, bo jest to wierzchołek

wewnętrzny

Jak znaleźć sąsiadujące liście?

najbliżsi sąsiedzi w D nie muszą

być sąsiadującymi liści w drzewie

11

4

D(j,k)=12 a D(i,j)=13 czy D(k,l)=13

2

„Strzyżenie wiszących krawędzi”

Jak znaleźć sąsiadujące liście bazując na D?

6

7

D. Makowiec: G: klastrowanie

42

Iteracyjnie stosujemy proces

strzyżenia krawędzi wiszących

Macierz D:

Krawędzie wiszące to krawędzie

prowadzące do liści drzewa.

Strzyżenie krawędzi wiszących

to skrócenie wszystkich tych

krawędzi o

d.

Zdegenerowana trójka to zbiór

trzech elementów i, j, k w D

takich, że D(i,j) +D(j,k) =D(i,k).

20

1/18/2017

„Strzyżenie wiszących krawędzi”

D. Makowiec: G: klastrowanie

43

D. Makowiec: G: klastrowanie

44

Po usunięciu B:

Kolejna iteracja:

strzyżenie o 3

wyszukiwanie zdegenerowanej trojki

Uwaga: tak naprawdę to kolejne iteracje to

przede wszystkim wyszukiwanie

zdegenerowanych trójek punków. Dopiero, gdy

takiej trójki nie mamy , to zaczynamy strzyżenie.

Rekonstrukcja drzewa

21

1/18/2017

Algorytm konstrukcji drzewa z macierzy odległości

D. Makowiec: G: klastrowanie

45

zakończenie obliczenia

przygotowanie zmiennych

do dalszego przetwarzania

Wyszukiwanie zdegenerowanej trójki,

poprawienie macierzy odległości

wywołanie rekurencyjne obliczenia

Rekonstrukcja drzewa

Test czy aktualna D jest

addytywna

A co jeśli D jest nieaddytywna?

D. Makowiec: G: klastrowanie

46

Jeśli D nie jest addytywna ( tak jest zazwyczaj) to szukamy T , które najlepiej przybliża D

to znaczy takiego T dla którego błąd kwadratowy jest najmniejszy.

Problem NP-trudny

22

1/18/2017

D. Makowiec: G: klastrowanie

Przypomnienie: klastrowanie hierarchiczne

Drzewa ewolucyjne i klastrowanie hierarchiczne

D. Makowiec: G: klastrowanie

47

48

UPGMA (Unweighted Pair Group Method with Arithmetic Mean)

23

1/18/2017

Drzewa ewolucyjne i klastrowanie hierarchiczne

D. Makowiec: G: klastrowanie

49

UPGMA zaczyna generowanie poprzez

zbudowanie drzewa postaci:

Uwaga: z

UPGMA

nigdy nie

powstanie

drzewo o

takiej

strukturze

które to „wyciąga w górę” tak,

aby zachodziło:

Następnie

dobudowuje

kolejną gałąź

Drzewa ewolucyjne i klastrowanie hierarchiczne

Kolejno

powstaje tego

typu struktura:

drzewo

ultrametryczne

Odległość od

pnia do

każdego liścia

jest taka sama

D. Makowiec: G: klastrowanie

50

24

1/18/2017

Dane jest n sekwencji DNA o długości

m każda.

Mamy zatem macierz dopasowania w

rozmiarze n x m.

Species

Species

Species

Species

Species

A

B

C

D

E

Można ją przetransformować na

macierz odległości, ale nigdy w drugą

stronę.

Informacja o dopasowaniu jest

bezpowrotnie tracona przy tej

transformacji

D. Makowiec: G: klastrowanie

51

ATGGCTATTCTTATAGTACG

ATCGCTAGTCTTATATTACA

TTCACTAGACCTGTGGTCCA

TTGACCAGACCTGTGGTCCG

TTGACCAGTTCTCTAGTTCG

n x m macierz dopasowania

tran

Nie ma

sfor

transformac

macji

ja

powrotnej

X

Metody dyskretne rekonstrukcji drzewa ewolucyjnego

n x n macierz odległości

Lepsza technika:

algorytm rekonstrukcji drzewa bazujący na symbolach

umożliwia badanie ewolucji dla każdego znaku.

Parsymonia w rekonstrukcji drzewa filogenetycznego

D. Makowiec: G: klastrowanie

52

Parsymonia (oszczędność): kryterium optymalizacyjne - szukamy takiego drzewa,

które wyznacza najmniejszą liczbę zdarzeń ewolucyjnych ( podstawienia, zamiany, itp.)

Brzytwa Ockhama

Przykład: Szukaj najprostszego wyjaśnienia dla danych { ATCG, ATCC, ACGG}

25

1/18/2017

Problem małej parsymonii inaczej

D. Makowiec: G: klastrowanie

53

Znaki naszego drzewa to brwi i usta. Każdy z nich może być w dwóch stanach.

Dobierz etykiety węzłów wewnętrznych tak by wynik parsymonii był najmniejszy.

Rekonstrukcja drzewa ewolucyjne oparta na symbolach

D. Makowiec: G: klastrowanie

54

Dwie klasy problemów:

małej parsymonii : zakładamy , że struktura drzewa jest dana

wielkiej parsymonii : struktura drzewa jest dowolna.

26

1/18/2017

Mała parsymonia w rekonstrukcji drzewa filogenetycznego

D. Makowiec: G: klastrowanie

55

D. Makowiec: G: klastrowanie

56

Znaki w

łańcuchach są

niezależne od

siebie (???)

zatem problem

malej

parsymonii

może być

rozwiązawany

dla każdej

pozycji

oddzielnie

Parsymonia w rekonstrukcji drzewa filogenetycznego

Punktacja

zgodna z

tablicą małej

parsymonii

Punktacja

zgodna z

przykładową

tablicą ważonej

małej

parsymonii

27

1/18/2017

57

D. Makowiec: G: klastrowanie

Algorytm Sankoffa

Każdy wierzchołek v z drzewa T

wyznacza poddrzewo o korzeniu:

wierzchołków osiągalnych z v.

Etykieta v ma zbierać

własności dzieci wierzchołka v.

st (v)

st (u )

st (w)

Algorytm dynamiczny

Niech st (v) to wynik parsymonii dla poddrzewa v uzyskany przy założeniu,

ze w v umieszczono znak t, czyli

st (v) min i{ A,T ,C ,G}{si (u ) d it } min i{ A,T ,C ,G}{si ( w) d it }

Warunek początkowy

0 dla v t

st (v)

dla v t

58

D. Makowiec: G: klastrowanie

Algorytm Sankoffa

A

C

T

G

28

1/18/2017

D. Makowiec: G: klastrowanie

A

T

G

C

?

A

C

D. Makowiec: G: klastrowanie

9

A

7

8

9

T

G

C

A

59

60

?

C

29

1/18/2017

D. Makowiec: G: klastrowanie

9, 7, 8, 9

A: + 0 ,3 , 4, 9

61

7, 2, 2, 8

+ 0 ,3 , 4, 9

min{9,10,12,18} + min{7, 5, 6 , 17} = 14

T: + 3, 0 , 2, 4

+3,0,2,4

min{12, 7, 10,13} + min{10, 2, 4 , 12} = 9

G: + 4, 2, 0 , 4

+4,2,0, 4

min{ 13, 9, 8, 13} + min{11, 4, 2 , 12} = 10

C: + 9, 4, 4, 0

+ 9,4,4,0

min{18, 11,12, 9} + min{19, 6, 6 , 8} = 15

T

T

T

Ojciec dostaje wektor:

{ 14,9,10,15}

A, T, G, C

D. Makowiec: G: klastrowanie

Algorytm Fitcha

62

Idąc od dołu góry przydziel każdemu wierzchołkowi zestaw etykiet:

jeśli część wspólna jest niepusta

w przeciwnym przypadku

Idąc do dołu z góry wybierz wspólny stan dla ojca i jego potomka

jeśli taki jest. W przeciwnym wypadku wylosuj jeden i zapłać karę

Przykład 1

30

1/18/2017

D. Makowiec: G: klastrowanie

63

Przykład 2

Algorytm Sankoffa versus algorytm Fitcha

D. Makowiec: G: klastrowanie

64

Macierz punktacji

si(v) - od Sankoffa,

jest równoważne S (v) - od Fitch’a .

31

1/18/2017

Problem wielkiej parsymonii

D. Makowiec: G: klastrowanie

65

Problem NP-zupełny

Przykłady drzew o 4 liściach

Ilość drzew ukorzenionych o n liściach :

T(n) dla n = 2, 3, 4, 5, 6, 7, 8, 9, 10, ….

to

Zamiana najbliższych sąsiadow w problemie wielkiej parsymonii

D. Makowiec: G: klastrowanie

66

Najbliżsi sąsiedzi w przestrzeni drzew

Każda krawędź pozwala na trzy

różne połączenia czterech

poddrzew A, B, C i D

32

1/18/2017

Problem przeszukiwania przestrzeni drzew

D. Makowiec: G: klastrowanie

67

Wszystkie drzewa

swobodne o pięciu

liściach.

Drzewa sąsiadujące

(poprzez transformację

zamiany najbliższych

sąsiadów ) są połączone

krawędzią

Algorytm zachłanny

Monte Carlo przeszukuje

przestrzeń drzew

33