Rodzaje badań statystycznych

Wyróżnia się badania :

1. Pełne ( całkowite )

2. Częściowe

Badania pełne i częściowe mogą być :

1. Ciągłe ( np. rejestracja urodzeń, zgonów, małżeństw, itp. )

2. Okresowe ( np. spisy ludności , rolne, przemysłu )

3. Doraźne ( np. klęsk żywiołowych )

Wśród badań częściowych wyróżnia się :

1. Badania reprezentacyjne ( są bardzo wartościowe, bo pozwalają z dużym

prawdopodobieństwem uogólnić wyniki uzyskane ze zbiorowości próbnej na całą

populację generalną, są tańsze od badań całkowitych).

2. Badania monograficzne ( obejmują obserwację grupy społecznej, wsi , miasta ,

przykładem badania monograficznego jest badanie warunków życia ludności w

mieście Rzeszowie w pewnym momencie lub w okresie)

3. Badania ankietowe ( dość często wykorzystywana metoda badań , sprowadza się

głównie do zbierania informacji pierwotnych, ważnym problemem jest

wykształcenie umiejętności dobrego opracowania ankiety, zestaw pytań w

kwestionariuszy ankietowym powinien być umiejętnie sformułowany.

W Polsce badaniami ankietowymi zajmują się takie instytucje jak : OBOP, CBOS,

PPENTOR oraz inne ośrodki naukowe.

Procedury dobru próby

W badaniach statystycznych w praktyce posługujemy się próbą . Próba mała gdy

n 30 , gdy n>30 to mamy do czynienia z próbą dużą .

Od próby wymaga się , aby była reprezentatywna. Na reprezentatywność próby mają

wpływ dwa czynniki :

1. Sposób doboru próby

2. Liczebność próby

Wyróżnia się dwie procedury doboru próby :

1. Dobór celowy ( sprowadza się do tego , że o wyborze jednostek decyduje badacz,

opierając się na merytorycznej znajomości problematyki badawczej, próba ta nie

podlega prawu wielkich liczb )

2. Dobór losowy ( zgodny jest z zasadami doboru według metody reprezentacyjnej,

umożliwia zastosowanie metod statystyki matematycznej do wnioskowania, próba

ma charakter losowy, gdy każda jednostka populacji z jednakowym

prawdopodobieństwem różnym od zera może się w niej znaleźć. Wyodrębniona

próba podlega działaniu prawa wielkich liczb, co oznacza że wraz ze wzrostem

liczebności próby losowej (n) rośnie stopień jej reprezentatywności )

Przed pobraniem próby ważne jest określenie jednostki losowania Indywidualna

jednostka losowania pokrywa się z jednostką badania, a zespołową jednostką

losowania , gdy nie pokrywa się z jednostką badania ( np. losuje się mieszkania a

bada się ich osoby w nich zameldowane ).

Losowanie próby określa się jako operat losowania , przez który rozumie się

wykaz jednostek uwzględnionych przy losowaniu z możliwością ich identyfikacji

Na przykład , takim operatem losowania dla populacji mieszkańców Rzeszowa jest

spis ( ponumerowany) wszystkich mieszkańców tego miasta.

Sposób postępowania przy doborze próby losowej określa się mianem schematu

losowania. Podstawowe schematy losowania to:

1. losowanie indywidualne

2. losowanie nieograniczone ze zwracaniem ( zwane inaczej niezależnym lub

zwrotnym )

3. losowanie nieograniczone bez zwracania ( inaczej określane jako zależne )

4. losowanie warstwowe

5. losowanie systematyczne

6. losowanie grupowe

Klasyfikacja cech statystycznych

Cechy statystyczne można podzielić na:

1. ilościowe ( mierzalne, kwantytatywne ) – można je zmierzyć i wyrazić za pomocą

odpowiednich jednostek fizycznych ( np. kg, m, szt, t )

2. jakościowe ( kwalitatywne) – zwykle są określane słownie np. płeć, standard

mieszkania, pochodzenie społeczne, rodzaj kredytu itp.

Cechy ilościowe określa się jako zmienne, które można podzielić na :

skokowe ( dyskretne )

ciągłe

Cecha skokowa przyjmuje skończony i przeliczalny zbiór wartości na danej skali

liczbowej , przy czym jest to najczęściej zbiór liczb całkowitych nieujemnych ( np.

liczba dzieci w rodzinie , liczba usterek w konkretnym produkcie , wielkość gospodarstwa

domowego itp. )

Cecha ciągła przyjmuje wszystkie liczby rzeczywiste z określonego przedziału liczbowego

< a , b > , przy czym liczba miejsc po przecinku jest uzależniona od dokładności

pomiarów ( np. wiek , płaca, wzrost, plon pszenicy itp. )

Występuje również podział cech na :

stałe ( własności wspólne dla wszystkich jednostek statystycznych danej

zbiorowości statystycznej

zmienne ( własności , dzięki którym poszczególne jednostki różnią się między

sobą, przy czym dokładny stopień zmienności poszczególnych cech jest

możliwy lub niemożliwy do określenia )

Dla potrzeb pomiaru cech stosuje się cztery rodzaje skal : nominalną , porządkową,

interwałową i ilorazową .

Skala nominalna – skala stosująca wyłącznie opis słowny dla potrzeb identyfikacji

jednostki. Np. kobieta i mężczyzna . Nie są możliwe działania arytmetyczne na danych

opisanych na skali nominalnej.

Skala porządkowa – służąca do porządkowania danych. Na przykład ranking szkół

wyższych z punktu widzenia ich atrakcyjności.

Skala interwałowa - skala mająca własności skali porządkowej, gdyż możliwe jest

porządkowanie jednostek statystycznych opisanych w tej skali , a jednocześnie jest

możliwe określenie interwału ( przedziału ) liczbowego, w którym zawierają się

obserwacje.

Skala ilorazowa – skala ma cechy skali interwałowej, a ponadto iloraz ma tutaj określoną

interpretację. Dane opisane w skali ilorazowej przyjmują zawsze wartości liczbowe, np.

waga itp.

Szeregi statystyczne

Materiał liczbowy , otrzymany w wyniku przeprowadzonej obserwacji statystycznej lub

pomiaru, po opracowaniu i pogrupowaniu nazywamy szeregiem strukturalnym,

charakteryzuje on zbiorowość statystyczną pod względem wyróżnionej cechy jakościowej

i ilościowej.

Wyróżnia się dwa typy grupowania : grupowanie typologiczne ( według cechy jakościowej

) oraz grupowanie wariancyjne ( według cechy ilościowej )

Szeregiem szczegółowym prostym nazywamy uporządkowany nierosnąco lub niemalejąco

ciąg wartości badanej zmiennej. Oznaczmy symbolem X badaną zmienną , symbolem x i

( i=1,2,...,n) wartość tej zmiennej odpowiadającą i-tej jednostce statystycznej. Załóżmy,

że badano n jednostek statystycznych. Ciąg wartości tej zmiennej ;

x1 , x2, ..., xn

określa się szeregiem szczegółowym prostym, jeśli w powyższym ciągu każdy następny

element nie jest mniejszy od poprzedniego.

Przykład 1.

Załóżmy , że w pewnej miejscowości poddano obserwacji 16 rodzin ze względu na liczbę

dzieci i otrzymano następujące wyniki :

0,1,1,2,2,3,3,3,4,4,4,5,5,6,6,7

Powyższy ciąg wartości jest uporządkowany niemalejąco, jest więc szeregiem

szczegółowym prostym. W tym przypadku jednostką statystyczną jest rodzina, a cechą

liczba dzieci w rodzinie

Wśród szeregów strukturalnych cechy ilościowej wyróżnia się szereg szczegółowy ważony

oraz rozdzielczy.

Szereg szczegółowy ważony

Załóżmy, że wśród danych zawartych w szeregu szczegółowym prostym wyróżniono k

różnych wartości. Następnie grupujemy jednostki statystyczne odpowiadające

jednakowym wartościom cechy. Postępując w ten sposób otrzymujemy wyniki, które

można zaprezentować w poniższej tablicy

Tab. 1 Wyniki grupowania statystycznego

Wartości cechy Liczebność Częstość względna

xi

fi

fi / n

x1

f1

f1 / n

x2

f2

f2 / n

.

.

.

.

.

.

.

.

.

xk

fk

fk / n

n

Razem

f

i 1

i

k

f /n 1

n

i 1

i

Źródło; opracowanie włane

Druga i trzecia kolumna tej tablicy charakteryzuje strukturę zbiorowości n- elementowej

pod względem cechy X. Symbolem fi oznaczamy liczbę jednostek statystycznych , dla

których wartość cechy przyjęła wartość xi ( i = 1,2,...,n). Wartość tę nazywamy

liczebnością. Trzecia kolumna zawiera wielkości zwane liczebnościami względnymi lub

frakcjami. Suma tych wielkości jest równa 1. Mnożąc te wielkości przez 100,

otrzymujemy częstości w procentach . Częstości względne są wielkościami

niemianowanymi. Mogą być wykorzystane do porównań struktur zbiorowości różniących

się liczebnościami. Liczebności lub częstości zawarte w przedostatniej i ostatniej kolumnie

tej tablicy charakteryzują rozkład elementów zbiorowości pod względem danej cechy , lub

rozkład cechy.

Szereg rozdzielczy

Obszar zmienności wartości cech dzielimy na rozłączne przedziały w postaci

[ xi , xi 1 )

dla i=1,2,...,k. Są to przedziały prawostronnie otwarte. Jednostki statystyczne , których

wartości cechy przedstawia szereg szczegółowy prosty grupujemy wykorzystując

przedziały, które nazywać będziemy przedziałami klasowymi lub klasami. Wyniki

grupowania zawiera poniższa tablica

Tab.2

Wyniki grupowania statystycznego

Liczebność

Przedział klasowy

x1 x2

fi

środek przedziału

klasowego

xi*

f1

x1*

Częstość względna

fi / n

f1 / n

x2 x3

f2

.

.

.

.

.

.

xk xk 1

x2*

fk

k

Razem

i 1

f2 / n

.

.

.

.

.

.

xk*

fk / n

fi n

k

f /n 1

i 1

i

Źródło: Opracowanie własne

Wartość środkową oblicza się według następującej formuły :

xi

xi xi 1

2

( i=1,2,...,k)

Przy budowie szeregu rozdzielczego należy sobie odpowiedzieć na następujące pytania :

1. czy długości przedziałów mają być jednakowe ?

2. na ile klas należy podzielić obszar zmienności ?

W praktyce badań statystycznych wygodnie jest, gdy przedziały klasowe są jednakowej

długości. W przypadku , gdy przedziały nie są jednakowej długości, do opisu struktury

zbiorowości wykorzystać należy tzw. gęstość liczebności, definiowaną za pomocą

następującego wzoru :

gf i

fi

xi 1 xi

( i=1,2,...,n )

gdzie w mianowniku mamy długość i-tego przedziału, w liczniku zaś odpowiadającą mu

liczebność.

W badaniach statystycznych brak jest jednoznacznych kryteriów umożliwiających w

sposób jednoznaczny odpowiedzieć na pytanie o liczbę klas w szeregu rozdzielczym.

J. Spława Neyman zalecał przy tworzeniu szeregów rozdzielczych podział obszaru

zmienności na około 10 – 20 klas, w zależności od liczebności zbiorowości.

Oznaczmy symbolem „ h „ długość przedziału klasowego. Załóżmy, że wszystkie

przedziały mają mieć równą długość. W tym przypadku najczęściej zaleca się, aby

długość przedziału obliczać za pomocą następującej formuły :

h

max xi min xi

k

( i=1,...,n)

gdzie : w liczniku jest zakres zmienności wartości cechy, w mianowniku zaś liczba

wymaganych klas.

Jeśli decydujemy się na budowę przedziałów klasowych , to narażamy się na pewną

stratę informacji dotyczących pojedynczych wyników. Im większa jest rozpiętość

przedziału klasowego, tym ta strata może być bardziej dotkliwa.

Przedziały klasowe zapisuje się zazwyczaj z dokładnością do przyjętej jednostki

pomiarowej. Można budować rozkłady ( szeregi ) z przedziałami klasowymi domkniętymi

lub otwartymi.

Rozstęp wynosi

R= Xmax – Xmin . Rozstęp charakteryzuje jedynie wstępnie dyspersję

badanego rozkładu.

Odchylenie ćwiartkowe wyrażone jest następującym wzorem :

Qx

Q3 Q1

2

Najpierw należy obliczyć kwartyl trzeci i kwartyl pierwszy.

Grupy dochodów miesięcznych

na gospodarstwo domowe

0,5 – 1,0

1,0 – 1,5

1,5 – 2,0

2,0 – 3,0

3,0 – 4,0

4,0 – 5,0

5,0 – 6,0

6,0 – 7,0

7,0 – 8,0

8,0 – 9,0

Liczba kobiet Szereg

W%

skumulowany

0,9

0,9

4,0

4,9

8,8

13,7

21,5

35,2 Q1

23,5

58,7 Q2

20,3

79,0 Q3

10,8

89,8

5,2

95,0

2,8

97,8

2,2

100,0

Wzory:

Q1 x 0 (

N

i

cum n1 ) *

4

n0

3

i

Q3 x 0 ( * N cum n1 ) *

4

n0

Q1 2,0 (25 13,7) *

1

2,5255

21,5

Q3 4,0 (75 58,7) *

1

4,802

20,3

Odchylenie ćwiartkowe wynosi :

Qx

4,8 2,5255

1,1372

2

Oznacza to , że średnio miesięczne dochody kobiet różnią się od mediany o 1,27 tyś. zł.

Mediana dla badanego rozkładu wynosi :

M x 3 (50 35,2) *

1

3,63

23,5

Współczynnik zmienności ( względna miara dyspersji )wynosi:

Vx

Qx

* 100%

Mx

Vx

1,1372

* 100% 31,3278

3,63

Oznacza to , że 31,32 % mediany dochodów kobiet stanowi odchylenie standardowe.

Wyznaczenie dominanty według wzoru :

Dx x0 i

Dx 3 1 *

(n0 n1 )

(n0 n1 ) (n0 n1 )

(23,5 21,5)

3,3848

(23,5 21,5) (23,5 20,3)

Podstawowym miernikiem asymetrii jest różnica między średnią arytmetyczną a

dominantą, czyli :

m D( x) 3,81 3.38 0,43

Znak „ – „ przy wartości miernika oznacza asymetrię lewostronną , znak „+” asymetrię

prawostronną.

W rozpatrywanym przykładzie mamy do czynienia z asymetrią prawostronną , co oznacza

, że przewaga liczebności występuje w przedziałach klasowych poniżej średniej

arytmetycznej.

O sile i kierunku symetrii mówią współczynniki asymetrii. Współczynnik asymetrii

Pearsona wyznacza się według formuły :

Vs

m D( x)

( x)

Vs

3,81 3,38

0,259

1,66

Współczynnik asymetrii wykazuje skośność prawostronną.

Gdy rozkład jest symetryczny to , Vs = 0

Gdy rozkład jest asymetryczny – prawostronny., to Vs > 0

Gdy rozkład jest asymetryczny – lewostronny , to Vs < 0

Współczynników asymetrii jest kilka, a zastosowanie ich jest uzależnione od charakteru

badanego szeregu i możliwości wyliczenia poszczególnych parametrów.

Miarą asymetrii jest również współczynnik skośności obliczony na podstawie dominanty i

mediany, według wzoru :

3

M x D x

Vs 2

x

3

3,63 3,38

2

Vs

0,2259

1,66

Miarą asymetrii może być także moment trzeci centralny. Dla rozkładu przedziałowego

ma on postać następującą:

3

n

3

x

i 1

i

x ni

N

Tablica pomocnicza do wyznaczenia momentu trzeciego centralnego

x i

ni

x i x

xi x 3 * ni

0,75

1,25

1,75

2,50

3,50

4,50

5,50

6,50

7,50

8,50

Razem

0,9

4,0

8,8

21,5

23,5

20,3

10,8

5,2

2,8

2,2

100

-3,063

-2,563

-2,063

-1,313

-0.313

0,687

1,687

2,687

3,687

4,687

-25,863

-67,344

-77,263

-48,665

-0,720

6,581

51,851

100,879

140,336

226,519

306,313

Dla badanego szeregu moment trzeci centralny wynosi :

3

306,31333

3,06

100

Moment trzeci centralny można również zapisać w postaci momentów zwykłych w sposób

następujący:

3 m3 3m 2 m1 2(m1 ) 2

gdzie :

1

n

m1

x

i 1

i

N

n

* ni

m2

x

i 1

2

i

N

3

n

* ni

m3

x

i 1

i

N

* ni

Dla szeregu wynoszą odpowiednio :

m1 3,18

m2

1729,9

17,299

100

m3

9005,9

90,059

100

wobec tego otrzymujemy :

3 90,059 3 * 17,299 * 3,813 2(3,813) 2 3,06

Miarą względną asymetrii jest następująca formuła :

3

3

(x) 3

Dla rozpatrywanego szeregu wynosi :

3

3,06

0,66

(1,66) 3

Rozkład ma asymetrię prawostronną o natężeniu 0,66.

Dla szeregów dokładnie symetrycznych m3=0. W przypadku asymetrii prawostronnej m3

> 0, lewostronnej zaś m3 < 0.

Przykład 3.

Zbiór województw , w którym cechą badania była ich powierzchnia, został opisany przy

użyciu podstawowych charakterystyk liczbowych tj średniej arytmetycznej, która wynosi

6,286 tyś. km2 oraz odchylenia standardowego ,które jest równe 2, 138 tyś, km 2.W celu

dokładniejszego opisu rozkładu tej zbiorowości należy wyznaczyć miary koncentracji.

Powierzchnia Liczba

x i x i x

W tyś. km2

Wojewódz.

1-3

1

2 -4,286

3-5

14

4 -2,286

5-7

18

6 -0,286

7-9

10

8 1,714

9-11

5

10 3,714

11-13

1

12 5,714

49

m4

1 n

ni ( x i x ) 4

n i 1

m4

2823,554720

57,623566

49

ni ( x i x ) 4

337,449405

382,325213

0,12043

86,306453

951,344040

1066,009178

2823,554720

Względna miara koncentracji to stosunek momentu centralnego czwartego rzędu przez

odchylenie standardowe do potęgi czwartej, czyli :

K

m4

s4

Im wyższa wartość K , tym bardziej wysmukła jest krzywa liczebności , co wskazuje na

tendencję do skupienia się jednostek wokół średniej. Małe wartości wskazują na

spłaszczenie krzywej rozkładu , a zatem słabą koncentrację. Zakłada się ,że dla rozkładu

normalnego K=3, dla bardziej od niego spłaszczonego K < 3 oraz dla wysmukłego K > 3.

W związku z powyższym skonstruowany współczynnik koncentracji o postaci :

Ku

m4

3

s4

przyjmuje wartość zero, jeżeli rozkład ma kształt normalny ,K u > 0 , jeżeli rozkład jest

bardziej wysmukły, oraz Ku < 0 , gdy rozkład jest spłaszczony w stosunku do rozkładu

normalnego.

Ku

m4

57,623566

3

3 0,243

4

20,897960

s

Koncentracja w porównaniu z krzywą normalną jest słabsza, a zatem rozkład jest

spłaszczony.

Inną miarą koncentracji jest współczynnik koncentracji Lorenca. Zjawisko koncentracji

może być rozważane jako nierównomierny podział ogólnej sumy wartości zmiennej x

pomiędzy poszczególne jednostki zbiorowości statystycznej. Ma to miejsce przy badaniu

dochodów, koncentracji produkcji, gęstości zaludnienia, rozmieszczenia bogactw

naturalnych itp. Tak rozumiana koncentracja jest zwykle przedstawiana i mierzona za

pomocą krzywej koncentracji Lorenza. Kształt krzywej określa natężenie koncentracji.

Współczynnik koncentracji Lorenza ( KL ) można wyrazić za pomocą wzoru:

KL

a

ab

gdzie :

a – pole zawarte między linią równomiernego podziału a krzywą Lorenza

b – pole pod krzywą Lorenza

a+b – pole trójkąta

Wyznaczenie pola a nie jest łatwe. Częściej wyznaczamy przybliżoną wartość pola b,

budując w tym celu w układzie współrzędnych prostokąty o podstawie równej

wskaźnikowi struktury dla liczby jednostek znajdujących się w przedziale, a wysokość

jest średnią ze skumulowanych wartości wskaźników struktury wielkości badanego

zjawiska grupy badanej i poprzedniej. Obliczenie powierzchni pola b można opisać

następującym wzorem:

b

skum.Wi skumWi 1 ˆ

Wi

2

gdzie :

skum.Wi – kolejne skumulowane wartości wskaźników struktury wielkości badanego

zjawiska

Ŵi - kolejne wartośći wskaźników struktury dla liczby badanych jednostek

Współczynnik ten jest względną miarą koncentracji zjawiska. W praktyce zawiera się

0 Kl 1

Przykład 4.

Struktura zatrudnienia w badanych firmach została scharakteryzowana za pomocą

następujących liczb zawartych w poniższej tablicy. Należy określić stopień koncentracji

zatrudnienia w badanych firmach w 1995 roku .

Liczba zatrudnionych

pracowników

w badanych firmach

do

4

5 - 10

11-15

16 - 50

51 -100

101 - 200

201 - 500

501 -1000

1001 - 2000

2001 - 5000

5001 i więcej

Firmy Zatrudnienie

w% w%

37,7

20,5

7,2

17,4

7,0

4,3

3,1

1,5

0,7

0,4

0,2

100

1,0

2,0

1,3

7,0

6,8

8,2

13,2

14,3

13,7

17,7

14,8

100

Źródło: Dane umowne

Tablica pomocnicza do wyznaczenia do wyznaczenia współczynnika Lorenza

Firmy w Zatrudnienie w Skum. Skum. skum.Wi skumWi 1

skumWi skumWi 1

%

%

Wi

Ŵ

Ŵi

Wi

2

i

37,7

20,5

7,2

17,4

1,0

2,0

1,3

7,0

37,7

58,2

65,4

82,8

1,0

3,0

4,3

11,3

7,0

4,3

6,8

8,2

89,8

94,1

18,1

26,3

3,1

13,2

97,2

39,5

(1+0)/2=0,5

( 3,0+1,0)/2=2,0

( 4,3+3,0)/2=3,65

( 11,3 + 4,3 )

/2=7,80

14,7

2

* Wˆ i

0.5*37,7=18,85

2,0*20,5=41,00

3,65*7,2=26,28

7,80*17,4=135,72

102,90

95,46

22,20

101,99

32,90

1,5

14,3

98,7

53,8

69,975

46,65

0,7

13,7

99,4

67,5

42,455

60,65

0,4

17,7

99,8

85,2

30,54

76,35

0,2

14,8

100,0

100,0

18,52

92,80

100

100

Źródło: Obliczenia własne

683,69

Obliczona powierzchnia b wynosi 683,69, wobec tego współczynnik koncentracji wynosi:

Pole trójkąta ( a + b)=5000, wobec tego

K

(a b) b 5000 683,69

a

0,863

ab

ab

5000

Oznacza to dość wysoką koncentrację badanego zjawiska.

Inną miarą koncentracji jest współczynnik koncentracji Lorenza. Może być on

wykorzystywany do badań w zakresie koncentracji własności ziemskiej, bogactw

naturalnych czy kapitału. Punktem wyjścia do ilościowego badania koncentracji jest

ustalenie, w jaki sposób rozkłada się ogólna suma wartości badanej cechy na

poszczególne jednostki zbiorowości statystycznej.

Do oceny stopnia natężenia tak rozumianej koncentracji stosuje się krzywą koncentracji

lub krzywą Lorenza. Kształt linii łamanej określa natężenie koncentracji Jeżeli na każdą

jednostkę zbiorowości przypada taka sama część ogólnej sumy wartości cechy , to

zamiast krzywej koncentracji otrzymamy linię prostą przechodzącą przez początek układu

współrzędnych pod kątem =45 w stosunku do osi odciętych. Jest to tzw. Linia

równomiernego rozkładu wartości cechy dla poszczególnych jednostek zbiorowości.

Stosunek pola zawartego między krzywą koncentracji a linią równomiernego rozkładu do

ogólnego pola trójkąta nosi nazwę współczynnika koncentracji Lorenza.Można go

wyznaczyć w sposób następujący:

KL

a 0,5 b

0,5

0,5

gdzie :

a – powierzchnia pola zawartego między krzywą koncentracji a linią

rozkładu

b – powierzchnia pola leżącego pod krzywą koncentracji

równomiernego

Współczynnik ten zawiera się w przedziale [ 0, 1 ]. Procedurę wyznaczania współczynnika

przedstawimy na przykładzi

Przykład 4.Na podstawie danych dotyczących osób pobierających renty z tytułu

niezdolności do pracy według wysokości świadczeń we wrześniu 1997 roku należy ocenić

stopień koncentracji wysokości świadczeń z ubezpieczenia społecznego.

Obliczenia pomocnicze do wyznaczenia współczynnika koncentracji.

Wysokość

Liczba

Łączna

Odsetki Odsetki Skum. Skum. Pole

Świadczenia

Pobier. Renty Wysok.

Liczby

Łączn.

figury b

wi

zi

Brutto

Z tytuł.niezd. Świadcz.

Pobier. Wysok.

Z ubezp.społ. Do pracy

Brutto

Renty

Świadcz.

ni

ni z i

x i * ni

wi

1

1

1

1

400-450

450-500

500-550

550 -600

600-650

650-700

700-750

750-800

800-900

900-1 000

000 – 1 100

100 - 1 200

200 – 1 300

300 – 1 400

255,6

387,5

191,0

142,6

104,9

88,8

61,9

48,4

72,6

48,4

40,3

29,6

29,6

29,6

108 630,0

184 062,5

100 275,0

81 955,0

65 562,5

59 940,0

44 877,5

37 510,0

62 710,0

45 980,0

42 315,0

34 040,0

37 000,0

39 960,0

N

0,159

0,241

0,119

0,089

0,065

0,055

0,038

0.030

0,0,45

0,030

0,025

0,018

0,018

0,018

0,101

0,172

0,093

0,076

0,061

0,056

0,042

0,035

0,058

0,043

0,039

0,032

0,034

0,037

0,159

0,400

0,518

0,607

0,672

0,727

0,766

0,796

0,841

0,871

0,896

0,915

0,933

0,952

0,101

0,273

0,366

0,443

0,504

0,560

0,602

0,636

0,694

0,737

0,776

0,808

0,843

0,880

0.0080

0.0451

0.0379

0,0359

0,0309

0,0294

0,0223

0,0186

0,0300

0,0215

0,0190

0,0146

0,0152

0,0158

1 400 – 1 500 16,1

23 345,0

0,010

0,022

1 500 – 1 600 10,7

16 585,0

0,007

0,015

1 600 – 1 700 5,6

9 240,0

0,003

0,009

1 700 – 1 800 45,6

79 800,0

0,028

0,074

Ogółem

1 608,8

1 072 828,5 1,000

1,000

Zaliaś A. : Metody statystyczne. PWE, Warszawa, s.75.

0,962

0,968

0,972

1,000

0,902

0,917

0,926

1,000

0,0089

0,0060

0,0032

0,0273

0,3896

Pole figury b pod krzywą Lorenza , można w przybliżeniu wyznaczyć w sposób

następujący:

k

KL

0,5 (

i 1

cumzi cumzi 1

) * wi

2

0,5

gdzie :

cum zi – względna wartość szeregu skumulowanego obliczonego w sposób następujący

zi

x i * ni

k

x

i 1

i

* ni

wi - liczebności względne obliczone następująco:

wi

k

ni

, przy czym N n i

N

i 1

W naszym przykładzie mamy :

18

b p i 0,3896

i 1

a=0,5-0,3896=0,1104

KL

0,1104

0,2208

0,5

Uzyskany wynik wskazuje na słaby stopień koncentracji, co odpowiada równomiernemu

podziałowi łącznej wysokości świadczenia brutto z ubezpieczenia społecznego między

pobierających renty z tytułu niezdolności do pracy.

Rachunek prawdopodobieństwa

1.

2.

3.

4.

Krótki rys historyczny

Podstawowe wiadomości o zdarzeniach

Pojęcie prawdopodobieństwa

Podstawowe twierdzenia rachunku prawdopodobieństwa

!. Krotki rys historyczny

Rachunek prawdopodobieństwa jest dziedziną matematyki. Z rachunkiem

prawdopodobieństwa związane są takie nazwiska francuskich matematyków jak :

B.Pascal ( 1623 – 1662 ) i P. Fermat ( 1601 – 1661 ).

Duży wkład w rozwój tej dyscypliny przypisuje się również szwajcarskiemu

matematykowi J. Bernoulliemu ( 1654 – 1705.W pracy „ Traktat o sztuce przewidywania

„ można znaleźć podstawowe twierdzenia rachunku prawdopodobieństwa zwane „

prawem wielkich liczb „. Wielkie zasługi w rozwój teorii prawdopodobieństwa położył

również P.S. Laplace ( 1749 – 1705 ) oraz K.F. Gauss ( 1777 – 1855 ). Gauss uważany

jest za twórcę teorii błędów obserwacji i metody najmniejszych kwadratów. Na uwagę

zasługuje nazwisko S.D. Poissona ( 1781 –1840 ), francuskiego matematyka , którego

imieniem został nazwany jeden z najważniejszych rozkładów statystycznych.

Studiując historię rachunku prawdopodobieństwa ważne wydaje się wymienienie prac

członka Petersburskiej Akademii Nauk , szwajcara z pochodzenia , L. Eulera ( 1707 –

1783) Całki Eulera nazywa się tzw. Funkcją gamma i funkcją beta. Funkcje te mają duże

zastosowanie w statystyce matematycznej.

Za twórcę rosyjskiej szkoły probabilistycznej uznać należy P. Czejbyszewa (1821 – 1894)

Wybitni matematycy radzieccy, A. Kołmogorow, N. Smirnow i inni stworzyli radziecką

szkołę teorii prawdopodobieństwa, która należy do czołowych w świecie.

Osiągnięcia współczesnej probabilistyki w Polsce są związane z imieniem profesora

Uniwersytetu Wrocławskiego H.Steinhausa i jego uczniów.

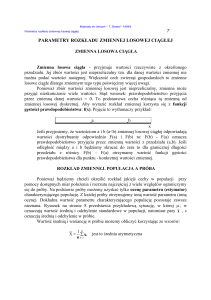

Zmienna losowa jest to zmienna, która przyjmuje różne wartości liczbowe, wyznaczone

przez los.

Zmienną losową można traktować jako pewną funkcję określoną na przestrzeni próby

związanej z eksperymentem. Przyporządkowanie prawdopodobieństw różnym możliwym

wartością zmiennej losowej, czyli „probabilistyczne prawo rządzące zmienną losową „

nazywamy rozkładem prawdopodobieństwa zmiennej losowej.

Zmienna losowa może być :

Skokowa ( dyskretna )

Ciągła

Zmienna losowa jest skokowa ( dyskretna ), gdy może przyjmować wartości ze zbioru

najwyżej przeliczalnego.

Zmienna losowa ciągła może przyjmować wartości z dowolnego przedziału liczbowego.

Możliwe wartości takiej zmiennej tworzą zbiór nieprzeliczalnie nieskończony.

Rozkładem prawdopodobieństw zmiennej losowej skokowej, zwanym też funkcją rozkładu

masy prawdopodobieństwa jest tablica, wzór lub wykres, który przyporządkowuje

prawdopodobieństwa każdej możliwej wartości zmiennej.

Zmienne losowe będziemy oznaczać dużymi literami, najczęściej literą X, chociaż mogą

być użyte inne litery. Małych liter będziemy używać do oznaczenia poszczególnych

wartości przybieranych przez zmienne losowe. Zapis P(X=x) oznacza

prawdopodobieństwo, że zmienna losowa X przyjmuje pewną określoną wartość x. Na

przykład zapis P(X=5)=0,2 oznacza, że prawdopodobieństwo , iż zmienna losowa X

przyjmuje wartość 5 jest równe 0,2. Można używać skróconych zapisów, np. P(5)=0,2

Rozkład prawdopodobieństwa skokowej zmiennej losowej X spełnia następujące

warunki

P( X ) 0 dla wszystkich wartości x

(1)

P( X ) 1

wszystkiex

(2)

Przykład 1. Załóżmy, że w poniższym zestawieniu wymieniono możliwe liczby ogłoszeń

zamieszczonych dziennie w gazecie i odpowiadające im prawdopodobieństwa

X

0

1

2

3

4

5

P(X)

0,1

0,2

0,3

0,2

0,1

0,1

Jest to rozkład prawdopodobieństw zmiennej losowej X. Można zauważyć, że wszystkie

prawdopodobieństwa są nieujemne i sumują się do jedności. Zmienne losowa nie

przyjmuje wartości większych od 5, co oznacza, że nie zamieszcza się nigdy więcej niż 5

ogłoszeń dziennie. Prawdopodobieństwo zamieszczenia dwóch ogłoszeń wynosi 0,3, a

trzech ogłoszeń – 0,2.Powstaje pytanie , skąd się biorą prawdopodobieństwa

Redakcja gazety codziennie rejestruje liczbę zamieszczonych ogłoszeń. Częstości z

jakimi pojawiają się w długim szeregu dni różne liczby ogłoszeń ,łatwo obliczyć z

tych rejestrów. Częstości te uznajemy za prawdopodobieństwa ukazania się

odpowiednich liczb zamieszczonych ogłoszeń.

W innych sytuacjach prawdopodobieństwa można wyprowadzić z pewnych

teoretycznych rozważań. Takie rozkłady są tablicowane i można je znaleźć w

każdym podręczniku statystyki.

Dystrybuanty ( skumulowane funkcje rozkładu )

Skumulowaną funkcją rozkładu ( dystrybuantą ) skokowej zmiennej losowej X jest

funkcja

F ( x) P( X x) Pi

(3)

i x

Dla przykładu 1 dystrybuanta liczby ogłoszeń zamieszczonych dziennie w gazecie wynosi

x

0

1

2

3

4

5

P(x)

0,1

0,2

0,3

0,2

0,1

0,1

F(x)

0,1

0,3

0,6

0,8

0,9

1,0

Należy zauważyć, że każda wartość F(x) jest sumą wszystkich wartości P(i) dla i

mniejszych lub równych x. Na przykład

F (3) P( X 3) P(0) P(1) p(2) P(3) 0,1 0,2 0,3 0,2 0,8

Oczekiwana wartość i odchylenie standardowe zmiennej losowej

Oczekiwana wartość skokowej zmiennej losowej X jest równa sumie wszystkich

możliwych wartości tej zmiennej mnożonych przez ich prawdopodobieństwa

E( X )

xP( x)

(4)

wszystkiex

Wykorzystując dane z przykładu 1 wyznaczamy oczekiwaną liczbę ogłoszeń w gazecie (

zgodnie z wzorem 4 )

Obliczenie oczekiwanej ( średniej ) liczby ogłoszeń w gazecie

x

P(x)

X P(x)

0

0,1

0

1

0,2

0,2

2

0,3

0,6

3

0,2

0,6

4

0,1

0,4

5

0,1

0,5

1,0

3,3

Z tablicy wynika, że

E ( x) 2,3 . Możemy powiedzieć, że przeciętnie

dzienne

zamieszcza się 2,3 ogłoszenia.

Oczekiwana wartość funkcji skokowej zmiennej losowej h(x) jest :

E h( x)

h( x ) P ( x )

(5)

wszystkiex

Przykład 2. Miesięczna sprzedaż pewnego produktu charakteryzuje rozkład

prawdopodobieństwa podany w poniższej tablicy.

Sprzedaż

5000

6000

7000

8000

9000

P(x)

0,2

0,3

0,2

0,2

0,1

1,0

Przypuśćmy, że firma ponosi stały miesięczny koszt produkcji równy 8000 $ i że na

każdej wyprodukowanej jednostce zarabia 2 $. Jaki jest miesięczny oczekiwany zysk

firmy ?

Funkcja zysku ze sprzedaży produktu jest dla firmy funkcja h(x)=2x – 8000.

Tablica pomocnicza do wyznaczenia oczekiwanego zysku

x

h(x)

P(x)

h(x)P(x)

5 000

2 000

0,2

400

6 000

4 000

0,3

1 200

7 000

6 000

0,2

1 200

8 000

8 000

0,2

1 600

9 000

10 000

0,1

1 000

5 400 = E[h(x)]

W przypadku liniowej funkcji zmiennej losowej, obliczenie oczekiwanej wartości funkcji

h(x) można uprościć, korzystając ze wzoru na oczekiwaną wartość funkcji zmiennej

losowej.

Oczekiwana wartość liniowej funkcji zmiennej losowej :

E(a X +b) = a E(x)+b

(6)

Gdzie a i b są ustalonymi liczbami. W rozpatrywanym przykładzie 2 mamy ;

E [ h (x)] = E[2x – 8 000 ] = 2 E (x) – 8 000 = 2 * 6 700 – 8 000 = 5 400 $ .

Wariancja

i odchylenie standardowe zmiennej losowej

Wariancja zmiennej losowej jest oczekiwana wartość kwadratu odchylenia tej zmiennej

od jej średniej . Pojęcie to jest podobne do pojęcia wariancji w zbiorze wyników

obserwacji ( w próbie lub populacji ) .

Wariancją skokowej zmiennej losowej X jest :

2 V ( X ) E[( X ) 2 ]

x P ( x)

2

( 7)

wszystkiex

Dla przykładu 1 mamy :

x

x

P(x)

(x ) 2

( x ) 2 P( x)

0

1

2

3

4

5

5,29

1,69

0,09

0,49

2,89

7,29

0,529

0,338

0,027

0,098

0,289

0,729

0,1

0,2

0,3

0,2

0,1

0,1

-2,3

-1,3

-0,3

0,7

1,7

2,7

2,01

Wygodny do stosowania wzór obliczania wariancji zmiennej losowej :

2 V ( x) E ( X 2 ) [ E ( X )] 2

(8)

Zgodnie z wzorem (8) wyznaczamy dla przykładu 1 wariancję liczby ogłoszeń w gazecie.

Obliczenia pomocnicze

X P(X) X P(X) X2P(X)

0 0,10 0

0

1 0,20 0,20

0,20

2 0,30 0,60

1,20

3 0,20 0,60

1,80

4 0,10 0,40

1,60

5 0,10 0,50

2,50

1,00 2,30

7,30

V ( X ) E ( X 2 ) [ E ( X )] 2 7,30 2,3 2 2,01

Dla zmiennych losowych standardowe odchylenie określamy jako dodatni pierwiastek

kwadratowy z wariancji . Standardowe odchylenie zmiennej losowej wyraża się wzorem:

S ( x) 2

(9)

W rozpatrywanym przykładzie 1 wynosi

2,01 1,418

Wariancję liniowej funkcji zmiennej losowej

wzoru :

V (ax b) a 2V ( x) a 2 2

ax b wyznaczyć można z następującego

( 10 )

gdzie a i b są ustalonymi liczbami.

Wariancja jako średnie kwadratowe odchylenie wartości zmiennej losowej od jej wartości

średniej jest miarą rozproszenia możliwych wartości zmiennej. Wariancja daje

wyobrażenie o zmienności a tym samym o niepewności związanej z przyszłymi

wartościami zmiennej, które mogą tym bardziej odbiegać od przeciętnej, im wyższa jest

wariancja.

Posługiwanie się odchyleniem standardowym często jest wygodniejsze z tego powodu, że

wariancja jest wielkością „kwadratową” Odchylenie standardowe jest łatwiejsze do

interpretacji z punktu widzenia ekonomicznego. Na przykład : standardowe odchylenie

stopy przychodu z określonej lokaty kapitału powszechnie jest uznawane za miarę ryzyka

związanego z tą lokatą.

Twierdzenie Czebyszewa

Znajomość odchylenia standardowego pozwala wyznaczyć granice, w których możliwe

wartości zmiennej losowej mieszczą się z pewnym określonym prawdopodobieństwem.

Granice te wyznacza twierdzenie Czebyszewa . Twierdzenie to powiada, że dla dowolnej

liczby k większej od jedności prawdopodobieństwo, że wartość zmiennej losowej odchyla

się od wartości o mniej niż o k odchyleń standardowych, jest nie mniejsze niż 1 – 1/k2.

Możemy to twierdzenie zapisać następująco : dla dowolnej zmiennej losowej o średniej

i odchyleniu standardowym oraz dla dowolnej liczby k 1 :

P( X k ) 1 1 / k 2

( 11 )

Wybrane rozkłady zmiennej losowej skokowej

Podstawowymi rozkładami zmiennej losowej skokowej są:

Rozkład jednopunktowy

Rozkład dwupunktowy

Rozkład dwumianowy ( Bernoulliego )

Rozkład Poissona

Rozkład jednopunktowy

Zmienna losowa X przyjmuje tylko jedną wartość x1 z prawdopodobieństwem równym 1,

czyli :

( 12 )

P( X x1 ) 1

Łatwo wykazać , że

E( X ) x1

,

2 0

Dystrybuanta F(x) w tym przypadku ma postać :

x x1

{ 1 dla x x1

F(x)= { 0 dla

( 13 )

Rozkład dwupunktowy

Mówimy, że zmienna losowa X podlega rozkładowi X podlega rozkładowi

dwupunktowemu, jeśli zbiór wartości { x1 , x2 } jest dwuelementowy , przy czym :

P(X=x1)=q

( 14 )

P(X=x2)=p

( 15 )

oraz p+q=1

Szczególnym przypadkiem rozkładu dwu – punktowego jest tzw. Rozkład zero –

jedynkowy , gzie przyjmuje się, że x 1 = 0 oraz x2 = 1 .

Mamy więc :

P(X=0)=q

( 16 )

P(X=1)=1

( 17 )

Przy czym p + q = 1 , skąd q = 1 – p

Podstawowe charakterystyki liczbowe zmiennej podlegającej rozkładowi zero –

jedynkowemu:

E(X)=p

2 pq

( 18 )

( 19 )

Dystrybuanta w tym przypadku ma postać następującą :

F(x) = { 0

dla

{ 1 – p dla

{ 1

dla

x0

0 x 1

x>1

Rozkład dwumianowy

Przypuśćmy, że wykonujemy n niezależnych doświadczeń ( np. rzucamy 10 razy kostką

do gry albo wykonujemy 7 rzutów monetą itp. ). Przyjmujemy, że każde z tych

doświadczeń może zakończyć się sukcesem albo porażką, przy czym

prawdopodobieństwo wystąpienia sukcesu w każdym z wykonywanych doświadczeń jest

takie samo i wynosi p(0 p 1) .

Zmienną losową definiujemy jako liczbę sukcesów uzyskanych przy wykonywaniu n

doświadczeń.

Dwumianowy rozkład prawdopodobieństwa :

n

n!

P( X ) p x q n x

pq n x

x

x

!

(

n

x

)!

( 20 )

gdzie p jest prawdopodobieństwem sukcesu w jednym doświadczeniu, q=1-p, z kolei n

jest liczbą doświadczeń, a x jest liczbą sukcesów .

Rozkład zdefiniowany wzorem ( 20 ) jest rozkładem dwumianowym lub rozkładem

Bernoulliego. Nazwa pochodzi od matematyka Jacquesa Bernoulliego ( 1654 – 1705 ).

Doświadczenia Bernoulliego to ciągi identycznych doświadczeń spełniających nastęoujące

warunki :

1. Są dwa możliwe wyniki każdego doświadczenia, nazwane sukcesem lub porażką.

Wyniki te wykluczają się i dopełniają.

2. Prawdopodobieństwo sukcesu oznaczone przez p, pozostaje takie samo od

doświadczenia do doświadczenia. Prawdopodobieństwo porażki, oznaczone przez

q, równe jest 1-p

3. Doświadczenia są od siebie niezależne. Znaczy to , że wynik któregokolwiek

doświadczenia nie ma wpływu na wyniki pozostałych doświadczeń .

Średnia, wariancja i kształt rozkładu dwumianowego

Średnia rozkładu dwumianowego jest to iloczyn liczby doświadczeń n i

prawdopodobieństwa sukcesu w pojedynczym doświadczeniu p.

Wariancja jest iloczynem liczby doświadczeń n , wartości p oraz q . Prawdziwe są

poniższe wzory :

Średnia rozkładu dwumianowego :

E ( x) np

( 21 )

Wariancja rozkładu dwumianowego :

1 V ( x) npq

( 22 )

Odchylenie standardowe rozkładu dwumianowego :

npq

( 23 )

Kształt rozkładu prawdopodobieństwa dwumianowej zmiennej losowej jest symetryczny

przy p=1/2. Rozkład jest skośny prawostronnie przy p < ½ , a lewostronnie przy p >

½ gdy liczba doświadczeń n jest niewielka.

Dwumianowy rozkład prawdopodobieństwa jest jednym z najpowszechniej stosowanych

rozkładów w badaniach statystycznych.

Rozkład Poissona

Rozkład Poissona jest wygodny do scharakteryzowania zmiennej losowej będącej liczbą

zajść pewnego zdarzenia w określonym przedziale czasu . Taką zmienną jest liczba awarii

urządzenia przemysłowego w ciągu tygodnia, liczba wypadków samochodowych w ciągu

miesiąca, itp. Rozkład Poissona jest też dobrym przybliżeniem rozkładu dwumianowego,

gdy liczba doświadczeń n jest duża ( n 20) , a prawdopodobieństwo „ sukcesu „ (

zajścia interesującego nas zdarzenia ) jest niewielkie ( p 0,05) .

Rozkład Poissona:

P ( x)

x e

x!

dla x= 0,1,2,3,...,

(24 )

jest średnią rozkładu ( i równocześnie jego wariancji ), e jest podstawą

logarytmów naturalnych ( e 2,71828... )

gdzie

Przykłady

Przykład 1. Klientami sklepu spożywczego są kobiety i mężczyźni > Na podstawie

wcześniejszych badań wiadomo ,że prawdopodobieństwo zakupu żywności przez kobietę

w tym sklepie wynosi 0,6 .

a) Co jest zmienną losową ?

b) Wyznaczyć wartość oczekiwaną i wariancję badanej zmiennej losowej ?

Rozwiązanie :

a) ) Zmienną losową jest płeć klienta. Przyjmuje ona wartość 1 w przypadku kobiet oraz

0 , gdy do sklepu wchodzi mężczyzna. Jest to przykład zmiennej zero – jedynkowej .

b) E ( X ) p 0,6

oraz V ( X ) p (1 p ) 0,6 * 0,4 0,24

Przykład 2.

Sprzedawca pewnego dobra trwałego użytku kontaktuje się z 8 potencjalnymi klientami

dziennie. Z wcześniejszych doświadczeń wiadomo , że prawdopodobieństwo zakupu tego

dobra przez potencjalnego klienta wynosi 0,10.

a) jakie jest prawdopodobieństwo tego, że sprzedawca przeprowadzi dokładnie 2

transakcje sprzedaży dziennie ?

b) Jaki odsetek stanowić będą dni, w których sprzedawca nie dokona żadnej

transakcji sprzedaży ?

c) Jakiej średniej liczby sprzedanych dóbr trwałego użytku dziennie może się

spodziewać sprzedawca ?

Rozwiązanie :

a) Korzystając ze wzoru na prawdopodobieństwo w rozkładzie dwumianowym mamy

:

P( X 2)

8!

* (0,1) 2 * (0,9) 8 2

2! (8 2)!

Zamiast przeprowadzania dość skomplikowanych obliczeń można również skorzystać z

tablic rozkładu dwumianowego odczytując ( P( X k ) dla n=8, k=2, p=0,1

Wobec tego mamy :

P( X 2) P( X 3) Q(2) Q(3) 0,18690 0,03809 0,14881

8!

* (0,1) 0 * (0,9) 8 0 0,43

b) P ( X 0)

0!(8 0)!

zatem 43 % ogółu dni roboczych stanowią takie dni , kiedy nie zostanie dokonana żadna

transakcja sprzedaży.

c) E ( X np 8 * 0,1 0,8

Przykład 3.

Wadliwość produkcji pewnego przedsiębiorstwa wynosi 3%. Z gotowych wyrobów

znajdujących się w magazynie sprzedano 40 sztuk.

a) Jakiej średniej liczby braków można się spodziewać w sprzedanej partii towarów

b) Jakie jest prawdopodobieństwo , że dokładnie 5 sztuk wadliwych znajdzie się w

sprzedanej partii towarów

Rozwiązanie :

a) E ( x) np 40 * 0,03 1,2

b)

P( X 5)

(1,2) 5 * e 1, 2

0,00625

5!

( por. tablicę w rozkładzie Poissona , dla

1,2 ; k 5 )

Inne podejście opiera się na rachunku dystrybuant. Korzystamy z tablic dystrybuanty w

tym rozkładzie i mamy :

P( X 5) P( X 5) P( X 4) F (5) F (4) 0,998 0,992 0,006

Zmienna losowa ciągła i jej rozkłady

1. Zmienna losowa ciągła , funkcja gęstości, dystrybuanta, podstawowe

charakterystyki

2. Rozkłady zmiennej losowej ciągłej

Rozkład normalny

Rozkład logarytmiczno – normalny

Rozkład chi – kwadrat

Rozkład Studenta

Rozkład Fishera – Snedecora

Inne ( np. rozkład serii, rozkład Darbina - Watsona

Zmienna losowa ciągła jest to taka zmienna , która przyjmuje wszystkie wartości z

pewnego określonego przedziału liczbowego.

Dla zmiennej losowej ciągłej pojawia się pojęcie funkcji gęstości. Funkcja gęstości jest to

przedziałami ciągła funkcja f(x), dzięki której można określić prawdopodobieństwo tego,

że zmienna losowa x znajdzie się w określonym przedziale.

Funkcja gęstości spełnia następujące warunki :

f ( x) 0

( 1)

f ( X )dx 1

(2)

Funkcja gęstości może być interpretowana jako podstawa do liczbowych ustaleń „

średniej gęstości prawdopodobieństwa z otoczenia punktu, zwanego środkiem przedziału

klasowego”.

Dystrybuanta dla zmiennej losowej ciągłej określana jest jako prawdopodobieństwo

tego, że zmienna losowa przyjmie wartości mniejsze lub równe x i

F ( x i ) P( X x i )

(3)

Dystrybuanta dla zmiennej losowej ciągłej jest całką z określoną górną granicą x ,

zapisaną w sposób następujący :

x

F ( x)

f ( x)dx

(4)

Dla prawdopodobieństwa w przedziale ( x1 ; x2 ) należy stosować formułę :

P{x1 x x 2 } F ( x 2 ) F ( x1 )

x2

f ( x)dx

( 5)

x1

Wartość oczekiwana zmiennej losowej ciągłej wyraża się następującym wzorem :

E ( x)

xf ( x)dx

(6)

Wariancja zmiennej losowej ciągłej jest wyznaczona zgodnie z formułą :

D 2 ( x) [ x E ( x)] 2 f ( x)dx

(7)

Odchylenie standardowe zmiennej losowej ciągłej dane jest wzorem :

D( x) D 2 ( x)

(8)

Rozkłady zmiennej losowej ciągłej

Rozkład normalny

Rozkład normalny wiąże się z nazwiskiem matematyka K.F. Gaussa ( 1777 – 1855 ) i

bywa najczęściej określany jako rozkład Gaussa. Rozkład normalny to jeden z

najważniejszych rozkładów zmiennej losowej ciągłej. Odgrywa on w zastosowaniach

statystyki ogromną rolę. Mówimy , że zmienna losowa x ma rozkład normalny z

parametrami i 0 , co zapisujemy X : N ( , ) lub X ~ N ( , ) , jeśli jej funkcja

gęstości jest określona następującym wzorem :

f ( x)

1

2

gdzie :

E (x)

D 2 ( x) 2

( x )2

*e

2 2

, dla x ( ;)

( 9)

3,144159...,

e 2,71828...

Krzywa gęstości prawdopodobieństwa rozkładu normalnego ma następujące własności :

1. Krzywa normalna jest krzywą w kształcie dzwonu, symetryczną względem prostej

przechodzącej przez punkt x , co znaczy, że jest spełniona równość :

P( X P( X ) 0,5 . Oś rzędnych jest oczywiście osią symetrii krzywej.

2. Obszar ograniczony wykresem funkcji f(x) i osią odciętych ma pole równe

jedności.

3. Funkcja gęstości prawdopodobieństwa rozkładu normalnego osiąga maksimum w

punkcie x . Obliczając pochodną funkcji (9) i przyrównując ją do 0 ,

sprawdzamy łatwo, że wartość maksymalna tej funkcji gęstości wynosi :

f ( )

1

2

4.Krzywa gęstości prawdopodobieństwa rozkładu normalnego ma 2 punkty przegięcia,

położone symetrycznie względem osi rzędnych , o odciętych x , w których

krzywa z wklęsłej przechodzi w wypukłą lub odwrotnie.

Parametr

rozkładu normalnego jest to średnia rozkładu czyli miara położenia. Mówi

o tym , gdzie leży centrum rozkładu na osi liczbowej. Ponieważ krzywa gęstości

normalnej jest symetryczna i ma jeden szczyt , w środku ,średnia jest

równocześnie medianą i dominantą rozkładu prawdopodobieństwa. Inaczej mówiąc,

jest też punktem, w którym gęstość jest największa i który dzieli pole pod krzywą

gęstości na połowy, z których każda ma miarę ½.Standardowe odchylenie jest miarą

zmienności , czyli rozproszenia zmiennej. Gdy standardowe odchylenie jest duże,

wykres funkcji gęstości jest „ szeroki „ , ale za to „ płaski „( Całe pole pod krzywą

musi mieć miarę równą 1 ). Gdy standardowe odchylenie jest małe, wykres funkcji

gęstości jest „ wąski „ ale „ wysoki „

Na uwagę zasługują także następujące własności rozkładu normalnego :

P( X ) 0,6826

P( 2 X 2 ) 0,9545

P( 3 X 3 ) 0,9973

W analizach szczególnie ważna jest reguła trzech odchyleń standardowych zwana także

reguła 3 sigm, której prawdopodobieństwo jest bardzo wysokie i praktycznie wynosi 1.

Jest ona wykorzystywana w badaniach empirycznych w celu eliminacji obserwacji

nietypowych, nie przystających do pozostałych ( wątpliwych , rzadkich , odstających ,

ekstremalnych ) , co do których istnieją przypuszczenia , że pochodzą z innej

zbiorowości. Za wątpliwe uznaje się takie obserwacje , których wartość różni się od

średniej o więcej niż 3 odchylenia standardowe.

Rozkład normalny standaryzowany

Rozkład normalny z wartością oczekiwaną

0 i odchyleniem standardowym 1 ,

czyli Z : N (0,1) , określony za pomocą formuły :

1

z2

1

f ( z)

*e 2

2

( 10 )

Każdy rozkład normalny

X : N ( , ) może być transformowany do rozkładu normalnego

Z : N (0,1) poprzez procedurę standaryzacji zmiennej X do Z. Czasami zamiast Z stosuje

się literę U ( unormowana ). Zmienna losowa standaryzowana wyraża się wzorem :

Z

X

( 11 )

Procedura standaryzacji ma swoje uzasadnienie w tym, że tylko rozkład normalny

standaryzowany jest stablicowany. Najczęściej korzysta się z tablic dystrybuanty .

Przykład 1.

Załóżmy , że mamy 100 pojedynczych wyników pomiarów pewnej wielkości. Efekty

obserwacji pogrupowano , a wyniki w postaci szeregu rozdzielczego przedziałowego

podano w poniższej tablicy. Zachodzi przypuszczenie , że rozkład liczby wszystkich

pomiarów ma rozkład normalny .

Tab.1. Szereg rozdzielczy wyników pomiaru pewnej wielkości ( w mm)

Wyniki pomiarów

Liczba wyników

xi , xi 1 )

xi

fi

79-81

81-83

83-85

85-87

87-89

89-91

91-93

93-95

95-97

97-99

1

4

9

15

24

21

13

9

3

1

100

80

82

84

86

88

90

92

94

96

98

xi f i

80

328

756

1 290

2 112

1 890

1 196

846

288

98

8 884

Źródło : A. Zeliaś : Metody statystyczne . PWE, Warszawa 2000 s. 221-222.

i szacujemy na podstawie wyników

zamieszczonych w powyższej tablicy ( tab.1 ) i otrzymujemy : x 88,84 i s 3,23258 .

Parametry rozkładu normalnego

Pozostałe obliczenia potrzebne do ustalenia , czy jest to rozkład normalny, znajdują się

w poniższej tablicy :

xi

fi

80

82

84

86

88

90

92

94

96

98

1

4

9

15

24

21

13

9

3

1

100

ui

xi x

s

-2,73466

-2,11596

-1,49726

-0,87855

-0,25985

0,35885

0,97755

1,59625

2,21495

2,83365

f (u i )

0,009606

0,042166

0,129518

0,270864

0,385683

0,373911

0,246809

0,112704

0,034710

0,007274

ni

fˆi

f (u i )

s

0.59

2,61

8,01

16,76

23,86

23,13

15,27

6,97

2,15

0,45

99,8

f i fˆi

0,41

1,39

0,99

-1,76

0,14

-2,73

-2,27

2,03

0,85

0,55

Z uwagi na to , że różnice między rozkładem empirycznym a teoretycznym , czyli

f i fˆi

od i= 1,2,...,10 są względnie duże , to nie można przyjąć , że rozkład liczby wyników

pomiarów nie jest rozkładem normalnym.

Rozkład chi – kwadrat

Rozkład chi – kwadrat

( 2 ) został opracowany przez statystyków A. Abbego ( 1863 ), H.

Helmerta ( 1875 ) , K. Pearsona ( 1900

Zakładając , że X1, X2 , ..., Xk są niezależnymi zmiennymi losowymi o rozkładzie

normalnym o parametrach

0 i 1 , zmienna losowa 2 określona w sposób

następujący :

k

2 X i2

( 12 )

i 1

ma rozkład

2

z k „ liczbą stopni swobody „

Zmienna losowa o rozkładzie chi- kwadrat przyjmuje wartości dodatnie , a jej rozkład

zależy od liczby stopni swobody k . Dla małych wartości k jest to rozkład silnie

asymetryczny , w miarę wzrostu k asymetria jest coraz mniejsza. Liczbę stopni swobody

k wyznaczamy najczęściej w sposób następujący :

k n 1

lub

k n p 1

gdzie :

n – liczebność próby

p – liczba szacowanych parametrów z próby

Liczba stopni swobody jest równa liczbie wszystkich parametrów ( która nie musi być

równa liczbie wyników obserwacji ) pomniejszonej o liczbę wszystkich ograniczeń

narzuconych na te parametry . Ograniczeniem jest każda wielkość , która zostaje

obliczona na podstawie tych samych pomiarów

Wartość oczekiwana w rozkładzie

E( 2 ) k

wyraża się następującą formułą :

( 13 )

Wariancja w rozkładzie

D 2 ( 2 ) 2k

2

2

jest wyrażona formułą :

( 14 )

Odchylenie standardowe w rozkładzie

2

to :

D ( ) 2k

( 15 )

Dla uproszczenia zapisów można się posługiwać formułą :

2 : 2 /( k ; 2k )

, co oznacza ,że

2

ma rozkład o k stopniach swobody . Rozkład

2

jest rozkładem asymetrycznym, przy czym wraz ze wzrostem k rozkład ten staje się

coraz bardziej zbliżony do symetrycznego, a dla k>30 zachodzi zależność :

2 : 2 ( k ; 2k ) X : N ( k ; 2k )

( 16 )

k

Oznacza to , że wraz ze wzrostem k ( powyżej 30 ) rozkład

asymptotycznie normalny o tych samych parametrach

2

przechodzi w rozkład

E ( ) k i D 2 ( 2 ) 2k .

2

Rozkład t – Studenta

Jest to ważny rozkład , który jest stosowany głównie do małych próbek . Rozkład t –

Studenta ( pseudonim angielskiego statystyka W. Gosseta ) jest rozkładem

symetrycznym względem prostej x=0, a jego kształt jest bardzo zbliżony do rozkładu

normalnego standaryzowanego ( jest nieco bardziej spłaszczony ).

2 : 2 ( k ; 2k )

Jeżeli Z :N(0;1) i

T

Z

są niezależnymi zmiennymi losowymi , to zmienna

k ma rozkład t- Studenta o k stopniach swobody .

2

Wartość oczekiwana w rozkładzie t- Studenta

E (T ) o

dla

k2 2

ma postać następującą:

( 17 )

Wariancja w rozkładzie t- Studenta ma postać następującą:

D 2 (T )

k

dla

k 2

k 3

( 18 )

Odchylenie standardowe w rozkładzie t- Studenta ma postać następującą :

D(t )

k

k 2

dla

k 3

( 19 )

Dla k >30 zmienna o rozkładzie t- Studenta ma rozkład zbliżony do rozkładu normalnego

standaryzowanego [ N : ( 0 , 1 ) ]

Dla różnych wartości k i różnych prawdopodobieństw stablicowane są wartości

dla których spełniona jest zależność

t takie ,

p(t / 2 T t / 2 ) dla k n 1 stopni

swobody.

Rozkład F – Snedecora

Y1 i Y2 są zmiennymi niezależnymi i mają rozkłady 2 o k1 i k 2

stopniach swobody , to zmienna losowa Fk1k 2 ma rozkład F – Snedecora :

Jeżeli zmienne

Fk1k 2

Y1 / k1

Y2 / k 2

gdzie

k1 i k 2 są stopniami swobody .

( 20 )

Wartość oczekiwana w rozkładzie F wyraża się

E(F )

k2

k2 2

dla

k2 2

następującą formułą :

( 21 )

Wariancja w rozkładzie F wyraża się następującym wzorem :

D 2 (F )

2k 22 (k1 k 2 2)

k1 (k 2 2) 2 (k 2 4)

dla

k 2 4 ( 22 )

W zależności od

k1 i k 2 stablicowano wartości zmiennej losowej F , w taki sposób , że

dla danych wartości prawdopodobieństw zależność P( Fk1k 2 F )

Dobór próby i rozkłady z próby

Estymacja punktowa i przedziałowa

We wnioskowaniu statystycznym – na podstawie znanej próby losowej , opisujemy za

pomocą statystyk nieznaną populację, z której została pobrana próba.

Parametry populacji ( np. średnia , odchylenie standardowe ) szacujemy korzystając ze

statystyk z próby . Gdy statystyka z próby jest wykorzystywana do oszacowania

parametru populacji , nazywa się estymatorem tego parametru.

Estymatorem parametru populacji jest statystyka z próby używana do oszacowania

tego parametru. Oceną lub szacunkiem parametru jest konkretna wartość liczbowa

estymatora z danej próby Jeżeli jako ocenę ( szacunek ) podajemy jedną wartość

liczbową, nazywamy ją oceną punktową ( szacunkiem punktowym ) parametru

populacji.

Średnia z próby , jest statystyką używaną jako estymator średniej w populacji.

Odchylenie standardowe z próby , służy jako estymator odchylenia standardowego w

populacji. Oprócz tych statystyk występują również inne np. częstość ( frakcja ).

Frakcją ( częstością ) w populacji p , jest liczba elementów populacji należących do

pewnej kategorii , którą się interesujemy, podzieloną przez liczbę wszystkich elementów

populacji .

Frakcja ( częstość ) w próbie wyraża się następującą formułą :

pˆ

x

n

(1)

gdzie x jest liczbą elementów próby , które należą do interesującej nas kategorii , a n

jest liczebnością próby.

Pobieranie próby losowej

Aby otrzymać próbę losową z całej populacji , powinniśmy dysponować wykazem

wszystkich elementów populacji . Taki wykaz nazywa się operatem losowania . Operat

losowania pozwala wybierać elementy z populacji przez losowe generowanie numerów

elementów, które znajdują się w próbie. Przypuśćmy, że chcemy pobrać prostą 100elementową próbę losową z populacji 7 000 ludzi. Sporządzamy wykaz tych 7 000 ludzi i

każdemu przypisujemy numer identyfikacyjny. Mamy wykaz 7 000 numerów, które

tworzą operat losowania. Następnie generujemy na komputerze lub w jakiś inny sposób

100 liczb losowych o wartościach od 1 do 7 000 . Taka procedura daje każdemu ze 100

ludzi tę samą szansę znalezienia się w próbie .

Do generowania liczb losowych może być użyty komputer lub tablica liczb losowych.

Rozkład statystyki z próby jest rozkładem prawdopodobieństwa wszystkich możliwych

wartości, jaka ta statystyka może przyjąć, jeżeli obliczamy je na podstawie badania

losowych prób o tych samych rozmiarach, pobranych z określonej populacji.

Rozkład średniej z próby , x , to rozkład prawdopodobieństwa wszystkich wartości , jakie

może przybrać losowa zmienna x , gdy próba o liczebności n jest pobierana z określonej

populacji .

Centralne twierdzenie graniczne - jeżeli pobieramy próbę z populacji o średniej

skończonym odchyleniu standardowym

i

, to rozkład średniej z próby , x , dąży do

i odchyleniu standardowym / n , gdy liczebność

2

próby wzrasta nieograniczenie , czyli , dla „ dostatecznie dużych n „ : x ~ N ( , / n)

rozkładu normalnego o średniej

Centralne twierdzenie graniczne zasługuje na uwagę , ponieważ stwierdza zmierzanie

rozkładu średniej z próby do rozkładu normalnego , niezależnie od rozkładu populacji, z

której pochodzi próba.

Trzy główne aspekty centralnego twierdzenia granicznego

1. Jeżeli liczebność próby jest dostatecznie duża , to rozkład średniej z próby , x ,

jest normalny

2. Oczekiwaną wartością średniej x jest

3. Odchyleniem standardowym średniej x jest

/ n

Historia centralnego twierdzenia granicznego jest związana z rozkładem normalnym jako

rozkładem granicznym rozkładu dwumianowego, gdy n rośnie nieograniczenie.

Aby wykorzystać centralne twierdzenie graniczne, powinniśmy znać standardowe

odchylenie w populacji, . Gdy nie jest znane, trzeba się posłużyć jego estymatorem z

próby , S. W takim przypadku rozkład standaryzowanej statystyki jest następujący :

x

(2)

S/ n

gdzie S zastępuje nieznane i nie jest standaryzownym rozkładem normalnym.

Jeśli rozkład w populacji jest normalny, to statystyka określona wzorem ( 2 ) ma rozkład

t – Studenta o n-1 stopniach swobody .

Centralne twierdzenie graniczne dla przypadku pobierania próby do oszacowania frakcji

elementów danej kategorii populacji , p jest sformułowane następująco :

Gdy liczebność próby n wzrasta , to rozkład frakcji z próby , p̂ , zbliża się do rozkładu

normalnego o średniej p o odchyleniu standardowym

p(1 p) / n

Z centralnego twierdzenia granicznego wynika , iż rozkład średniej z próby i rozkład

frakcji z próby zbliżają się do rozkładu normalnego , gdy wzrasta liczebność próby .

Estymatory i ich własności

Estymator jest nieobciążony , jeżeli jego wartość oczekiwana jest równa parametrowi

populacji , do oszacowania którego służy. Np. Średnia z próby jest nieobciążonym

estymatorem średniej z populacji .

Systematyczne odchylanie się wartości estymatora od szacowanego parametru nazywa

się obciążeniem estymatora .

Estymator jest efektywny , jeżeli ma niewielką wariancję ( a tym samym niewielkie

odchylenie standardowe )

Estymator jest zgodny , jeżeli prawdopodobieństwo , że jego wartość będzie bliska

wartości szacowanego parametru , wzrasta wraz ze wzrostem liczebności próby .

Estymator jest dostateczny , jeżeli wykorzystuje wszystkie informacje o szacowanym

parametrze , które są zawarte w danych ( w próbie )

Przykład 1.

W wylosowanych 9 punktach sprzedaży w pewnym mieście w określonym dniu zbadano

cenę produktu A i otrzymano następujące rezultaty :

Punkt

1

2

3

4

5

6

7

8

9

sprzedaży

Cena w zł 1,15

1,18

1,16

1,20

1,12

1,19

1,17

1,15

1,14

za 1 szt.

( xi)

Źródło : Dane umowne.

Korzystając z procedury estymacji punktowej , należy oszacować

1. przeciętną cenę produktu A za 1 szt. W określonym dniu w całej zbiorowości

( miasto )

2. odchylenie standardowe ceny produktu A w określonym dniu w badanym mieście

Ad 1. Wiedząc ,że estymacja punktowa sprowadza się do znalezienia jednej wartości

mogącej służyć do oszacowania nieznanej średniej ceny produktu A w całym mieście

zadanie sprowadza się do znalezienia średniej arytmetycznej na podstawie próby ( x ) .

Miara ta jest najbardziej użytecznym estymatorem średniej zbiorowości generalnej , gdyż

ma własność nieobciążoności i zgodności oraz jest relatywnie bardziej efektywna od

innych średnich ( mediany czy dominanty )

x

x

9

i

1,16 , co oznacza ,że w badanym mieście średnia cena jednej sztuki produktu

A wynosi 1,16 zl.

Ad.2. Zadanie sprowadza się , do obliczenia odchylenia standardowego ceny produktu na

podstawie wyników próby

xi

1,15

1,18

1,16

1,20

1,20

1,19

1,17

1,15

1,14

-0,01

0,02

0,00

0,04

-0,04

0,03

0,01

-0,01

-0,02

xi x

( xi x ) 2 0.0001 0,0004 0,0000 0,0016 0,0016 0,0009 0,0001 0,0001 0,0004 0.0052

Źródło : Obliczenia własne

S

(x

i

x) 2

n 1

0,0052

0,025 zł

8

Należy zauważyć , że wzór na estymator S różni się od klasycznego wzoru na odchylenie

standardowe , które wyznacza się w całej zbiorowości ( lub na podstawie wyników

pochodzących z dużej próby ) według formuły :

(x

i

x) 2

n

Odchylenie standardowe ceny produktu A w badanym mieście wynosiło 0,025 zł .

Oznacza to , że cena w poszczególnych punktach sprzedaży różniła się od średniego

poziomu , przeciętnie rzecz biorąc , o 0,025 zł.

Przykład 2.

W pewnej firmie w sposób losowy wybrano 15 rozmów telefonicznych, zbadano długość

ich trwania oraz ustalono , czy są to rozmowy lokalne czy też zamiejscowe . Poniższa

tablica prezentuje zebrane na ten temat informacje :

Kolejny numer

Czas trwania Rodzaj rozmów

rozmowy

( w min )

telefonicznej

1

2

miejscowa

2

12

zamiejscowa

3

10

miejscowa

4

3

miejscowa

5

5

zamiejscowa

6

6

miejscowa

7

3

miejscowa

8

5

miejscowa

9

8

miejscowa

10

4

miejscowa

11

5

miejscowa

12

4

miejscowa

13

5

miejscowa

14

4

miejscowa

15

9

zamiejscowa

Należy :

1. Oszacować przeciętny czas trwania wszystkich rozmów telefonicznych w tej firmie

2. Oszacować odchylenie standardowe czasu trwania wszystkich rozmów

telefonicznych w tej firmie

3. Oszacować odsetek ( procent ) rozmów zamiejscowych wśród ogółu rozmów

telefonicznych przeprowadzonych w tej firmie

4. Wyznaczyć błąd standardowy odsetka rozmów zamiejscowych wśród ogółu

rozmów telefonicznych przeprowadzonych w tej firmie

Ad.1. x

x

15

i

5,67 min . , co oznacza że przeciętny czas trwania wszystkich rozmów

telefonicznych w tej firmie wynosi 5,67 min.

Ad.2.

S

(x

i

x) 2

n 1

2,85 min . , co oznacza , że odchylenie standardowe czasu

trwania wszystkich rozmów telefonicznych w tej firmie wynosi 2,85 min ( o tyle różni się ,

średnio biorąc , czas trwania poszczególnych rozmów od przeciętnej rozmowy ).

Ad.3. p

3

0,20 , co oznacza ,że rozmowy zamiejscowe stanowią 20 % ogółu

15

wszystkich rozmów telefonicznych przeprowadzonych w tej firmie.

Ad.4.

p

0,20 * (1 0,20)

0,103

15

Błąd standardowy odsetka rozmów zamiejscowych w tej firmie wynosi 10,3 %.

Estymacja przedziałowa parametrów

Estymacja przedziałowa określonego parametru z populacji generalnej polega na

konstrukcji pewnego przedziału liczbowego ( na podstawie wyników z próby losowej

pobieranej ze zbiorowości generalnej ) , o którym można powiedzieć ,że z przyjętym z

góry prawdopodobieństwem pokryje wartość estymowanego parametru. Przedział taki

nazywamy przedziałem ufności Neymana , natomiast prawdopodobieństwo , że przedział

ten –będący zmienną losową – pokryje nieznany parametr, nazywamy współczynnikiem

ufności i oznaczamy symbolem 1 - . Poziomy współczynników ufności najczęściej

przyjmowane są jako : 0,90;0,95 ;0,99.

Przedziałem ufności nazywamy przedział liczbowy, o którym przypuszczamy , że mieści

się w nim nieznany parametr populacji . Z przedziałem tym związana jest miara ufności (

pewności ) , że ten przedział naprawdę zawiera interesujący nas parametr , zwana

poziomem ufności

Na sposób konstrukcji przedziału ufności ma wpływ liczebność próby losowej . W

zależności od rodzaju szacowanego parametru i liczebności próby można wyróżnić kilka

przedziałów ufności, których sposób konstruowania zostanie przedstawiony na

modelowych przykładach .

Model I. Populacja generalna ma rozkład normalny N ( , ) . Wartość średnia

jest

nieznana , odchylenie standardowe w populacji jest znane. Z populacji tej pobrano próbę

o liczebności n elementów , wylosowanych niezależnie . Wówczas przedział ufności dla

średniej populacji otrzymuje się ze wzoru :

P{x u

n

x u

n

} 1

gdzie :

x - średnia arytmetyczna obliczona z próby

u poziom zmiennej standaryzowanej odczytany z tablic rozkładu normalnego

N(0,1) przy przyjętym z góry współczynniku ufności

- nadzieja matematyczna w populacji generalnej

- odchylenie standardowe w populacji generalnej

n - liczebność próby

Przykład 1. Wybraną w sposób losowy 625 – osobową grupę sportowców zbadano pod

względem czasu poświęconego na trening w miesiącu otrzymując : x 70godz. i

10godz. Wiadomo przy tym ,że czas poświęcony na trening posiada rozkład normalny

. Oszacować metodą przedziałową średni miesięczny czas treningu dla ogółu sportowców

przyjmując współczynnik ufności 0,95.Dla przyjętego współczynnika ufności 1-=0,95

mamy u 1,96 . Przedział ufności jest następujący :

10

P{70 1,96

625

70

10

625

} 1

Ostatecznie otrzymujemy :

69,216 70,784

Otrzymany wynik interpretujemy następująco : przedział liczbowy od 69,216 godzin do

70,784 godzin jest jednym z tych wszystkich możliwych do otrzymania przedziałów, które

z prawdopodobieństwem 0,95 pokrywają szacowany średni czas poświęcony miesięcznie

na trening przez ogół sportowców .Oznacza to , że gdybyśmy wielokrotnie powtarzali

powyższe postępowanie , to średnio biorąc w 95 przypadkach na 100 otrzymywalibyśmy

przedziały dobre ( tzn. pokrywające średni czas poświęcony miesięcznie na trening przez

ogół sportowców ) zaś w pozostałych przypadkach – złe .

Model II. Populacja generalna ma rozkład N ( , ) . Nieznana jest zarówno wartość

, jak i odchylenie standardowe w populacji . Z populacji tej wylosowano

niezależnie małą próbę o liczebności n elementów. Przedział ufności dla średniej

średnia

populacji otrzymuje się wówczas według wzoru :

P{x t

s

n 1

x t

s

n 1

} 1

lub według wzoru równoważnego

P{x t

sˆ

n

x t

sˆ

n

} 1

gdzie x oznacza średnią arytmetyczną obliczoną z próby , s i

standardowymi z próby obliczonymi według wzorów :

s

1 n

( xi x ) 2

n i 1

Wartość

sˆ

ŝ są odchyleniami

1 n

(x x) 2

n 1 i 1

t oznacza wartość zmiennej t – Studenta odczytaną z tablicy tego rozkładu dla

n-1 stopni swobody w taki sposób , by dla danego z góry prawdopodobieństwa 1 - była

spełniona relacja P{t t t } 1 .

Model III. Populacja generalna ma rozkład N ( , ) bądź dowolny inny rozkład o średniej

i skończonej wariancji 2 ( nieznanej ). Z populacji tej pobrano do próby n

niezależnych obserwacji , przy czym liczebność próby jest dużą ( co najmniej kilka

dziesiątków ) . Wtedy przedział ufności dla średniej populacji wyznaczamy ze wzoru jak

w modelu I , z tą tylko różnicą , że zamiast we wzorze tym używamy odchyleń

standardowych s lub ŝ obliczonych z próby. Ze względu na dużą próbę wyniki jej grupuje

się w szereg rozdzielczy o r klasach i wtedy wygodnie jest obliczać x oraz s według

wzorów:

x

1 r o

xj nj

n j 1

s

1 r o

(x j x)2 n j

n j 1

x oj oznacza środek poszczególnego przedziału klasowego, a n j jego liczebność. Gdy

liczba r przedziałów klasowych jest mała , tzn. gdy długość h każdego przedziału

klasowego jest duża , obliczając z powyższego wzoru wartość s należy stosować , tzw.

1 2

2

h , a dopiero potem wyciągnąć

poprawkę grupowania , tj. odjąć od s liczbę

12

gdzie

pierwiastek.

Uwaga : Wzory na przedziały ufności dla średniej

w modelu I i II są wyznaczone w

oparciu o dokładny rozkład statystyki x , natomiast w modelu III w oparciu o jej rozkład

graniczny ( z dużej próby ). Ponadto , podczas gdy przedziały ufności otrzymane w

oparciu o rozkład normalny mają przy ustalonym n stałą długość , to przedziały ufności

otrzymane w oparciu o rozkład Studenta mają w różnych próbach , oprócz końców

również zmienną długość.

Współczynnik ufności 1- przyjmuje się subiektywnie, jako dowolnie duże, bliskie 1 ,

prawdopodobieństwo. Jest ono miarą zaufania do prawidłowego szacunku . Ponieważ

duży współczynnik ufności daje szerszy przedział, nie należy więc bez potrzeby

przyjmować tego współczynnika zbyt wysokiego. Zwykle przyjmuje się współczynniki

ufności 1- wynoszące 0,90 ; 0,95 ( najczęściej ), wreszcie 0,99 lub 0,999 w badaniach

gdzie ryzyko pomyłki jest małe.

Przykład 2 . Wytrzymałość pewnego materiału budowlanego jest zmienną losową o

rozkładzie normalnym N ( , ) . W celu oszacowania nieznanej średniej wytrzymałości

tego materiału dokonano pomiarów wytrzymałości na n=5 wylosowanych niezależnie

sztukach tego materiału . Wyniki pomiarów były następujące ( w kg/cm 2 ) : 20,4 ; 19,6 ;

22,1 ; 20,8 ; 21,1. Przyjmując współczynnik ufności 1- = 0,99 należy zbudować

przedział ufności dla średniej wytrzymałości tego materiału.

Rozwiązanie :

Z treści zadania wynika , że ze względu na nieznajomość odchylenia standardowego

oraz małą próbę mamy do czynienia z przedziałem ufności zbudowanym o rozkład t

Studenta , czyli :

P{x t

s

n 1

x t

s

n 1

} 1

Należy najpierw obliczyć z próby wartości x oraz s .

Obliczenia pomocnicze znajdują się w poniższej tablicy

Wyniki pomiaru

xi x xi x 2

wytrzymałości xi

20,4

19,6

22,1

20,8

21,1

104,0

0,4

1,2

1,3

0

0,3

0,16

0,44

1,69

0

0,09

3,38

Otrzymujemy :

x

104

20,8 kg / cm2 ,

5

s

3,38

0,676 0,82 kg / cm2

5

Następnie z tablic rozkładu Studenta dla 1-=0,99 ( czyli dla =0,01 ) oraz dla n-1 =4

stopni swobody odczytujemy wartość t 4,604 . Podstawiając do wzoru na przedział

ufności otrzymujemy :

20,8 4,604 *

0,82

0,82

20,8 4,604 *

4

4

czyli

18,9 22,7

Możemy powiedzieć ,że przedział liczbowy o końcach 18,9 i 22,7 kg/cm2 z ufnością 0,99

pokrywa nieznaną średnią wytrzymałość tego materiału.

Przykład 3 . Załóżmy , że chcemy oszacować średni staż pracy pracowników

zatrudnionych w pewnej firmie przy produkcji wyrobów . Za pomocą schematu losowania

nieograniczonego niezależnego , wylosowano z populacji tych pracowników próbę liczącą

n=100 osób i otrzymano następujące wyniki badania tego stażu pracy w latach ( wyniki

pogrupowano w szereg rozdzielczy ):

Staż pracy w Liczba pracowników

latach xj

nj

0-2

4

2-4

10

4-6

55

6-8

25

8-10

6

Przyjmując współczynnik ufności 1- =0,90 , zbudować przedział ufności dla średniego

stażu pracy badanej populacji pracowników .

Rozwiązanie Z treści zadania wynika , że ze względu na dużą próbę mamy do czynienia z

modelem III. Przedział ufności dla średniej populacji należy zbudować w oparciu o

rozkład normalny , według wzoru :

P{x u

n

x u

n

} 1

przyjmując zamiast wartość jego zgodnego estymatora s z próby . Obliczenia do

wyznaczenia x i s znajdują się w poniższej tablicy :

xj

nj

x 0j x 0j n j ( x 0j x ) 2 ( x 0j x ) 2 n j

0-2

2-4

4-6

6-8

8-10

4

10

55

25

6

100

1

3

5

7

9

4

30

275

175

54

538

19,36

5,76

0,16

2,56

12,96

77,44

57,60

8,80

64,00

77,76

285,60

Wobec tego otrzymujemy :

x

538

5,38

100

s2

,

285,60

2,856

100

Ze względu na małą liczbę przedziałów ( h=2 lata ) należy zastosować poprawkę na

1 2 4

h

0,333 . Zatem

12

12

s 2,856 0,333 2,523 1,6 . Następnie z tablicy rozkładu normalnego N(0,1)

odczytujemy wartość u . Dla 1- =0,90 ( tzn. dla =0,1 ) odczytujemy ,że

2

grupowanie , tzn. od s odjąć

u 1,64 . Otrzymujemy następujący przedział ufności dla średniego stażu pracy :

1,6

1,6

czyli 5,1 5,7 . Zatem przedział liczbowy o

5,4 1,64

5,4 1,64

100

100

końcach 5,1 i 5,7 obejmuje z ufnością 0,90 prawdziwą średnią stażu pracy w

badanej populacji pracowników w badanej firmie.

Przedział ufności dla wskaźnika struktury

Podstawowym parametrem populacji , szacowanym w przypadku badań

statystycznych ze względu na cechę niemierzalną ( jakościową ) jest frakcja ,

prawdopodobieństwo