Statystyczne metody analizy

danych

Statystyka opisowa

Wykład I-III

Agnieszka Nowak - Brzezioska

Podstawowe pojęcia

STATYSTYKA - nauka traktująca o metodach ilościowych

badania prawidłowości zjawisk (procesów) masowych.

BADANIE STATYSTYCZNE - ogół prac mających na celu

poznanie

struktury

określonej

zbiorowości

statystycznej.

ZBIOROWOŚD (POPULACJA) STATYSTYCZNA – zbiór

dowolnych elementów (osób, przedmiotów, faktów)

podobnych pod względem określonych cech (ale nie

identycznych) poddanych badaniu statystycznemu.

JEDNOSTKA STATYSTYCZNA - składowe (elementy)

zbiorowości (obiekty badania), które podlegają

bezpośredniej obserwacji lub pomiarowi.

n - oznaczenie liczby jednostek

statystycznych w populacji

• ZBIOROWOŚD (POPULACJA) GENERALNA – wszystkie

elementy będące przedmiotem badania, co do których

chcemy formułowad wnioski ogólne.

• ZBIOROWOŚD PRÓBNA (PRÓBA) - podzbiór populacji

generalnej; wyniki badao próby są uogólniane na

zbiorowośd

generalną.

Próba

musi

byd

reprezentatywna.

• Reprezentatywnośd zależy od: sposobu wyboru

jednostek (celowy, losowy) oraz liczebności próby.

• n>30 - duża próba

• n≤30 - mała próba

Populacja a próba

• Z oczywistych powodów nie jesteśmy w stanie

opisad całej tej populacji.

• Musimy się zatem posłużyd podzbiorem populacji

generalnej - pobraną wcześniej próbą.

• Na podstawie analizy tej próby będziemy jednak

chcieli wyciągad wnioski na temat całej populacji.

• Aby to było możliwe należało na wstępie zadbad

aby pobrana populacja w sposób możliwie

reprezentatywny opisywała populację generalną.

Populacja a próba

• Do oceny i opisu populacji próby można posłużyd się

samymi danymi ale jest to niewygodne.

• Z reguły badacz wykorzystuje różnorodne syntetyczne

wska

źniki

(statystyki) mające ilustrowad badaną

populację.

• Gdy opisujemy jakąś skooczoną populację np. wzrost

uczniów z klasy IIA (populacja generalna o skooczonej

liczbie elementów) mówimy o statystykach z populacji.

W przypadku gdy opisujemy jedynie wycinek jakiejś

większej,

najczęściej

niepoliczalnej

populacji

generalnej, mówimy o statystyce z próby.

Estymacja, estymator

• Chcemy zatem wyznaczyd wartośd pewnej

charakterystyki danych populacji na podstawie

próby.

• Wyniki obliczane na próbie chcemy rozciągnąd na

populację i wnioskowad o populacji. Opisywana

zależnośd nosi nazwę estymacji.

• Poszczególne statystyki obliczane z próby takie jak

np. średnia arytmetyczna z próby jest więc tylko

przybliżeniem wartości przeciętnej z populacji m.

• W związku z tym są nazywane estymatorami.

SZEREGI STATYSTYCZNE

SZEREGI STATYSTYCZNE – odpowiednio

usystematyzowany i uporządkowany surowy

materiał statystyczny.

Szeregi statystyczne dzielimy na szeregi:

• szczegółowe

• rozdzielcze (punktowe, przedziałowe)

• czasowe (momentów, okresów)

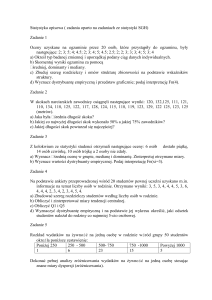

PRZYKŁAD 1 (szereg szczegółowy i szereg

rozdzielczy)

SZEREG ROZDZIELCZY PUNKTOWY

WSKAŹNIK STRUKTURY (wi)

• Wskaźnik struktury (inaczej częstośd) nazywany jest też:

liczebnością względną, frakcją, odsetkiem. Wylicza się go

następująco:

Kolumna liczb { wi }

nazywana jest

rozkładem empirycznym

(liczby usterek).

SKUMULOWANY WSKAŹNIK

STRUKTURY (wi sk)

• Skumulowany wskaźnik struktury (inaczej: częstośd

skumulowana). Wylicza się go następująco:

Kolumna liczb { wi sk }

nazywana jest

dystrybuantą empiryczną

(liczby usterek).

ZALECENIA przy grupowaniu

w szereg rozdzielczy przedziałowy

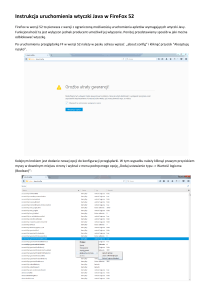

szereg rozdzielczy przedziałowy przykład

• Przedmiotem badania jest czas dojazdu do pracy w dwóch

firmach: X i Y.

Czas dojazdu pracowników firmy X

[w minutach]

Czas dojazdu pracowników firmy Y

[w minutach]

• Pogrupuj dane w szeregi rozdzielcze następującej postaci :

X

Y

WSKAŹNIK PODOBIEOSTWA

STRUKTUR

• Wskaźnik podobieostwa struktur (wp) jest najprostszą miarą

statystyczną pozwalającą ocenid podobieostwo kształtowania

się badanej cechy w dwóch różnych zbiorowościach.

• Wyliczamy go następująco:

X

Y

PREZENTACJA GRAFICZNA

SZEREGOW STATYSTYCZNYCH

HISTOGRAM - wykres słupkowy

DIAGRAM - wykres liniowy

Oba typy wykresów mogą byd sporządzane w

wariantach dla:

• liczebności

• liczebności skumulowanej

• częstości

• częstości skumulowanej

• Dla wzrokowego porównania rozkładu

badanej cechy w dwóch (lub więcej)

zbiorowościach używamy wyłącznie wykresów

częstościowych.

• Dla firmy X wykonad je samodzielnie w domu.

• O innych typach wykresów poczytad

samodzielnie we wskazanych wcześniej

rozdziałach.

Histogram i diagram częstości

dla czasu dojazdu pracowników firmy Y

Histogram i diagram częstości skumulowanej

dla czasu dojazdu pracowników firmy Y

Diagramy częstości

dla czasu dojazdu pracowników firm X i Y

X

Y

Statystyka opisowa to:

• Miary można podzielid na kilka podstawowych kategorii:

• miary położenia, np. kwantyl oraz miary tendencji

centralnej

(np.

średnia

arytmetyczna,

średnia

geometryczna, średnia harmoniczna, średnia kwadratowa,

mediana, moda )

• miary zróżnicowania np. (odchylenie standardowe,

wariancja, rozstęp, rozstęp dwiartkowy, średnie odchylenie

bezwzględne, odchylenie dwiartkowe, współczynnik

zmienności )

• miary asymetrii (np. współczynnik skośności, współczynnik

asymetrii, trzeci moment centralny )

• miary koncentracji (np. współczynnik Giniego, kurtoza )

Średnia arytmetyczna

• Średnią arytmetyczną - definiuje się jako sumę wartości cechy mierzalnej

podzieloną przez liczbę jednostek skooczonej zbiorowości statystycznej.

gdzie:

n - liczebnośd zbiorowości próbnej (próby),

xi - wariant cechy.

Y

Należy pamiętad, że przy

pogrupowaniu danych

źródłowych

w szereg rozdzielczy przedziałowy

następuje pewna utrata

informacji.

Jeżeli policzymy średnią dla

szeregu szczegółowego lub

szeregu rozdzielczego

punktowego, to wynik będzie

dokładny i taki

sam.

Dla danych w postaci szeregu

rozdzielczego przedziałowego

średnia będzie już przybliżeniem.

Tym większym, im szersze są

przedziały klasowe, im jest ich

mniej, itd.

Ważniejsze własności ŚREDNIEJ arytmetycznej

Moda

• Modalna (dominanta D, moda, wartość najczęstsza) - jest to wartośd

cechy statystycznej, która w danym rozdziale empirycznym występuje

najczęściej.

• Dla szeregów szczegółowych oraz szeregów rozdzielczych punktowych

modalna odpowiada wartości cechy o największej liczebności

(częstości).

• W szeregach rozdzielczych z przedziałami klasowymi bezpośrednio

można określid tylko przedział, w którym modalna występuje, jej

przybliżoną wartośd wyznacza się graficznie z histogramu liczebności

(częstości) lub ze wzoru interpolacyjnego:

gdzie: m - numer przedziału (klasy), w którym występuje modalna,

- dolna granica przedziału, w którym występuje modalna,

nm - liczebność przedziału modalnej, tzn. klasy o numerze m, nm-1;

nm+1 - liczebność klas poprzedzającej i następnej, o numerach m -1 i m + 1,

hm - rozpiętość przedziału klasowego, w którym występuje modalna.

• Modalna (Mo) zwana też dominantą (D) jest to

wartośd cechy, która występuje najczęściej w

badanej zbiorowości.

Y

Y

Y

Y

Y

Modalna możemy wyznaczyd graficznie tak jak to pokazano na rysunku

Modalną wyznaczamy i sensownie interpretujemy tylko wtedy, gdy

dane są pogrupowane w szereg rozdzielczy (punktowy lub

przedziałowy).

2. Liczebnośd populacji powinna byd dostatecznie duża.

3. Diagram lub histogram liczebności (częstości) ma wyraźnie

zaznaczone jedno maksimum (rozkład jednomodalny).

4. Dla danych pogrupowanych w szereg rozdzielczy przedziałowy

modalna nie występuje w skrajnych przedziałach (pierwszym lub

ostatnim) - przypadek skrajnej asymetrii. Nie da się w takim

przypadku analitycznie wyznaczyd modalnej.

5. Dla danych pogrupowanych w szereg rozdzielczy przedziałowy

przedział modalnej oraz dwa sąsiednie przedziały (poprzedzający i

następujący po przedziale modalnej) powinny mied taką samą

rozpiętośd.

Miary pozycyjne

• Kwantyle - definiuje się jako wartości cechy badanej zbiorowości,

przedstawionej w postaci szeregu statystycznego, które dzielą zbiorowośd

na określone części pod względem liczby jednostek, części te pozostają do

siebie w określonych proporcjach.

• Kwartyl pierwszy Q1 dzieli zbiorowośd na dwie części w ten sposób, że 25%

jednostek zbiorowości ma wartości cechy niższe bądź równe kwartylowi

pierwszemu Q1, a 75% równe bądź wyższe od tego kwartyla.

• Kwartyl drugi (mediana Me) dzieli zbiorowośd na dwie równe części;

połowa jednostek ma wartości cechy mniejsze lub równe medianie, a

połowa wartości cechy równe lub większe od Me; stąd nazwa wartość

środkowa.

• Kwartyl trzeci Q3 dzieli zbiorowośd na dwie części w ten sposób, że 75%

jednostek zbiorowości ma wartości cechy niższe bądź równe kwartylowi

pierwszemu Q3, a 25% równe bądź wyższe od tego kwartyla.

• Decyle np. decyl pierwszy oznacza, że 10% jednostek ma wartości cechy

mniejsze bądź równe od decyla pierwszego, a 90% jednostek wartości

cechy równe lub większe od decyla pierwszego.

• Kwartyle to takie wartości cechy X, które dzielą zbiorowośd na cztery

równe części pod względem liczebności (lub częstości). Części te pozostają

w określonych proporcjach do siebie.

• Aby dokonywad takiego podziału zbiorowośd musi byd uporządkowana

• według rosnących wartości cechy X.

• Każdy kwartyl dzieli zbiorowośd na dwie części, które pozostają do siebie w

• następujących proporcjach. I tak:

• kwartyl 1 (QI) - 25% z lewej i 75% populacji z prawej strony kwartyla,

• kwartyl 2 (QII) - 50% z lewej i 50% populacji z prawej strony kwartyla,

• kwartyl 3 (QIII) - 75% z lewej i 25% populacji z prawej strony kwartyla.

Mediana

• Mediana (Me) - wartośd środkowa, inaczej: kwartyl 2

(QII).

• Jest to taka wartośd cechy X, która dzieli zbiorowośd na

dwie równe części, tj. połowa zbiorowości

charakteryzuje się wartością cechy X mniejszą lub

równą medianie, a druga połowa większą lub równą.

Mediana dla szeregu szczegółowego

• Szereg musi byd posortowany rosnąco !!!

• Wartośd mediany wyznacza się inaczej gdy liczebnośd

populacji (n) jest nieparzysta, a inaczej gdy jest

parzysta.

Y

Y

Y

Y

Kwartyl pierwszy i trzeci

• Dla szeregu szczegółowego kwartyl pierwszy i trzeci wyznacza

się w ten sposób, że w dwóch częściach zbiorowości, które

powstały po wyznaczeniu mediany, ponownie wyznacza się

medianę; mediana w pierwszej części odpowiada kwartylowi

pierwszemu, a w drugiej kwartylowi trzeciemu.

• Dla szeregu rozdzielczego wyznaczenie kwartyli poprzedza się

ustaleniem ich pozycji:

• gdzie: m - numer przedziału (klasy), w którym

występuje odpowiadający mu kwartyl,

- dolna granica tego przedziału,

nm - liczebnośd przedziału, w którym

występuje odpowiedni kwartyl,

- liczebnośd skumulowana do przedziału

poprzedzającego kwartyl,

hm - rozpiętośd przedziału klasowego, w

którym jest odpowiedni kwartyl.

Miary zmienności (rozproszenia,

dyspersji)

Miary klasyczne

wariancja

odchylenie standardowe

odchylenie przeciętne

współczynnik zmienności

Miary pozycyjne

rozstęp

odchylenie dwiartkowe

współczynnik zmienności

Miary KLASYCZNE

• Wariancja, odchylenie standardowe, odchylenie przeciętne, współczynnik

zmienności (klasyczny)

• Wariancję (s2) definiuje się jako średnią arytmetyczną kwadratów odchyleo

wartości cechy od średniej arytmetycznej zbiorowości. Wariancja jest

wielkością mianowaną w kwadracie miana badanej cechy i nie

interpretujemy jej.

• Odchylenie standardowe (s) jest pierwiastkiem kwadratowym z wariancji.

Jest ono wielkością mianowaną tak samo jak badana cecha. Odchylenie

standardowe określa przeciętne zróżnicowanie badanej cechy od średniej

arytmetycznej.

• Odchylenie przeciętne (d) jest średnią arytmetyczną bezwzględnych odchyleo

wartości cechy od jej średniej arytmetycznej. Jest ono wielkością mianowaną

tak samo jak badana cecha. Odchylenie przeciętne interpretujemy podobnie

jak odchylenie standardowe.

• Współczynnik zmienności (klasyczny) (Vs lub Vd) jest to iloraz odchylenia

standardowego (lub przeciętnego) przez średnia arytmetyczną. Jest to

wielkośd niemianowana.

• Używamy go do porównao zmienności w dwu lub więcej zbiorowościach.

Ocena rozproszenia

na podstawie obserwacji diagramów

Na rysunku pokazano dwa diagramy

częstości (1) i (2).

Dla uproszczenia miary położenia (średnia,

mediana i modalna) są sobie równe i

identyczne dla obu zbiorowości.

Mniejsze rozproszenie wokół średniej

występuje w zbiorowości (1).

Diagram jest smuklejszy i wyższy.

Większe rozproszenie wokół średniej

występuje w zbiorowości (2).

Diagram jest bardziej rozłożysty i niższy.

Odchylenie standardowe w zbiorowości (1)

jest mniejsze niż w zbiorowości (2)

s1 < s2

Przedział TYPOWYCH wartości cechy

(miary klasyczne)

• Przedział taki ma tą własnośd, że około70%

jednostek badanej zbiorowości charakteryzuje

się wartością cechy należącą do tego

przedziału.

Reguła „3 sigma”

Dla szeregów szczegółowych

przykład

• Weźmy dane o liczbie braków:

• 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 1,

1, 1, 1, 1, 1, 1, 1, 2, 2, 2, 2, 2, 2, 3, 3, 3, 3, 4, 4

• Jak pamiętamy: n=50

Dla szeregów rozdzielczych

punktowych

Dla szeregów rozdzielczych

przedziałowych

czas dojazdu pracowników firmy Y

Rozstęp

• Najprostszą i najbardziej intuicyjną miarą zmienności

przypadków w populacji próby jest rozstęp.

• Rozstęp - różnica pomiędzy wartością maksymalną, a

minimalną cechy - jest miarą charakteryzującą

empiryczny obszar zmienności badanej cechy. W

związku z tym, że przy jego obliczeniu ignoruje się

wszystkie dane (za wyjątkiem dwóch wartości minimalnej i maksymalnej), nie daje on jednak

informacji o zróżnicowaniu poszczególnych wartości

cechy w zbiorowości.

Dla szeregów szczegółowych

• Weźmy dane z (liczba braków):

• 0, 0, 0, 0, 0, 0, 0,

0, 0, 0, 0, 0, 0, 0,

0, 0, 0, 0, 0, 0,0, 0,

0, 0, 0, 0, 0, 0, 0,

0, 1, 1, 1, 1, 1, 1,

1, 1, 2, 2,2, 2, 2, 2,

3, 3, 3, 3, 4, 4

Inny przykład

• Weźmy dane z innego przykładu

10, 10, 10, 12, 12, 12, 12,

13, 13, 13,

13, 13, 14, 14, 15, 15, 15

Dla szeregów rozdzielczych punktowych

Dla szeregów rozdzielczych przedziałowych

Wariancja

Rozstęp możemy uznad jedynie za wstępną miarę zmienności w populacji próby. Zresztą

przyjrzyjmy się takiemu przykładowi:

Dwa obszary charakteryzują się identycznymi wartościami średnimi badanego parametru i

identycznymi wartościami minimalnymi i maksymalnymi, a co za tym idzie identycznymi

rozstępami. Jednak już na pierwszy rzut oka widad, że rozrzuty danych wokół wartości

przeciętnej w obu przypadkach są skrajnie różne. W obszarze A dane są znacznie bardziej

skumulowane przy wartości średniej niż w obszarze B.

Wariancja

• Wariancja - jest to średnia arytmetyczna kwadratów odchyleo

poszczególnych wartości cechy od średniej arytmetycznej

zbiorowości.

•

•

•

•

•

szereg szczegółowy

szereg rozdzielczy punktowy

szereg rozdzielczy z przedziałami klasowymi

Wykonując proste przekształcenia algebraiczne, otrzymamy:

szereg szczegółowy

szereg rozdzielczy

Odchylenie standardowe

• Odchylenie standardowe s - jest to pierwiastek

kwadratowy z wariancji. Stanowi miarę

zróżnicowania o mianie zgodnym z mianem

badanej cechy, określa przeciętne zróżnicowanie

poszczególnych wartości cechy od średniej

arytmetycznej.

• Typowy obszar zmienności cechy - około 2/3

wszystkich jednostek badanej zbiorowości

statystycznej posiada wartości cechy w tym

przedziale:

Odchylenie przeciętne

Odchylenie przeciętne d - jest to średnia arytmetyczna

bezwzględnych odchyleo wartości cechy od średniej

arytmetycznej. Określa o ile jednostki danej zbiorowości

różnią się średnio, ze względu na wartośd cechy, od

średniej arytmetycznej.

Pomiędzy odchyleniem przeciętnym i standardowym, dla

tego samego szeregu, zachodzi relacja: d < s.

Odchylenie ćwiartkowe Q

jest to parametr określający odchylenie wartości cechy

od mediany. Mierzy poziom zróżnicowania tylko części

jednostek; po odrzuceniu 25% jednostek o

wartościach najmniejszych i 25% jednostek o

wartościach

największych.

Typowy obszar zmienności cechy:

Miary asymetrii

• wskaźnik skośności

współczynnik skośności

• Rozkłady różnią się między sobą kierunkiem i

siła asymetrii (miary klasyczne):

• dla szeregów symetrycznych

• jeżeli asymetria prawostronna

• jeżeli asymetria lewostronna.

• Wskaźnik skośności - jest to wielkośd

bezwzględna wyrażona jako różnica między

średnią arytmetyczną, a modalną.

Współczynniki skośności (asymetrii)

są stosowane w porównaniach, do określenia

siły oraz kierunku asymetrii, są to liczby

niemianowane, im większa ich wartośd tym

silniejsza asymetria.

Pozycyjny współczynnik asymetrii określa

kierunek i siłę asymetrii jednostek

znajdujących się miedzy pierwszym z trzecim

kwartylem.

Miary koncentracji

• współczynnik skupienia (koncentracji)(kurtoza)

współczynnik koncentracji Lorenza

kurtoza

• Współczynnik

skupienia

(koncentracji)

(kurtoza)

Kjest

miarą

skupienia

poszczególnych obserwacji wokół średniej. Im

wyższa wartośd współczynnika tym bardziej

wysmukła krzywa liczebności, większa

koncentracja wartości cech wokół średniej.

• Jeżeli przyjmiemy, że zbiorowośd ma:

• rozkład normalny, to: K = 3,

• rozkład bardziej spłaszczony od normalnego,

to: K < 3,

• rozkład bardziej wysmukły od normalnego, to:

K > 3.

• Stąd:

Analiza korelacji

Zależności korelacyjne

• Badając różnego rodzaju zjawiska, np. społeczne, ekonomiczne,

psychologiczne, przyrodniczne itp. stwierdzamy niemal zawsze, że

każde z nich jest uwarunkowane działaniem innych zjawisk

• Istnienie związków pomiędzy zjawiskami charakteryzującymi

badane zbiorowości bywa często przedmiotem dociekao i

eksperymentów naukowych.

• Przykład: David Buss w publikacji z 2001 roku pt.

”Psychologia ewolucyjna. Jak wytłumaczyd społeczne zachowania

człowieka?”, opisał badanie, w którym sprawdzał, czy istnieje

związek między szybkością chodzenia a pozycją społeczną. Okazało

się, że związek ten jest dośd wyraźny wśród mężczyzn, natomiast w

mniejszym stopniu wśród kobiet.

Inny przykład:

• Allison i Cicchetti w pracy ”Sleep in mammals”

• (Science, 194, 1976) opisali badania przeprowadzone wśród

przedstawicieli 62 gatunkach ssaków. Przedmiotem obserwacji

(pomiarów) były m.in. następujące charakterystyki:

• długośd snu w ciągu doby (godz/dobę),

• maksymalna długości życia (lata),

• masa ciała (kg),

• masa mózgu (g),

• czas trwania ciąży (dni).

• Cel badania: Ustalenie, czy istnieją jakiekolwiek zależności

pomiędzy wymienionymi charakterystykami, a jeśli tak, to jaka

• jest siła tych zależności.

Kolejny przykład:

• Związek pomiędzy wagą a wzrostem człowieka próbuje

się wyrazid za pomocą tzw. wskaźnika BMI (Body Mass

Index):

• Przyjmuje się, że wartośd BMI dla osób z prawidłową

masą ciała zawiera się mniej więcej w przedziale 18; 5

BMI < 25. Jednak BMI kształtuje się na poziomie

indywidualnym dla konkretnych osób i może znacznie

przekraczad wartośd 25.

• Przykład ten wskazuje, że zależnośd między wagą a

wzrostem nie jest ściśle funkcyjna. Podana formuła

opisuje tylko w przybliżeniu te zależności.

Przy analizie współzależności pomiędzy wzrostem i wagą, nie

oczekujemy, aby zależnośd ta była ściśle funkcyjna, tzn. aby

istniała jednoznacznie określona funkcja matematyczna y = f (x),

podająca wagę y konkretnej osoby z ustalonym wzrostem x.

Mimo tego wydaje się, że ”jakaś” zależnośd pomiędzy wagą i

wzrostem istnieje.

Obserwując obie cechy w dużej zbiorowości osób, dojdziemy do

przekonania, że średnia waga jest większa w grupie osób

wyższych i na odwrót.

Związek między wagą i wzrostem jest przykładem tzw. związku

korelacyjnego, w skrócie – korelacji. Z korelacją mamy do

czynienia wtedy, gdy wraz ze zmianą wartości jednej cechy

zmienia się średnia wartośd drugiej cechy.

• Związek korelacyjny można odkryd obserwując

dużą liczbę przypadków. Nie ujawnia się w

pojedynczych obserwacjach.

• Zależnośd korelacyjna może byd prostoliniowa (w

skrócie – liniowa) lub krzywoliniowa, silna lub

słaba.

• Na podstawie obserwacji wykresu rozproszenia

możemy w przybliżeniu ocenid charakter

zależności i jej siłę.

• Potrzebujemy miary, która pomogłaby wyrazid

siłę zależności w sposób liczbowy.

• Załóżmy, że między cechami X i Y występuje

zależnośd korelacyjna o charakterze liniowym.

• Współczynnikiem służącym do pomiaru siły tego

związku jest współczynnik korelacji liniowej

Pearsona określony wzorem

• gdzie x; y oznaczają średnie arytmetyczne,

natomiast

• sx ; sy – odchylenia standardowe zmiennych

odpowiednio X i Y.

Współczynnik r korelacji liniowej

Pearsona

Współczynnik r korelacji liniowej Pearsona przyjmuje zawsze

wartości z przedziału [-1; 1].

Znak współczynnika informuje o kierunku korelacji (liniowa

ujemna lub liniowa dodatnia).

Wartośd bezwzględna |r| informuje o sile korelacji liniowej.

W szczególnym przypadku, gdy |r|=1, wówczas mamy do

czynienia z korelacją funkcyjną (tzn. zależnośd Y od X można

wyrazid za pomocą funkcji Y = aX + b, gdzie a; b są pewnymi

stałymi).

Współczynnik r mierzy tylko korelację o charakterze

prostoliniowym.

Gdy r = 0, wówczas mówimy, że nie ma korelacji liniowej

(ale może byd krzywoliniowa).

Wyniki badao ssaków

• Kilka wybranych uwag podsumowania:

• wszystkie cechy są ze sobą wzajemnie powiązane (w mniejszym lub większym

stopniu),

• można zauważyd silną, dodatnią korelację liniową między masą mózgu i ciała,

• umiarkowana, ujemna korelacja liniowa między czasem snu a czasem życia,

• dośd silna korelacja (dodatnia lub ujemna) czasu ciąży z innymi zmiennymi,

• Pytanie: Jak opisad zależnośd np. czasu ciąży od wszystkich pozostałych

zmiennych jednocześnie? Odpowiedzi dostarcza analiza regresji.

współczynnik korelacji rang

Spearmana

Jednym ze współczynników korelacji obliczanych dla

danych rangowych jest, określony wzorem

gdzie

Własności:

Współczynnik rS przyjmuje wartości z przedziału [-1; 1].

Wartośd rS = 1 oznacza, że istnieje całkowita zgodnośd

uporządkowao wg rang ai i bi .

Wartośd rS = -1 oznacza z kolei pełną przeciwstawnośd

uporządkowao między rangami.

Wartośd rS = 0 oznacza brak korelacji rang.

przykład

• Przypuśdmy, że porządkujemy 4 studentów w zależności od stopnia

ich zdolności matematycznych, zaczynając od studenta najlepszego,

któremu przydzielamy numer 1, a koocząc na studencie

najsłabszym, któremu przydzielamy numer 4 (ocenę zdolności

powierzamy np. ekspertowi)

• Mówimy wówczas, że studenci zostali uporządkowani w kolejności

rang, a numer studenta jest jego rangą.

• Oznaczmy rangi poszczególnych studentów przez ai .

• Przykładowo, niech: a1 = 4; a2 = 2; a3 = 3; a4 = 1; co oznacza, że w

badanej grupie, ustawionej w kolejności alfabetycznej, pierwszy

student (oznaczmy go umownie literą A) jest najsłabszy, student B –

dobry, student C – słaby, a student D – najlepszy.

• Załóżmy, że w podobny sposób uporządkowaliśmy tych

samych studentów z punktu widzenia ich zdolności

muzycznych. Niech bi będą rangami poszczególnych

• studentów:

• b1 = 2; b2 = 1; b3 = 3; b4 = 4

• W ten sposób każdemu studentowi przyporządkowaliśmy

• po dwie rangi ai oraz bi .

• Pytanie: Jak na tej podstawie możemy ocenid, czy istnieje

zależnośd między zdolnościami matematycznymi oraz

muzycznymi w badanej grupie. Innymi słowy, jak ocenid

stopie o zgodności (lub niezgodności) rang ai ; bi?

• Uwaga: W przypadku danych rangowych nie możemy

zastosowad współczynnika korelacji Pearsona

• korelacyjny wykres rozrzutu (korelogram)

• rodzaje zależności (brak, nieliniowa, liniowa)

• pomiar siły zależności liniowej (współczynnik

korelacji Pearsona, współczynnik korelacji rang

Spearmana)

• liniowa funkcja regresji

Badamy jednostki statystyczne pod katem dwóch

różnych cech - cechy X oraz cechy Y.

Pytanie jakie sobie stawiamy to:

czy istnieje zależnośd pomiędzy cecha X i cecha Y ?

Jeżeli taka zależnośd istnieje, to poszukujemy

odpowiedzi na kolejne pytania:

• jaki jest charakter tej zależności

oraz

• jaka jest jej siła ?

• Zależnośd korelacyjna pomiędzy cechami X i Y

charakteryzuje sie tym, że wartościom jednej

cechy są przyporządkowane ściśle określone

wartości średnie drugiej cechy.

• Jeżeli otrzymamy bezładny zbiór punktów, który nie

przypomina kształtem wykresu znanego związku

funkcyjnego, to powiemy że pomiędzy cechami X i Y nie

ma zależności.

• Gdy smuga punktów układa sie w kształt paraboli,

powiemy, że istnieje zależnośd pomiędzy cechami X i Y i

jest to związek nieliniowy; zależnośd nieliniowa.

• Gdy smuga punktów układa sie wzdłuż linii prostej,

powiemy, że istnieje zależnośd pomiędzy cechami X i Y i

jest to związek liniowy; zależnośd liniowa.

Pomiar KIERUNKU i SIŁY zależności

liniowej. Szeregi szczegółowe

• Współczynnik korelacji (Pearsona) rxy

obliczamy dla cech ilościowych wg

następującego wzoru:

• gdzie:

• C(X,Y) – kowariancja pomiędzy cechami X i Y

• sx (sy) – odchylenie standardowe cechy X

(cechy Y)

INTERPRETACJA współczynnika

korelacji rxy

Znak współczynnika rxy mówi nam o kierunku

zależności. I tak:

• znak plus – zależnośd liniowa dodatnia, tzn.

wraz ze wzrostem wartości jednej cechy rosną

średnie wartości drugiej z cech,

• znak minus – zależnośd liniowa ujemna, tzn.

wraz ze wzrostem wartości jednej cechy

maleją średnie wartości drugiej z cech.

Siła zależności

Wartośd bezwzględna współczynnika korelacji, czyli

|rxy|, mówi nam o sile zależności. Jeżeli wartośd

bezwzględna |rxy|:

• jest mniejsza od 0,2, to praktycznie brak związku

liniowego pomiędzy badanymi cechami,

• 0,2 – 0,4 - zależnośd liniowa wyraźna, lecz niska,

• 0,4 – 0,7 - zależnośd liniowa umiarkowana,

• 0,7 – 0,9 - zależnośd liniowa znacząca,

• powyżej 0,9 - zależnośd liniowa bardzo silna

przykład

W grupie 7 studentów badano zależnośd pomiędzy ocena z egzaminu

ze statystyki (Y), a liczba dni poświęconych na naukę (X).

• Widad tutaj wyraźną zależnośd liniową (dodatnia).

• Obliczamy współczynnik korelacji (Pearsona).

• UWAGA ! Liczebnośd populacji jest mała (n=7). Użyjemy tak małego

przykładu tylko dlatego, aby sprawnie zilustrowad procedurę

liczenia.

Współczynnik korelacji rang

(Spearmana)

• Współczynnik korelacji rang (Spearmana) rS

używamy w przypadku gdy:

• 1. chod jedna z badanych cech jest cecha

jakościowa (niemierzalna), ale istnieje możliwośd

uporządkowania (ponumerowania) wariantów

każdej z cech;

• 2. cechy maja charakter ilościowy (mierzalny), ale

liczebnośd zbiorowości jest mała (n<30).

• Numery jakie nadajemy wariantom cech noszą

nazwę rang.

uwagi

UWAGA! W procesie nadawania rang stymulanty

porządkujemy malejąco, a destymulanty rosnąco.

UWAGA! W procesie nadawania rang może zdarzyd się więcej

niż 1 jednostka o takiej samej wartości cechy (np. k

jednostek).

Wówczas należy na chwile nadad tym jednostkom kolejne

rangi.

Następnie należy zsumowad takie rangi i podzielid przez k

(otrzymamy w ten sposób średnią rangę dla tej grupy k

jednostek).

W ostateczności każda jednostka z tych k jednostek otrzyma

identyczna rangę (średnia dla danej grupy k jednostek).

• Współczynnik korelacji rang (Spearmana) rS

wyznaczamy wg następującego wzoru:

• di – różnica pomiędzy rangami dla cechy X i

cechy Y

Współczynnik korelacji rang (Spearmana) rS spełnia zawsze warunek:

INTERPRETACJA

Analogiczna jak dla współczynnika korelacji (Pearsona).

przykład

• Dla danych z przykładu 1 obliczenia współczynnika korelacji rang

(Spearmana) są następujące:

Wartośd współczynnika

korelacji rang (Spearmana)

potwierdza bardzo silna,

dodatnia (znak plus)

zależnośd pomiędzy czasem

nauki (X), a uzyskana ocena

(Y).

• Analiza korelacji i regresji jest działem statystyki

zajmującym się badaniem związków i zależności pomiędzy

rozkładami dwu lub więcej badanych cech w populacji

generalnej.

• Termin regresja dotyczy kształtu zależności pomiędzy

cechami. Dzieli się na analizę regresji liniowej i nieliniowej.

• W przypadku analizy nieliniowej, graficzną reprezentacją

współzależności są krzywe wyższego rzędu np. parabola.

• Pojęcie korelacji dotyczy siły badanej współzależności.

Analiza regresji i korelacji może dotyczyd dwóch i większej

ilości zmiennych (analiza wieloraka). W tym miejscu

zajmowad się będziemy jedynie najprostszym przypadkiem

regresji prostoliniowej dwóch zmiennych.

Zapamiętad…

• Co to jest korelacja, jakie są jej własności ?

• Kiedy stosowad korelację rang Spearmana a

kiedy Pearsona ?

• Kiedy korelacja jest dodatnia / ujemna ?

• Jak opisywad dany zbiór danych (jakie

wskaźniki)?

• Jak zrobid wykres częstości ?