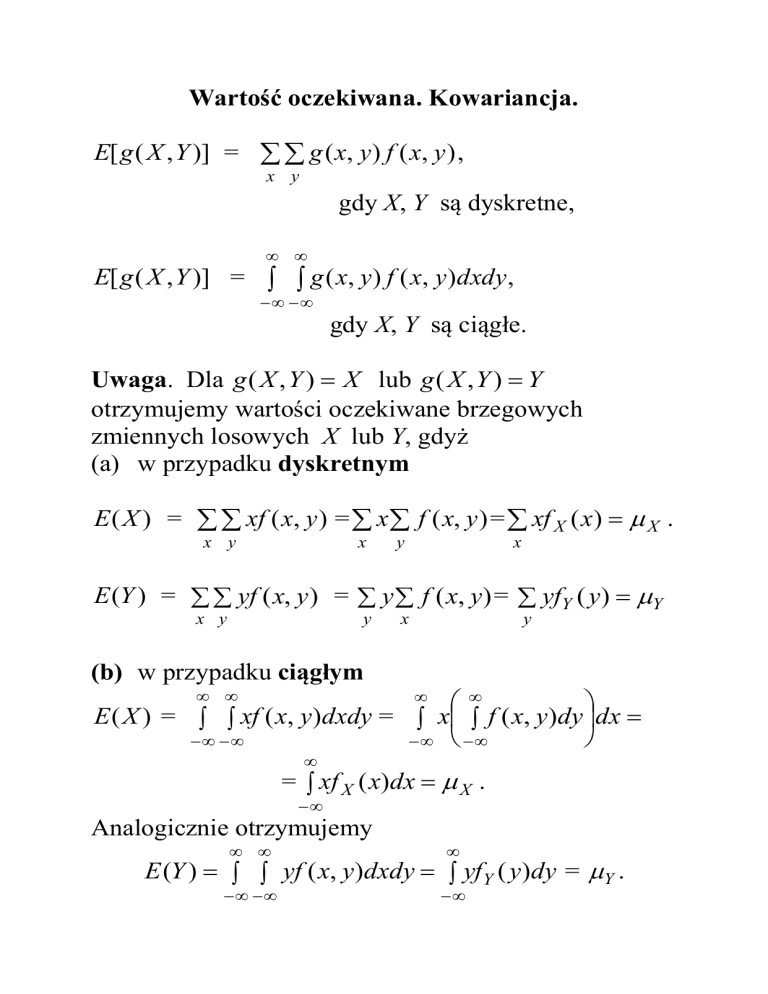

Wartość oczekiwana. Kowariancja.

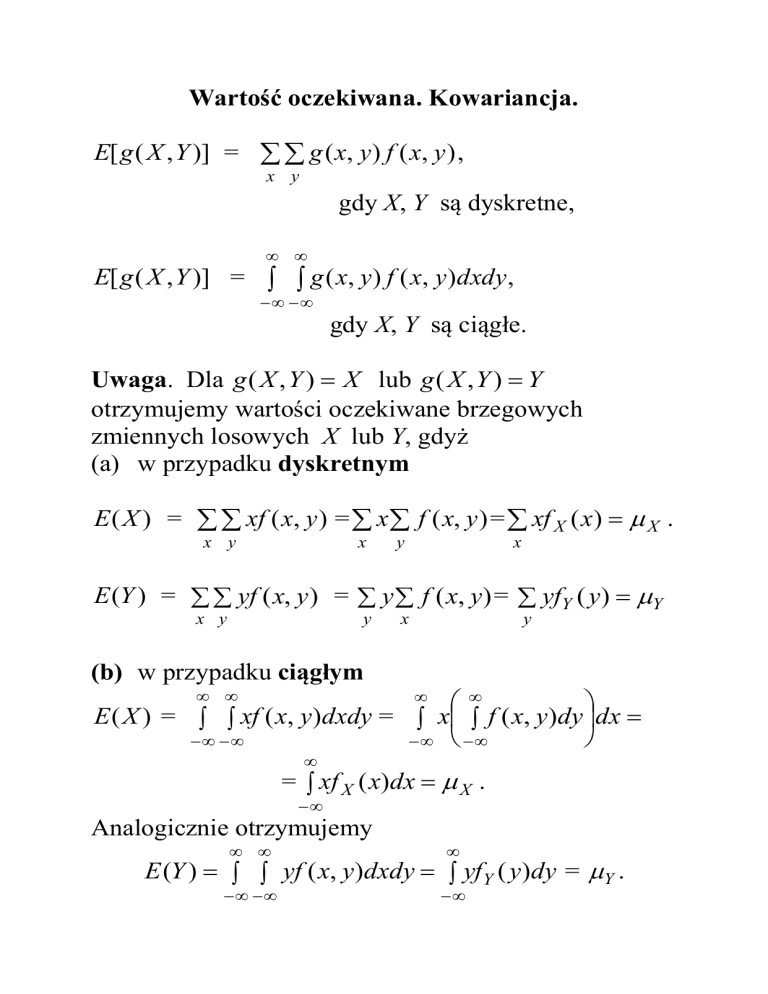

E[ g ( X , Y )] = g ( x, y ) f ( x, y ) ,

x y

gdy X, Y są dyskretne,

E[ g ( X , Y )] = g ( x, y ) f ( x, y )dxdy ,

gdy X, Y są ciągłe.

Uwaga. Dla g ( X , Y ) X lub g ( X , Y ) Y

otrzymujemy wartości oczekiwane brzegowych

zmiennych losowych X lub Y, gdyż

(a) w przypadku dyskretnym

E (X ) = xf ( x, y ) = x f ( x, y ) = xf X ( x) X .

x y

x

x

y

E (Y ) = yf ( x, y) = y f ( x, y ) = yfY ( y ) Y

x y

y

x

y

(b) w przypadku ciągłym

E (X ) = xf ( x, y )dxdy = x f ( x, y )dy dx

= xf X ( x)dx X .

Analogicznie otrzymujemy

E (Y ) yf ( x, y )dxdy yfY ( y )dy = Y .

Stwierdzenie. Niech c będzie dowolną stałą, a

g ( X , Y ) , g1 ( X , Y ) , g 2 ( X , Y ) zmiennymi losowymi

jednowymiarowymi. Wówczas

E[cg ( X , Y ) cE[ g ( X , Y )] ,

E[ g1 ( X , Y ) g 2 ( X , Y )] E[ g1 ( X , Y )] E[ g 2 ( X , Y )].

Stwierdzenie. Jeśli zmienne losowe X, Y są niezależne,

to

E ( XY ) E ( X ) E (Y ) .

Definicja. Niech X i Y będą zmiennymi losowymi o

łącznej funkcji prawdopodobieństwa ( gęstości )

f ( x, y) . Kowariancją zmiennych X i Y nazywamy

liczbę:

XY E[( X X )(Y Y )].

Stąd: XY ( x X )( y Y ) f ( x, y ) ,

x y

gdy X, Y są dyskretne

XY ( x X )( y Y ) f ( x, y )dxdy ,

gdy X, Y są ciągłe.

Notacja: Zamiast XY często piszemy Cov (X,Y).

Stwierdzenie. Cov(X,Y) = E ( XY ) X Y .

Twierdzenie. Jeśli zmienne losowe X i Y są

niezależne, to

Cov(X,Y) = 0.

Uwaga. Twierdzenie odwrotne nie jest na ogół

prawdziwe.

Twierdzenie. Dla dowolnych stałych a, b

Var( aX bY ) =

a 2 Var(X) + b 2 Var(Y) + 2 ab Cov(X,Y).

Wniosek. Jeśli zmienne losowe X i Y są niezależne,

to

Var( aX bY ) = a 2 Var(X) + b 2 Var(Y).

Definicja. Współczynnikiem korelacji między

zmiennymi losowymi X i Y nazywamy liczbę:

Cov( X , Y )

.

Var ( X ) Var (Y )

Zadanie. Zmienna losowa ( X , Y ) ma rozkład ciągły o

gęstości

0 x y 1

Cy

f ( x, y )

dla

.

przeciwnie

0

a) Wyznaczyć stałą C.

b) Obliczyć kowariancję pomiędzy zmiennymi X, Y.

c) Czy zmienne losowe X, Y są niezależne ?

1

1

1

0

x

0

2

a) f ( x, y )dxdy = dx Cydy = C y / 2

x dx =

1

1 1

x2

= C dx = C ( 1/2 - 1/6 ) = 1. Stąd C = 3.

2

0 2

1

1

0

x

b) E ( X ) xf ( x, y )dxdy = xdx 3 ydy =

x x3

= 3 x y / 2 dx = 3 dx = 3

x

2

0 2

0

1

2

1

1

x2 x4 1

=

8 0

4

= 3/8

1

1

0

x

E (Y ) = yf ( x, y )dxdy = dx 3 y 2 dy =

11

x3

= 3 dx =

3

03

x4 1

x = 1 – 1/4 = 3/4

4 0

1

1

0

x

E ( XY ) = xyf ( x, y )dxdy = xdx 3 y 2 dy =

1

xdx = 3 x(1 x )dx = 3( x

=3 x y

0

1

3

1

3

2

0

1

/ 2 x / 5) =

0

5

= 0,9

Cov(X,Y) = 0,9 – (3/8)(3/4) = 99/160.

(c) Cov(X,Y) 0, więc zmienne nie są niezależne, tzn.

są zależne.

Własności współczynnika korelacji

(i)

(ii)

1 1

Jeśli a i b są stałymi, oraz jeśli

Y = a + bX,

to

1

gdy

1

b0

b0

(iii) Jeśli 1, to między zmiennymi losowymi X, Y

istnieje liniowa zależność funkcyjna.

(iv)

Jeśli zmienne losowe X i Y są niezależne, to

0.

Interpretacja. Współczynnik korelacji jest miarą

zależności liniowej między zmiennymi losowymi.

Dwuwymiarowy rozkład normalny

Zmienna losowa ( X , Y ) ma dwuwymiarowy rozkład

normalny, jeśli ma gęstość postaci:

f ( x, y )

1

q

(

x

,

y

)

exp

,

2

2 X Y

2(1 )

1

gdzie

q ( x, y )

( x X )2

X2

2

( x X )( y Y )

XY

( y Y ) 2

y2

x , y , stałe X , Y , spełniają

warunki X > 0, Y > 0, 1 1.

Notacja: ( X , Y ) ~ N ( X , Y , X , Y , )

Twierdzenie. Jeśli ( X , Y ) ~ N ( X , Y , X , Y , ) , to

,

(i)

X ~ N ( X , X ) ,

(ii)

Cov(X,Y) = .

Y ~ N ( Y , Y ) .

(iii) X, Y są niezależne wtedy i tylko wtedy gdy = 0.

Twierdzenie. Zmienna losowa (X,Y) ma

dwuwymiarowy rozkład normalny wtedy i tylko wtedy

gdy zmienna losowa aX + bY ma rozkład normalny, a, b

są dowolnymi stałymi.

Zadanie. Niech zmienna losowa X oznacza dzienną

wartość sprzedaży ( w 100 zł. ) dyskietek a zmienna

losowa Y dzienną wartość sprzedaży papieru

kserograficznego ( w 100 zł.). Wiadomo, że

dwuwymiarowa zmienna losowa ( X , Y ) ma rozkład

normalny o parametrach: X 5 , Y 6 , X 0,5 ,

Y 0,2 0,1. (a) Obliczyć wartość średnią oraz

wariancję łącznej wartości sprzedaży w ciągu 10 dni,

jeśli wartości sprzedaży obu artykułów w kolejnych

dniach są niezależnymi zmiennymi losowymi o

rozkładach takich jak rozkład zmiennej ( X , Y ) . (b)

Obliczyć prawdopodobieństwo, że łączna wartość

sprzedaży w ciągu 10 dni przekroczy 10000 zł.

(a) Łączna wartość sprzedaży:

S10 ( X1 Y1 ) ... ( X10 Y10 ) .

E(S10 ) 10 [ E ( X ) E(Y )] 10(5 6) 110(100 zł.)

Średnia łączna wartość sprzedaży to 11000 zł.

Var( S10 ) = 10 Var(X +Y) = 10 [Var(X) + Var(Y) +

2Cov(X,Y)] = 10( 0,52 0,22 2 0,1 0,5 0,2) =

= 30 (100 2 zł. ).

(b) S10 ~ N (110, 30) . Zatem po standaryzacji

S10 110

~ N (0,1) , skąd

30

S 110 100 110

P( S10 100) = P 10

=

30

30

P( Z 1,8257) = 1 (1,8257) = 1 – [1 - (1,8257) ]

= 0,966.

CIĄGI ZMIENNYCH LOSOWYCH

Niech X1, X 2 ,..., X n będą zmiennymi losowymi

określonymi na tej samej przestrzeni zdarzeń

elementarnych S .

F ( x1, x2 ,..., xn ) = P( X1 x1, X 2 x2 ,..., X n xn ) =

dystrybuanta wektora losowego ( X1, X 2 ,..., X n ).

f ( x1, x2 ,..., xn ) = funkcja prawdopodobieństwa

łącznego lub funkcja gęstości łącznej wektora losowego

( X1, X 2 ,..., X n ).

Definicja. Zmienne losowe X1, X 2 ,..., X n są niezależne,

jeśli

F ( x1, x2 ,..., xn ) = FX 1 ( x1 ) FX 2 ( x2 ) ... FX n ( xn ) ,

gdzie FX i ( x i ) P( X i xi ) , i = 1,2,...,n.

Definicja.

E[ g ( X1, X 2 , , , , X n )] =

... g ( x1 , x2 ,..., xn ) f ( x1 , x2 ,..., xn ) ,

x1 x 2

xn

lub

... g ( x1 , x2 ,..., x n ) f ( x1 , x2 ,..., xn )dx1dx2 ...dxn .

Stwierdzenie. Dla dowolnych stałych a1, a2 ,..., an :

E (a1 X1 a2 X 2 ... an X n ) =

a1E ( X1 ) a2 E ( X 2 ) ... an E ( X n ) .

Wniosek. Niech E ( X i ) , i = 1,2,..,n, oraz

1 n

X Xi .

n i 1

Wówczas E ( X ) = .

1

D. W stwierdzeniu trzeba przyjąć ai , i = 1,2,..,n.

n

Stwierdzenie. Jeśli X1, X 2 ,..., X n są niezależnymi

zmiennymi losowymi, to

Var (a1 X1 a2 X 2 ... an X n ) =

a12 Var( X 1 ) + a2 2 Var( X 2 ) + ... + a n 2 Var( X n ).

1

W szczególności, jeśli Var( X i ) = 2 oraz ai ,

n

i = 1,2,..,n, to

2

Var( X ) =

.

n

Przykład. Dokonujemy n jednakowych, niezależnych

doświadczeń Bernoulli’ego o prawdopodobieństwie

sukcesu p, 0 p 1. Znaleźć wartość oczekiwaną i

wariancję zmiennej losowej Sn będącej liczbą

sukcesów.

Niech X i 1, gdy sukces w i-tym doświadczeniu,

X i 0, gdy porażka w i-tym doświadczeniu. Wówczas

X1, X 2 ,..., X n są niezależnymi zmiennymi losowymi o

funkcjach prawdopodobieństwa:

f X i (1) p , f X i (0) 1 p .

Stąd:

E ( X i ) p , Var( X i ) = p(1 p) .

Liczba sukcesów =

Sn X1 X 2 ... X n .

E (Sn ) = E ( X1 X 2 ... X n ) =

E ( X1 ) E ( X 2 ) ... E ( X n ) = np .

Var( Sn ) =

Var( X 1 ) + Var( X 2 ) + ... + Var( X n ) = np(1 p)

PODSTAWY WNIOSKOWANIA

STATYSTYCZNEGO

Populacja – zbiorowość elementów badanych ze

względu na określoną cechę.

Rozkład populacji = rozkład prawdopodobieństwa

cechy = rozkład prawdopodobieństwa zmiennej

losowej X - cechy losowo wybranego elementu

populacji.

Losujemy n elementów niezależnie i w taki sam sposób

( np. w przypadku skończonej populacji – losowanie ze

zwracaniem ). Niech zmienna losowa X i oznacza

cechę i-go potencjalnie wylosowanego elementu,

i 1,..., n. Wówczas X1 , X 2 ,..., X n są niezależnymi

zmiennymi losowymi o rozkładzie cechy X .

Definicja. Prostą próbą losową o liczności n

nazywamy ciąg niezależnych zmiennych losowych

X1, X 2 ,..., X n określonych na przestrzeni zdarzeń

elementarnych S i takich, że każda ze zmiennych ma

taki sam rozkład.

Mówimy wówczas, że X1, X 2 ,..., X n jest prostą próbą

losową z rozkładu ( odpowiednia nazwa rozkładu ).

Konkretny ciąg wartości x1 , x2 ,..., xn ( prostej ) próby

losowej X1, X 2 ,..., X n nazywamy realizacją ( prostej )

próby losowej lub próbką.

Zadanie statystyki: badanie własności rozkładu cechy

X na podstawie obserwacji – próbki.

Np. jak ocenić X na podstawie realizacji prostej próby

losowej? W jakim sensie średnia próbkowa x jest dobrą

oceną X ?

Rozkład średniej prostej próby losowej

Określenie. Statystyką nazywamy zmienną losową

T ( X1, X 2 ,..., X n ) będącą funkcją próby losowej

X1, X 2 ,..., X n .

Statystykę

X 1 X 2 ... X n 1 n

X

= Xi

n

n i 1

nazywamy średnią z próby losowej X1, X 2 ,..., X n .

Średnia próbkowa x = realizacja statystyki X .

Twierdzenie. ( Prawo wielkich liczb ). Niech

X1, X 2 ,..., X n będzie prostą próbą losową z rozkładu

zmiennej losowej X o średniej . Wówczas dla

dowolnie małej liczby 0

P( X [ , ]) 1, przy n .

Stąd średnia z prostej próby losowej jest dobrym

oszacowaniem średniej teoretycznej ( średniej rozkładu

cechy populacji ): P ( X ) bliskie 1, dla

dostatecznie dużego n.

Stwierdzenie. Niech X1, X 2 ,..., X n będzie prostą próbą

losową z rozkładu zmiennej losowej X o średniej i

wariancji 2 . Wówczas

(a) E ( X ) ,

2

Var( X ) =

,

n

(b) Jeśli X ~ N ( , ) , to X ~ N ( ,

n

)

Zadanie. Załóżmy, że wzrost ( w cm ) w populacji

dorosłych Polaków jest cechą o rozkładzie normalnym o

nieznanej wartości średniej ( cm ) i odchyleniu

standardowym = 6,5 ( cm ). Obliczyć

prawdopodobieństwo, że średnia z prostej próby

losowej o liczności 100 ( średni wzrost 100 losowo

wybranych dorosłych Polaków ) różni się od

prawdziwej wartości o więcej niż 1,5 (cm).

Wiemy, że X ~ N ( ,

6,5

) N ( ,0,65) .

100

P ( X 1,5) P({ X 1,5} { X 1,5}) =

P( X 1,5) + P( X 1,5) =

X 1,5

X 1,5

P

= P

+

=

0,65 0,65

0,65 0,65

= P( Z 2,31) P( Z 2,31) = 2 (2,31) =

2[1 (2,31) ] = 0,0208,

gdzie Z ma standardowy rozkład normalny.

Zauważmy, że dla pojedynczej obserwowanej zmiennej

mamy

P( X 1 1,5) 2 P( Z 0,231) = 0,8180.

( rysunek gęstości średniej )

Twierdzenie. ( CENTRALNE TWIERDZENIE

GRANICZNE = twierdzenie Lindeberga-Levy’ego)

Niech X1, X 2 ,..., X n będzie prostą próbą losową z

rozkładu o średniej i wariancji 2 . Wówczas dla

dużych liczności próby n rozkład prawdopodobieństwa

standaryzowanej średniej jest bliski standardowemu

rozkładowi normalnemu N (0,1) , dokładniej, dla

dowolnych a b zachodzi

X

P(a

b) P(a Z b) (b) (a),

/ n

przy n . Równoważnie rozkład średniej X jest

bliski rozkładowi normalnemu N ( , / n ) .

Uwaga. Przy założeniach centralnego twierdzenia

granicznego rozkład prawdopodobieństwa

standaryzowanej sumy Sn X1 X 2 ... X n jest w

przybliżeniu rozkładem normalnym, tzn.

S n n

P a

b (b) (a) , przy n .

n

Równoważnie rozkład Sn jest bliski N (n , n ) .

Wystarczy zauważyć:

S n n

X

P a

b P a

b

n

/ n

Uwaga. Przybliżenie na ogół można stosować gdy

n 25 .

Wniosek. ( Twierdzenie Moivre’a – Laplace’a)

Jeśli Sn ~ Bin(n, p) , to przy n

S n np

P a

b (b) (a) .

np(1 p)

D. Sn X1 X 2 ... X n , gdzie X1, X 2 ,..., X n jest

prostą próbą losową z rozkładu Bernoulli’ego Bin(1, p) .

Zatem p, 2 p(1 p) . Po podstawieniu

otrzymujemy tezę.

Uwaga. Przybliżenie można stosować gdy

np 5, np(1 p) 5 .

Przykład. Załóżmy, że rozkład codziennego dojazdu do

pracy jest w przybliżeniu rozkładem jednostajnym na

przedziale [0,5 godz., 1 godz. ] i że czasy dojazdów w

różne dni są niezależne. Obliczyć przybliżone

prawdopodobieństwo zdarzenia, że średni dzienny

dojazd w ciągu 30 dni przekroczy 0,8 godz.

Niech X i oznacza czas dojazdu w i-tym dniu ,

i 1,2,...,30 .

0,5 1 3

E( X i )

,

2

4

(1 0,5) 2 1

2

Var ( X i )

.

12

48

3

1

E ( X ) , Var ( X )

4

30 48

P ( X 0,8) = P(

X 3/ 4

0,8 3 / 4

)

1 /(30 48)

1 /(30 48)

P( Z 1,89) 0,03.

Zadanie. Codzienne opóźnienie pociągu ( w minutach )

na pewnej trasie jest zmienną losową ciągłą o gęstości

0 x 10

Cx

.

f ( x) dla

przeciwnie

0

a) Wyznaczyć stałą C.

b) Wyznaczyć dystrybuantę F ( x), x (, ) .

c) Obliczyć prawdopodobieństwa P( X 5) ,

P(5 X 7) .

d) Obliczyć wartość oczekiwaną i wariancję

codziennego opóźnienia pociągu.

e) Obliczyć przybliżone prawdopodobieństwo, że łączne

opóźnienie pociągu na tej trasie w ciągu 90 dni

przekroczy 600 minut, jeśli opóźnienia w kolejnych

dniach są niezależnymi zmiennymi losowymi.

10

0

a) f ( x)dx Cxdx C 50 = 1. C = 1/50.

x

x

0dt

x0

b) F ( x) f (t )dt = x

dla

,

0 x 10

(t / 50)dt

0

Zatem

x0

0

F ( x) x 2 / 100 dla 0 x 10.

1

x 10

c) P( X 5) = 1 – F(5) = 1- 25/100 = 0,75.

P(5 X 7) = F(7) – F(5) = 0,49 – 0,25 = 0,24.

10

0

d) E ( X ) xf ( x)dx = ( x 2 / 50)dx = 20/3,

10

E ( X ) x f ( x)dx ( x 3 / 50)dx = 50.

2

2

0

2 Var ( X ) E ( X 2 ) - 2 = 50 – 400/9 = 50/9.

e) Niech S90 X1 X 2 ... X 90 oznacza łączny czas

opóźnienia w ciągu 90 dni. X1, X 2 ,..., X n jest prostą

próbą losową z rozkładu o gęstości takiej jak

gęstość zmiennej X. X i = opóźnienie i-go dnia.

20

600.

3

50

Var( S90 ) = 90 .

9

Z Centralnego Twierdzenia Granicznego rozkład

50

).

S90 jest bliski rozkładowi N (600, 90

9

E ( S90 ) 90

P(S90

600 600

S 90 600

600) P

=

90 50 / 9

90 50 / 9

P( Z 0) 1 (0) = 1 - 0,5 = 0,5.

Poprawka w przybliżeniu normalnym

Jeśli zmienne losowe X i w prostej próbie losowej

przyjmują jedynie wartości całkowite, to otrzymamy

lepsze przybliżenie rozkładem normalnym stosując

Centralne Twierdzenie Graniczne ( w szczególności

twierdzenie Moivre’a – Laplace’a ) z tzw. poprawką

uwzględniającą fakt, że rozkład dyskretny przybliżamy

rozkładem ciągłym, dokładniej zauważmy iż dla

całkowitych a i b mamy:

n

n

i 1

i 1

P(a X i b) = P(a 0,5 X i b 0,5)

n

(1) P(a 0,5 X i b 0,5) =

i 1

n

X i n X

a 0,5 n

b 0,5 n X

X

P

i 1

n X

n X

n X

b 0,5 n X

n X

Równoważnie mamy:

a 0,5 n X

n X

.

(2)

b 0,5

a 0,5

P

X

n

n

b 0,5 n X

=

n X

a 0,5 n X

-

n X

Przykład. Załóżmy, że nowa szczepionka będzie

testowana na 100 osobach. Producent ocenia jej

skuteczność na 80 %. Znaleźć przybliżone

prawdopodobieństwo, że

(a) pożądaną odporność uzyskają mniej niż 74 osoby,

(b) co najmniej 74 osoby i co najwyżej 85 osób uzyska

odporność po zastosowaniu szczepionki.

Niech S100 X1 X 2 ...X100 będzie liczbą osób

spośród 100 testowanych, które uzyskają odporność,

gdzie X1, X 2 ,..., X100 jest prostą próbą losową z

rozkładu Bernoulli’ego Bin(1,0,8) . Stąd

E ( X 1 ) 0,8 , 2 Var( X1 ) 0,8 0,2 0,16 ,

0,4.

(a) Wstawiając we wzorze (1) a , b 73, n =100

mamy: P(S100 74) P(S100 73)

S 100 0,8 73 0,5 100 0,8

P 100

100 0,4

100 0,4

73,5 80

P Z

= P( Z 1,62) = 1 – 0,9474 =

4

= 1 - P( Z 1,62) = 1 – 0,9474 = 0,0526.

85,5 80

73,5 80

Z

(b) P(74 S100 85) P

=

4

4

= P(1,63 Z 1,37) (1,37) (1,63) =

= (1,37) [1 (1,63)] = 0,9147 – 1 + 0,9484 =

= 0,8631.

Rozkład częstości

Niech X będzie zmienną losową o rozkładzie

Bernoulli’ego, tzn.

P( X 1) p i P( X 0) q 1 p .

W zastosowaniach często p 100 % oznacza procent

elementów badanej populacji posiadających określoną

własność. Wówczas p nazywamy proporcją lub

wskaźnikiem struktury.

X 1 p 0 (1 p) p

X 2 12 p 02 (1 p) p 2 p(1 p)

Niech X1, X 2 ,..., X n będzie prostą próbą losową z

rozkładu X. ( X i 1 (0) jeśli i-ty wylosowany element

ma ( nie ma ) określoną własność ).

n

Xi

S

pˆ i 1 = n = X nazywamy częstością wystąpienia

n

n

(elementów o danej własności ) w prostej próbie

losowej.

p (1 p )

.

E ( pˆ ) p , Var( p̂ ) =

n

Z Centralnego Twierdzenia Granicznego dla średniej

z próby losowej mamy:

P ( a

pˆ p

b (b) (a ) ,

p (1 p )

n

gdy n , oraz na mocy wzoru (2)

b 0,5

a 0,5

P

pˆ

n

n

b 0,5 np

a 0,5 np

-

.

=

np(1 p )

np(1 p )

Twierdzenie. Dla dowolnych a, b

P( a

pˆ p

b (b) (a) , gdy n .

pˆ (1 pˆ )

n

Zadanie. W populacji dorosłych Polaków 39 % ma

kłopoty ze snem. Oszacować prawdopodobieństwo, że

wśród 100 losowo wybranych dorosłych Polaków

częstość osób mających kłopoty ze snem nie przekroczy

0,33.

P( pˆ 0,33) P(S100 100 0,33) P(S100 33,5) =

S 100 0,39

33,5 100 0,39

= P 100

100 0,39 0,61

100 0,39 0,61

(1,13) 1 (1,13) 0,1292.